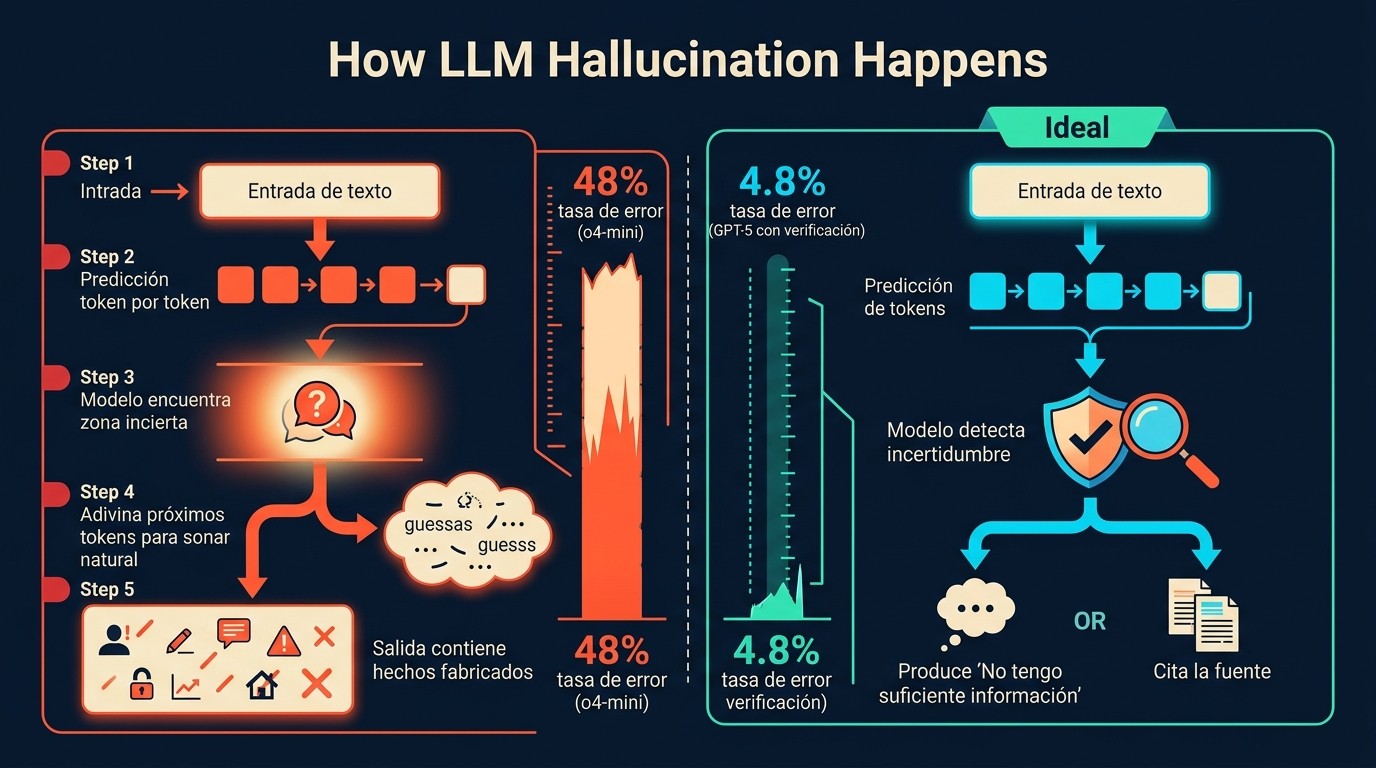

Las alucinaciones en GPT no son un bug menor: son una consecuencia directa de cómo funcionan los modelos de lenguaje. GPT-4o alucinó en el 20,6% de las consultas evaluadas por OpenAI; su sucesor GPT-5 bajó eso al 4,8%. Pero o3 alucinó 33% en resúmenes y o4-mini llegó al 48%. Los números no mienten, aunque el modelo sí.

En 30 segundos

- Una alucinación en IA es una respuesta plausible pero falsa que el modelo genera porque predice palabras, no verifica hechos.

- GPT-5 mejoró la tasa de alucinación al 4,8%, pero o3 llega al 33% y o4-mini al 48% en ciertos benchmarks.

- Dos bufetes de abogados fueron multados con USD 31.100 en 2026 por usar citas legales inventadas por ChatGPT.

- RAG, búsqueda web integrada y temperatura baja vía API reducen las alucinaciones, pero no las eliminan.

- Para tareas críticas (legal, salud, finanzas), la revisión humana no es opcional: es el único control real.

¿Qué son las alucinaciones en GPT?

Una alucinación en GPT es una respuesta que suena completamente razonable pero es falsa. El modelo no accede a una base de datos de hechos verificados: predice qué palabra viene después de la anterior, optimizando para que el texto sea coherente y plausible. Si esa predicción no coincide con la realidad, tenés una alucinación.

Hay dos tipos. La alucinación intrínseca contradice directamente una fuente que el modelo tiene disponible. La extrínseca es más sutil: el modelo genera información que no estaba en ninguna fuente, pero la presenta como si fuera real. Esta segunda es la más peligrosa porque no podés detectarla comparando contra el input.

Los ejemplos históricos son llamativos. Google Bard inventó que el telescopio James Webb había fotografiado el primer exoplaneta fuera del sistema solar (error de astronomía básica). Sydney, el chatbot de Bing, afirmó falsamente que espiaba a los usuarios a través de sus cámaras web. Galactica, el modelo de Meta para ciencia, generó información con sesgos graves antes de que lo dieran de baja a los tres días del lanzamiento. Casos reales, con nombres, no abstracciones.

Las cifras de 2026: mejora real, pero insuficiente

Ponele que confiás en los propios benchmarks de OpenAI, que es asumir bastante. Según la documentación oficial de OpenAI sobre alucinaciones, GPT-4o tenía una tasa de alucinación del 20,6% en evaluaciones estructuradas. GPT-5 la bajó al 4,8%. Eso es una mejora real, no menor.

Ahora vienen los datos que no aparecen en el comunicado de prensa:

| Modelo | Tasa de alucinación | Contexto del benchmark |

|---|---|---|

| GPT-4o | 20,6% | Evaluación general OpenAI |

| GPT-5 | 4,8% | Evaluación general OpenAI |

| o1 | 16% | Resúmenes de documentos |

| o3 | 33% | Resúmenes de documentos |

| o4-mini | 48% | Resúmenes de documentos |

¿Alguien verificó estos números de forma independiente? Todavía no de manera sistemática. Pero el patrón es claro: los modelos razonantes (o-series) razonan mejor en matemática y lógica formal, pero alucinan más en tareas de resumen y síntesis de texto.

El contexto regulatorio no ayuda. Un estudio del Stanford RegLab de 2024 encontró que 3 de cada 4 abogados planean incorporar IA a su flujo de trabajo, y que en 1 de cada 3 consultas legales aparecen alucinaciones. Para una profesión donde citar mal una jurisprudencia puede costarte el caso (y la carrera), ese número es alarmante.

Casos reales: cuando alucinar tiene consecuencias legales

En 2023, el abogado Amir Mostafavi presentó un escrito legal con citas de casos inventados por ChatGPT. El juez los buscó, no los encontró, y Mostafavi terminó con una multa de USD 10.000. No es el único. Complementá con técnicas avanzadas de prompting en GPT Image.

En mayo de 2026, dos bufetes distintos recibieron multas por un total de USD 31.100 por presentar investigación legal falsa generada por IA. En ambos casos, los abogados no verificaron las citas antes de presentarlas. El problema no era ChatGPT: era confiar en ChatGPT sin doble verificación.

A principios de 2024, un hombre demandó a OpenAI tras una crisis psicótica que atribuye a conversaciones con ChatGPT. El modelo, según la demanda, inventó un concepto llamado “high-level inscription” y lo trató como si fuera una teoría filosófica establecida, llevando al usuario por un espiral de interpretaciones cada vez más desconectadas de la realidad. No es un caso aislado de uso edge: es alguien usando el producto exactamente como fue diseñado.

¿Por qué OpenAI dice que es inevitable?

La respuesta corta es que la arquitectura no fue diseñada para distinguir verdad de mentira.

Un modelo de lenguaje grande aprende a predecir la siguiente palabra dado un contexto. El entrenamiento lo optimiza para que las respuestas sean fluidas, coherentes y plausibles según los patrones del texto humano. Ninguna parte de ese proceso incluye etiquetar proposiciones como verdaderas o falsas. El modelo no tiene acceso privilegiado a los hechos del mundo: tiene patrones estadísticos sobre cómo las personas escriben sobre esos hechos.

La analogía que más me convence: es como un estudiante que lleva meses estudiando patrones de exámenes anteriores, pero cuando aparece una pregunta nueva, adivina con confianza en vez de decir “no sé”. Los incentivos del entrenamiento favorecen una respuesta plausible sobre una admisión de incertidumbre. Y ahí está el problema.

OpenAI lo admite públicamente (algo que no siempre hizo): resolver las alucinaciones requiere un rediseño fundamental de la arquitectura, no solo mejores datos de entrenamiento o más parámetros. GPT-5 mejoró. Pero “menos malo” no es lo mismo que “confiable”.

Técnicas prácticas para reducir alucinaciones

Ninguna técnica las elimina. Eso dicho, combinadas sí reducen el riesgo de forma medible. Relacionado: cuál modelo comete menos errores en código.

Contexto específico en el prompt

Si le pedís a GPT que resuma “el caso legal sobre patentes de software”, va a inventar detalles para llenar los huecos. Si le das el texto completo del fallo y le pedís que extraiga los argumentos principales del párrafo 3 al 7, el espacio para alucinaciones se achica. Más contexto concreto, menos relleno fabricado.

Pedir fuentes explícitamente

No garantiza nada (el modelo puede inventar las citas también), pero agrega una capa de fricción útil. Cuando el modelo tiene que citar, tiende a ser más conservador con las afirmaciones que no puede respaldar. Y si inventa una cita, es más fácil de detectar.

Temperatura baja vía API

Si usás la API directamente, bajar la temperatura a menos de 0,5 hace que las respuestas sean más deterministas y conservadoras. El modelo toma menos riesgos en sus predicciones. Zafa para tareas estructuradas; para texto creativo, lo hace aburrido.

Instrucciones personalizadas en ChatGPT Plus

En la sección de instrucciones del sistema podés agregar algo como “Si no sabés la respuesta con certeza, decime que no tenés información suficiente en lugar de inventar”. No es infalible, pero reduce la frecuencia con que el modelo rellena huecos silenciosamente.

Validación con fuentes externas

Esto es lo más básico y lo que más se saltea: verificar los datos importantes en fuentes primarias antes de usarlos. Si GPT te dice que un estudio de Harvard encontró que X, buscalo. Si no existe, acá tenés tu alucinación.

Herramientas y arquitecturas para el problema

RAG (Retrieval-Augmented Generation) es la respuesta técnica más seria al problema. En vez de pedirle al modelo que recuerde hechos de su entrenamiento, RAG le da documentos relevantes al momento de generar la respuesta. El modelo trabaja sobre información verificada, no sobre patrones estadísticos de memoria.

La búsqueda web integrada de ChatGPT Plus funciona bajo un principio similar: en vez de confiar en lo que “recuerda”, consulta fuentes actuales. Reduce las alucinaciones sobre eventos recientes. Pero ojo: no las elimina. El modelo todavía puede malinterpretar lo que encuentra o sintetizarlo incorrectamente. En análisis completo entre Gemini y ChatGPT profundizamos sobre esto.

La validación cruzada es subestimada: si hacés la misma pregunta con ligeras variaciones y el modelo te da respuestas contradictorias, hay alucinación o incertidumbre alta. Es una señal de alerta barata.

Para organizaciones que usan IA en producción, las métricas de monitoreo recomendadas por Lakera incluyen tasa de alucinación por debajo del 5%, puntuación de fidelidad entre 0 y 1, y frecuencia de intervención humana necesaria. Cualquier sistema que no mida estas variables no sabe realmente qué tan bien está funcionando.

Confusiones comunes sobre alucinaciones

“Con web search activado, GPT no alucina.” Incorrecto. El modelo puede buscar información correcta y aun así sintetizarla mal. Puede elegir la fuente equivocada. Puede combinar dos fuentes de forma que el resultado no represente a ninguna.

Otra: creer que los modelos razonantes (o3, o4) no alucinan porque “piensan antes de responder”. Los datos dicen lo contrario: o3 alucinó 33% en resúmenes. El razonamiento mejorado ayuda con tareas lógicas estructuradas, no con la fidelidad factual en texto libre.

Y la más común: confundir alucinación con falta de datos de entrenamiento recientes. GPT-5 puede alucinar sobre datos históricos de hace 10 años que estaban en su entrenamiento. El problema no siempre es “no tiene la info”, sino “confabula en vez de admitir incertidumbre” (que vale tanto para info reciente como para info antigua).

Qué está confirmado y qué no

| Afirmación | Estado |

|---|---|

| GPT-5 redujo la tasa de alucinación al 4,8% (vs 20,6% de GPT-4o) | Confirmado por OpenAI |

| o3 alucinó 33% en benchmarks de resúmenes | Confirmado en evaluaciones publicadas |

| Multas por USD 31.100 a dos bufetes por citas falsas generadas por IA | Confirmado (mayo 2026) |

| La arquitectura actual puede eliminar alucinaciones con más parámetros | No confirmado — OpenAI dice que requiere rediseño fundamental |

| RAG elimina las alucinaciones completamente | No confirmado — reduce, no elimina |

Cómo usar GPT de forma segura: lo básico

Nunca uses GPT como fuente única para información factual que importa. Para síntesis, redacción, brainstorming o código: excelente. Para citas legales, diagnósticos, datos financieros o afirmaciones que vas a publicar: verificá siempre en fuentes primarias antes de usar lo que te dice.

Si trabajás en un equipo que usa IA para generar contenido o documentación pública, la revisión humana no es un lujo: es el único control real que tenés sobre lo que sale publicado. Un flujo donde cualquier output de IA puede llegar al cliente final sin revisión es un flujo esperando su próximo escándalo.

Pedile siempre referencias. Si no puede dártelas, o si las que te da no existen cuando las buscás, tratá esa información como hipótesis a verificar, no como hecho. Es un cambio de mentalidad más que un cambio técnico, y es el más importante. Tema relacionado: comparativa entre generadores de imagen.

Si querés profundizar en cómo alucina la IA, tenemos un análisis en My guy was hallucinating HARD today.

Preguntas Frecuentes

¿Por qué GPT alucina y genera información falsa?

Porque fue entrenado para predecir la siguiente palabra, no para verificar hechos. El modelo optimiza coherencia y plausibilidad, no veracidad. Cuando no tiene información suficiente, rellena los huecos con patrones estadísticos que suenan bien pero pueden ser completamente inventados.

¿Cuál es la tasa de alucinación actual en ChatGPT?

Depende del modelo y la tarea. GPT-5 alcanza 4,8% en evaluaciones generales de OpenAI, una mejora respecto al 20,6% de GPT-4o. Pero o3 llega al 33% y o4-mini al 48% en benchmarks de resúmenes. No hay una sola cifra: varía por modelo, tarea y forma de medir.

¿Cómo puedo evitar que ChatGPT me dé información falsa?

Combiná varias técnicas: contexto específico y completo en el prompt, pedido explícito de fuentes, temperatura baja si usás la API, búsqueda web integrada para datos recientes, y validación manual de cualquier dato que vayas a usar en contexto crítico. Ninguna técnica sola es suficiente.

¿Cuál es la diferencia entre alucinación intrínseca y extrínseca en IA?

La intrínseca contradice información que el modelo tenía disponible (contradice su propia fuente). La extrínseca agrega información que no estaba en ninguna fuente pero suena creíble. La extrínseca es más peligrosa porque no podés detectarla comparando contra el input: tenés que buscar fuera del sistema.

¿Qué hago si ChatGPT alucina en información crítica?

Si estás en legal, salud o finanzas, la respuesta es simple: no usés GPT como fuente de verdad en esas tareas sin revisión humana. Para cualquier alucinación que ya llegó a producción (un documento, una publicación), corregila explícitamente y con la fuente correcta citada. El costo de no hacerlo puede incluir multas, como vimos con los bufetes en 2026.

Conclusión

Las alucinaciones en GPT mejoraron: GPT-5 al 4,8% es un progreso genuino sobre el 20,6% de GPT-4o. Pero los modelos razonantes como o3 y o4-mini van en la dirección contraria para tareas de texto, con tasas del 33% y 48% respectivamente. No es una tendencia lineal de mejora continua: es un mapa complejo donde cada modelo tiene sus puntos ciegos.

Lo que cambió es que las consecuencias ya son concretas y costosas. USD 31.100 en multas legales en un solo mes no es un escenario hipotético. Un hombre demandando a OpenAI tras una crisis psicótica inducida por el modelo tampoco.

El paso concreto para hoy: si tu equipo usa IA para generar cualquier contenido que llega a clientes, reguladores o decisiones críticas, implementá revisión humana obligatoria en ese pipeline. No como política futura, sino como flujo de trabajo que existe ya.

Fuentes

- OpenAI — Por qué los modelos de lenguaje alucinan (documentación oficial)

- Lakera — Guía completa sobre alucinaciones en LLMs

- Infobae — Informe OpenAI sobre persistencia de alucinaciones

- Informatec Digital — Cómo reducir alucinaciones en ChatGPT

- Toronto Life — Hombre demanda a OpenAI tras crisis inducida por ChatGPT