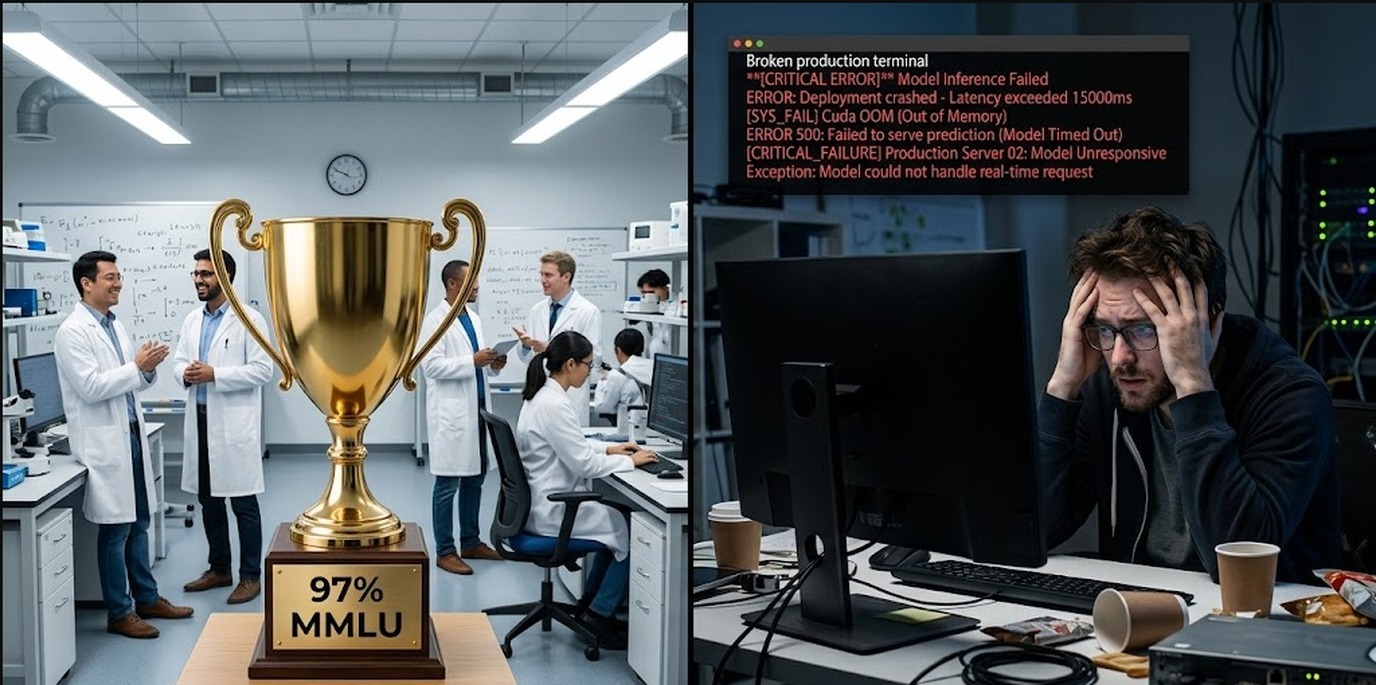

Los benchmarks de modelos IA como MMLU, GSM8K y HumanEval tienen un problema serio: miden lo que es fácil de medir, no lo que importa. Estudios de 2026 documentan un gap promedio del 37% entre el puntaje en laboratorio y el rendimiento real en producción, y algunos datasets como MMLU Math tienen tasas de error en sus propios datos de hasta el 42%.

En 30 segundos

- Los benchmarks más usados (MMLU, GSM8K, ARC) miden opciones múltiples, no tareas reales de trabajo.

- El 42% de las preguntas de MMLU Math tiene errores o ambigüedades en los datos originales, según auditorías de 2026.

- Existe un gap documentado del 37% entre el score en benchmark y el rendimiento real en producción.

- Varias empresas optimizan sus modelos para pasar evaluaciones conocidas sin mejorar rendimiento general.

- Existen alternativas más confiables: benchmarks propios con casos reales, pruebas A/B en producción, y plataformas como Vercel AI Gateway Leaderboard que usan tráfico real.

Vercel es una plataforma de despliegue en la nube que proporciona hosting y servicios de edge computing para aplicaciones web. Fue desarrollada por Vercel Inc. y se especializa en frameworks modernos como Next.js, React y Vue.

Un benchmark de modelo IA es una evaluación estandarizada diseñada para medir capacidades específicas de un modelo de lenguaje, como razonamiento matemático, comprensión de texto o generación de código, usando un conjunto fijo de preguntas con respuestas correctas conocidas. El problema es que “capacidades específicas medidas en condiciones de laboratorio” y “utilidad real para tu equipo” son dos cosas distintas.

Por qué los benchmarks de modelos IA imprecisos dominan igual el debate

Ponele que tu empresa está evaluando qué modelo usar para automatizar respuestas a clientes. Abrís una tabla comparativa, ves que el modelo A tiene 92.3% en MMLU y el modelo B tiene 87.1%, y concluís que el A es mejor. Lógico, ¿no?

Excepto que MMLU mide preguntas de opción múltiple sobre 57 temas académicos. Tu caso de uso es responder mails con contexto de historial de compras, tono específico de marca, y referencias a productos con nombres técnicos. MMLU no mide nada de eso.

El AI Index 2026 de Stanford documenta que los modelos top siguen subiendo en los benchmarks clásicos pero que la correlación con satisfacción de usuarios reales se estanca. Los benchmarks se crearon para comparar rápido y publicar papers. Nunca fueron diseñados para que un equipo de DevOps eligiera su LLM de producción.

Problemas estructurales que nadie te cuenta cuando mirás el leaderboard

El primer problema es la calidad de los datos. Auditorías independientes de 2026 encontraron que MMLU Math tiene hasta un 42% de preguntas con errores, ambigüedades o respuestas contestables de más de una forma. Los benchmarks de SQL tienen tasas similares o peores: según Kili Technology, más del 50% de los datasets de SQL usados en evaluaciones tienen inconsistencias en la ground truth. O sea, los modelos compiten para acertar preguntas que a veces no tienen una respuesta correcta única.

El segundo problema es la contaminación de datos. Los datasets de benchmark son públicos. Las empresas que entrenan modelos tienen acceso a esos datasets. Si el modelo los vio durante el entrenamiento (aunque sea de forma indirecta), sus respuestas no representan generalización sino memorización. Investigaciones publicadas en 2026 confirman que varios modelos top en HumanEval muestran signos claros de overfitting al dataset específico, con caídas de rendimiento de 15-25 puntos cuando se usan variaciones ligeramente distintas de las mismas tareas.

El tercer problema es la saturación. GSM8K, que mide razonamiento matemático básico, ya tiene modelos con scores de 97%+. ¿Significa que los modelos resolvieron el razonamiento matemático? No. Significa que GSM8K ya no diferencia. El benchmark quedó obsoleto antes de que alguien lo reemplazara por algo mejor. Relacionado: qué tal se desempeña ChatGPT.

El cuarto problema, y quizás el más ignorado: los benchmarks tienen sesgos culturales y lingüísticos. La mayoría están construidos sobre textos en inglés, con referencias culturales anglosajonas. Un modelo puede “entender” mejor inglés no porque sea más inteligente sino porque fue entrenado en más texto en ese idioma. Para equipos que trabajan en español rioplatense o portugués de Brasil, los rankings no dicen casi nada.

La brecha de producción: 37 puntos que no aparecen en el gráfico

Las investigaciones que comparan desempeños en benchmarks con métricas de producción consistentemente encuentran brechas importantes. El número que circula en 2026 es 37% promedio: un modelo que puntúa 90% en lab puede rendir como si fuera un 53% en condiciones reales. ¿Por qué?

Primero, la latencia. Un modelo con desempeño perfecto que tarda 8 segundos en responder puede ser menos útil que uno con score inferior que responde en 0.8 segundos, dependiendo del caso de uso. Los benchmarks no miden latencia.

Segundo, la consistencia. Si hacés la misma pregunta 100 veces con temperatura ≥ 0, los modelos varían sus respuestas. En benchmarks se toma una respuesta. En producción, la varianza importa, especialmente si construís flujos de trabajo que dependen de formato predecible.

Tercero, el contexto largo real. Muchos benchmarks usan prompts de 200-500 tokens. Vos en producción quizás mandás 50K o 100K tokens de contexto. El rendimiento degrada de formas no lineales y distintas según el modelo. El benchmark de ventana de contexto no mide dónde exactamente falla la atención del modelo a medida que el contexto crece.

Gaming de benchmarks: cómo se manipulan las métricas

Acá viene lo bueno (o lo malo, según cómo lo mirés).

Las empresas que lanzan modelos saben cuáles son los benchmarks que los periodistas técnicos van a citar. Saben que MMLU, MATH, HumanEval y GPQA son los que aparecen en las comparativas. Así que optimizan para esos benchmarks específicamente, sea mediante fine-tuning dirigido o mediante el proceso de RLHF, que puede estar sesgado hacia las respuestas que puntúan bien en las evaluaciones conocidas. Para más contexto, ver nuestro análisis sobre modelos de lenguaje actuales.

¿Alguien lo verificó de forma independiente y sistemática? En la mayoría de los casos, no. Los reportes de lanzamiento de modelos son preparados por las propias empresas. La metodología de evaluación suele estar parcialmente documentada, con detalles que permiten cierta libertad en cómo se presenta el resultado.

También están las gráficas manipuladas: ejes que no empiezan en cero, mezcla de categorías incomparables en el mismo cuadro, selección de los benchmarks donde el modelo propio gana y omisión de los que no. Tomalo con pinzas cada vez que una empresa publica su propia tabla comparativa.

Un caso documentado: algunos modelos tienen scores notablemente más altos en la versión original de un benchmark que en versiones ligeramente modificadas por terceros para testear generalización. La diferencia puede ser de 20 puntos o más (no es poca).

Alternativas concretas para evaluar modelos sin depender de benchmarks genéricos

Si los benchmarks estándar no sirven, ¿qué hacés?

Armá tu propio benchmark con tareas reales

Cincuenta tareas representativas de tu caso de uso real son más valiosas que cualquier leaderboard público. Si tu equipo usa el modelo para resumir tickets de soporte, armá 50 tickets reales (anonimizados), generá respuestas con cada modelo candidato, y evaluá con criterios específicos: ¿resolvió el problema? ¿el tono es correcto? ¿incluyó pasos accionables? Ese benchmark vale más que MMLU para tu decisión.

Pruebas A/B en producción con tráfico real

Si tenés volumen suficiente, probá dos modelos en paralelo con el mismo prompt y medí métricas downstream reales: tasa de resolución en primer contacto, tiempo de sesión, feedback de usuarios. Es el gold standard. El problema es que requiere infraestructura y tráfico, así que no siempre es viable al principio.

Validación humana sobre muestras

Las métricas automáticas como BLEU y ROUGE tienen correlación baja con juicio humano en tareas de generación de texto. Según MIT Technology Review, varios estudios de 2026 confirman que BLEU puede variar mientras la calidad percibida se mantiene constante. La evaluación humana sobre muestras aleatorias, aunque costosa, sigue siendo el método más confiable para tareas donde la calidad del texto importa.

Medí lo que importa para tu stack

Latencia en percentil 95 (no promedio), costo por token según tu mix real de prompts, tasa de errores de formato cuando el modelo tiene que responder en JSON o XML, y tasa de alucinaciones en tu dominio específico. Ninguno de estos aparece en los benchmarks públicos. Todos son fáciles de medir si tenés un framework de evaluación propio. Más contexto en las habilidades verdaderas de Claude.

Nuevas plataformas y benchmarks más duros

Vercel AI Gateway Leaderboard toma un enfoque distinto: en vez de evaluar modelos con preguntas de opción múltiple, mide rendimiento basado en tráfico real de producción que pasa por su gateway. Las métricas incluyen latencia, disponibilidad y consistencia en condiciones reales. No es perfecto (el mix de casos de uso de los usuarios de Vercel no es representativo de todos los casos posibles), pero está más cerca de la realidad que MMLU.

En el frente de benchmarks más difíciles, en 2026 hay dos que están ganando atención: Humanity’s Last Exam (HLE), diseñado por el Center for AI Safety con preguntas que los mejores modelos actuales responden correctamente en menos del 10% de los casos, y FrontierMath, un conjunto de problemas matemáticos de investigación que la mayoría de los modelos no pasa del 2%. Son más difíciles de gamear porque son menos conocidos, más variados, y requieren razonamiento real, no recuperación de patrones memorizados.

Artificial Analysis también ofrece comparativas que combinan múltiples benchmarks con contexto de costos y latencia, lo que da una vista más completa para tomar decisiones.

Tabla comparativa: benchmarks clásicos vs. enfoques alternativos

| Criterio | Benchmarks clásicos (MMLU, GSM8K) | Evaluación propia / producción |

|---|---|---|

| Costo de implementación | Cero (resultado ya publicado) | Medio-alto (requiere setup) |

| Relevancia para tu caso | Baja a media | Alta (diseñado para vos) |

| Riesgo de gaming | Alto (empresas optimizan para estos) | Bajo (benchmark privado) |

| Mide latencia real | No | Sí |

| Mide costo real | No | Sí |

| Actualización | Lenta (quedan obsoletos) | Controlada por vos |

| Validez estadística | Alta (miles de ejemplos) | Depende de tu muestra |

| Aplicable para decisión de compra rápida | Sí (referencia inicial) | No (requiere tiempo) |

Cómo leer un benchmark sin que te tomen el pelo

Si tenés que usar benchmarks públicos (y la mayoría de las veces lo vas a hacer como primer filtro), hay un checklist mínimo:

- ¿Quién creó el benchmark? Si lo creó o financió la misma empresa que lo pasa, tomalo con pinzas.

- ¿Qué tarea real mide exactamente? Un score de 95% en “comprensión de texto” puede incluir desde preguntas triviales hasta razonamiento causal. La etiqueta no dice nada.

- ¿El dataset fue auditado por terceros? Si no hay paper de auditoría independiente, los errores en datos son probables.

- ¿Cuándo fue creado? Si tiene más de 18 meses, probablemente está saturado y ya no diferencia entre modelos modernos.

- ¿Hay validación humana de los resultados? Las métricas automáticas solas no alcanzan.

- ¿Los modelos que compiten tuvieron acceso a datos similares durante el entrenamiento? Si el paper no lo descarta, no podés asumir que no.

Cristián Tala publicó en 2026 una evaluación que probó 25 modelos con 125 tests diseñados para tareas reales, en español, con casos de uso concretos de negocio. El ranking resultante difiere bastante del orden que ven en los leaderboards estándar. El ejercicio ilustra exactamente el punto: cambiar el dataset cambia el ganador.

Errores comunes al evaluar modelos de IA

Error 1: Tomar el mejor benchmark disponible como proxy de calidad general. Un modelo que gana en MATH no necesariamente razona mejor en otros contextos. Los benchmarks miden una cosa específica. El error es generalizar.

Error 2: Comparar modelos con versiones distintas o contextos distintos. Si el modelo A fue evaluado con temperatura 0 y el modelo B con temperatura 0.7, los resultados no son comparables. Si uno usó chain-of-thought y el otro no, tampoco. Las tablas comparativas mezclan estos detalles sin documentarlos.

Error 3: Ignorar la degradación con contexto largo. Un modelo que puntúa bien en tareas de 500 tokens puede degradar significativamente con 50K tokens. Si tu caso de uso implica documentos largos o historiales extendidos, testealo específicamente con esas longitudes antes de elegir. Sobre eso hablamos en evaluaciones de la familia GPT.

Error 4: No medir costo total. Un modelo con score 5% mejor pero 3 veces más caro puede no ser la elección correcta. Los benchmarks no incluyen precio por token. La evaluación de “mejor modelo” siempre debería incluir la ecuación score/costo.

Error 5: Evaluar una vez y no volver a hacerlo. Los modelos se actualizan, a veces sin documentación clara de qué cambió. Un modelo que elegiste en enero puede comportarse diferente en julio. Si tu caso de uso es crítico, evaluá periódicamente.

Preguntas Frecuentes

¿Por qué los benchmarks de IA no son precisos?

Los benchmarks miden tareas específicas en condiciones controladas que no replican los usos reales. Tienen errores en sus propios datos (hasta 42% en MMLU Math), sufren contaminación porque los modelos pueden haber visto esos datos en el entrenamiento, y se saturan rápido (cuando todos los modelos superan el 95%, el benchmark deja de diferenciar). El resultado es que el ranking en benchmark y el rendimiento en producción tienen un gap promedio del 37%.

¿Puedo confiar en los rankings de modelos de IA para elegir uno?

Como primer filtro para descartar opciones muy inferiores, sí. Para tomar una decisión definitiva de producción, no. Los rankings son útiles para entender el orden de magnitud, pero no reemplazan evaluar el modelo con tus propios casos de uso, en tu idioma, con tus tipos de prompts y tu longitud de contexto real.

¿Qué diferencia hay entre benchmark y rendimiento real?

Un benchmark evalúa el modelo en un conjunto fijo de preguntas diseñadas para medir una capacidad teórica. El rendimiento real depende de latencia, consistencia, costo por token, manejo de contexto largo y la distribución específica de tareas de tu caso de uso. Estudios de 2026 documentan gaps de hasta 37 puntos porcentuales entre ambas medidas.

¿Cómo evaluar modelos de IA sin depender de benchmarks públicos?

Armá un dataset de 50-100 tareas reales de tu negocio, evaluá las respuestas con criterios concretos y documentados, medí latencia y costo en tu stack, y si tenés tráfico suficiente hacé pruebas A/B en producción. Para contexto de mercado inicial, plataformas como Vercel AI Gateway Leaderboard o Artificial Analysis ofrecen comparativas más completas que un solo benchmark.

¿Son los benchmarks MMLU y GSM8K realmente confiables?

MMLU tiene una tasa de error documentada en sus datos del 42% en la categoría de matemáticas. GSM8K está saturado: los modelos top superan el 95% y ya no sirve para diferenciar. Ambos tienen problemas de contaminación de datos. Siguen siendo útiles como referencia histórica y para comparar órdenes de magnitud, pero no para decisiones finas de selección de modelo.

Conclusión

Los benchmarks de modelos IA no son inútiles. Son el punto de partida lógico cuando necesitás ordenar opciones rápidamente y no tenés tiempo para evaluar cada modelo desde cero. El problema es tomarlos como respuesta definitiva cuando son apenas el primer paso.

Lo que cambió en 2026 es que hay más evidencia pública del gap entre lab y producción, más benchmarks difíciles que son más difíciles de gamear (Humanity’s Last Exam, FrontierMath), y más plataformas que miden con tráfico real en vez de datasets estáticos. Eso es progreso. Pero la solución estructural es la misma que siempre fue: diseñá evaluaciones propias con tus datos, medí lo que importa para vos, y usá los benchmarks públicos como filtro inicial, no como veredicto.

Si estás construyendo un producto sobre LLMs y el hosting o la infraestructura es parte de la ecuación, también tiene sentido elegir un proveedor que entienda el contexto latinoamericano. Donweb opera en la región y es una opción a considerar para alojar aplicaciones que consumen APIs de modelos.

Fuentes

- MIT Technology Review – AI benchmarks are broken: here’s what we need instead

- Stanford HAI – AI Index 2026: Technical Performance

- Vercel AI Gateway Leaderboard

- Cristián Tala – Benchmark de modelos de IA 2026: probé 25 modelos con 125 tests reales

- Kili Technology – AI Benchmarks Guide 2026 and why they’re not enough