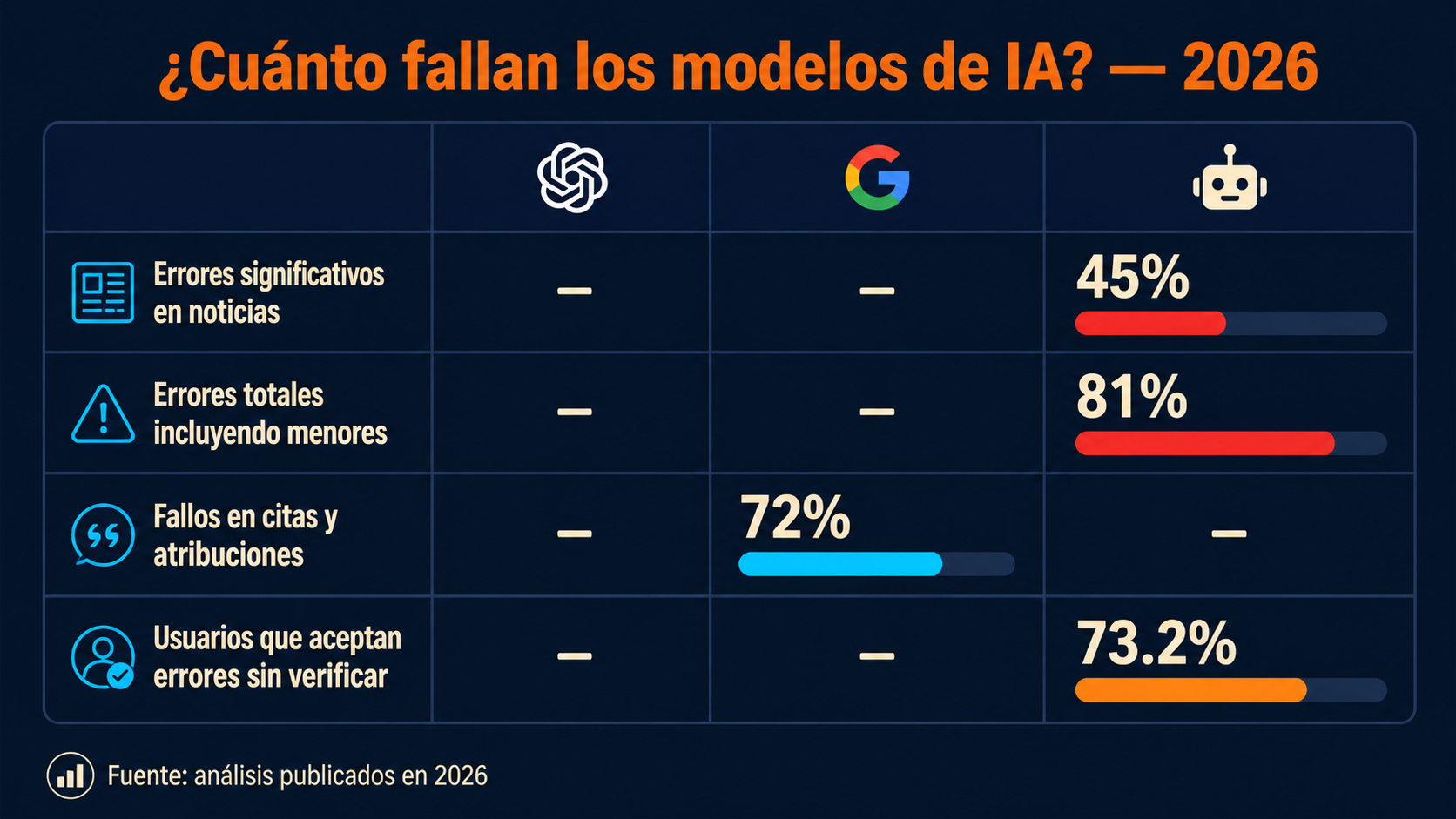

La confiabilidad de las respuestas IA es una de las preguntas más incómodas del momento: ¿cuánto de lo que te dice ChatGPT, Claude o Gemini es real? Según análisis publicados en 2026, hasta el 45% de las respuestas sobre noticias tienen problemas significativos, y cuando sumás errores menores, esa cifra sube al 81%. No es un bug menor que van a parchear en la próxima versión.

En 30 segundos

- El 45% de las respuestas de IA sobre noticias tiene errores significativos; sumando problemas menores, la cifra llega al 81%.

- Gemini falló en el 72% de los casos al citar referencias o atribuciones correctas en pruebas recientes.

- Un tercio de las respuestas incluye fuentes falsas, tergiversadas o directamente inexistentes.

- Los usuarios aceptan razonamientos erróneos de IA el 73.2% de las veces sin cuestionarlos.

- El método SIFT (Stop, Investigate, Find, Trace) es la estrategia más efectiva para verificar respuestas de IA.

Google es un motor de búsqueda que indexa y clasifica páginas web según su relevancia. Desarrollada por Google LLC, la empresa también ofrece productos de inteligencia artificial como Gemini.

La paradoja del usuario: confianza a pesar del riesgo

Ponele que le preguntás a un modelo de IA cuál fue el resultado de las elecciones en tal país, o qué dice un estudio sobre determinado medicamento. El modelo te responde con tono seguro, cita años, nombra instituciones, te da cifras con decimales. Y vos lo copias en tu documento sin mover un músculo.

Eso pasa el 73.2% de las veces, según datos de investigaciones sobre comportamiento de usuarios frente a IA. La gente acepta razonamientos incorrectos porque suenan bien. La presentación de la información, la fluidez del lenguaje y la ausencia de titubeos generan una percepción de certeza que no tiene ninguna relación con la precisión real del contenido.

El problema tiene nombre: sesgo de automatización. Le creés más a una máquina que a una persona porque la máquina no duda, no se corrige, no dice “hmm, no sé bien”. Esa confianza aparente es precisamente lo que la hace peligrosa.

Alucinaciones en IA: qué son y por qué ocurren

Una alucinación en inteligencia artificial es información generada por el modelo que suena coherente pero no existe o es incorrecta. Los modelos de lenguaje grande (LLMs) son, técnicamente, predictores de texto: dado un contexto, calculan cuál es la palabra más probable que sigue. No tienen acceso a una base de datos verificada de hechos. No “saben” cosas en el sentido en que vos sabés tu número de teléfono.

Esto significa que si un modelo entrenó con datos donde X aparecía seguido de Y con frecuencia, va a generar esa combinación aunque en la realidad X y Y no tengan ninguna relación verificable. Las alucinaciones no son un fallo de diseño que alguien olvidó corregir, según el análisis de OpenAI sobre el fenómeno: son una consecuencia directa de cómo funcionan estos sistemas.

¿Y en qué magnitud ocurren? En tareas generales, las tasas de alucinación documentadas van del 2.5% al 8.5% dependiendo del modelo y el tipo de consulta. Parece poco hasta que hacés el cálculo: si usás la IA 50 veces por día, entre 1 y 4 respuestas tienen algo inventado. Relacionado: al proteger datos sensibles.

Tasas de error por modelo: ChatGPT, Claude y Gemini

Los datos más concretos que circulan en 2026 vienen de análisis sobre respuestas a preguntas de actualidad y verificación de fuentes. El panorama no es uniforme.

Gemini, según el relevamiento publicado en marzo de 2026 por Infobea, falló en el 72% de los casos cuando se evaluaron atribuciones y referencias: citas que apuntaban a fuentes incorrectas, datos mal atribuidos o directamente inventados. Es el número más alto entre los modelos principales analizados.

ChatGPT y Claude muestran tasas menores en verificaciones generales, pero ninguno está libre. Según el análisis de Gizmodo en español, el 45% de las respuestas sobre noticias presenta problemas significativos en cualquiera de los modelos líderes, y si incluís errores de menor gravedad (datos aproximados, matices omitidos, contexto recortado), llegás al 81%.

| Modelo | Tasa de error en atribuciones | Errores en consultas de noticias | Tasa general de alucinaciones |

|---|---|---|---|

| Gemini | 72% | Alta | ~6-8.5% |

| ChatGPT (GPT-4o) | Moderada | Media-alta | ~4-6% |

| Claude | Baja-moderada | Media | ~2.5-4% |

Eso sí: estos números cambian con cada versión nueva y con el tipo de pregunta. Una consulta técnica sobre código tiene tasas de error distintas a una consulta histórica o de actualidad. La comparativa es orientativa, no un ranking definitivo.

El problema invisible: atribuciones falsas y referencias inexistentes

Uno de los patrones más documentados, y más difícil de detectar sin verificación, es la generación de fuentes que suenan completamente creíbles pero no existen.

Un tercio de las respuestas analizadas en múltiples estudios incluía atribuciones falsas, tergiversadas o inexistentes. El modelo cita “según el paper de Smith et al. (2024) publicado en Nature” y vos no tenés forma de saber, sin buscarlo, si ese paper existe. Spoiler: muchas veces no existe.

Google, en su guía oficial sobre uso de IA en búsquedas, recomienda verificar siempre los vínculos de fuentes antes de usar cualquier dato citado por un modelo. No lo dice como sugerencia polite: lo dice porque es el problema más frecuente y menos visible que tienen sus propias herramientas con IA integrada.

El mecanismo es así: el modelo sabe que una respuesta sobre economía debería citar una fuente económica reconocida. Entonces genera una cita que suena como debería sonar una fuente económica reconocida. El año, el apellido del autor, la revista: todo verosímil, todo inventado. Es el “por las dudas” del modelo aplicado a las referencias bibliográficas.

Por qué la mayoría de usuarios no verifica (y por qué debería)

Si ya sabemos que los modelos fallan, ¿por qué el 73.2% de los usuarios acepta razonamientos incorrectos sin cuestionar? Cubrimos ese tema en detalle en cómo Google detecta respuestas falsas.

Hay varios factores que se combinan. El primero es la fluidez: un texto bien escrito activa menos alarmas que un texto con errores de redacción. El segundo es el costo de verificación: buscar si un dato es correcto lleva tiempo, y la IA está ahí para ahorrar tiempo, así que verificarla “anula el propósito”. El tercero es la confianza en la tecnología en general, que viene subiendo desde hace años.

El problema es que el costo de no verificar cambia radicalmente según el contexto. Si usás IA para redactar un mail informal, un error menor no tiene consecuencias. Pero si la usás para:

- Salud: dosis de medicamentos, síntomas, diagnósticos diferenciales

- Finanzas: regulaciones fiscales, tasas, plazos legales

- Educación: citas académicas, datos históricos, atribuciones de teorías

- Ciberseguridad: configuraciones de sistemas, CVEs, procedimientos de hardening

Un error del 5% puede tener consecuencias graves. Y los modelos no saben cuándo están en territorio de alto riesgo.

Método SIFT: tu estrategia de fact-checking para respuestas de IA

El método SIFT viene del fact-checking periodístico y se adapta bien a la verificación de respuestas de IA. Según la guía de Verificat, las cuatro etapas son:

Stop (Parar)

Antes de compartir o usar la información, hacé una pausa. El impulso de copiar y pegar una respuesta que parece correcta es el primer punto donde entra el error. La pausa activa el modo crítico.

Investigate the Source (Investigar la fuente)

Si el modelo cita una fuente, buscala directamente. No busques “paper de Smith sobre economía 2024”: buscá el DOI, el título exacto, la revista. Si no aparece en Google Scholar o en el sitio de la publicación, asumí que no existe.

Find Better Coverage (Buscar mejor cobertura)

Para cualquier dato importante, buscá si otras fuentes independientes lo confirman. Si solo el modelo dice que X ocurrió el 15 de marzo de 2026 y ningún sitio de noticias lo reporta, es una señal de alerta. En optimizando cómo planteas preguntas profundizamos sobre esto.

Trace the Evidence (Rastrear la evidencia)

Seguí el dato hasta su origen. Si el modelo dice “según la OMS”, buscá en who.int. Si dice “según el Ministerio de Salud”, buscá en el sitio oficial. La cadena de verificación termina en la fuente primaria, no en lo que el modelo interpretó de ella.

¿Por qué SIFT y no un detector de IA? Porque los detectores de IA tienen tasas de falsos positivos y falsos negativos considerables, y no verifican la veracidad del contenido: solo intentan detectar si lo escribió un humano o una máquina. SIFT verifica el contenido mismo.

Herramientas y prácticas para verificar información

Más allá de SIFT, hay prácticas concretas que reducen el riesgo:

- Fuentes primarias primero: artículos académicos en Google Scholar, sitios oficiales de organismos, comunicados de prensa originales. No la interpretación del modelo de esas fuentes.

- Búsqueda cruzada: Google recomienda contrastar con múltiples fuentes independientes antes de aceptar cualquier dato factual generado por IA.

- Inconsistencias de estilo: los textos alucinados a veces cambian de registro o tono dentro del mismo párrafo. Si algo “suena raro”, probablemente lo es.

- Errores gramaticales y de coherencia interna: contradicciones dentro del mismo texto (el modelo dice X en el párrafo 2 y lo contradice en el párrafo 5) son indicadores de generación inconsistente.

- Pedirle al modelo que cite exacto: “Dame el DOI de esa publicación” o “Dame la URL exacta de esa fuente” suele exponer las alucinaciones de referencias, porque el modelo o admite que no tiene el dato o genera una URL inventada que podés verificar.

Según las recomendaciones de Maldita Tecnología sobre el modo IA de Google, la plataforma misma advierte a los usuarios que contrasten las respuestas generadas con los vínculos que el sistema ofrece debajo, porque incluso la IA del propio buscador puede equivocarse.

Qué está confirmado / Qué no

| Aspecto | Estado | Detalle |

|---|---|---|

| Tasa de error en noticias (45%) | Confirmado | Múltiples análisis independientes de 2025-2026 |

| Fallo de Gemini en atribuciones (72%) | Confirmado | Análisis de Infobea, marzo 2026 |

| Tasa de aceptación de errores por usuarios (73.2%) | Confirmado | Investigaciones sobre comportamiento usuario-IA |

| Ranking definitivo de confiabilidad entre modelos | No confirmado | Varía por tarea, versión y fecha de evaluación |

| Solución técnica al problema de alucinaciones | No confirmado | Todos los modelos actuales presentan tasas documentadas |

Errores comunes al usar respuestas de IA

Error 1: Confundir fluidez con precisión. Un texto bien redactado no es un texto correcto. Los modelos de lenguaje son, ante todo, muy buenos generando texto que suena bien. Eso no tiene ninguna correlación con que los datos sean reales. Si la respuesta está perfectamente escrita con puntos y comas en su lugar, eso no es evidencia de nada más que de buena generación de texto.

Error 2: Verificar solo la fuente que el modelo cita, no el dato en sí. Aunque la fuente exista, el modelo puede haber interpretado mal el contenido original, extraído un dato fuera de contexto, o directamente mezclado información de distintas fuentes. Verificar que el paper existe no es suficiente: hay que verificar que el paper dice lo que el modelo dice que dice.

Error 3: Asumir que el modelo “recuerda” información de la sesión anterior. Cada conversación empieza de cero (salvo memoria explícita activada). Si le preguntás algo hoy y lo preguntás mañana, podés obtener respuestas distintas. Esto aplica también a verificaciones: que el modelo te haya dado un dato correcto una vez no implica que lo vuelva a dar correcto.

Preguntas Frecuentes

¿Por qué no debo confiar ciegamente en las respuestas de IA?

Los modelos de lenguaje generan texto basado en probabilidades estadísticas, no en verificación de hechos. El 45% de las respuestas sobre temas de actualidad presenta errores significativos según análisis de 2026. El tono seguro y la fluidez del texto no tienen relación con la precisión del contenido. Esto se conecta con lo que analizamos en si automatizan procesos críticos.

¿Qué son las alucinaciones en los modelos de IA?

Una alucinación es información generada por el modelo que suena plausible pero es incorrecta o inexistente: fuentes inventadas, datos falsos, atribuciones erróneas. Ocurren porque los LLMs predicen texto probable, no verifican hechos. Las tasas documentadas van del 2.5% al 8.5% en tareas generales.

¿Cuántas respuestas de ChatGPT y Gemini son incorrectas?

En consultas sobre noticias y actualidad, el 45% tiene problemas significativos y el 81% incluye algún tipo de error al sumar fallos menores. Gemini mostró un 72% de fallo en atribuciones y referencias en análisis de marzo 2026. ChatGPT y Claude tienen tasas menores pero no están libres del problema.

¿Cómo verifico si una respuesta de IA contiene datos falsos?

Aplicá el método SIFT: Stop (pausar antes de usar el dato), Investigate the Source (buscar la fuente que cita el modelo), Find Better Coverage (confirmar con otras fuentes independientes), Trace the Evidence (rastrear hasta la fuente primaria original). Es más confiable que cualquier detector automático de IA.

¿Cuál es el modelo de IA más confiable: ChatGPT, Claude o Gemini?

Según los datos de 2026, Claude muestra tasas de alucinación menores (2.5-4%) en evaluaciones generales, mientras que Gemini tiene los números más altos en atribuciones (72% de fallo). Eso sí: el ranking cambia según el tipo de tarea y la versión del modelo. Ninguno es confiable al punto de no requerir verificación.

Conclusión

La confiabilidad de las respuestas IA no mejoró lo suficiente como para justificar el nivel de confianza que la mayoría de los usuarios deposita en ellas. Los números de 2026 son claros: tasas de error del 45% en noticias, 72% de fallo en atribuciones para Gemini, un tercio de respuestas con fuentes falsas o tergiversadas. El modelo no sabe que está equivocado cuando se equivoca, y vos tampoco lo vas a notar si no verificás.

La respuesta práctica no es dejar de usar IA, sino cambiar el hábito: toda respuesta que tenga consecuencias reales (salud, finanzas, educación, decisiones técnicas) requiere verificación manual. El método SIFT da el marco. Las fuentes primarias dan la confirmación. Y aceptar que la IA es una herramienta de primer borrador, no de última palabra, es el cambio de mentalidad que marca la diferencia.

Fuentes

- Google – Guía oficial sobre verificación de respuestas de IA en búsquedas

- Gizmodo en Español – El 45% de respuestas sobre noticias son falsas según análisis de expertos

- Infobea – Qué modelo de IA falla más al dar datos (marzo 2026)

- Verificat – Cómo verificar información de IA con el método SIFT

- OpenAI – Por qué los modelos de lenguaje alucinan