DeepSeek confirmó que está a punto de lanzar V4, un modelo multimodal de 1 billón de parámetros. Si el número te parece exagerado, hay un detalle clave: solo activa 32 mil millones de parámetros por token. Es una arquitectura Mixture of Experts (MoE) llevada al extremo, y viene a competir de frente con GPT-5.4 de OpenAI y Claude Opus de Anthropic.

Lo que hace que esta noticia sea especialmente relevante no es solo el tamaño del modelo. DeepSeek desarrolló V4 usando chips Huawei Ascend y Cambricon, reduciendo su dependencia de semiconductores estadounidenses. En un contexto donde las restricciones de exportación de chips a China se endurecen cada trimestre, esto marca una dirección técnica y geopolítica que conviene seguir de cerca.

Qué es DeepSeek V4 y qué trae de nuevo

DeepSeek V4 es la cuarta generación del modelo de lenguaje de la empresa china DeepSeek, fundada en 2023 por Liang Wenfeng, también fundador del fondo de cobertura High-Flyer. La compañía ya había llamado la atención con DeepSeek V3 a fines de 2024, cuando demostró que se podían entrenar modelos competitivos a una fracción del costo de sus rivales occidentales.

V4 sube la escala de forma considerable. Estos son los datos que se conocen hasta ahora:

- 1 billón de parámetros totales (1 trillion en nomenclatura inglesa)

- 32 mil millones de parámetros activos por token gracias a la arquitectura MoE

- Capacidad multimodal: procesa texto, imagen y posiblemente audio

- Optimizado específicamente para generación de código y contextos largos

- Entrenado con hardware chino: chips Huawei Ascend 910B y procesadores Cambricon

Para ponerlo en perspectiva: DeepSeek V3 tenía 671 mil millones de parámetros totales con 37 mil millones activos. V4 casi duplica los parámetros totales, pero reduce los activos por token. Eso significa que el modelo es más grande en conocimiento almacenado, pero más eficiente en cada inferencia.

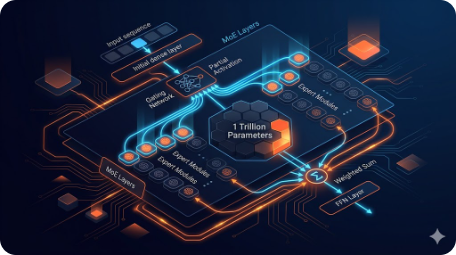

Cómo funciona: MoE a escala masiva

Si no estás familiarizado con Mixture of Experts, la idea es simple: en vez de activar toda la red neuronal para cada consulta, el modelo tiene “expertos” especializados y un router que decide cuáles activar según el input. Pensalo como un equipo de trabajo donde no todos participan en cada proyecto, solo los que tienen expertise relevante.

Con 1 billón de parámetros totales y solo 32 mil millones activos, V4 tiene un ratio de activación de aproximadamente 3.2%. Esto tiene implicancias directas en costos de inferencia. Menos parámetros activos significa menos cómputo por token, lo que se traduce en respuestas más baratas de servir.

La optimización para contextos largos es otro punto a destacar. DeepSeek V3 ya soportaba ventanas de contexto de 128K tokens. Si V4 expande esto, podría manejar documentos completos, repositorios de código enteros o conversaciones extensas sin perder coherencia. Todavía no hay confirmación oficial del tamaño de contexto, pero las filtraciones apuntan a que será significativamente mayor.

En cuanto al código, DeepSeek ya tenía una reputación sólida. DeepSeek Coder V2 y V3 se posicionaron consistentemente en los primeros puestos de benchmarks como HumanEval y MBPP. Si V4 mantiene esa línea y la mejora con la escala adicional, podría convertirse en una de las mejores opciones para asistencia en programación.

Por qué importa: independencia tecnológica y costos

Hay dos razones principales por las que V4 merece atención, y ninguna es el tamaño del modelo en sí.

La primera es la independencia del hardware estadounidense. Desde que Estados Unidos restringió la exportación de chips NVIDIA de alto rendimiento (A100, H100, H200) a China, la pregunta era cuánto tardarían las empresas chinas en encontrar alternativas viables. DeepSeek ya había entrenado V3 con NVIDIA H800 (una versión limitada del H100 permitida para exportación), pero con V4 el salto es claro: Huawei Ascend y Cambricon son chips diseñados y fabricados en China.

Si DeepSeek logra un modelo competitivo con GPT-5.4 usando hardware propio, la narrativa de que las restricciones de chips frenarían la IA china queda seriamente debilitada. Esto tiene implicancias para toda la industria, no solo para DeepSeek.

La segunda razón es el costo. DeepSeek V3 se entrenó por aproximadamente 5.5 millones de dólares según las estimaciones de la propia empresa. Si V4 mantiene una relación costo-rendimiento similar, estaríamos ante un modelo de primer nivel entrenado por una fracción de lo que gastan OpenAI o Google. OpenAI reportó haber invertido más de 100 millones de dólares en el entrenamiento de GPT-4, y los números para GPT-5.4 serían considerablemente mayores.

Para vos como usuario o developer, esto se traduce en una cosa concreta: más competencia en el mercado, lo que presiona los precios a la baja y mejora la calidad de los servicios disponibles. Si te interesa, podes leer mas sobre modelos de lenguaje abierto como Gemma 3.

A quién afecta: developers, empresas y usuarios

El impacto de V4 varía según tu perfil. Veamos los escenarios más relevantes.

Developers y equipos técnicos

Si trabajás con modelos de lenguaje para generación de código, V4 podría ser una alternativa seria a GPT-5.4 y Claude Opus. DeepSeek tiene tradición de liberar sus modelos como open source (V3 se publicó con licencia MIT), así que existe la posibilidad de que V4 también esté disponible para descarga y uso local. Esto te permitiría correr el modelo en tu propia infraestructura sin depender de una API externa.

Además, si se confirma la ventana de contexto extendida, podrías alimentar el modelo con repositorios completos para que entienda tu codebase de manera integral. Eso cambia la dinámica de trabajo con asistentes de código.

Empresas y startups

Para empresas que consumen APIs de modelos de lenguaje, un competidor más significa mejor negociación de precios. DeepSeek V3 ya ofrecía precios de API sensiblemente más bajos que OpenAI y Anthropic. Si V4 mantiene esa política, podría ser una opción atractiva para aplicaciones que requieren alto volumen de inferencia.

Eso sí, hay un factor a considerar: los datos pasan por servidores en China. Para algunas empresas, especialmente en sectores regulados como fintech o salud, esto puede ser un impedimento por cuestiones de compliance. Si usás la versión open source en tu propia infraestructura, ese problema desaparece.

Usuarios finales

Si usás ChatGPT, Claude o Gemini para tareas cotidianas, V4 no va a cambiar tu rutina de un día para el otro. Pero sí contribuye a un mercado más competitivo, lo que históricamente lleva a mejores productos gratuitos y precios más accesibles en los planes pagos.

DeepSeek V4 vs la competencia: dónde se ubica

Para entender dónde se posiciona V4, conviene ver el panorama actual de modelos de primer nivel:

- GPT-5.4 (OpenAI): el modelo más reciente de OpenAI. Multimodal, con capacidades de razonamiento avanzado. Entrenado con NVIDIA H100/B200. Acceso solo por API y ChatGPT Plus/Pro.

- Claude Opus 4.6 (Anthropic): el modelo más capaz de Anthropic. Fuerte en razonamiento, código y seguimiento de instrucciones complejas. Acceso por API y suscripción.

- Gemini 2.5 Pro (Google): multimodal nativo con ventana de contexto de hasta 1 millón de tokens. Integrado en el ecosistema Google.

- DeepSeek V4 (DeepSeek): 1 billón de parámetros, 32B activos. Optimizado para código y contextos largos. Potencialmente open source. Entrenado con hardware chino.

La ventaja competitiva de DeepSeek siempre fue la relación costo-rendimiento. V3 ya había demostrado que podía competir en benchmarks con modelos que costaron 10 o 20 veces más de entrenar. Si V4 mantiene esa tendencia y además es open source, la propuesta de valor es clara: rendimiento de primer nivel a costos accesibles, con la opción de correrlo en tu propia infraestructura.

Donde DeepSeek suele quedar atrás es en el ecosistema. OpenAI tiene plugins, integraciones con Microsoft, y una base de usuarios masiva. Anthropic tiene integraciones empresariales sólidas. Google tiene… bueno, Google. DeepSeek tiene un chat web, una API, y una comunidad open source activa. Es menos, pero para muchos casos de uso es suficiente.

También hay que ser honesto con las limitaciones. Los modelos chinos históricamente tienen censura en temas políticos sensibles para el gobierno chino. Esto no afecta la mayoría de los usos técnicos, pero es algo que tenés que saber si tu caso de uso involucra contenido geopolítico o social.

Preguntas Frecuentes

¿Cuándo sale DeepSeek V4?

No hay fecha oficial confirmada, pero las filtraciones y declaraciones de la empresa indican que el lanzamiento es inminente. DeepSeek suele liberar sus modelos con poca anticipación. Lo más probable es que veamos el modelo disponible durante el primer semestre de 2026.

¿DeepSeek V4 va a ser open source?

Todavía no está confirmado, pero hay razones para ser optimista. DeepSeek V2 y V3 se liberaron con licencias abiertas (MIT en el caso de V3). La empresa ha construido su reputación precisamente sobre la apertura de sus modelos. Si se mantiene la tendencia, V4 debería estar disponible para descarga.

¿Puedo usar DeepSeek V4 gratis?

DeepSeek ofrece un chat web gratuito (chat.deepseek.com) con acceso a sus modelos. La API tiene un tier gratuito limitado y planes pagos por consumo. Si el modelo es open source y tenés el hardware necesario (se estiman al menos 64 GB de VRAM para versiones cuantizadas), podrías correrlo localmente sin costo.

¿DeepSeek V4 es mejor que ChatGPT?

“Mejor” depende del uso. DeepSeek V3 ya igualaba o superaba a GPT-4o en benchmarks de código y matemáticas. Si V4 escala esos resultados, podría competir con GPT-5.4 en tareas técnicas. Para uso conversacional general, la experiencia de usuario de ChatGPT sigue siendo difícil de superar por su ecosistema de integraciones.

Conclusión

DeepSeek V4 representa algo concreto: la demostración de que se puede entrenar un modelo de primer nivel con hardware no estadounidense y a costos muy por debajo de la competencia occidental. Eso, más allá de los benchmarks que publiquen después del lanzamiento, es lo que cambia las reglas del juego para la industria.

Si sos developer o trabajás con IA en tu empresa, lo que conviene hacer ahora es seguir de cerca el lanzamiento oficial. Cuando salga, probalo en tus casos de uso específicos antes de tomar decisiones. Los benchmarks genéricos sirven como referencia, pero lo que importa es cómo rinde el modelo en tu dominio. Si termina siendo open source, evaluá si tiene sentido incorporarlo a tu stack, ya sea por costo, por privacidad de datos, o simplemente porque te da control total sobre la inferencia. Mientras tanto, la competencia entre DeepSeek, OpenAI, Anthropic y Google sigue siendo la mejor noticia para cualquiera que use o desarrolle con modelos de lenguaje.

¿Qué benchmarks se esperan de DeepSeek V4?

Todavía no hay benchmarks oficiales de V4. Sin embargo, DeepSeek V3 ya igualaba o superaba a GPT-4o en HumanEval, MBPP y benchmarks matemáticos. Si V4 escala esos resultados con su arquitectura de 1 billón de parámetros, se espera que compita directamente con GPT-5.4 y Claude Opus 4.6 en tareas de código y razonamiento.

¿Qué hardware necesito para correr DeepSeek V4 en local?

Si V4 se libera como open source, vas a necesitar un setup considerable. Para versiones cuantizadas se estiman al menos 64 GB de VRAM (por ejemplo, dos NVIDIA RTX 4090 o una A100 de 80 GB). La versión completa sin cuantizar requeriría un cluster de GPUs empresariales, pero la comunidad suele publicar versiones optimizadas a los pocos días del lanzamiento.