Introducción

Imaginá que tu foto de LinkedIn podría definir tu futuro profesional. Que un algoritmo analizando tus características faciales pudiera predecir tu salario, tu posición en el trabajo, o tus probabilidades de avanzar en la carrera. Esto ya no es ciencia ficción. Investigadores de prestigiosas universidades han desarrollado una tecnología llamada “Photo Big 5” que utiliza inteligencia artificial para extraer rasgos de personalidad de un simple fotografía y predecir resultados laborales con una precisión sorprendente. Pero detrás de esta innovación se esconden serias preocupaciones éticas, legales y sociales que cualquier profesional debe conocer.

¿Qué es Photo Big 5 y Cómo Funciona?

Photo Big 5 es un sistema de inteligencia artificial entrenado para detectar los cinco grandes rasgos de personalidad —conocidos como Big Five o OCEAN en psicología— directamente desde una fotografía del rostro de una persona. Estos rasgos son: apertura, consciencia, extroversión, amabilidad y neuroticismo. El sistema analiza características faciales, expresiones y patrones en la imagen para asignar puntuaciones a cada rasgo.

Lo revolucionario de esta tecnología es su capacidad predictiva. Los investigadores entrenarón el modelo utilizando miles de fotos de LinkedIn vinculadas con datos reales de carreras profesionales, salarios, rangos laborales y progresión de empleos. El resultado es un algoritmo que puede estimar con relativa precisión qué tan exitoso será un profesional basándose únicamente en su fotografía.

Resultados Impactantes: Lo que Reveló la Investigación

Los hallazgos de este estudio han generado un debate intenso en el mundo empresarial. Según la investigación, Photo Big 5 tiene un poder predictivo comparable e incluso superior a indicadores tradicionales como el GPA, las pruebas de aptitud estandarizadas, o calificaciones académicas. Esto significa que tu foto podría ser más importante que tus calificaciones en la universidad para predecir tu futuro laboral.

Uno de los datos más llamativos es el impacto salarial. Para los hombres, pasar del quintil más bajo al más alto en rasgos de personalidad medidos por la foto está asociado con un aumento salarial predeterminado del 8,4% en su primer trabajo después del MBA. Para ponerlo en perspectiva, esa diferencia es más grande que las brechas salariales documentadas entre hombres blancos y hombres negros (3,5%) o entre hombres blancos y hombres asiáticos (1,9%) en el mismo contexto laboral.

La investigación también demostró que Photo Big 5 predice factores como el rango de la escuela a la que asistió el profesional, la compensación inicial, la antigüedad laboral, las elecciones de industria, las transiciones de carrera y hasta la probabilidad de avance profesional. Lo más preocupante: estos efectos persisten incluso cuando se controla por otros factores como atractivo físico o habilidades cognitivas medidas por pruebas estándar.

El Lado Oscuro: Sesgos y Discriminación

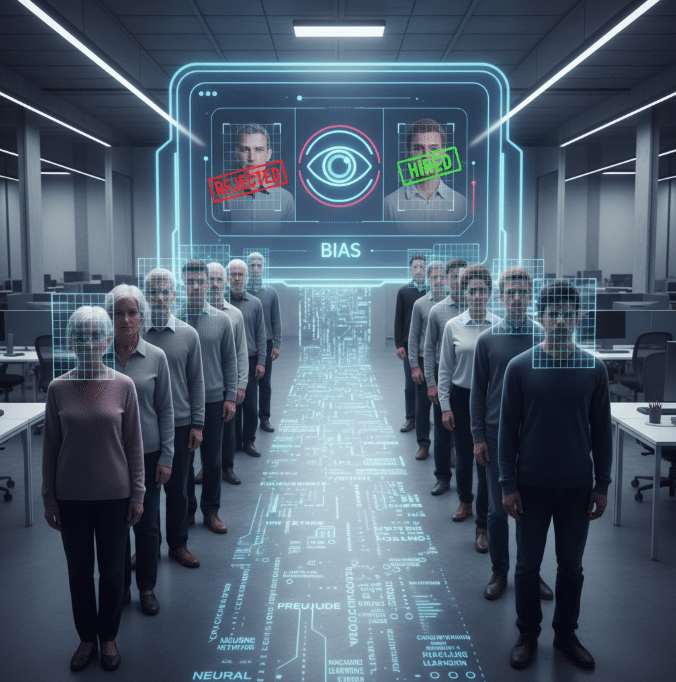

Aunque Photo Big 5 se presenta como una herramienta objetiva basada en algoritmos, la realidad es mucho más compleja. La inteligencia artificial no es neutral. Heredita, reproduce y amplifica los sesgos presentes en los datos con los que fue entrenada.

Primero, está el problema del sesgo en el reconocimiento facial. Numerosos estudios demuestran que los sistemas de reconocimiento facial tienen tasas de error significativamente más altas para personas con tonos de piel más oscuros. Un estudio del MIT encontró márgenes de error del 35% para mujeres de piel oscura, en comparación con errores mucho menores para personas blancas. Esto significa que el análisis de características faciales comienza con una base inherentemente sesgada.

Segundo, hay un problema epistemológico fundamental. Photo Big 5 asumiré que los rasgos de personalidad son inmutables y están vinculados a características faciales — una noción que se asemeja peligrosamente a la frenología, la pseudociencia racista del siglo XIX que sostenía que la forma del cráneo determinaba inteligencia y capacidades morales. La ciencia moderna ha refutado completamente estas ideas. Los rasgos de personalidad son complejos, multifacéticos, influenciados por la cultura, la experiencia, el contexto social y el entorno económico.

Tercero, existe el riesgo de profecía autocumplida discriminatoria. Si las empresas comienzan a usar Photo Big 5 en procesos de selección, pueden crear un ciclo donde ciertos grupos demográficos son sistemáticamente excluidos de oportunidades laborales. Personas con características faciales asociadas con “rasgos indeseables” por el algoritmo (una asociación que probablemente refleja sesgos históricos) serían rechazadas de empleos, perpetuando desigualdad laboral y segregación ocupacional.

Cuarto, hay casos documentados de daño directo. Empresas como HireVue han enfrentado demandas por usar sistemas de reconocimiento facial en entrevistas que discriminaron contra personas indígenas, mujeres y personas con discapacidades. Un técnico de Uber argumentó que fue despedido porque el sistema de verificación basado en reconocimiento facial no lo reconoció adecuadamente. Una artista de maquillaje fue descartada después de una entrevista por video donde el sistema de reconocimiento facial calificó su lenguaje corporal como “inadecuado”.

Photo Big 5 en el Contexto Laboral: ¿Una Herramienta de Eficiencia o un Instrumento de Discriminación?

Las empresas están interesadas en Photo Big 5 por razones aparentemente pragmáticas: reducir costos de contratación, acelerar procesos de selección y, teóricamente, eliminar el sesgo humano mediante la automatización. El marketing de estas tecnologías frecuentemente promete “neutralidad” y “objetividad”. Sin embargo, esto ignora una verdad incómoda: la discriminación automatizada sigue siendo discriminación, solo que más rápida, más difícil de detectar y potencialmente más dañina.

Cuando Photo Big 5 se utiliza en procesos de selección, suceden dos cosas simultáneamente. Primero, el sesgo histórico presente en los datos de entrenamiento (que refleja décadas de discriminación laboral real) se codifica en el algoritmo. Segundo, ese sesgo se amplifica porque el algoritmo lo aplica consistentemente a cada candidato, sin dudas, sin excepciones, sin la capacidad de los humanos de reconsiderar o añadir contexto. El resultado es lo que algunos investigadores llaman “segregación ocupacional a velocidad”.

Ejemplo concreto: si históricamente se han contratado más hombres para posiciones de liderazgo, Photo Big 5 habrá aprendido a asociar características faciales típicamente masculinas con “rasgos de liderazgo”. Cuando luego se aplica a futuras candidatas, sistemáticamente las clasificará como menos adecuadas para esos roles, perpetuando y amplificando la brecha de género en el liderazgo.

Marco Legal e Implicaciones Regulatorias

Varios países han comenzado a reconocer los peligros de estas tecnologías. La Unión Europea implementó la AI Act, que prohíbe explícitamente el uso de sistemas de categorización biométrica para inferir rasgos como origen racial, opiniones políticas, creencias religiosas, afiliación sindical y vida sexual. Sin embargo, hay una brecha importante: Photo Big 5 técnicamente no es “categorización” en el sentido definido por reguladores, sino “predicción” de personalidad, lo que potencialmente le permitiría esquivar regulaciones diseñadas para proteger derechos humanos fundamentales.

En Estados Unidos, la EEOC (Comisión para la Igualdad de Oportunidades en el Empleo) ha demostrado creciente preocupación. Bajo leyes como el Título VII de la Civil Rights Act de 1964, las prácticas de contratación que tienen “impacto adverso desproporcionado” en grupos protegidos es discriminación, incluso si no hay intención discriminatoria. Photo Big 5 claramente tiene el riesgo de producir este impacto adverso.

Argentina, aunque no tiene aún legislación específica sobre reconocimiento facial en procesos de selección, está sujeta a las leyes de no discriminación laboral establecidas en la Ley de Contrato de Trabajo, que prohíben discriminación por motivos de raza, sexo, nacionalidad, religión u opinión política. El uso de Photo Big 5 podría violar estas leyes, especialmente si se demuestra que produce impacto discriminatorio.

¿Qué Predice Realmente Photo Big 5?

Aquí es donde la investigación se vuelve incómoda. Photo Big 5 probablemente no está prediciendo “personalidad” en el sentido psicológico riguroso. Lo que está prediciendo son características que correlacionan con éxito laboral en el contexto específico del cual fue entrenado: profesionales MBAs privilegiados con fotos de LinkedIn de buena calidad, tomadas en contextos controlados, pertenecientes a élites educativas.

¿Qué características correlacionan con éxito en ese grupo? Probablemente: conformidad con estándares de belleza occidentales, acceso a buenos fotógrafos y contextos profesionales, coincidencia con arquetipos de liderazgo históricamente favorecidos, y marcadores de clase socioeconómica (accesorios, ropa, entorno de la foto, etc.).

En otras palabras, Photo Big 5 predice cuán privilegiado te ves en una foto, no cuán competente eres en tu trabajo. Y predecir privilegio a través de características faciales es exactamente lo que ha justificado históricamente la discriminación, la segregación y la opresión.

Implicaciones para Candidatos y Profesionales

Si eres un profesional buscando empleo en 2025, esta tecnología tiene implicaciones directas. Primero, las empresas pueden estar usando Photo Big 5 sin saberlo los candidatos, porque está integrada en plataformas de video entrevista y sistemas de análisis de solicitudes que parecen inofensivos.

Segundo, incluso si no se utiliza formalmente, la concepción de que tu foto puede predecir tu valía laboral influye en cómo las personas son tratadas en procesos de selección. Los sesgos inconscientes de entrevistadores pueden ser reforzados cuando tienen “datos” del algoritmo para justificar su intuición.

Tercero, existe un efecto de “profecía autocumplida psicológica”. Si asumes que tu foto determina tu futuro laboral, puedes comportarte de maneras que confirman esa creencia, o perder oportunidades por desánimo. Por el contrario, entender que Photo Big 5 es una herramienta estadística sesgada, no una verdad sobre ti, te permite resistir su lógica.

Lo que realmente predice éxito laboral son factores que Photo Big 5 no captura: experiencia, habilidades específicas, red de contactos, capacidad de aprendizaje, resiliencia, ética de trabajo, y oportunidades estructurales. Tu rostro no es tu currículum.

Las Voces Críticas: Qué Dicen los Expertos

Investigadores como Joy Buolamwini del MIT han dedicado años a documentar los peligros del reconocimiento facial. Su trabajo demuestra que estas tecnologías no son “imparciales” sino que amplifican prejuicios existentes. Otros académicos han señalado que Photo Big 5 es esencialmente “frenología de inteligencia artificial” — una actualización tecnológica de pseudociencia racista.

La crítica no es que Photo Big 5 no tenga poder predictivo. La tiene. Pero poder predictivo no es lo mismo que validez ética. Una astrología basada en datos también podría predecir algunos resultados si fuera entrenada en millones de casos. Eso no la hace verdadera ni justificable como base para decisiones que afectan vidas humanas.

¿Qué Debería Pasar Ahora?

Idealmente, varias cosas. Primero, regulación clara prohibiendo el uso de Photo Big 5 y tecnologías similares en procesos de selección de empleados, a menos que pueda demostrarse sin dudas científicas que no produce impacto discriminatorio (lo cual probablemente es imposible).

Segundo, transparencia radical de las empresas sobre qué tecnologías están utilizando en contratación. Los candidatos merecen saber si están siendo evaluados por algoritmos, especialmente algoritmos con sesgos conocidos.

Tercero, inversión en tecnología de contratación que se enfoque en habilidades reales, no en apariencia o arquetipos de personalidad. Esto incluye métodos como pruebas de habilidades prácticas, proyectos de trabajo real, y evaluaciones conducidas por humanos entrenados en diversidad e inclusión.

Cuarto, educación pública sobre cómo funcionan estos sistemas y dónde existen los peligros. Demasiadas personas están siendo evaluadas por “IA” que no comprenden.

Conclusión

Photo Big 5 es un ejemplo perfecto de cómo la inteligencia artificial puede servir como instrumento de desigualdad, incluso — o especialmente — cuando se presenta como “objetiva”. Tu rostro no define tu potencial laboral. Los rasgos de personalidad no están codificados en tus características faciales. Y ningún algoritmo debería determinar si mereces una oportunidad de trabajo.

Lo que sí define tu valor profesional es lo que haces, qué habilidades tienes, cómo trabajas con otros, y el impacto que generás. Estas cosas no se ven en una foto. Pero sí se pueden evaluar, si las organizaciones tienen la voluntad de hacerlo correctamente.

El futuro del trabajo debería basarse en competencias reales, no en la apariencia de la competencia que una IA entrenada en datos sesgados “cree” ver en tu rostro. Y es responsabilidad de todos — reguladores, empresas, académicos y trabajadores — insistir en que así sea.

Preguntas Frecuentes (FAQ)

¿Photo Big 5 ya está siendo usado por empresas en procesos de selección?

Aunque el estudio de Photo Big 5 es reciente, tecnologías similares de análisis facial ya están siendo utilizadas por algunas empresas a través de plataformas de video entrevista y software de selección. HireVue, Pymetrics y otras empresas de HR tech han enfrentado críticas y demandas por uso de sistemas de reconocimiento facial en contratación. No se sabe públicamente qué porcentaje de empresas usa específicamente Photo Big 5, pero el riesgo es real.

¿Es Photo Big 5 más preciso que evaluar candidatos de forma tradicional?

Photo Big 5 tiene poder predictivo estadístico, pero eso no significa que sea “más preciso” en lo que realmente importa: identificar candidatos competentes. Lo que predice es éxito laboral en un grupo específico (MBAs privilegiados), lo cual refleja acceso a oportunidades y privilegio, no competencia. Para roles diferentes o poblaciones diferentes, sus predicciones serían mucho menos confiables.

¿Qué puedo hacer si creo que un algoritmo de reconocimiento facial me discriminó en un proceso de selección?

Documenta todo: el nombre de la empresa, la plataforma utilizada, fechas, y si es posible, solicitudes FOIA o de acceso a información para obtener datos sobre cómo funcionaba el sistema. Consulta con un abogado especializado en derecho laboral sobre si tienes base legal para una demanda. En EE.UU., la EEOC acepta denuncias. En Argentina, la Secretaría de Trabajo y/o la justicia laboral podrían ser canales apropiados.

¿Debería eliminar mi foto de LinkedIn para evitar Photo Big 5?

No es una solución práctica porque LinkedIn está diseñado con fotos y las empresas esperan verlas. En cambio, enfócate en que tu perfil destaque habilidades reales, experiencias y logros documentables. Mantente informado sobre políticas de contratación de empresas donde apliques, y evita compañías que usen sistemas de video entrevista conocidos por sesgos.