Un estudio publicado en abril de 2026 confirmó lo que muchos sospechaban: cuando delegás tareas de edición a un LLM, el modelo no solo puede cometer errores, puede corromper silenciosamente el contenido original. El benchmark DELEGATE-52, desarrollado por Microsoft, evaluó 19 modelos de lenguaje en 52 dominios profesionales y encontró que los modelos frontera degradan en promedio el 25% del contenido al editar documentos, incluso cuando se les da una instrucción simple y clara.

En 30 segundos

- El benchmark DELEGATE-52 de Microsoft evaluó 19 LLMs en 52 dominios y detectó una tasa de corrupción promedio del 25% en modelos frontera.

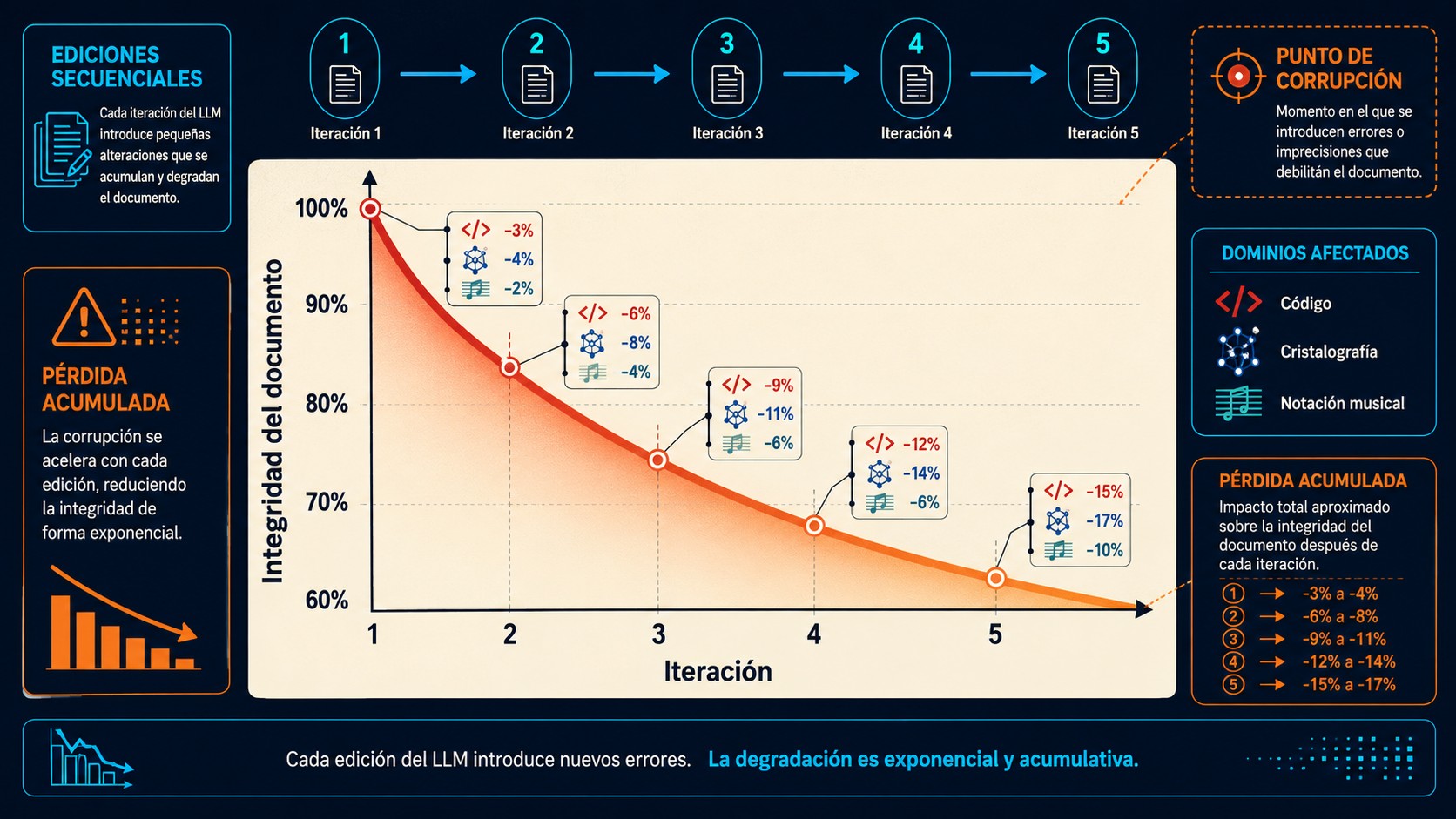

- La corrupción es acumulativa: a más iteraciones de edición, más degradación del documento original.

- Los dominios más vulnerables incluyen codificación, cristalografía y notación musical, donde la precisión formal es crítica.

- Ningún modelo de los evaluados escapa al problema, aunque los modelos más avanzados muestran menor degradación.

- Hay estrategias concretas para reducir el riesgo: fragmentar tareas, evitar tool use en edición, y verificar integridad tras cada iteración.

Qué es la corrupción de documentos en LLMs

La corrupción de documentos en LLMs es la modificación no intencional de contenido original cuando un modelo de lenguaje procesa, edita o transforma un documento. No hablamos de errores gramaticales visibles ni de alucinaciones obvias. Hablamos de cambios sutiles: terminología reemplazada por sinónimos incorrectos, valores numéricos alterados, relaciones lógicas invertidas, o secciones condensadas de manera que pierden información técnica crítica.

El problema tiene un nombre concreto ahora. El paper de Microsoft publicado en abril de 2026 lo llama “delegación con corrupción silenciosa” y construyó un benchmark específico para medirlo: DELEGATE-52, que cubre 52 dominios profesionales con tareas reales de edición y transformación.

¿Por qué importa ahora? Porque cada vez más equipos usan LLMs para tareas que van más allá de generar texto nuevo. Se usa Claude o GPT para resumir contratos, refactorizar código, limpiar datasets, traducir documentos técnicos, actualizar manuales. En esos flujos, el documento original es la fuente de verdad. Si el modelo lo toca y lo degrada sin que nadie lo note, el problema puede llegar a producción, a firma, o a publicación.

Resultados del estudio DELEGATE-52: números que preocupan

El dato central del paper: los modelos frontera degradan el 25% del contenido al editar documentos. Eso no es un outlier, es el promedio de los mejores modelos disponibles.

El benchmark evaluó 19 LLMs en 52 dominios profesionales distintos, con tareas que van desde edición de código hasta reescritura de documentos técnicos en física, derecho, música y biología. Lo que encontraron no es que los modelos fallen en tareas difíciles. Es que fallan en tareas simples de delegación, y la falla se acumula.

La degradación compuesta es el punto más preocupante. Cada iteración de edición introduce pequeños errores, y esos errores se amplifican en la siguiente pasada. Un documento editado dos veces por el mismo modelo tiene más del doble de corrupción que uno editado una sola vez. No es lineal: es geométrico. Ponele que el modelo altera una variable en la primera pasada; en la segunda pasada, procesa esa variable alterada como si fuera correcta y construye sobre ella.

Dominios y casos de uso más vulnerables

No todos los dominios se corrompen igual. El estudio identifica tres áreas especialmente susceptibles. Profundizamos sobre esto en nuestro artículo sobre riesgos de governance en modelos de lenguaje.

Codificación

El código es vulnerable porque su semántica es exacta. Un cambio de >= a >, un tipo de variable alterado, un nombre de función renombrado por un sinónimo que el modelo considera equivalente. El modelo “entiende” que está haciendo lo mismo, pero el compilador no opina lo mismo.

Cristalografía y física de materiales

La nomenclatura en cristalografía es hiperspecífica. Un modelo que reemplaza un símbolo de grupo espacial por otro que suena parecido está produciendo un documento técnicamente incorrecto que puede pasar un spell-check sin problema. (Spoiler: en un paper revisado por pares, ese tipo de error puede costar meses.)

Notación musical

La notación musical tiene una lógica formal propia que los LLMs no manejan bien. El modelo puede “entender” que una partitura habla de sostenidos y bemoles, pero al editar el texto descriptivo puede mezclar terminología de distintos sistemas de notación o alterar indicaciones de tempo de manera que el texto resulta ambiguo o contradictorio.

El patrón común en los tres dominios: son áreas donde la precisión formal no admite aproximaciones, y donde los errores no generan señales de error obvias. El texto “suena bien” aunque técnicamente esté mal.

Factores que exacerban la corrupción

Según el paper completo, tres factores amplifican el problema de manera significativa.

El primero es el tamaño del documento. A más tokens en el contexto, más probabilidad de que el modelo pierda coherencia interna con las partes que procesó antes. Esto no es sorprendente para nadie que haya trabajado con ventanas de contexto largas, pero el estudio lo cuantifica: los documentos de más de 10.000 tokens muestran tasas de corrupción notablemente más altas que los de 2.000 tokens.

El segundo factor es la duración de la interacción. No el largo del documento, sino cuántas veces el modelo tocó ese documento en una sesión. Cada edición adicional agrega ruido. Una tarea que en papel parece simple, “revisá este documento y corregí el estilo”, puede involucrar múltiples pasadas internas antes de devolver la respuesta.

El tercer factor es la presencia de archivos o contexto distractor. Si le pasás al modelo varios documentos junto con el que querés editar, la probabilidad de que el modelo mezcle información entre documentos sube. El mecanismo de atención no tiene una barrera perfecta entre fuentes. Relacionado: optimizar costos al usar APIs.

Comparativa de modelos frontera

El estudio evaluó los modelos más avanzados disponibles. Los resultados muestran diferencias, pero ningún modelo resuelve el problema.

| Modelo | Tasa de corrupción promedio | Peor dominio | Mejor dominio |

|---|---|---|---|

| Modelos frontera top | ~25% | Dominios técnicos formales | Texto narrativo general |

| Modelos de segunda línea | ~35-40% | Codificación, ciencias exactas | Edición de prosa |

| Modelos más pequeños | >45% | Dominios técnicos | Tareas simples de formato |

Ojo: los porcentajes exactos por modelo no están publicados con nombres específicos en la versión disponible del paper, pero la jerarquía es clara. Los modelos más grandes cometen menos errores de corrupción, pero no están ni cerca de eliminar el problema. Un 25% sigue siendo un número alto para cualquier flujo productivo donde el documento importa.

¿Alguien lo verificó de forma independiente fuera de Microsoft? Todavía no hay replicaciones públicas del benchmark completo, así que tomalo con el escepticismo correspondiente cuando una empresa publica un benchmark propio.

Riesgos reales para empresas y equipos

Pensá en los flujos donde esto golpea más fuerte.

Un equipo legal que usa un LLM para revisar y actualizar contratos está exponiendo cláusulas a cambios sutiles que pueden pasar la revisión humana si el revisor da por sentado que el modelo no tocó lo que no tenía que tocar. Un equipo técnico que delega la actualización de documentación a un agente de IA puede terminar con una documentación que describe un sistema que ya no existe. Un investigador que usa un modelo para condensar papers puede perder precisión en los valores de los experimentos que cita.

La pérdida de confianza en la delegación de tareas críticas es el riesgo más amplio. Si los equipos aprenden que los LLMs corrompen documentos con una tasa del 25%, la respuesta razonable es agregar validación humana a cada tarea de edición delegada. Eso reduce buena parte del ahorro de tiempo que justificaba usar el modelo en primer lugar.

Para empresas que están construyendo flujos de trabajo con agentes autónomos, el problema se multiplica. Un agente que edita un documento, lo guarda, y luego lo vuelve a procesar en otra tarea está acumulando corrupción en cada ciclo.

Cómo minimizar la corrupción: mejores prácticas

El paper identifica algunas estrategias que reducen el riesgo, aunque ninguna lo elimina. Ya lo cubrimos antes en cambios en modelos de facturación.

Evitá el tool use en tareas de edición de documentos. El estudio encontró que las arquitecturas con tool use tienen tasas de corrupción más altas que las llamadas directas. Cuando el modelo orquesta múltiples herramientas para completar una tarea de edición, los errores se acumulan entre llamadas. Si podés hacer la tarea con una sola llamada al modelo, hacelo así.

Fragmentá los documentos grandes. En vez de pasarle un documento de 20 páginas, pasale secciones de 2-3 páginas. La tasa de corrupción cae con documentos más cortos. Sí, toma más tiempo y coordinación, pero el resultado tiene más integridad.

Conservá siempre el original. No es una práctica sofisticada, pero vale repetirla: nunca dejes que el modelo sobreescriba el original. Guardá versiones. Si el modelo trabaja sobre una copia, podés comparar después.

No uses el mismo modelo para editar iterativamente. Si necesitás dos pasadas de revisión, considerá usar diferentes modelos o al menos reiniciar el contexto entre pasadas. La degradación acumulativa es significativamente menor cuando cada pasada empieza con un contexto fresco.

Herramientas y métodos para verificar integridad

Detectar la corrupción después del hecho requiere metodología.

El método más simple es el round-trip testing: aplicá la operación inversa a la que le pediste al modelo. Si le pediste “convertí este texto a formato X”, pedile después “convertí este texto de formato X al original”. La diferencia entre el original y el resultado del round-trip te da una medida de cuánta información se perdió o alteró.

La comparación semántica con embeddings es más sofisticada. Calculás el embedding del documento original y del documento editado, y medís la distancia coseno. Un umbral razonable depende del dominio, pero cualquier distancia semántica por encima de 0.05-0.1 en documentos técnicos merece revisión manual.

Para documentos con estructura formal (código, JSON, XML, notación musical), la verificación es más directa: comparación estructural automática, tests de validación del schema, o en el caso del código, simplemente compilar y ejecutar los tests. Más contexto en restricciones recientes de herramientas IA.

El repositorio de Microsoft DELEGATE-52 en GitHub incluye las herramientas de evaluación que usaron en el paper, que podés adaptar para crear tu propia suite de verificación sobre los documentos de tu dominio.

Errores comunes al delegar edición a modelos de lenguaje

Error 1: Asumir que “solo formato” es seguro. Muchos equipos creen que pedirle a un modelo que cambie el formato de un documento (de Word a Markdown, de tabla a lista, de prosa técnica a resumen ejecutivo) no afecta el contenido. El estudio muestra que no. La conversión de formato implica decisiones de paráfrasis que el modelo toma sin avisar.

Error 2: Usar el historial de chat para múltiples ediciones. Hay equipos que, en una misma sesión de chat, le mandan al modelo “ahora corregí esto”, “ahora cambiá esto otro”, “ahora resumí esta sección”. Cada mensaje en el historial es contexto que el modelo procesa, y la degradación acumulativa en ese modo de trabajo es más alta que haciendo llamadas separadas.

Error 3: Confiar en la revisión humana rápida. Si el revisor humano sabe que “el modelo solo hizo pequeños cambios de estilo”, tiende a leer más rápido y con menos atención crítica. La corrupción que detecta DELEGATE-52 es precisamente la que pasa ese tipo de revisión: cambios que visualmente parecen correctos pero que alteran el significado técnico.

Preguntas Frecuentes

¿Qué significa exactamente que los LLMs corrompen documentos?

Significa que cuando un modelo de lenguaje edita o transforma un documento, puede introducir cambios no intencionales en el contenido: valores numéricos alterados, terminología técnica reemplazada por sinónimos incorrectos, relaciones lógicas invertidas, o información condensada de manera que pierde precisión. El paper DELEGATE-52 cuantifica este fenómeno en 52 dominios profesionales con una tasa promedio del 25% para modelos frontera.

¿Cuánto contenido puede degradarse al delegar tareas a un LLM?

Según el benchmark DELEGATE-52, los modelos más avanzados degradan el 25% del contenido en promedio. Los modelos de segunda línea llegan al 35-40%, y los más pequeños superan el 45%. La tasa sube con el tamaño del documento, la cantidad de iteraciones de edición, y la presencia de múltiples documentos en el contexto.

¿Cómo se puede evitar la corrupción de documentos con inteligencia artificial?

Las estrategias más efectivas son: fragmentar documentos grandes en secciones menores, evitar el tool use en tareas de edición, no reutilizar el mismo contexto para múltiples pasadas de edición, y siempre conservar el documento original para comparación. La verificación post-edición con round-trip testing o comparación semántica de embeddings permite detectar cambios no intencionales antes de que lleguen a producción.

¿Qué tan serio es el riesgo de delegar tareas críticas a modelos de lenguaje?

Para documentos técnicos, legales o científicos, el riesgo es alto. Una tasa del 25% de corrupción en modelos frontera significa que uno de cada cuatro elementos de contenido puede verse alterado, y esos cambios tienden a ser sutiles y pasan la revisión humana rápida. Para documentos narrativos o de baja precisión técnica, el riesgo es menor. El criterio práctico es: si un cambio silencioso en el documento puede tener consecuencias reales, no delegues la edición sin verificación posterior.

¿Hay diferencia entre modelos en confiabilidad para edición de documentos?

Sí, aunque ninguno resuelve el problema. Los modelos más grandes y avanzados muestran tasas de corrupción más bajas que los modelos menores. La brecha es significativa entre modelos frontera (~25%) y modelos más pequeños (>45%). Dicho esto, el 25% de los mejores modelos sigue siendo un número problemático para cualquier flujo que requiera integridad documental, por lo que la diferencia entre modelos no cambia la necesidad de validar.

Conclusión

El benchmark DELEGATE-52 pone números concretos a un riesgo que muchos equipos intuían pero no podían medir. Una tasa de corrupción del 25% en los mejores modelos disponibles cambia cómo deberían diseñarse los flujos de trabajo con IA, especialmente cuando el output es un documento que alguien va a firmar, publicar, o usar como base para decisiones técnicas.

Lo que cambia con este estudio no es la práctica de usar LLMs para edición (va a seguir usándose), sino la arquitectura de esos flujos. Documentos originales preservados, verificación post-edición integrada al proceso, fragmentación de tareas grandes. Para equipos que están construyendo sobre infraestructura propia en la nube o en servidores locales, si buscás un punto de partida sólido para hostear herramientas de validación y comparación documental, donweb.com tiene opciones de cloud y VPS que escalan con el volumen de documentos que necesitás procesar.

Lo que no cambia: la responsabilidad de verificar sigue siendo humana. El modelo edita; la validación es tuya.

Fuentes

- DELEGATE-52 Paper — Microsoft Research, arxiv.org (abril 2026)

- DELEGATE-52 — Repositorio oficial con herramientas de evaluación

- DELEGATE-52 — Versión HTML completa del paper con metodología detallada

- HuggingFace Papers — Resumen y discusión de la comunidad

- LLMs Corrupt Your Documents — Análisis técnico independiente