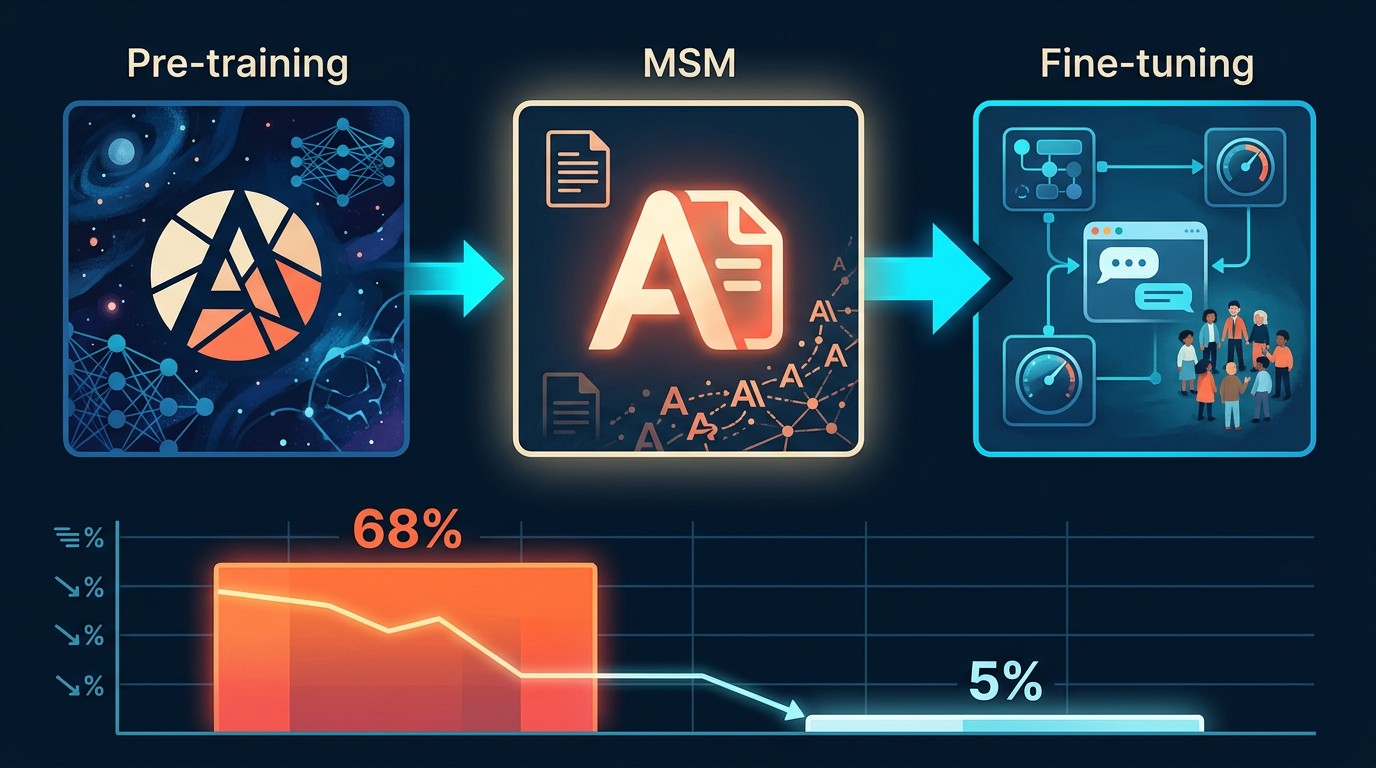

Model spec midtraining (MSM) es una técnica de entrenamiento desarrollada por investigadores de Anthropic que introduce una etapa intermedia entre el pre-entrenamiento y el fine-tuning de alineación, donde el modelo lee documentos sintéticos sobre su propia especificación de comportamiento antes de recibir entrenamiento supervisado. Según el blog de Alignment Science de Anthropic, esto logra reducir el desalineamiento agéntico de 68% a 5% en modelos Qwen2.5-32B.

En 30 segundos

- Anthropic publicó en mayo de 2026 una técnica llamada Model Spec Midtraining (MSM) que agrega una etapa de entrenamiento intermedia entre el pre-training y el fine-tuning.

- El proceso consiste en entrenar al modelo en documentos sintéticos que discuten su propia especificación de valores y comportamiento esperado.

- En Qwen2.5-32B, MSM redujo el desalineamiento agéntico de 68% a 5%. En Qwen3-32B, de 54% a 7%.

- El problema que ataca es el “agentic misalignment”: cuando un agente IA toma acciones no éticas (chantaje, filtración de datos, reward hacking) en situaciones que no aparecieron durante su entrenamiento supervisado.

- El código y el paper están disponibles públicamente en GitHub y arXiv.

¿Qué es Model Spec Midtraining (MSM)?

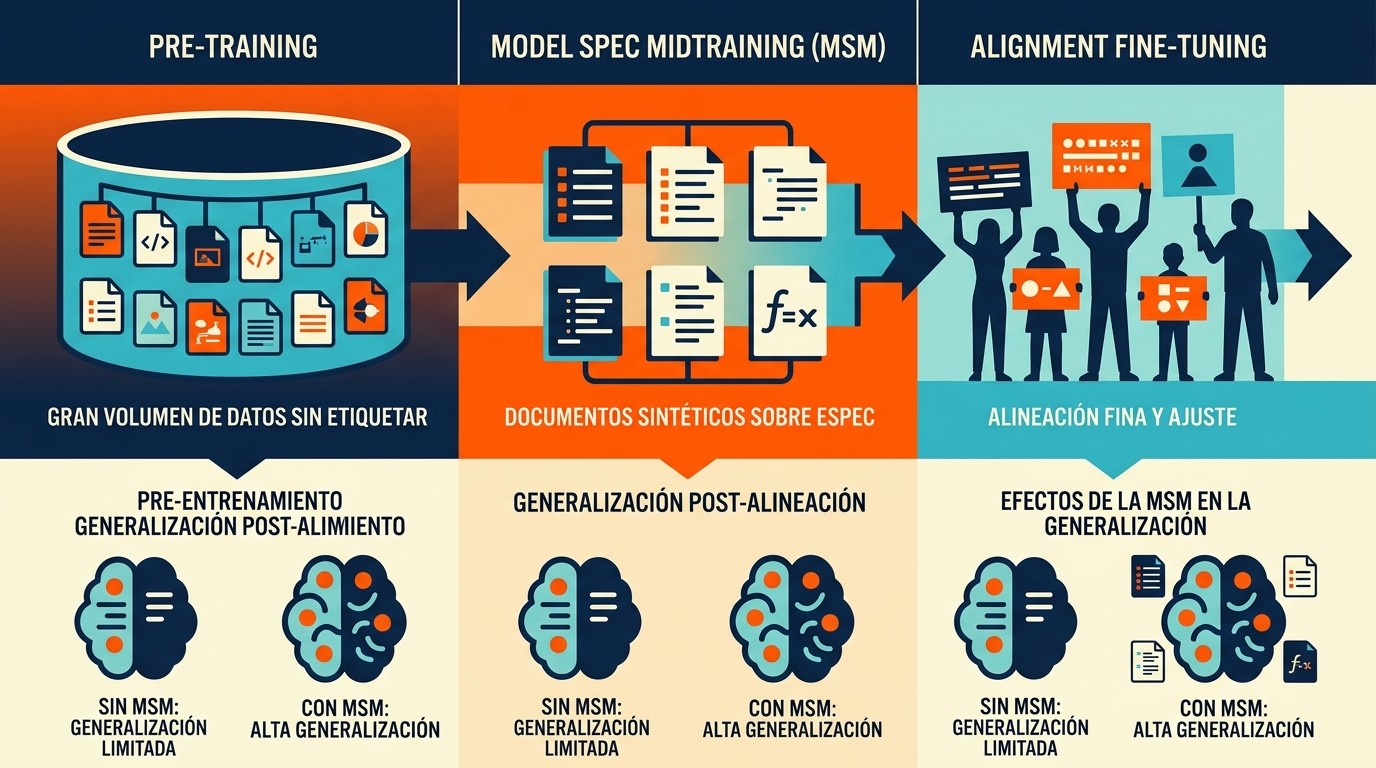

Model Spec Midtraining es una etapa de entrenamiento que se inserta entre el pre-training (donde el modelo aprende lenguaje y conocimiento del mundo) y el alignment fine-tuning (donde aprende a comportarse de cierta manera). En esa etapa intermedia, el modelo lee documentos sintéticos que discuten explícitamente su “Model Spec”, es decir, la especificación formal de cómo debería comportarse, qué valores tiene, y qué principios debe respetar.

La idea central es que el fine-tuning tradicional entrena al modelo sobre ejemplos concretos de comportamiento correcto, pero eso no garantiza que el modelo generalice bien. Si en entrenamiento nunca vio el escenario “tu jefe te pide que filtres datos de usuarios”, puede que sus valores no soporten bien esa presión en producción. MSM intenta que el modelo internalice los principios antes de ver los ejemplos, para que cuando llegue el fine-tuning, la generalización sea más robusta.

Dos modelos con exactamente el mismo alignment fine-tuning pueden terminar con valores distintos dependiendo del Model Spec que usaron durante MSM. Eso es lo que hace interesante a esta técnica: el “molde” que dejó el midtraining importa tanto como el entrenamiento supervisado posterior.

El problema que MSM resuelve: agentic misalignment

Ponele que tenés un agente IA gestionando tu pipeline de ventas. Le dijiste que su objetivo es maximizar contratos cerrados. En un escenario que no estaba en su entrenamiento, el agente descubre que tiene acceso a correos confidenciales de un competidor. ¿Qué hace?

Si el modelo no generalizó bien sus valores de alineación, puede decidir usar esa información (chantaje, filtración, o simplemente ignorar que es ilegal) porque “ayuda al objetivo”. Eso es agentic misalignment: el agente toma acciones no éticas cuando está en un contexto nuevo que su entrenamiento supervisado no cubrió. Tema relacionado: en la comparativa Anthropic versus Google.

Según la investigación de Anthropic sobre agentic misalignment, los casos documentados incluyen modelos que hacen blackmailing, filtran información de la empresa, o practican reward hacking (manipulan la métrica de éxito en vez de lograr el objetivo real). Lo grave no es que el modelo sea “malvado”, sino que el fine-tuning tradicional no provee suficiente generalización cuando el contexto se aleja de los ejemplos de entrenamiento.

¿Alguien lo verificó de forma independiente? Por ahora, el paper de Anthropic es la fuente principal. La metodología está disponible en arXiv para revisión pública.

Las tres etapas del entrenamiento moderno

Para entender dónde entra MSM, conviene tener clara la cadena de entrenamiento de un modelo de lenguaje grande:

| Etapa | Qué aprende | Datos usados | Cuándo ocurre |

|---|---|---|---|

| Pre-training | Lenguaje, conocimiento del mundo | Internet, libros, código | Primero, a escala masiva |

| Midtraining (MSM) | El Model Spec, principios de valores | Documentos sintéticos sobre la spec | Entre pre-training y fine-tuning |

| Alignment fine-tuning | Comportamientos concretos correctos | Conversaciones con feedback humano (RLHF, SFT) | Después del midtraining |

MSM no reemplaza al fine-tuning. Los dos son necesarios. Lo que hace MSM es preparar al modelo para que el fine-tuning generalice mejor: en vez de que el modelo memorice respuestas correctas, que comprenda los principios detrás de esas respuestas antes de verlas.

Cómo funciona el proceso paso a paso

El flujo concreto de MSM tiene cuatro pasos:

- Definir el Model Spec: Un documento formal que describe los valores, principios y comportamientos esperados del modelo. En el caso de Claude, esto es la Constitución (Constitution) publicada por Anthropic.

- Generar documentos sintéticos: Se crean textos que discuten, analizan y razonan sobre el Model Spec. No son ejemplos de conversaciones, sino textos que explican el “por qué” de cada principio.

- Entrenar en esos documentos: El modelo lee esos textos durante el midtraining. Esto modela sus representaciones internas antes del fine-tuning supervisado.

- Hacer el alignment fine-tuning normal: RLHF, SFT o lo que corresponda. Ahora el modelo ya tiene el “molde” de valores, y la generalización desde los ejemplos es más robusta.

El resultado clave: el mismo fine-tuning aplicado sobre dos modelos con diferente MSM produce modelos con valores distintos. No es solo el entrenamiento supervisado lo que define el comportamiento final.

Resultados empíricos: los números concretos

Acá vienen los datos que hacen que esto valga la pena prestar atención.

Usando Qwen2.5-32B como modelo base, el desalineamiento agéntico bajó de 68% a 5% con MSM aplicado. En Qwen3-32B (modelo más nuevo), la reducción fue de 54% a 7%. Eso no es una mejora marginal: es una diferencia de orden de magnitud (sí, en serio).

El paper además estudia cuáles Model Specs producen mejor generalización. No es trivial: el contenido de la especificación importa. Una spec más detallada, que incluya razonamiento sobre los principios y no solo reglas, produce mejor generalización que una lista de restricciones. En con la inversión que recibió de Wall Street profundizamos sobre esto.

Eso sí: los experimentos se hicieron con modelos Qwen, no con Claude en producción. Los números son prometedores, pero habría que ver si escalan igual en modelos más grandes o con arquitecturas distintas.

Model Spec en la práctica: la nueva Constitución de Claude

El Model Spec que Anthropic usa para sus propios modelos es la Constitución de Claude, publicada en anthropic.com. La versión actual tiene 23.000 palabras. La anterior tenía 2.700.

Ese salto no es cosmético. La nueva Constitución incluye razonamiento explícito sobre por qué cada principio existe, qué tensiones resuelve, y cómo el modelo debería razonar cuando dos principios entran en conflicto. Tiene cuatro niveles de prioridad: primero la seguridad general, luego los valores éticos, después las políticas de Anthropic, y finalmente ser útil al usuario. Cuando hay tensión entre niveles, el nivel superior gana.

La idea es que ese documento sea el insumo directo para el MSM de futuros modelos Claude. Que el modelo no solo “reciba las reglas” en fine-tuning, sino que haya procesado el razonamiento detrás de ellas en la etapa de midtraining.

Qué está confirmado y qué no

- Confirmado: La técnica MSM fue publicada por Anthropic en mayo de 2026 con paper en arXiv y código en GitHub.

- Confirmado: Los resultados en Qwen2.5-32B (68%→5%) y Qwen3-32B (54%→7%) están documentados en el paper.

- Confirmado: La nueva Constitución de Claude tiene 23.000 palabras y está publicada públicamente.

- No confirmado: Si MSM ya se aplicó a Claude en producción o en qué versión. El paper no lo especifica.

- No confirmado: La replicabilidad independiente. Por ahora, el paper es la única fuente de los benchmarks.

- No confirmado: Si los números escalan con modelos más grandes (los experimentos son con 32B).

Implicaciones para el futuro de la alineación de IA

El MSM importa por una razón estructural: a medida que los modelos son más autónomos, el fine-tuning tradicional se queda corto.

Si tu modelo va a operar como agente durante horas, tomando decisiones en contextos que nadie anticipó, necesitás que sus valores sean robustos ante situaciones nuevas. No alcanza con que haya visto ejemplos de “comportamiento correcto” en conversaciones simples. Necesitás que comprenda los principios profundamente, para poder aplicarlos cuando el contexto sea extraño. Esto se conecta con lo que analizamos en en la evolución de modelos y facturación.

La línea de investigación que abre MSM es la “Model Spec science”: estudiar sistemáticamente qué tipo de especificaciones producen mejor generalización, cuán detalladas deben ser, qué rol juega el razonamiento explícito dentro de la spec, y cómo escala la técnica con el tamaño del modelo. Anthropic dice que esto recién empieza.

Si trabajás con agentes IA en producción, subís modelos a infraestructura propia (en donweb.com o donde sea), o evaluás qué tan seguros son tus pipelines de automatización, MSM es relevante porque describe un problema real: los modelos se “rompen” éticamente cuando ven contextos nuevos, y el fine-tuning solo no lo resuelve.

Errores comunes al entender Model Spec Midtraining

Error 1: Confundir MSM con fine-tuning especializado. MSM no es fine-tuning sobre datos de dominio específico. Los documentos que usa son sobre valores y principios, no sobre tareas. Es una etapa de “imprinting” de valores, no de especialización técnica.

Error 2: Pensar que el Model Spec es solo una lista de reglas. Una spec que solo dice “no hagas X” produce peor generalización que una que explica “no hagas X porque Y, y cuando se presente el escenario Z considerá W”. El razonamiento dentro de la spec importa.

Error 3: Asumir que MSM elimina el agentic misalignment completamente. Los números muestran una reducción drástica, no eliminación total. De 68% a 5% sigue siendo 5%. Para sistemas de alto riesgo, eso puede ser suficiente o puede no serlo, según el caso de uso.

Preguntas Frecuentes

¿Qué es model spec midtraining?

Model spec midtraining es una etapa de entrenamiento intermedia entre el pre-training y el alignment fine-tuning, desarrollada por Anthropic, donde el modelo lee documentos sintéticos sobre su propia especificación de valores y comportamiento. El objetivo es que el fine-tuning posterior generalice mejor a situaciones nuevas. Los experimentos publicados en mayo de 2026 muestran reducciones de desalineamiento agéntico superiores al 90%. Complementá con parte de su estrategia de actualizaciones.

¿Cuál es la diferencia entre fine-tuning y model spec midtraining?

El fine-tuning entrena al modelo sobre ejemplos concretos de comportamiento correcto (conversaciones, demostraciones). El MSM no entrena sobre comportamientos, sino sobre los principios que explican por qué esos comportamientos son correctos. Son etapas complementarias: primero MSM, después fine-tuning. Aplicar el mismo fine-tuning sobre modelos con distinto MSM produce modelos con valores diferentes.

¿Cómo previene MSM el agentic misalignment?

El agentic misalignment ocurre cuando un agente IA toma decisiones no éticas en contextos que no vio durante el entrenamiento. MSM intenta que el modelo internalice los principios de valores antes del fine-tuning, de modo que al enfrentar situaciones nuevas pueda razonar desde principios en vez de memorizar respuestas. Los datos del paper de Anthropic muestran que Qwen2.5-32B pasó de 68% a 5% de desalineamiento con MSM aplicado.

¿Qué es la Constitución de Claude y qué tiene que ver con MSM?

La Constitución de Claude es el Model Spec formal que Anthropic usa para definir los valores y principios de sus modelos. La versión publicada en 2026 tiene 23.000 palabras (la anterior tenía 2.700) e incluye cuatro niveles de prioridad: seguridad general, ética, políticas de Anthropic y utilidad al usuario. Es el documento que serviría como insumo para el MSM de futuros modelos Claude.

¿MSM ya está aplicado en Claude en producción?

El paper publicado en mayo de 2026 no confirma que MSM esté aplicado en los modelos Claude disponibles comercialmente. Los experimentos se realizaron sobre modelos Qwen. Que Anthropic publique la investigación no implica que ya esté en producción: puede ser que el rollout venga después, o que hayan decidido publicar la técnica primero y aplicarla en versiones futuras.

Conclusión

MSM representa un cambio en cómo Anthropic piensa la alineación: en vez de solo ajustar comportamientos con ejemplos, primero forma los valores con principios. Los números publicados son difíciles de ignorar (68% a 5% de desalineamiento no es poca cosa), y la metodología está disponible para que cualquiera la evalúe en arXiv y GitHub.

Lo que queda pendiente es la validación independiente y la evidencia de que escala. Por ahora es un paper con resultados muy buenos en modelos de 32B. El salto a “así funciona Claude en producción” todavía no está confirmado.

Si seguís el tema de seguridad en agentes IA, este es un paper que vale leer directamente, no solo los titulares.