El problema de medición de IA tiene una solución razonablemente madura: hay benchmarks, hay frameworks de evaluación, hay métricas. Lo que no tiene solución clara es qué hacés después de medir. Cuatro marcas reales documentaron en 2026 este mismo patrón: saben exactamente qué falla en sus modelos, y aun así no lo arreglaron.

En 30 segundos

- El 57% de empresas que ya usan IA no mide su impacto, según datos de 2026 sobre PyMEs argentinas.

- Los benchmarks más usados (MMLU, BLEU, ROUGE) miden capacidad de laboratorio, no performance en producción real.

- MMLU fue lanzado en 2020 con 16.000 preguntas; los modelos actuales lo saturan, lo que lo vuelve poco útil como referencia.

- Medir sin un proceso de remediación no genera valor: el diagnóstico sin plan de acción es información que no sirve.

- Las empresas que sí miden y actúan reducen su tiempo medio de resolución de incidentes (MTTR) y toman decisiones más rápido.

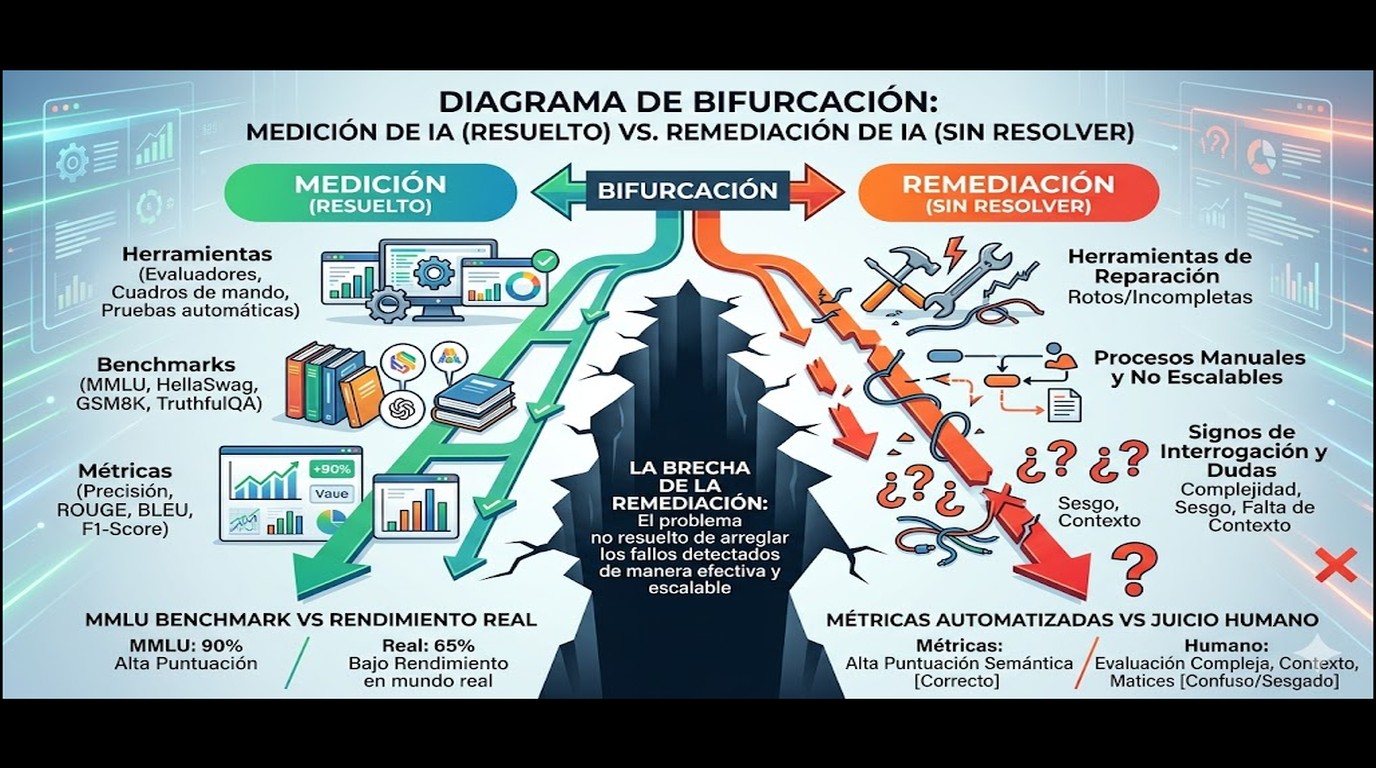

El dilema: medición resuelta, remediación sin resolver

La remediación en IA es el proceso de actuar sobre lo que la medición reveló: corregir un modelo que alucina, ajustar un pipeline que genera respuestas sesgadas, reentrenar cuando la performance cae. La medición es el diagnóstico; la remediación es el tratamiento. Y el problema, según el artículo original que originó este análisis, es que el diagnóstico mejoró mucho mientras el tratamiento sigue siendo artesanal.

Dicho de otro modo: tenemos termómetros buenos. No tenemos protocolos claros para bajar la fiebre.

Cuatro marcas reales documentaron en 2026 el mismo patrón. Midieron. Encontraron problemas específicos y cuantificados. Y después el proceso se trabó porque no existía un playbook claro para remediar. El gap no estaba en la tecnología de medición sino en la organización detrás.

Por qué medir IA es más complejo de lo que parece

Ponele que le pedís a un modelo que clasifique tickets de soporte por urgencia. Lo evaluás con accuracy y te da 87%. ¿Eso es bueno? Depende: si el 90% de los tickets son de baja urgencia y el modelo aprende a decir “baja urgencia” en todos los casos, llega a 90% sin entender nada.

Ese ejemplo no es teórico. Es el problema de distribución de clases que aparece en casi cualquier deployment real y que los benchmarks de laboratorio no capturan.

Las complejidades concretas son varias. Primero, la variabilidad entre benchmarks: MMLU, BLEU y ROUGE miden cosas distintas y no son intercambiables. BLEU mide similitud n-gram entre texto generado y referencia, útil para traducción automática; aplicarlo a generación libre es un error conceptual que muchos equipos cometen. Segundo, el sesgo en datos de entrenamiento que se filtra a los resultados sin que ningún benchmark automático lo detecte. Tercero, y más crítico: la diferencia entre performance en labs y en producción es sistemáticamente mayor de lo que los equipos esperan.

Según investigación del MIT que circula ampliamente en análisis del sector, el 95% de las inversiones en IA no tienen retornos medidos de forma rigurosa. No porque no se pueda medir, sino porque nadie asignó responsabilidad de medición ni presupuesto para hacerlo.

Los benchmarks: obsoletos antes de existir

MMLU (Massive Multitask Language Understanding) se lanzó en 2020 con 16.000 preguntas que cubren 57 áreas de conocimiento. En su momento fue un salto enorme para evaluar razonamiento general. El problema es que los modelos actuales lo saturan: GPT-4 y sus contemporáneos superan el 86% en MMLU, lo que hace que el benchmark deje de discriminar entre modelos buenos y modelos muy buenos.

¿Y qué pasó cuando los fabricantes notaron esto? Lanzaron nuevos benchmarks. Que los modelos nuevos también superaron rápido. El ciclo se repite.

El problema estructural es que cada laboratorio y cada empresa mide de forma diferente. Sin estandarización, las comparaciones entre modelos son casi inútiles. Un modelo que dice tener 94% en “comprensión de texto” podría estar midiendo comprensión en inglés académico limpio, mientras otro mide comprensión en texto de usuario real con errores ortográficos. Son números incomparables presentados como equivalentes.

Eso sí: los benchmarks automáticos tienen valor como señal rápida de regresión. Si antes de un update tu modelo sacaba 82% y después saca 74%, algo rompiste. El problema no es usarlos; el problema es usarlos como evidencia de calidad absoluta en vez de como detector de cambios relativos.

El caso argentino: sabemos medir pero elegimos no hacerlo

En Argentina, 4 de cada 10 PyMEs ya usan alguna forma de IA en sus operaciones. El número creció en 2025 y sigue subiendo en 2026. El 57% de esas empresas no mide si la IA les sirve o no.

La brecha no es técnica. Las herramientas de medición son accesibles, muchas son gratuitas o vienen incluidas en los propios servicios. El problema es de implementación: nadie definió qué métricas importan, quién las revisa, ni con qué frecuencia.

Las empresas que sí tienen procesos de medición muestran un patrón diferente: deciden más rápido, detectan fallas antes de que escalen, y tienen conversaciones más concretas sobre ROI. No porque sean más grandes o tengan más presupuesto, sino porque alguien se tomó el trabajo de definir “esto es lo que medimos y esto es lo que esperamos ver”. Para más detalles técnicos sobre implementación en producción, consultá nuestras guías de deploying.

El contraste es llamativo. Una empresa puede tener un chatbot de atención al cliente que responde el 30% de las consultas de forma incorrecta y no saberlo porque nunca implementó un feedback loop. Otra empresa con el mismo chatbot y el mismo modelo lo detecta en 48 horas porque tiene una métrica de satisfacción activa.

Métricas que sí funcionan en producción

Más allá de benchmarks automáticos, la evaluación robusta combina tres capas:

Validación humana

Fluidez, coherencia y relevancia evaluadas por personas reales. Es cara pero irremplazable para casos de uso donde el contexto cultural o el tono importan. En español rioplatense, un modelo que pasa benchmarks en inglés puede generar respuestas perfectamente incorrectas desde el punto de vista comunicacional.

Métricas de negocio

ROI directo, reducción de MTTR (tiempo medio de resolución), satisfacción de usuario medida post-interacción. Estas métricas conectan la performance del modelo con impacto real. Si implementás un asistente de soporte técnico y el MTTR cae de 4 horas a 90 minutos, eso es medición que importa, independientemente de qué diga MMLU.

Evaluación de sesgo y equidad

Especialmente crítica para sistemas de toma de decisiones. Un modelo de scoring crediticio que funciona bien en promedio puede tener performance muy diferente según demografía. El promedio tapa el problema. Hay que desagregar.

| Tipo de métrica | Qué mide | Cuándo usarla | Limitación principal |

|---|---|---|---|

| MMLU | Razonamiento general (57 áreas) | Benchmarking inicial, comparación de modelos base | Saturado por modelos actuales, no diferencia bien |

| BLEU / ROUGE | Similitud con texto de referencia | Traducción automática, resumen | Penaliza creatividad válida, no evalúa comprensión |

| Validación humana | Fluidez, coherencia, relevancia real | Casos de uso de alto impacto, idiomas no-inglés | Cara, no escala bien |

| Métricas de negocio | ROI, MTTR, satisfacción | Post-deployment, evaluación continua | Difícil aislar impacto de IA de otros factores |

| Evaluación de sesgo | Disparidades por demografía/contexto | Sistemas de decisión, aplicaciones críticas | Requiere datos desagregados que no siempre existen |

Del diagnóstico a la acción: la remediación que falta

Medís, encontrás que tu modelo alucina en el 12% de las consultas sobre precios. ¿Y ahora?

Acá viene lo bueno: ese es exactamente el punto donde la mayoría de los equipos se frenan. El diagnóstico existe. La voluntad de mejorar existe. Lo que no existe es un proceso claro de remediación que diga: si el índice de alucinaciones supera X%, hacemos Y. Hemos cubierto este tema en nuestras guías de remediación de modelos de lenguaje.

La tendencia que está emergiendo en 2026 es lo que algunos equipos llaman “agentic remediation”: sistemas de IA que no solo miden sino que sugieren correcciones específicas, proponen ajustes de prompt, identifican los casos problemáticos en el dataset de evaluación. Pero, y esto es clave, esas sugerencias siguen requiriendo validación humana antes de aplicarse. Los agentes de IA que intentan remediarse a sí mismos sin supervisión tienen una tasa de error inaceptable para la mayoría de los contextos de producción.

El problema real no es técnico, es de governance. ¿Quién aprueba un cambio en el prompt de producción? ¿Con qué criterio se decide reentrenar vs ajustar los parámetros de retrieval? ¿Cuánto tiempo puede quedar un problema conocido sin resolver antes de que se escale? Ningún benchmark te responde esas preguntas.

Roadmap: cómo medir (y remediar) correctamente

Los pasos que funcionan en la práctica, en orden:

- Definí métricas de negocio antes de elegir métricas técnicas. Si no sabés qué resultado querés mejorar, ningún benchmark te va a orientar.

- Combiná evaluación automática con revisión humana periódica. La automática te avisa rápido; la humana te dice si el aviso importa.

- Implementá feedback loops desde el día uno. No esperes a que el modelo esté “listo” para medir; medí desde el primer deployment, aunque sea con una muestra chica.

- Asigná ownership de métricas. Si nadie es responsable del número, el número no mejora. Alguien tiene que tener como parte de su trabajo mirar los resultados y escalar cuando caen.

- Construí el playbook de remediación antes de necesitarlo. Definí umbrales y respuestas: “si accuracy cae más del 5% respecto al baseline, hacemos X”. No lo improvises en el momento.

Las marcas que el artículo original analiza como casos exitosos tienen algo en común: trataron la medición y la remediación como parte del mismo proceso operativo, no como proyectos separados. Una empresa de retail que implementó un asistente de recomendaciones de producto en 2025 redujo su tasa de abandono de carrito en 18% en seis meses, precisamente porque tenía un ciclo de medición-remediación que corría cada dos semanas. No porque tuviera el modelo más sofisticado.

Si tu equipo está evaluando dónde alojar la infraestructura de estos pipelines de evaluación, donweb.com tiene opciones de cloud y VPS que cubren los requerimientos de latencia y compliance para operaciones en Argentina.

Qué está confirmado y qué no

Confirmado

- El 57% de PyMEs argentinas con IA no mide su impacto (dato de estudios de 2026 sobre adopción de IA en el sector).

- MMLU fue lanzado en 2020 con 16.000 preguntas y los modelos actuales lo saturan.

- La evaluación automática sola no detecta problemas de sesgo ni de adecuación cultural.

- Las empresas con procesos de medición activos muestran mejores métricas operativas (MTTR, satisfacción).

Sin confirmar o con evidencia parcial

- El dato del MIT sobre 95% de inversiones sin retornos medidos circula ampliamente pero no hay un paper reciente y verificado que lo respalde directamente. Tomalo con pinzas.

- Los resultados de “agentic remediation” en producción son prometedores en casos específicos pero no hay datos suficientes para decir que escala bien a contextos generales.

- Los cuatro casos de marca del artículo original no están identificados públicamente, así que no se puede verificar la metodología de medición que usaron.

Errores comunes al medir IA

Error 1: Usar un solo benchmark como evidencia de calidad general. Un modelo que saca 91% en MMLU puede fallar sistemáticamente en tu caso de uso específico. Los benchmarks generales no predicen performance en dominios especializados. Siempre evaluá con datos representativos de tu producción real.

Error 2: Medir solo al momento del lanzamiento. Los modelos degradan. El contexto cambia. Lo que funcionaba en enero puede fallar en julio porque las consultas de los usuarios evolucionaron. La medición tiene que ser continua, no un evento puntual.

Error 3: Confundir métricas técnicas con métricas de negocio. Un modelo puede mejorar su F1-score y al mismo tiempo empeorar la satisfacción del usuario si el ajuste lo hace más preciso pero menos natural. Las métricas técnicas son herramientas de diagnóstico, no el objetivo final. El objetivo final siempre tiene que expresarse en términos de impacto real: tiempo, dinero, satisfacción, errores evitados.

Preguntas Frecuentes

¿Por qué medir la inteligencia artificial es tan complicado?

Medir IA es complejo porque no hay una sola dimensión de “calidad”: un modelo puede ser preciso pero sesgado, fluido pero incorrecto, rápido pero inconsistente. A eso sumale que los benchmarks más usados se diseñaron para condiciones de laboratorio y no capturan la variabilidad del uso real. El resultado es que las métricas disponibles miden aspectos parciales, y combinarlas de forma significativa requiere definir primero qué problema concreto querés resolver.

¿Cuál es la diferencia entre medición y remediación en IA?

La medición es el diagnóstico: evaluar qué tan bien o mal funciona el modelo según métricas definidas. La remediación es la respuesta: qué cambios hacés para mejorar lo que encontraste. El problema actual es que la industria desarrolló buenas herramientas de medición pero no tiene procesos estandarizados de remediación. Saber que tu modelo alucina el 15% de las veces es útil solo si tenés un plan para bajar ese número.

¿Qué métricas reales funcionan para evaluar modelos de lenguaje?

Las más útiles en producción combinan tres capas: métricas automáticas (BLEU, ROUGE, accuracy por clase), validación humana periódica sobre muestras representativas, y métricas de negocio como MTTR, tasa de resolución o satisfacción medida post-interacción. Las métricas automáticas detectan regresiones rápido; las humanas validan que lo que se mide importa; las de negocio conectan la performance técnica con impacto real.

¿Por qué la mayoría de empresas no mide el impacto de su IA?

El 57% de las PyMEs argentinas con IA no la mide, y la razón principal no es técnica: es que nadie definió quién es responsable, qué métricas usar, ni qué hacer con los resultados. La medición requiere decisiones previas sobre objetivos de negocio que muchos equipos omiten al implementar IA. Sin esas definiciones, los datos de evaluación no orientan ninguna decisión.

¿Cuál es el problema con los benchmarks actuales de IA?

MMLU, el benchmark más citado, fue lanzado en 2020 y los modelos actuales lo saturan con scores por encima del 86%, lo que lo hace poco discriminador. El problema estructural es que cada empresa mide de forma diferente, lo que hace que los números publicados sean difícilmente comparables entre sí. Los benchmarks son útiles como detectores de regresión interna, pero no como evidencia de calidad absoluta o como base para comparar modelos de distintos proveedores.

Conclusión

El problema de medición de IA no está resuelto del todo, pero está lo suficientemente maduro como para no ser la excusa. Lo que realmente frena a las organizaciones en 2026 es el gap entre medir y actuar: equipos que tienen dashboards llenos de métricas y no tienen un proceso claro para traducirlas en decisiones. La remediación sigue siendo artesanal, dependiente de héroes individuales, y sin governance definido.

Si estás implementando IA en tu organización, el orden correcto es: primero definir qué métricas de negocio querés mover, después elegir las métricas técnicas que se correlacionan con esas, y al mismo tiempo diseñar el proceso de remediación. No como proyecto futuro, sino como parte del deployment inicial. Medir sin plan de acción es generar datos que no sirven.

Fuentes

- El Destape – PyMEs argentinas y la brecha en medición de IA 2026

- Nerds.ai – Evaluación de LLMs: principales benchmarks y cómo entenderlos

- AutomatizaPro – Cómo evaluar el rendimiento de un modelo de lenguaje

- IA360 – Evaluación y métricas de rendimiento en modelos de lenguaje

- CIO España – Tres enfoques para reducir los fallos de los agentes de IA