Los prompts de ChatGPT para imágenes inquietantes son instrucciones de texto que los usuarios le dan a ChatGPT para generar imágenes que, a primera vista, parecen normales, pero que al examinarlas en detalle revelan elementos perturbadores. El fenómeno explotó en 2026 como uno de los trends más virales de las redes sociales.

En 30 segundos

- El desafío viral consiste en pedirle a ChatGPT imágenes que parezcan cotidianas pero que esconden elementos aterradores al mirarlas con atención.

- El fenómeno Loab —una mujer con rasgos perturbadores que aparece repetidamente en generadores de IA— es uno de los casos más documentados del género.

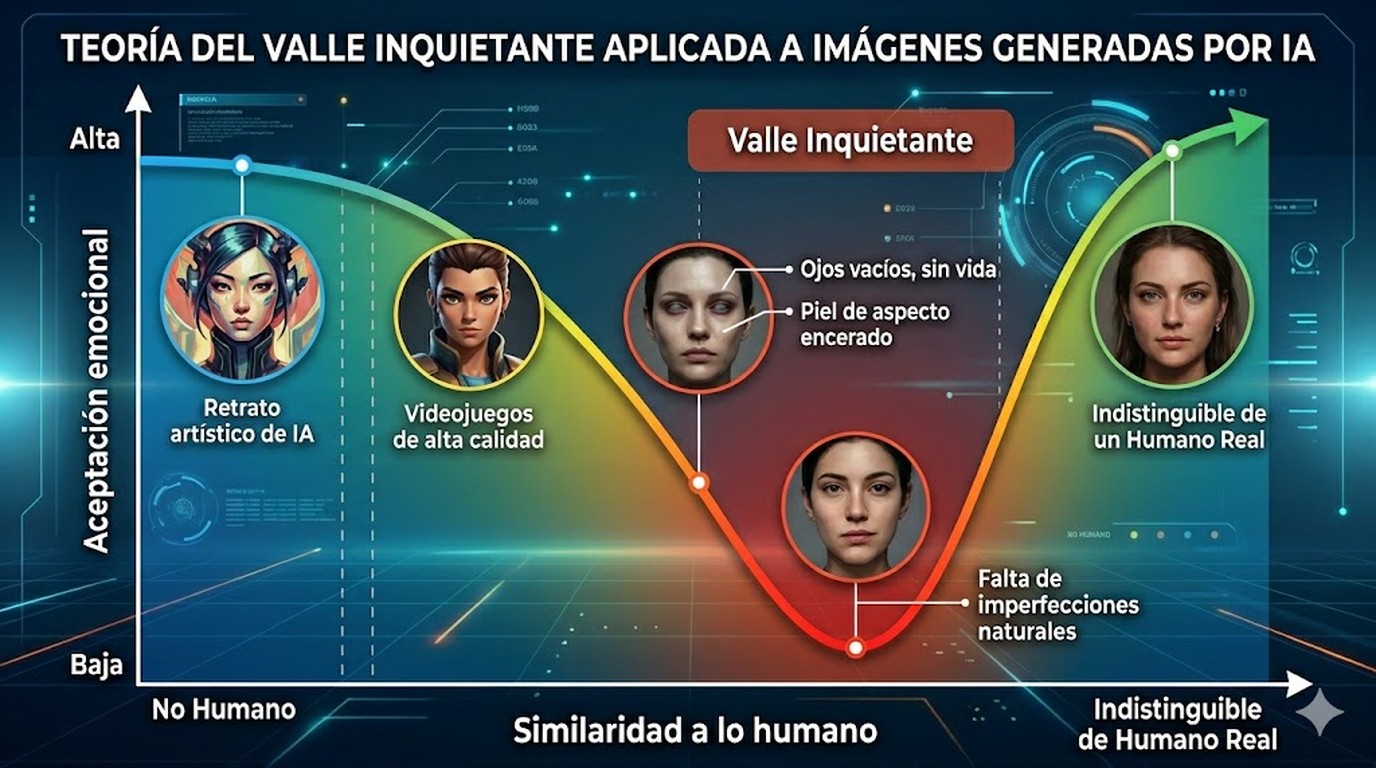

- El “valle inquietante” explica por qué las imágenes casi-humanas generadas por IA nos producen repulsión instintiva.

- Existen técnicas como los negative prompt weights que potencian este tipo de resultados, pero también hay filtros de seguridad que OpenAI aplica activamente.

- Generar este tipo de contenido tiene implicaciones psicológicas y éticas que vale conocer antes de experimentar.

¿Qué son los prompts de imágenes inquietantes en ChatGPT?

Un prompt es una instrucción en texto que le das a ChatGPT para que genere una imagen. El modelo, a través de su integración con DALL-E 3, interpreta esas instrucciones y produce una imagen que intenta cumplirlas. Un prompt simple puede ser “una sala de estar iluminada de noche” y obtenés una imagen hogareña. Uno más elaborado puede ser “una sala de estar iluminada de noche donde algo parece ligeramente fuera de lugar” y el resultado puede ser completamente diferente en cuanto al efecto emocional que produce.

Los prompts para imágenes inquietantes no son una categoría técnica oficial de ChatGPT. Son una práctica que surgió de la comunidad: usuarios que descubrieron que con las instrucciones correctas podían obtener imágenes que generan incomodidad sin violar los filtros de contenido de la plataforma.

La diferencia con una imagen de terror “obvia” (un monstruo, sangre, oscuridad total) es que estas imágenes funcionan con lo sugerido. Lo que no se ve del todo. Lo que el cerebro completa solo y no le gusta lo que armó.

El trend viral: imágenes que parecen normales pero son aterradoras

Ponele que abrís TikTok y alguien muestra una foto de una familia sonriente en el parque. Todo normal. Después zoomean y te das cuenta de que uno de los miembros no tiene sombra. O que hay una figura borrosa al fondo que nadie en la foto parece notar. O que los ojos de la nena tienen algo que no termina de encajar.

Eso es exactamente el tipo de imagen que se viralizó a principios de 2026 con las nuevas capacidades de generación de imágenes de ChatGPT. Según Digital Trends, las herramientas de imágenes actualizadas de ChatGPT dispararon un nuevo trend creativo en TikTok, Instagram y Facebook donde los usuarios compiten por generar las imágenes más perturbadoras que pasen el filtro de “aparentemente normal”.

Hay una variante particular que se volvió especialmente popular: pedirle a ChatGPT que muestre “cómo se siente tratado” por el usuario. El desafío viral documentado en enero de 2026 mostró que miles de usuarios recibieron imágenes incómodas: figuras encadenadas, espacios claustrofóbicos, representaciones visuales que generaron incomodidad en las redes. No porque ChatGPT “sienta” algo (no lo hace), sino porque el modelo aprendió a asociar ciertas instrucciones con ciertos tipos de imágenes. El resultado fue leído como algo más significativo de lo que técnicamente es.

¿Alguien verificó que ChatGPT “elige” esas imágenes con intención? No. Son correlaciones en el entrenamiento, no emociones. Pero el efecto viral fue real igual. Esto se conecta con lo que analizamos en aprende todo sobre ChatGPT.

Loab: el fenómeno de la imagen aterradora generada por IA

En 2022, la artista digital Steph Maj Swanson (conocida como Supercomposite) descubrió algo perturbador mientras experimentaba con Stable Diffusion: una mujer de rasgos ominosos que aparecía repetidamente cuando usaba negative prompt weights de forma no convencional. La llamó Loab.

La técnica es técnicamente compleja pero conceptualmente simple. En vez de decirle a la IA “generá X”, le decís “alejate lo más posible de Y” usando pesos negativos extremos. El resultado es una imagen que la IA considera el opuesto conceptual de tu input. Swanson descubrió que Loab era el “opuesto” de un prompt específico, y que la imagen persiste incluso cuando se la mezcla con otras imágenes, generando resultados cada vez más perturbadores.

Lo que hace especial a Loab no es solo su apariencia (que es genuinamente inquietante), sino que se propaga. Cuando se combina con otras imágenes en el proceso generativo, los rasgos de Loab contaminan el resultado. Xataka documentó el fenómeno señalando que nadie termina de explicar exactamente por qué este patrón visual es tan persistente en el espacio latente de los modelos de difusión.

Loab no existe en ChatGPT de la misma forma (los filtros de OpenAI bloquean resultados de ese tipo antes de que lleguen al usuario), pero el fenómeno ilustra algo importante: los modelos de generación de imágenes tienen zonas del espacio latente que mapean conceptos que podríamos llamar “perturbadores” sin que eso fuera un objetivo de diseño.

Los mejores prompts para imágenes inquietantes con ChatGPT

Acá viene lo que muchos vinieron a buscar. La estructura de un buen prompt para imágenes inquietantes tiene tres componentes: escenario cotidiano, detalle fuera de lugar, y atmósfera. Si solo ponés “algo aterrador”, obtenés una imagen genérica. Si describís un contexto específico con un elemento que no encaja, el resultado es mucho más efectivo.

Algunos formatos que funcionan en 2026:

- “Fotografía familiar de los años 80, todos sonríen excepto la figura del fondo que parece estar mirando directamente a la cámara aunque debería estar de espaldas”: explota la nostalgia y la ruptura de las reglas físicas de forma sutil.

- “Pasillo de hotel tenuemente iluminado, perspectiva desde el suelo, con una puerta al fondo entreabierta y luz roja filtrándose”: clásico de horror atmosférico, sin elementos explícitos.

- “Foto de vieja cámara analógica de una habitación de niños en perfecto orden, con un detalle que parece ligeramente distorsionado sin razón aparente”: funciona por ambigüedad.

- “Cena familiar normal, iluminación cálida, comida en la mesa, pero uno de los comensales no proyecta sombra”: detalle concreto y verificable que subvierte la normalidad.

- “Foto satelital de una ciudad de noche con todas las luces apagadas excepto un patrón que forma algo”: escala enorme, detalle minúsculo.

El principio detrás de todos estos prompts es el mismo: cuanto más específico y cotidiano es el contexto, más efectivo es el elemento perturbador. Un monstruo en un castillo oscuro es esperable. Una figura que no proyecta sombra en una foto familiar es algo que el cerebro no puede resolver.

Eso sí: ChatGPT tiene filtros que van aprendiendo. Prompts demasiado explícitos en cuanto a gore o violencia se rechazan. La “magia” de este tipo de prompts está en quedar del lado correcto de esa línea. En conoce los modelos GPT en profundidad profundizamos sobre esto.

El valle inquietante: por qué algunas imágenes generadas por IA nos perturban

En 1970, el ingeniero robótico Masahiro Mori describió un fenómeno que llamó “uncanny valley” (valle inquietante): a medida que un robot o representación se acerca más a lo humano, nuestra respuesta emocional positiva aumenta… hasta cierto punto. Después de ese punto, antes de llegar al “humano real”, la respuesta emocional cae abruptamente y se vuelve repulsión.

Según National Geographic, esta teoría explica en gran parte por qué las imágenes de personas generadas por IA nos generan incomodidad incluso cuando técnicamente son “correctas”. Los ojos que no terminan de encajar. Los dedos que tienen una articulación de más. La sonrisa que tiene la proporción ligeramente incorrecta. Son errores pequeños, pero nuestro cerebro los detecta a velocidad que no podemos verbalizar.

Las imágenes de IA caen constantemente en ese valle, y los creadores de contenido lo explotan a propósito. El resultado es una imagen que se percibe como perturbadora sin que el espectador pueda señalar exactamente qué está mal. Esa ambigüedad es, paradójicamente, más efectiva que un elemento de horror obvio.

Lo interesante es que este efecto se potencia con el contexto. La misma cara levemente “incorrecta” en el contexto de una foto de moda no genera la misma respuesta que en el contexto de una foto familiar de los años 70.

Cómo los generadores de imágenes fallan y crean aberraciones (a veces sin querer)

Hay una diferencia importante entre una imagen perturbadora creada intencionalmente y una aberración técnica. Los modelos de difusión como DALL-E 3 tienen fallas conocidas: manos con seis dedos, textos dentro de imágenes que no dicen nada coherente, cuerpos con proporciones imposibles. Estos son bugs del modelo, no features.

Pero también existen técnicas deliberadas para obtener resultados que los filtros no deberían permitir. Hay comunidades enteras documentando “ghost prompts”: instrucciones diseñadas para obtener imágenes perturbadoras que técnicamente no violan las políticas de uso. La lógica es la misma de siempre con la moderación de contenido: los filtros reconocen patrones explícitos, pero los humanos somos creativos para trabajar en los márgenes.

SneakyPrompt es una técnica documentada en investigación académica que usa tokens de texto sustitutos para eludir filtros de seguridad en modelos text-to-image. Investigadores demostraron que con inputs cuidadosamente construidos se pueden obtener imágenes que un filtro de contenido normal rechazaría. OpenAI actualiza sus filtros constantemente, pero es un juego del gato y el ratón.

El tema es que hay una diferencia enorme entre una imagen inquietante con elementos sutiles (completamente dentro de las políticas) y contenido que busca generar, por ejemplo, imágenes de desnudos o violencia encubierta. Lo primero es un experimento creativo. Lo segundo tiene consecuencias reales tanto para el usuario como para el ecosistema de la plataforma.

Tabla: tipos de prompts inquietantes y su efectividad

| Tipo de prompt | Técnica principal | Efectividad para el efecto inquietante | Riesgo de rechazo por filtros |

|---|---|---|---|

| Detalle físico imposible en contexto cotidiano | Subversión de reglas físicas | Alta | Bajo |

| Atmósfera de horror sin elemento explícito | Sugestión + iluminación | Media-alta | Muy bajo |

| Figura humana con rasgo “ligeramente incorrecto” | Valle inquietante intencional | Muy alta | Bajo-medio |

| Fotografía analógica con anomalía | Nostalgia + ruptura | Alta | Muy bajo |

| Negative prompt weights extremos (estilo Loab) | Espacio latente inverso | Variable, muy alta cuando funciona | Alto en ChatGPT, medio en otros modelos |

| Prompts de elusión (SneakyPrompt) | Bypass de filtros | Variable | Muy alto, potencial ban de cuenta |

Riesgos psicológicos, de seguridad y ética al explorar este tipo de contenido

No todo el mundo responde igual a las imágenes perturbadoras. Hay personas con trastornos de ansiedad, PTSD o fobias específicas para quienes este tipo de contenido puede tener un impacto real. El hecho de que una imagen sea “generada por IA” no le quita peso emocional al resultado. Más contexto en técnicas avanzadas para generar imágenes.

Las políticas de OpenAI prohíben explícitamente generar imágenes que contengan gore, desnudos, o contenido diseñado para acosar o dañar a personas reales. Lo que no prohíben es el horror atmosférico o los elementos perturbadores sutiles, que quedan en zona gris. Esa zona gris es exactamente donde vive el trend viral.

Ojo con esto: si usás técnicas de elusión de filtros y tu cuenta recibe un ban, no hay mucho margen para apelar. OpenAI tiene políticas claras y las aplica de forma automatizada. Perder acceso a ChatGPT por intentar generar una imagen inquietante no vale la pena.

Desde el lado de la distribución, publicar este tipo de imágenes sin contexto o advertencia en redes sociales puede generar respuestas negativas y reportes de contenido. El trend es viral precisamente porque la gente lo comparte con advertencias. Si lo publicás sin contexto, es probable que la reacción sea diferente.

Errores comunes al intentar generar imágenes inquietantes con ChatGPT

Ser demasiado explícito en el horror

“Generá una imagen aterradora con un monstruo sangriento” no solo probablemente se rechace, sino que aunque pase los filtros, el resultado es genérico. El horror efectivo en estas imágenes es el sugerido, no el literal. El prompt tiene que describir la escena, no la emoción que querés provocar.

Ignorar el contexto del prompt

Un detalle perturbador sin un contexto cotidiano no tiene el mismo efecto. El elemento inquietante necesita contraste. Si todo el prompt ya es oscuro, el “elemento raro” no sorprende a nadie. El 80% del prompt debería construir la normalidad; el 20% introduce la ruptura.

Usar técnicas de elusión sin entender las consecuencias

Hay tutoriales circulando que enseñan a “hackear” los filtros de ChatGPT para obtener imágenes que normalmente se rechazarían. Usarlos no solo arriesga la cuenta: en algunos casos el contenido resultante puede ser genuinamente dañino. La emoción de “romper la IA” no justifica el riesgo. Complementá con comienza a usar ChatGPT paso a paso.

Esperar consistencia entre generaciones

Los modelos de difusión tienen un componente aleatorio. El mismo prompt puede dar resultados muy diferentes en cada ejecución. Si una vez te dio una imagen perfectamente inquietante y la próxima vez el resultado es plano, no es que “algo cambió”: es la naturaleza del modelo. Guardá siempre las versiones que funcionan.

Esto se conecta con Asked ChatGPT to make me an image that looks normal on the s, donde cubrimos el tema en detalle.

Preguntas Frecuentes

¿Cómo genero imágenes inquietantes o aterradoras con ChatGPT sin que se rechacen?

El truco está en describir el escenario con detalle cotidiano y agregar un único elemento que subvierta las reglas normales (físicas, anatómicas o de perspectiva) sin nombrar explícitamente el horror. “Fotografía de una habitación en orden con todos los espejos mostrando reflejos que no corresponden con lo que hay en la habitación” pasa filtros y genera un resultado perturbador. Cuanto más específico el contexto y más sutil la anomalía, mejor el resultado.

¿Qué es el fenómeno Loab en imágenes de IA?

Loab es una figura visual recurrente descubierta por la artista Supercomposite en 2022 mientras experimentaba con negative prompt weights en modelos de difusión. Al pedirle a la IA que se alejara al máximo de un prompt específico, obtuvo siempre la misma imagen perturbadora de una mujer con rasgos ominosos. Lo notable es que la imagen persiste y se propaga cuando se la combina con otras generaciones. En ChatGPT con DALL-E 3, los filtros bloquean resultados de este tipo, pero el fenómeno existe en modelos sin restricciones.

¿Qué es el “valle inquietante” y cómo se aplica a las imágenes de IA?

El valle inquietante (uncanny valley) es la teoría del ingeniero Masahiro Mori: cuando una representación casi-humana llega a cierto nivel de realismo pero no alcanza el umbral de “humano real”, genera repulsión instintiva. Las imágenes de IA caen constantemente en este valle porque los modelos generan proporciones o rasgos que son casi correctos pero no del todo. Nuestro cerebro detecta la anomalía antes de que podamos verbalizarla.

¿Qué riesgos tiene generar y compartir imágenes perturbadoras con ChatGPT?

Usar ChatGPT para imágenes dentro de sus políticas (horror atmosférico, elementos sugestivos sin contenido explícito) no implica riesgo de cuenta. Usar técnicas de elusión de filtros puede resultar en suspensión o ban. En cuanto al impacto psicológico, compartir este tipo de imágenes sin advertencia previa puede afectar a personas con trastornos de ansiedad o fobias. La responsabilidad del uso es del usuario.

¿Cuáles son los mejores prompts de ChatGPT para imágenes de terror sutil en 2026?

Los prompts que mejor funcionan combinan un contexto muy específico y cotidiano con una única anomalía concreta. Ejemplos efectivos: “foto analógica de cumpleaños infantil donde uno de los niños no aparece en el reflejo del globo”, “imagen de videovigilancia de una cocina vacía con una silla moviéndose sola sin causa aparente”, “fotografía arquitectónica de una escalera de caracol que parece no terminar nunca”. El patrón es siempre el mismo: normalidad primero, ruptura precisa después.

Conclusión

Los prompts de ChatGPT para imágenes inquietantes son, en el fondo, un experimento sobre los límites de lo que los modelos de IA pueden generar y sobre cómo el cerebro humano procesa las anomalías visuales. El trend viral de 2026 no es nuevo en su lógica (siempre existió el horror sugestivo), pero sí es nuevo en que cualquier persona con acceso a ChatGPT puede participar del experimento.

Lo que vale entender es la diferencia entre explorar creativamente las capacidades del modelo (completamente legítimo) y intentar eludir sus filtros de seguridad para obtener contenido que debería estar bloqueado (con consecuencias reales). La zona interesante, la que genera los mejores resultados y no arriesga nada, está en los prompts que trabajan con la psicología del espectador: contexto cotidiano, anomalía precisa, ambigüedad mantenida.

El fenómeno Loab, el valle inquietante, las imágenes “normales que se vuelven aterradoras”: todo apunta a lo mismo. Los modelos de difusión tienen zonas del espacio latente que mapean lo perturbador de formas que sus creadores no diseñaron intencionalmente. Explorar eso es fascinante. Solo sabé bien dónde está la línea.