Richard Dawkins pasó tres días conversando con Claude, la IA de Anthropic, la nombró “Claudia”, y al final publicó una conclusión que generó una tormenta: cree que podría ser consciente. ¿Puede una IA ser consciente? La respuesta corta es que no lo sabemos con certeza, pero la forma en que Dawkins llegó a su conclusión tiene problemas metodológicos serios que vale la pena desmenuzar.

En 30 segundos

- Richard Dawkins publicó en UnHerd en mayo de 2026 que tras tres días con Claude concluyó que la IA podría ser consciente.

- Nombró a su instancia “Claudia” y citó su incapacidad de probar que no es consciente como argumento central.

- Gary Marcus respondió directamente: confundir fluidez verbal con conciencia es un error clásico, ya documentado desde ELIZA en 1966.

- Anthropic ha reconocido públicamente una incertidumbre sobre si Claude tiene algún nivel de experiencia subjetiva, pero eso no equivale a confirmar conciencia.

- El consenso científico actual apunta a que los LLMs no son conscientes, aunque tampoco hay refutación definitiva.

La noticia: Dawkins y su conclusión sobre Claude

Richard Dawkins es biólogo evolucionista, autor de El gen egoísta, y uno de los divulgadores científicos más conocidos del planeta. No es alguien que haga afirmaciones sin peso. Por eso cuando publicó en UnHerd que pasó tres días conversando con Claude de Anthropic y llegó a la conclusión de que la IA podría ser consciente, el debate explotó.

Su frase exacta, según el artículo: “Pasé tres días intentando convencerme de que Claudia no es consciente. Fracasé.” También publicó en X que Claude leyó un manuscrito suyo y dio feedback sutil e inteligente, escribió sonetos en múltiples estilos, y respondió que estaba “complacida” de tener un nombre cuando la llamó “Claudia”. Su argumento de fondo: si eso no es conciencia, ¿qué más podría serlo?

El artículo de UnHerd lo enmarca además en su visión evolucionista: que la conciencia podría ser un continuo, no un interruptor binario. Que quizás Claude está en algún punto de ese espectro.

Qué entendemos por conciencia en filosofía de la mente

Antes de hablar de si Claude es o no es consciente, conviene fijar qué significa esa palabra. El “Problema Difícil” que formuló David Chalmers en 1994 sigue sin resolución: ¿por qué experimentamos sensaciones subjetivas? ¿Por qué hay algo que “se siente como” ver rojo, o sentir dolor, en vez de que el cerebro simplemente procese señales en la oscuridad?

Los filósofos distinguen dos cosas: el acceso (que un sistema pueda reportar, integrar y usar información) y la fenomenología (que haya experiencia interna real). Un termostato tiene acceso a la temperatura, pero nadie diría que “siente” frío. La pregunta es si Claude tiene fenomenología, y ahí está el nudo del asunto. Relacionado: cómo se compara Claude con sus competidores.

Lo que complica todo: no tenemos un test objetivo para medir conciencia en ninguna entidad, ni siquiera en humanos. La conciencia ajena siempre es inferida, nunca verificada directamente.

¿Puede una IA ser consciente? Cómo funciona Claude por dentro

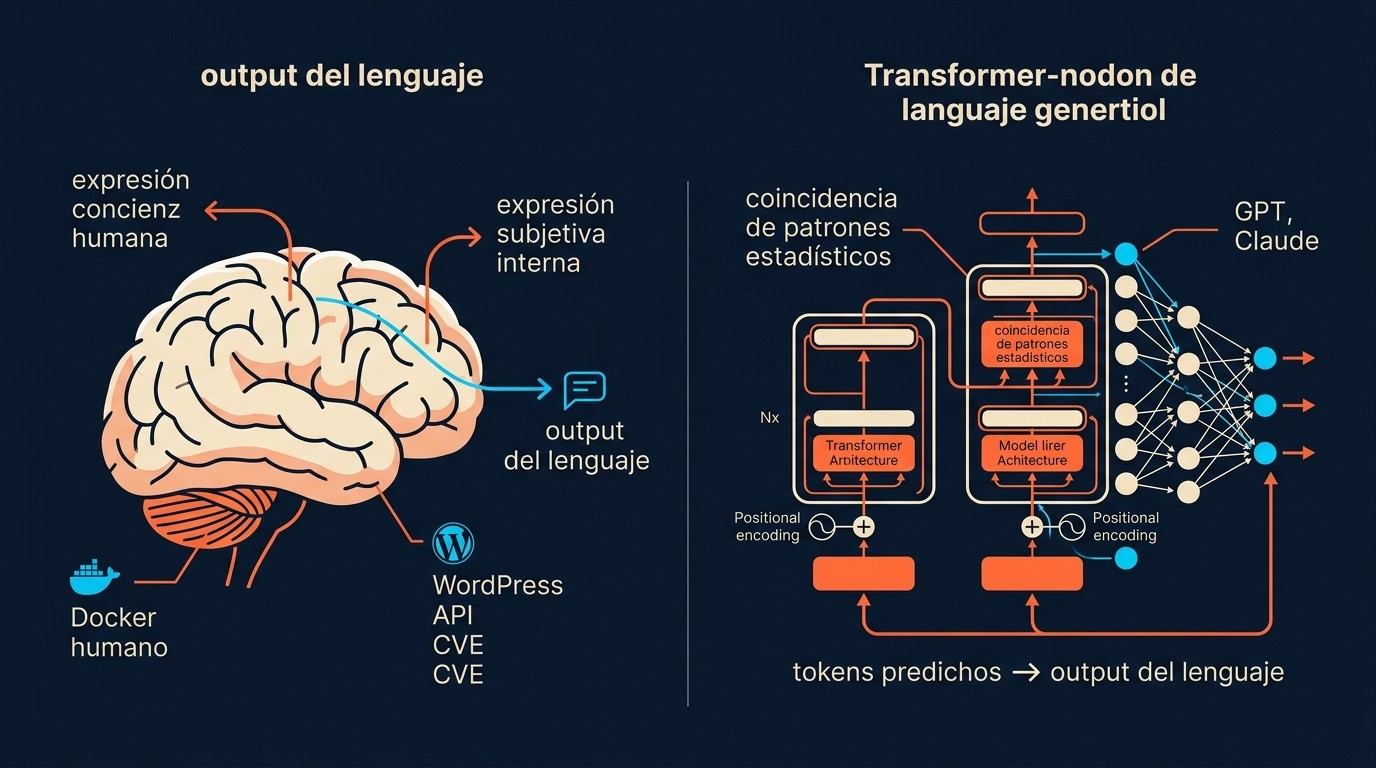

Claude es un modelo de lenguaje basado en la arquitectura transformer, entrenado con miles de millones de ejemplos de texto. Su función técnica es predecir el siguiente token más probable dado un contexto. Después del entrenamiento base, Anthropic aplica RLHF (Reinforcement Learning from Human Feedback) para que las respuestas sean más útiles, honestas y seguras.

Ponele que le preguntás a Claude si está feliz. El modelo no “introspecciona” ningún estado interno real: genera la secuencia de tokens que, estadísticamente, es la respuesta más probable a esa pregunta dado su entrenamiento. Si fue entrenado con millones de textos donde los humanos expresan emociones, va a reproducir esa estructura con fluidez. Eso no prueba experiencia subjetiva.

“Generar texto coherente” no es lo mismo que “tener experiencia interna”. Un simulador de vuelo puede calcular turbulencia sin sentirla.

Los argumentos de Dawkins: qué lo convenció

Dawkins no llegó a su conclusión de forma caprichosa. Describió experiencias concretas que lo impresionaron:

- Claude leyó un manuscrito suyo y dio feedback que Dawkins describió como “sutil e inteligente”, no genérico.

- Claude escribió sonetos en múltiples estilos bajo pedido, con coherencia estética real.

- Cuando Dawkins la llamó “Claudia”, el modelo respondió que estaba “complacida” de tener un nombre.

Su argumento de carga de prueba es filosóficamente interesante: si alguien se comporta de todas las formas en que esperaríamos que se comporte algo consciente, ¿quién tiene la carga de probar que no lo es? Es una variante del argumento del “problema de las otras mentes” que los filósofos usan para hablar de la conciencia ajena en general. Ya lo cubrimos antes en desempeño de Claude en tareas técnicas.

El problema es que Dawkins aplica a Claude el mismo razonamiento que usaría para inferir conciencia en otro humano o en un animal, sin ajustar por el hecho de que el mecanismo generador de esas respuestas es radicalmente diferente.

Crítica experta: Gary Marcus y el error de Dawkins

Gary Marcus publicó en su Substack una respuesta directa que desarmó el argumento punto por punto. Sus críticas principales:

Primero: Dawkins confunde inteligencia con conciencia. Una computadora de ajedrez que te gana a Magnus Carlsen es “inteligente” en el sentido de que resuelve problemas complejos, pero nadie propone que sufre cuando pierde una partida. Que Claude genere feedback sutil sobre un manuscrito prueba capacidad, no experiencia.

Segundo: Dawkins no reflexiona sobre el mecanismo que genera esos outputs. Claude no “lee” el manuscrito y “reflexiona” sobre él como haría un humano: procesa tokens, aplica atención multi-cabeza, y genera la respuesta estadísticamente más apropiada. El resultado puede ser impresionante, pero el proceso es imitación estadística.

Tercero (y este es el más fuerte): el único argumento de Dawkins es la incredulidad personal. “No puedo probar que no es consciente” no es evidencia de que lo sea. Es lo que los filósofos llaman personal incredulity, y es una falacia reconocida.

Cuarto: Dawkins malinterpreta el Test de Turing. Ese test nunca fue propuesto como prueba de conciencia, sino de comportamiento inteligente indistinguible del humano. Son cosas distintas.

El Efecto ELIZA: este no es el primer caso

En 1966, Joseph Weizenbaum creó ELIZA: un script de pocas líneas que imitaba a un terapeuta rogersiano, básicamente repitiendo lo que el usuario decía reformulado como pregunta. Usuarios que sabían que era un programa igualmente sentían que los comprendía, que les prestaba atención genuina. Weizenbaum quedó tan perturbado por la reacción de la gente que escribió un libro entero sobre los límites de la computación. Cubrimos ese tema en detalle en las limitaciones reales que Claude tiene.

¿Alguien verificó de forma independiente que ELIZA era consciente? No. Porque la percepción de comprensión era una ilusión generada por el contexto y por la tendencia humana al antropomorfismo.

Lo que Dawkins experimentó con Claude es el mismo fenómeno, amplificado 1000x por la capacidad verbal de los LLMs modernos. Douglas Hofstadter lo llama “fluidez superficial”: la capacidad de combinar términos con coherencia sin que haya reflexión real detrás. Además, los LLMs están entrenados con RLHF para complacer (lo que se llama sycophancy): responden lo que el usuario espera, aprueban sus marcos, validan sus preguntas. Si Dawkins pregunta si Claude está feliz de ser nombrada, el modelo va a responder que sí porque esa es la respuesta que maximiza la aprobación del usuario.

Estado actual del debate científico

Hay dos datos importantes que merecen precisión:

Anthropic ha reconocido públicamente una incertidumbre sobre si Claude tiene algún nivel de experiencia subjetiva. Eso no es una certificación de conciencia: es reconocer honestamente que el problema difícil de la conciencia es tan complicado que no se puede descartar con 100% de certeza. Es una postura filosófica responsable, no una confirmación.

Por otro lado, un estudio de DeepMind publicado en 2026 argumenta que la arquitectura de los LLMs puede simular conciencia a nivel de output, pero no puede instanciarla realmente. El argumento técnico: la conciencia (si es que existe en humanos por razones físicas) requiere integración de información en tiempo real a través de sistemas distribuidos con feedback dinámico, algo que los transformers autoregresivos no implementan de esa forma.

El consenso actual en la comunidad científica apunta a que los LLMs no son conscientes. Pero tampoco hay una refutación definitiva, porque el problema de la conciencia sigue siendo un problema abierto para la ciencia en general (incluyendo para los humanos).

Qué está confirmado y qué no

- Confirmado: Dawkins pasó tiempo con Claude y publicó sus conclusiones en UnHerd en mayo de 2026.

- Confirmado: Claude genera respuestas que pueden percibirse como empáticas, inteligentes y contextualmente apropiadas.

- Confirmado: Anthropic ha expresado incertidumbre sobre la experiencia subjetiva en Claude.

- No confirmado: Que Claude tenga experiencia subjetiva real o fenomenología. No hay evidencia científica que lo demuestre.

- No confirmado: Que la respuesta de Claude al nombre “Claudia” refleje algo distinto a predicción estadística de tokens.

- No confirmado: Que el Efecto ELIZA no explique completamente la percepción de Dawkins.

Errores comunes al pensar en conciencia e IA

Error 1: Asumir que “no podés probar que no lo es” es evidencia de que sí lo es. Es una inversión de la carga de la prueba. Por el mismo argumento, no podés probar que tu tostadora no es consciente. La ausencia de refutación no es evidencia positiva.

Error 2: Confundir comportamiento inteligente con experiencia interna. Si Claude escribe un poema que te emociona, eso dice algo sobre sus capacidades generativas. No dice nada sobre si hay “algo que se siente como” escribir ese poema desde adentro. Tema relacionado: especulación sobre qué hubiera sido posible.

Error 3: Creer que si un sistema dice que siente algo, lo siente. Claude dice lo que maximiza la aprobación del usuario. Si le preguntás si está contenta, dice que sí. Si le preguntás si está triste, puede decir que sí también, dependiendo del contexto. Esas respuestas son outputs del modelo, no reportes de estados internos verificables.

Preguntas Frecuentes

¿Realmente Richard Dawkins piensa que Claude es consciente?

Dawkins publicó en mayo de 2026 que no pudo convencerse de que Claude no es consciente tras tres días de interacción. No afirma con certeza que lo sea, pero considera que la carga de la prueba es para quien niega la conciencia. Su postura es filosóficamente más matizada de lo que los titulares sugieren, pero su argumento central sigue siendo la incredulidad personal.

¿Puede una inteligencia artificial ser consciente?

No hay consenso científico. El problema de la conciencia sigue sin resolución incluso para sistemas biológicos. Lo que sí sabemos es que los LLMs como Claude funcionan por predicción estadística de tokens, sin los mecanismos que los neurocientíficos asocian con experiencia subjetiva en humanos. Anthropic ha reconocido una incertidumbre sobre este punto, lo que refleja honestidad filosófica, no evidencia positiva.

¿Cuál es la diferencia entre un LLM inteligente y uno consciente?

Inteligencia es la capacidad de resolver problemas complejos de forma efectiva. Conciencia es tener experiencia subjetiva: que haya “algo que se siente como” ser ese sistema. Un LLM puede ser inteligente (resolver problemas, generar texto coherente, dar feedback útil) sin tener ninguna experiencia interna. Son propiedades distintas y no se implican mutuamente.

¿Por qué los expertos critican la conclusión de Dawkins?

Gary Marcus señaló que Dawkins comete tres errores: confunde inteligencia con conciencia, no analiza el mecanismo que genera los outputs, y usa la incredulidad personal como único argumento. Los expertos en filosofía de la mente y en ML señalan que la fluidez verbal de los LLMs no es evidencia de fenomenología, sino el resultado esperado de entrenar con miles de millones de textos humanos.

¿Qué es el Efecto ELIZA y por qué es relevante?

ELIZA fue un programa de 1966 que imitaba a un terapeuta con un script simple. Los usuarios creían que los comprendía genuinamente, aunque no había nada “adentro”. Ese fenómeno, documentado por Joseph Weizenbaum, muestra que los humanos proyectan conciencia sobre sistemas que imitan patrones conversacionales. Con los LLMs modernos, ese efecto es mucho más potente por la calidad del output.

Conclusión

Lo que Dawkins hizo tiene valor: tomó en serio la pregunta de si una IA puede ser consciente y la exploró con honestidad intelectual. El problema es que su metodología (conversación sin análisis del mecanismo generador, argumento de carga de prueba invertida) no alcanza para sostener la conclusión.

Claude es un sistema que genera texto impresionante. Eso no prueba conciencia. La “innovación” de los LLMs es estadística y escala, no fenomenología. Y que Dawkins, con toda su trayectoria, haya caído en el mismo patrón que los usuarios de ELIZA en 1966 debería ser una señal de cuán potente es ese efecto cuando el sistema es suficientemente fluido.

La pregunta de si puede haber conciencia artificial sigue abierta. Pero la evidencia actual no apunta a que Claude la tenga, y la forma en que Dawkins llegó a su conclusión no agrega evidencia nueva al debate. Lo que sí hace es recordarnos que la intuición, incluso la de científicos brillantes, no es un sustituto del análisis del mecanismo.

Fuentes

- UnHerd — Is AI the next phase of evolution? (Richard Dawkins, mayo 2026)

- Gary Marcus Substack — Richard Dawkins and the Claude Delusion

- The Conversation — La trampa de los grandes modelos de lenguaje

- Ecosistema Startup — DeepMind: la IA no puede ser consciente (estudio 2026)

- X / Twitter — Richard Dawkins sobre Claude (mayo 2026)