ChatGPT no restaura imágenes en el sentido técnico de la palabra. Lo que hace es regenerarlas: analiza lo que ve, interpreta el deterioro, y crea una versión nueva que parece reparada. La diferencia no es semántica, es crítica cuando la foto tiene personas reales. Eso explica por qué alguien puede pedirle que “restaure” la imagen de una novia inexistente y ChatGPT entrega algo verosímil sin chistar.

En 30 segundos

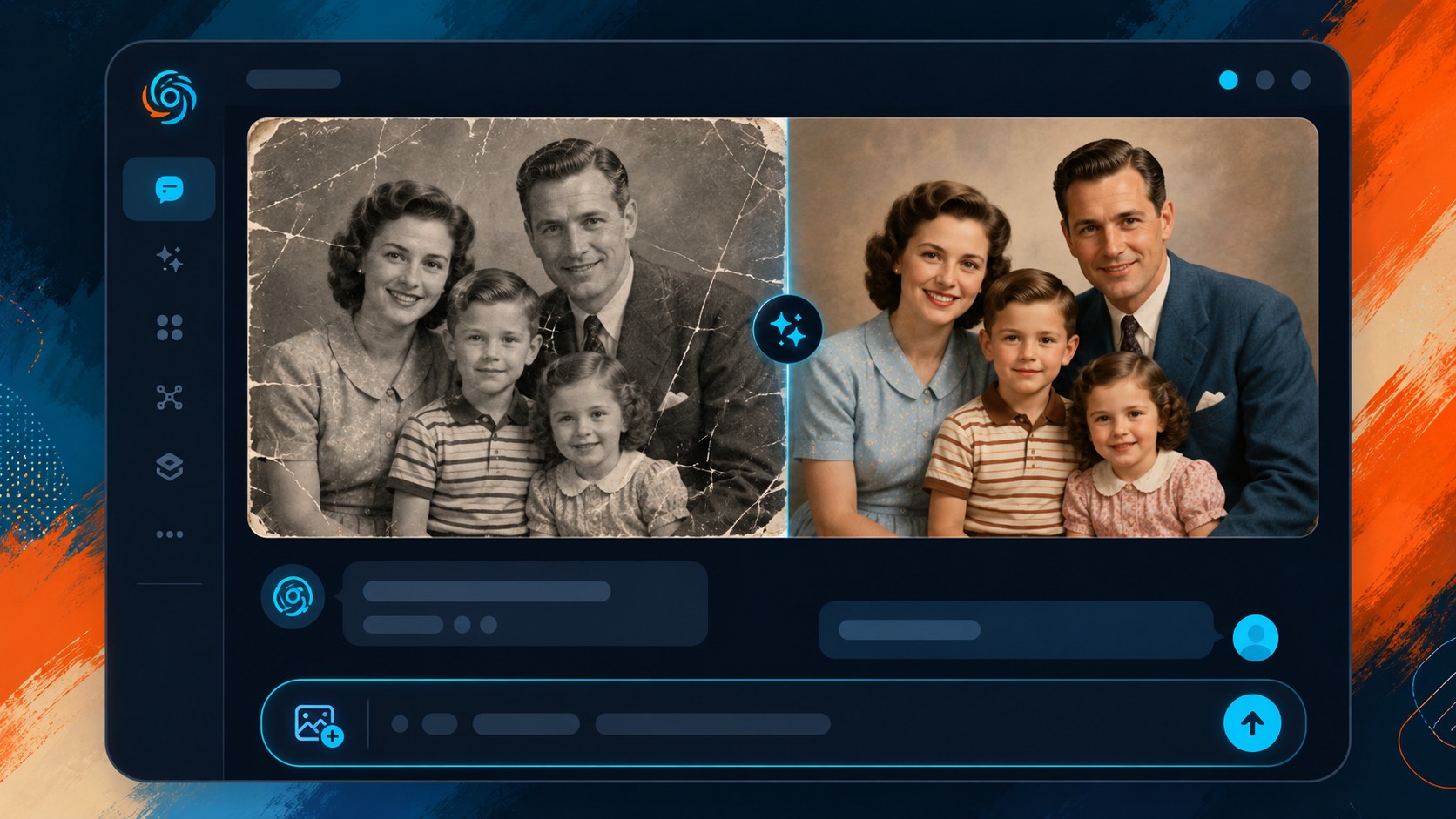

- ChatGPT con GPT-4o puede recibir fotos deterioradas y generar versiones “restauradas”, pero no repara píxeles dañados: crea nuevos.

- Los rostros son el punto débil: OpenAI aplica filtros anti-deepfake que alteran expresiones, proporciones y texturas faciales.

- Para obtener buenos resultados necesitás escanear a mínimo 600 DPI y escribir un prompt descriptivo del estado original de la foto.

- Funciona muy bien con fondos, texturas, arañazos y decoloración. Con caras de personas reales, los resultados son siempre aproximados.

- Para restauraciones que requieren fidelidad facial exacta, herramientas especializadas como Lightroom o Photoshop Neural Filters siguen siendo más precisas.

Qué es realmente restaurar imágenes con ChatGPT

Restaurar imágenes con ChatGPT es, técnicamente, una ilusión muy conveniente. ChatGPT no tiene acceso a los píxeles originales de una foto dañada ni puede “recuperar” información que ya no existe en el archivo. Lo que hace GPT-4o con visión es analizar la imagen como contexto visual y generar una nueva versión mediante su modelo de imágenes integrado (según la documentación oficial de OpenAI), que desde enero de 2026 se llama internamente Images 2.0.

La diferencia práctica es enorme. Photoshop con Neural Filters o Lightroom con Denoise trabajan sobre los datos reales del archivo: reconstruyen zonas dañadas usando los píxeles circundantes como referencia. ChatGPT, en cambio, hace una interpretación. Ve una foto en blanco y negro con arañazos, infiere que era una escena exterior de los años 60, y genera algo que se parece a eso. El resultado puede ser impresionante. Pero no es la foto original.

Eso explica el experimento viral que dio origen a este artículo: alguien le pidió a ChatGPT que restaurara la imagen de una novia que no existía. Y ChatGPT entregó un resultado perfectamente coherente. No porque “adivinó”, sino porque genera, no recupera.

Qué necesitás para empezar

Necesitás acceso a ChatGPT con GPT-4o. El plan gratuito tiene generación de imágenes limitada a partir de enero de 2026; para uso intensivo conviene el plan Plus (USD 20/mes), que da más créditos de generación por día.

Antes de subir la foto, digitalizarla bien hace toda la diferencia. El mínimo útil es 600 DPI para fotos de 10×15 cm. Con 300 DPI obtenés resultados mediocres porque ChatGPT tiene menos detalle para trabajar. Los formatos que acepta son JPG, PNG y WebP. Los archivos TIFF de alta resolución tenés que convertirlos antes.

Una advertencia que suele saltarse: si la foto tiene mucho ruido digital o está muy comprimida (típico de capturas de fotos), el modelo va a rellenar los huecos con su propia interpretación. Cuanto más deteriorado el original, más “inventado” el resultado.

Proceso paso a paso

El flujo es simple. Abrís ChatGPT, cargás la imagen con el botón de adjuntar, escribís el prompt, y esperás entre 15 y 40 segundos según la complejidad. Sobre eso hablamos en prompts que funcionan con GPT Image.

Lo que marca la diferencia es el prompt. Describir el estado actual de la foto (“tiene arañazos horizontales en la parte superior, los colores están desteñidos y hay una mancha marrón en el ángulo inferior izquierdo”) ayuda mucho más que escribir “restaura esta foto”. El modelo necesita contexto explícito porque lo que parece obvio para un humano, para el modelo es una interpretación entre varias posibles.

El resultado aparece directamente en el chat como imagen. Podés descargarlo con click derecho o usando el botón de descarga que aparece al pasar el cursor. Si no quedó bien, podés pedir ajustes en el mismo hilo: “la iluminación quedó muy dura, hacela más suave” o “el fondo quedó azul, debería ser verde”.

Prompts que funcionan: ejemplos concretos

Según el relevamiento de TechRadar y pruebas de usuarios hispanohablantes documentadas en fuentes como Infobea, estos son los patrones de prompt que dan mejores resultados:

Para colorizar fotos en blanco y negro

“Coloriza esta foto en blanco y negro. Es una foto de exterior, probablemente tomada en los años 50 o 60 en Argentina. Los colores deben ser naturales y realistas, no saturados.”

El año o época es crucial. Sin ese contexto, el modelo puede aplicar paletas de color de otra era.

Para eliminar arañazos y manchas

“Restaura esta foto. Tiene arañazos verticales en el centro, manchas de humedad en los bordes y el contraste está muy bajo. Mantené la composición y los elementos originales, solo corregí los defectos físicos.”

La instrucción de “mantener la composición original” es importante. Sin ella, el modelo puede reencuadrar o modificar elementos que no querías tocar.

Para mejorar resolución y nitidez

“Aumentá la resolución de esta imagen y mejoré la nitidez, especialmente en los detalles del fondo. La foto tiene ruido digital. Resultado final: nítido, con detalles preservados.” Cubrimos ese tema en detalle en otras herramientas de generación de imágenes.

Para restauración integral

“Restaura esta foto antigua. Está en blanco y negro, tiene arañazos, manchas y los bordes están quemados. Colorizá con tonos naturales de época, eliminá los defectos físicos y mejorá el contraste. No modificar los rostros ni alterar las personas que aparecen.”

Esa última instrucción (“no modificar los rostros”) es la que más gente omite. Y es la que más importa.

La limitación crítica con rostros

Acá viene el problema central. OpenAI tiene políticas activas anti-deepfake que afectan cómo el modelo genera rostros. Cuando le pedís que restaure una cara, el modelo no puede reproducir con exactitud los rasgos faciales de la persona original. Modifica sutilmente proporciones, expresiones y texturas de la piel. A veces el cambio es casi imperceptible. A veces la persona en la foto restaurada no parece la misma.

¿Y por qué alguien pudo “restaurar” la imagen de una novia inexistente y el resultado fue convincente? Porque si no existe referencia de cómo debería verse esa persona, cualquier cara coherente con el contexto de la foto es “correcta”. El modelo no mintió ni alucinó en el sentido técnico. Generó algo plausible, que es exactamente lo que hace siempre.

El problema real aparece cuando la cara sí importa. Una foto de tu abuela de los años 40 puede salir con rasgos que no son los de ella. Puede ser más joven, o mayor, o con una expresión que nunca tuvo. Desde un análisis de AI Vibe Daily, esto no es un bug a corregir sino una consecuencia directa de las restricciones de seguridad que OpenAI aplica a la generación de rostros reales.

Para fotos históricas familiares donde la fidelidad facial importa, este es un límite que no tiene vuelta: el modelo no puede garantizarla.

Qué corrige bien y qué no

| Tipo de defecto | Resultado con ChatGPT | Notas |

|---|---|---|

| Arañazos y rayaduras | Muy bueno | Funciona bien si son superficiales |

| Manchas de polvo y humedad | Bueno | Mejor en fondos que en primer plano |

| Decoloración y desvanecimiento | Bueno | Requiere describir los colores originales |

| Colorización B&N | Bueno | Mejor con contexto de época en el prompt |

| Zonas quemadas (overexposure) | Regular | Inventa contenido donde no hay datos |

| Rostros y expresiones | Aproximado | Nunca fiel al 100% por restricciones OpenAI |

| Detalles finos en piel | Deficiente | Tiende a suavizar en exceso |

| Texto en la imagen | Deficiente | Modifica letras, muy poco confiable |

ChatGPT vs software tradicional de restauración

La ventaja de ChatGPT es obvia: no necesitás instalar nada, no necesitás saber editar fotos, y el proceso lleva menos de un minuto. Para alguien sin experiencia en edición de imagen, es un punto de entrada muy accesible.

El problema es el control. Con Photoshop o Lightroom, cada ajuste es tuyo. Con ChatGPT, el modelo toma decisiones que vos no podés revertir a nivel granular. Si el color que aplicó en la ropa no te gusta, podés pedirle que lo cambie, pero no tenés forma de ajustar solo ese elemento sin afectar el resto. Es lo que en diseño se llama un proceso no determinístico: dos veces con el mismo prompt no dan el mismo resultado. Relacionado: cómo se compara con otros modelos IA.

Ponele que tenés una foto familiar de 1955 y querés que quede exactamente como era, con los colores y rasgos preservados. ChatGPT no es la herramienta correcta para ese trabajo. Para restauraciones con exigencia de fidelidad, Adobe Lightroom con sus herramientas de IA (Denoise, Detail) o Photoshop con Neural Filters dan más control. La curva de aprendizaje es mayor, pero el resultado es reproducible y ajustable.

ChatGPT gana en velocidad y accesibilidad. Pierde en control, precisión facial, y fidelidad al original.

Errores comunes al restaurar fotos con ChatGPT

Subir la foto directo desde el teléfono sin escanear

Una foto de una foto con el celular tiene reflejos, distorsión de perspectiva y ruido que el modelo interpreta como parte de la imagen original. El resultado va a intentar “restaurar” esos artefactos que en realidad introdujo el propio proceso de captura. Escaneá siempre; si no tenés scanner, usá una app de escaneo con luz flat y sin flash.

Prompt demasiado vago

“Mejorar esta foto” es un prompt que le da libertad total al modelo, y el modelo la va a usar. Puede cambiar el encuadre, modificar el fondo, ajustar la iluminación de formas que no esperabas. Cuanto más específico el prompt sobre qué está mal y qué querés preservar, mejor el resultado.

Esperar fidelidad facial en fotos de personas

Ya lo discutimos, pero vale repetirlo porque es el error más frustrante: si la foto tiene personas reales y la fidelidad de sus rasgos es importante para vos, ChatGPT no puede garantizarla. Preparate para resultados que se parecen pero no son idénticos.

No iterar

El primer resultado rara vez es el mejor. ChatGPT mantiene el contexto de la imagen en el hilo de conversación, así que podés seguir refinando: “el cielo quedó muy oscuro, aclaralo”, “las caras quedaron muy suavizadas, agregá más detalle”, “el tono general es muy frío, calentalo un poco”. Dos o tres iteraciones hacen una diferencia importante.

Esto que contamos acá tiene más detalle en Asked ChatGPT to restore my non existing image of my non exi.

Esto se conecta con Asked ChatGPT to restore my non existing image of my non exi, donde cubrimos el tema en detalle.

Preguntas Frecuentes

¿Cómo restauro fotos antiguas con ChatGPT?

Necesitás una cuenta con GPT-4o activo. Subís la imagen digitalizada (mínimo 600 DPI), escribís un prompt que describa el estado actual de la foto y lo que querés corregir, y esperás entre 15 y 40 segundos. El resultado aparece en el mismo chat y podés descargarlo directamente. Para mejores resultados, especificá qué elementos no querés que el modelo modifique. Complementá con cómo la gente realmente usa ChatGPT.

¿Puede ChatGPT colorizar fotos en blanco y negro?

Sí, con resultados decentes si describís bien el contexto de la foto (época, lugar, tipo de escena). El modelo aplica colores plausibles según lo que infiere del contexto, no colores exactos. Para fotos donde los colores originales son conocidos (uniforme de equipo, ropa específica), conviene incluir esa información en el prompt para evitar interpretaciones incorrectas.

¿Qué prompts usar para restaurar imágenes dañadas con ChatGPT?

Los prompts más efectivos describen el tipo de daño (“arañazos horizontales”, “manchas de humedad”, “decoloración general”) y lo que querés preservar (“mantener la composición original”, “no modificar los rostros”). Incluir la época de la foto ayuda con la colorización. Un prompt concreto como “restaura esta foto de los años 50, tiene arañazos y está desvanecida, colorizala con tonos naturales sin modificar los rostros” da mejores resultados que “mejorar foto antigua”.

¿Qué tan precisas son las restauraciones de ChatGPT en rostros?

Nunca son completamente fieles. OpenAI aplica restricciones de generación de rostros para prevenir deepfakes, lo que hace que el modelo altere sutilmente proporciones, expresiones y texturas faciales. El resultado puede parecerse mucho a la persona original, pero no es una reproducción exacta. Para fotos donde la fidelidad facial es prioritaria, herramientas como Photoshop Neural Filters dan más control sobre el resultado.

¿ChatGPT es mejor que Photoshop para restaurar fotos?

Depende del caso de uso. ChatGPT es más rápido y accesible, ideal para defectos generales como arañazos, decoloración y colorización B&N en fotos sin personas. Photoshop y Lightroom son mejores cuando necesitás control preciso, fidelidad facial, o reproducibilidad del proceso. ChatGPT no requiere conocimientos técnicos; Photoshop sí. Para restauraciones familiares importantes donde los rostros deben ser reconocibles, el software especializado sigue siendo más confiable.

Conclusión

ChatGPT con GPT-4o es una herramienta genuinamente útil para restaurar fotos antiguas, con un asterisco grande: regenera, no repara. Para fondos, arañazos, decoloración y colorización, los resultados pueden ser muy buenos con poco esfuerzo. Para rostros de personas reales donde la fidelidad importa, los límites son estructurales y no van a desaparecer mientras OpenAI mantenga sus políticas anti-deepfake.

El experimento de la “novia inexistente” ilustra exactamente eso: el modelo no tiene problemas para generar una cara convincente, precisamente porque no tiene referencia de cómo debería verse. Si la tenés, el modelo no puede usarla con exactitud. Esa paradoja define tanto la capacidad como el límite de la herramienta.

Si vas a usarla, escaneá bien la foto original, escribí un prompt descriptivo, y ajustá en varias iteraciones. Para proyectos de restauración familiar serios donde cada rasgo importa, combiná ChatGPT para los defectos generales con software especializado para los rostros.

Fuentes

- OpenAI Help Center – Imágenes en ChatGPT: capacidades oficiales

- TechRadar – Cómo usar ChatGPT para restaurar fotos antiguas (prueba práctica)

- AI Vibe Daily – Por qué ChatGPT no restaura realmente tus fotos antiguas

- Infobae – El prompt para restaurar fotos antiguas en ChatGPT

- Xataka – OpenAI y ChatGPT Images 2.0: la pieza que faltaba