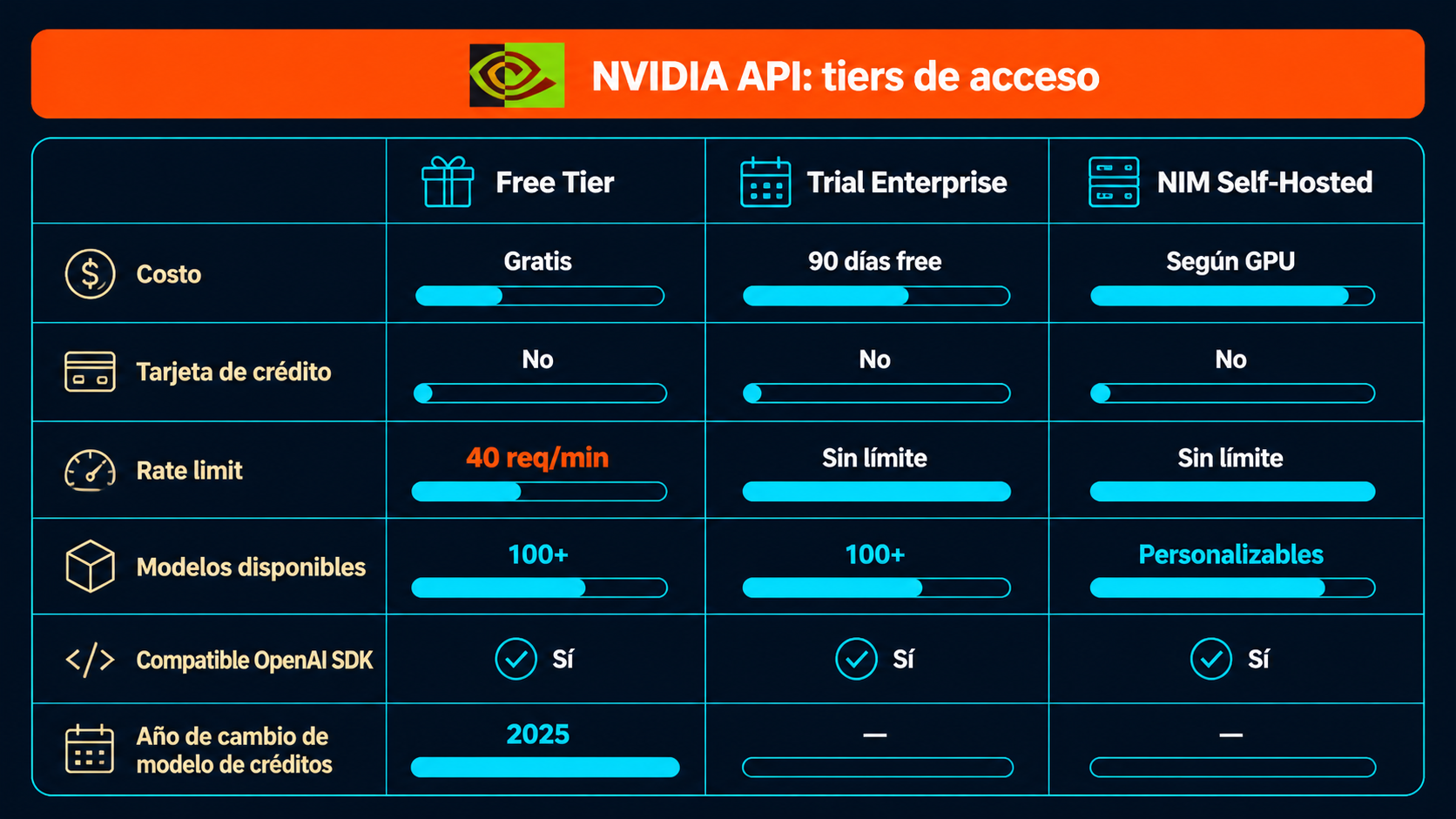

NVIDIA API es una plataforma de inferencia en la nube que permite acceder a más de 100 modelos de inteligencia artificial —incluyendo Llama, Mistral, DeepSeek y modelos propios de NVIDIA— mediante una clave API estándar compatible con el SDK de OpenAI. El acceso gratuito está disponible para cualquier desarrollador registrado en el NVIDIA Developer Program a través de build.nvidia.com, sin requerir tarjeta de crédito, con un límite de 40 requests por minuto en el tier libre. A partir de 2025, NVIDIA reemplazó el sistema de créditos por rate limits sin facturación por token, simplificando el modelo de uso para desarrollo y prototipado.

En pocas palabras: La API de NVIDIA es gratuita en 2026: registrás una cuenta en build.nvidia.com, generás tu API key sin tarjeta de crédito y accedés a más de 100 modelos (Llama, Mistral, DeepSeek) con un límite de 40 requests por minuto, suficiente para desarrollar y prototipar proyectos de IA sin costo.

NVIDIA ofrece acceso gratuito a más de 100 modelos de IA a través de su plataforma API NVIDIA gratis en build.nvidia.com. Cualquier desarrollador registrado en el NVIDIA Developer Program puede generar una clave API sin tarjeta de crédito y empezar a hacer inferencias en minutos, con límites de rate que alcanzan para prototipar sin gastar un peso.

En 30 segundos

- NVIDIA da acceso gratuito a 100+ modelos (Llama, Mistral, DeepSeek, Qwen, modelos propios) desde build.nvidia.com sin tarjeta de crédito.

- El tier gratuito incluye un límite de 40 requests por minuto; suficiente para desarrollo y prototipado, no para producción.

- La API es compatible con el SDK de OpenAI: solo cambiás la base URL y la key, el resto de tu código funciona igual.

- Para producción existe un trial de 90 días de NVIDIA AI Enterprise o la opción de correr NIM en tus propias GPUs.

- El sistema de créditos del pasado fue reemplazado en 2025 por rate limits sin facturación por token, lo que simplifica bastante el control de costos.

Qué es NVIDIA NIM y por qué importa

NVIDIA NIM (NVIDIA Inference Microservices) es la plataforma de inferencia de IA de NVIDIA que permite a desarrolladores acceder a modelos de lenguaje, visión y embeddings hospedados en la infraestructura DGX Cloud de la empresa, sin necesidad de configurar hardware propio. La interfaz pública de acceso es build.nvidia.com, donde NVIDIA expone su catálogo completo de modelos con una API REST compatible con el estándar de OpenAI.

¿Por qué interesa esto? Porque hasta hace poco, si querías probar modelos como Llama 3.1 o DeepSeek-R1 con inferencia de calidad, o comprabas créditos en alguna plataforma de terceros, o armabas tu propia infraestructura. NVIDIA cortó esa fricción ofreciendo el acceso directo, gratis, con sus propias GPUs. Para más detalles, consultá nuestra DeepSeek V4 y su billón de parámetros.

No es filantropía pura. El objetivo es que los desarrolladores construyan sobre NIM, se acostumbren al stack de NVIDIA y eventualmente migren a planes pagos o a infraestructura propia con chips NVIDIA. Pero mientras tanto, el free tier es real y funciona.

Cómo obtener tu clave API NVIDIA gratis en 3 pasos

El proceso es más directo de lo que parece. Según el anuncio oficial de NVIDIA, el acceso gratuito está disponible para todos los miembros del NVIDIA Developer Program, que es gratis de por sí.

Paso 1: Registrarse en NVIDIA Developer Program

Entrás a build.nvidia.com y hacés clic en “Sign In” o “Get Started”. Si no tenés cuenta NVIDIA, el registro toma menos de dos minutos con email y contraseña. No piden tarjeta. En algunos casos puede aparecer verificación por teléfono dependiendo de la región.

Paso 2: Ir a la sección de API Keys

Una vez logueado, navegás a build.nvidia.com/settings/api-keys. Ahí encontrás el botón para generar tu primera key. Las claves tienen el prefijo nvapi- seguido de una cadena alfanumérica larga. Guardala en algún lugar seguro porque no la podés ver de nuevo después de cerrar esa pantalla (sí podés generar una nueva si la perdés).

Paso 3: Probar el primer request

Con la key en mano, ya podés hacer tu primer request. El catálogo completo de modelos disponibles está en el dashboard principal de build.nvidia.com, con ejemplos de código en Python, curl y Node.js para cada modelo.

Modelos disponibles: qué hay en el catálogo

Más de 100 modelos. Eso suena impresionante hasta que te ponés a mirar cuántos son realmente útiles para casos de uso cotidianos. La verdad es que el catálogo tiene bastante sustancia. Complementá con según las recientes declaraciones de Jensen Huang.

| Modelo | Proveedor | Parámetros | Mejor para |

|---|---|---|---|

| Llama 3.1 8B Instruct | Meta | 8B | Tareas generales, rápido y liviano |

| Llama 3.1 70B Instruct | Meta | 70B | Razonamiento, análisis de texto largo |

| Mistral 7B Instruct | Mistral AI | 7B | Código, instrucciones estructuradas |

| DeepSeek-R1 | DeepSeek | 671B MoE | Razonamiento matemático, chain-of-thought |

| Qwen3.5 | Alibaba | Varios | Multilingüe, seguimiento de instrucciones |

| Nemotron-3 Super | NVIDIA | 49B | Modelos fine-tuneados para dominio técnico |

| NEVA-22B (visión) | NVIDIA | 22B | Análisis de imágenes, multimodal |

| NV-Embed-v2 | NVIDIA | 7B | Embeddings semánticos para RAG |

El catálogo también incluye modelos de síntesis de voz y modelos especializados para bioinformática y ciencias (como ESMFold para predicción de proteínas). Para desarrollo de aplicaciones estándar, los más usados son Llama 3.1 en sus distintos tamaños y DeepSeek-R1 para tasks de razonamiento.

Límites y restricciones: la letra chica que importa

Acá hay que ser honesto porque la información que circula en foros y blogs está un poco desactualizada.

El sistema original tenía créditos numerados (1.000 o 5.000 según la cuenta) que se consumían por request. Ese esquema cambió. El modelo actual, vigente desde 2025, usa rate limits sin facturación por token: podés hacer hasta 40 requests por minuto sin que se descuente ningún crédito. No hay un contador que baje. El límite es de velocidad, no de cantidad total.

Lo que eso significa en la práctica: podés hacer miles de requests por día sin problema, siempre que no superes las 40 por minuto. Para prototipado, testing y desarrollo, sobra. Para producción con usuarios reales, va a quedar corto.

¿Podés pedir más límite? Sí. En el dashboard hay opciones para solicitar aumento de rate limits, aunque el proceso implica justificar el caso de uso y no es instantáneo. Te puede servir nuestra cobertura de con técnicas avanzadas de prompting en visión.

Otro detalle: el tier gratuito es solo para el API Catalog hospedado por NVIDIA. Si querés correr NIM en tu propia infraestructura (self-hosted), eso es otro producto con otro esquema de licencias.

Ejemplo práctico: tu primer request desde Python

Ponele que querés consultar a Llama 3.1 8B sobre cómo funciona el fine-tuning. Si ya usaste la API de OpenAI, el código te va a resultar familiar porque la API de NVIDIA es compatible.

Instalás el SDK de OpenAI si no lo tenés:

pip install openaiY después el código en Python es así:

from openai import OpenAI

import os

client = OpenAI(

base_url="https://integrate.api.nvidia.com/v1",

api_key=os.environ.get("NVIDIA_API_KEY") # tu nvapi-...

)

completion = client.chat.completions.create(

model="meta/llama-3.1-8b-instruct",

messages=[

{

"role": "user",

"content": "Explicame en 3 párrafos cómo funciona el fine-tuning de un LLM."

}

],

temperature=0.7,

max_tokens=512

)

print(completion.choices.message.content)La única diferencia con una llamada estándar a OpenAI es el base_url y el formato del model (que usa el path proveedor/nombre-modelo).

El error más común que aparece en foros y que veo repetido en Stack Overflow: olvidar setear la variable de entorno. Si corrés el script sin NVIDIA_API_KEY seteada, vas a recibir un 401 Unauthorized que puede confundirse con un problema de permisos de cuenta. No lo es. Es simplemente que la key no llegó al request. Seteala explícitamente en el shell antes de correr:

export NVIDIA_API_KEY="nvapi-tu-clave-aqui"Si querés probar DeepSeek-R1 en vez de Llama, solo cambiás el model a "deepseek-ai/deepseek-r1". El resto del código queda igual. (Eso sí, DeepSeek-R1 va a ser bastante más lento porque tiene 671B parámetros con arquitectura MoE.) Para más detalles técnicos, mirá integrándola en workflows de automatización.

API Catalog vs. NIM self-hosted: la confusión más frecuente

Hay dos productos distintos que comparten el nombre NIM y eso genera bastante confusión en los foros de desarrolladores.

API Catalog (build.nvidia.com) es lo que estuvimos describiendo hasta ahora: inferencia hospedada en los servidores de NVIDIA, accesible vía API REST, gratis con límites de rate. No necesitás GPU propia. No necesitás Docker. Funciona desde cualquier máquina con conexión a internet.

NIM self-hosted es diferente: descargás un contenedor Docker con el modelo y la infraestructura de inferencia de NVIDIA, y lo corrés en tu propio hardware. Llama 3.1 8B en self-hosted requiere aproximadamente 16GB de VRAM; el modelo de 70B necesita varias GPUs. Esta opción tiene más control, latencia potencialmente menor si tenés buen hardware, y no tiene los rate limits del tier gratuito, pero tampoco es gratis en términos de infraestructura.

¿Cuándo usar cada uno? Para desarrollo y prototipado: API Catalog, sin dudas. Para producción con latencia crítica o datos sensibles que no podés mandar a servidores externos: self-hosted. Si estás empezando, olvidate del self-hosted por ahora y usá el API Catalog.

De desarrollo a producción: qué opciones tenés cuando necesitás escalar

El tier gratuito del API Catalog no está diseñado para producción. NVIDIA lo dice explícitamente: es para desarrollo, investigación y prototipado. Cuando tu aplicación empieza a tener usuarios reales y necesitás SLAs, las opciones son: Ya lo cubrimos antes en aunque sus competidores también avanzan rápido.

- NVIDIA AI Enterprise trial (90 días gratis): incluye acceso a NIM con límites de producción, soporte técnico y SLAs. Después del trial, es un producto pago.

- NIM self-hosted en hardware propio: bajás el contenedor, corrés en tus GPUs. Control total, escalabilidad dependiente de tu infraestructura.

- Partners cloud de NVIDIA: AWS, Azure y Google Cloud tienen integraciones con NIM para deployar en sus infraestructuras, con facturación por uso.

Para equipos que están evaluando opciones de hosting de sus propias aplicaciones con integración a estas APIs, vale la pena considerar una infraestructura de backend confiable. En el mercado argentino, donweb.com ofrece servidores VPS donde podés alojar el backend de tu aplicación que consume la API de NVIDIA.

Qué está confirmado y qué no

| Afirmación | Estado | Fuente |

|---|---|---|

| Acceso gratuito a 100+ modelos en build.nvidia.com | Confirmado | Anuncio oficial NVIDIA Developer Blog |

| Sin tarjeta de crédito para el tier gratuito | Confirmado | Proceso de registro en build.nvidia.com |

| Límite de 40 requests/minuto | Confirmado para cuentas estándar | Documentación NVIDIA NIM |

| El sistema de créditos fue reemplazado por rate limits | Confirmado (cambio de 2025) | Foros oficiales NVIDIA Developer |

| Trial de 90 días de AI Enterprise incluye producción | Confirmado | Página de NVIDIA AI Enterprise |

| Fecha exacta de vencimiento del free tier | No confirmado — sin fecha anunciada de cierre | No hay comunicado oficial |

Errores comunes al usar la API NVIDIA gratis

Error 1: Usar el nombre de modelo mal formateado

En el API Catalog de NVIDIA, los modelos se identifican con el formato proveedor/nombre-modelo (por ejemplo: meta/llama-3.1-8b-instruct). Si pasás solo el nombre corto como hacés con OpenAI (gpt-4o), vas a recibir un error 404 Model not found. El listado completo de model IDs está en la documentación oficial de NIM.

Esto se conecta directo con nuestro artículo sobre Free 1 year Nvidia api key y cómo usarla al máximo.

Error 2: Confundir la base URL según el caso de uso

La base URL para el API Catalog es https://integrate.api.nvidia.com/v1. Si usás https://api.openai.com/v1 con tu API key de NVIDIA (o viceversa), la autenticación va a fallar aunque el formato del request sea correcto. Parecen URLs similares pero no son intercambiables.

Error 3: Asumir que el free tier escala a producción

Este es el más importante. Con el rate limit de 40 requests por minuto, si tu aplicación tiene 20 usuarios simultáneos haciendo consultas, vas a empezar a recibir errores 429 Too Many Requests. El free tier es para desarrollo. Cualquiera que haya armado un prototipo que de repente “funciona en local pero explota con usuarios reales” se topó con este techo. Planificá la migración a Enterprise o self-hosted antes de abrir el producto al público.

Preguntas Frecuentes

¿Cómo obtengo una clave API de NVIDIA gratis?

Registrarte en el NVIDIA Developer Program (gratuito) en build.nvidia.com, luego ir a build.nvidia.com/settings/api-keys y generar una nueva key. El proceso no requiere tarjeta de crédito. La key generada tiene el prefijo nvapi- y es válida para todos los modelos del catálogo.

¿Cuánto tiempo duran los créditos gratuitos de NVIDIA NIM?

El sistema actual no usa créditos que se agoten: desde 2025, el tier gratuito funciona con rate limits (hasta 40 requests por minuto) sin un contador que baje. Podés hacer requests indefinidamente mientras no superes ese límite de velocidad. NVIDIA no anunció fecha de cierre para este modelo de acceso.

¿Qué modelos puedo usar gratis con la API de NVIDIA?

Más de 100 modelos, incluyendo Llama 3.1 (Meta) en sus variantes de 8B, 70B y 405B, Mistral 7B Instruct, DeepSeek-R1, Qwen3.5, y modelos propios de NVIDIA como Nemotron-3 Super. El catálogo también incluye modelos de visión, embeddings (NV-Embed-v2) y modelos especializados en biociencias.

¿Cuáles son los límites de la API gratuita de NVIDIA?

El límite principal es de 40 requests por minuto. No hay límite diario ni mensual de requests totales bajo el esquema actual. El tier gratuito está destinado a desarrollo y prototipado; NVIDIA no garantiza SLAs ni soporte técnico para usuarios de este plan.

¿Cómo integro la API de NVIDIA en mi aplicación Python?

Usás el SDK de OpenAI (pip install openai) cambiando la base_url a https://integrate.api.nvidia.com/v1 y el api_key a tu clave NVIDIA. El nombre del modelo sigue el formato proveedor/nombre-modelo (por ejemplo meta/llama-3.1-8b-instruct). El resto del código es idéntico a cualquier integración con OpenAI.

Conclusión

La oferta de API NVIDIA gratis es genuinamente útil para desarrolladores que quieren probar inferencia de calidad sin pagar. El catálogo de 100+ modelos, el sistema de rate limits sin agotamiento de créditos y la compatibilidad con el SDK de OpenAI hacen que la barrera de entrada sea casi nula.

Lo que no es: una solución de producción. Los 40 requests por minuto son suficientes para prototipar, no para servir usuarios reales. Y el tier gratuito no tiene SLA ni soporte, lo cual es esperable para algo sin costo.

Si estás arrancando un proyecto de IA en 2026 y todavía no lo probaste, build.nvidia.com es la primera parada. Registrate, generá la key, probá Llama 3.1 o DeepSeek-R1, y después evaluás si escalar a Enterprise o self-hosted según lo que necesite tu aplicación. No tiene sentido pagar por algo que podés validar gratis.

Fuentes

- NVIDIA API Catalog — Plataforma oficial de acceso a modelos NIM

- NVIDIA Developer Blog — Anuncio de acceso gratuito para Developer Program

- Documentación oficial NVIDIA NIM — Guías técnicas y referencia de API

- Foros NVIDIA Developer — Comunidad técnica oficial