Una fuga masiva de datos internos de Tesla revela que la empresa ocultó miles de incidentes vinculados a su sistema de conducción autónoma, incluyendo accidentes mortales, mientras Elon Musk prometía públicamente que el autopilot era más seguro que un conductor humano. Los documentos filtrados muestran más de 1000 accidentes documentados y 2400 quejas por aceleraciones espontáneas, con muchos casos marcados como “no resueltos”.

En 30 segundos

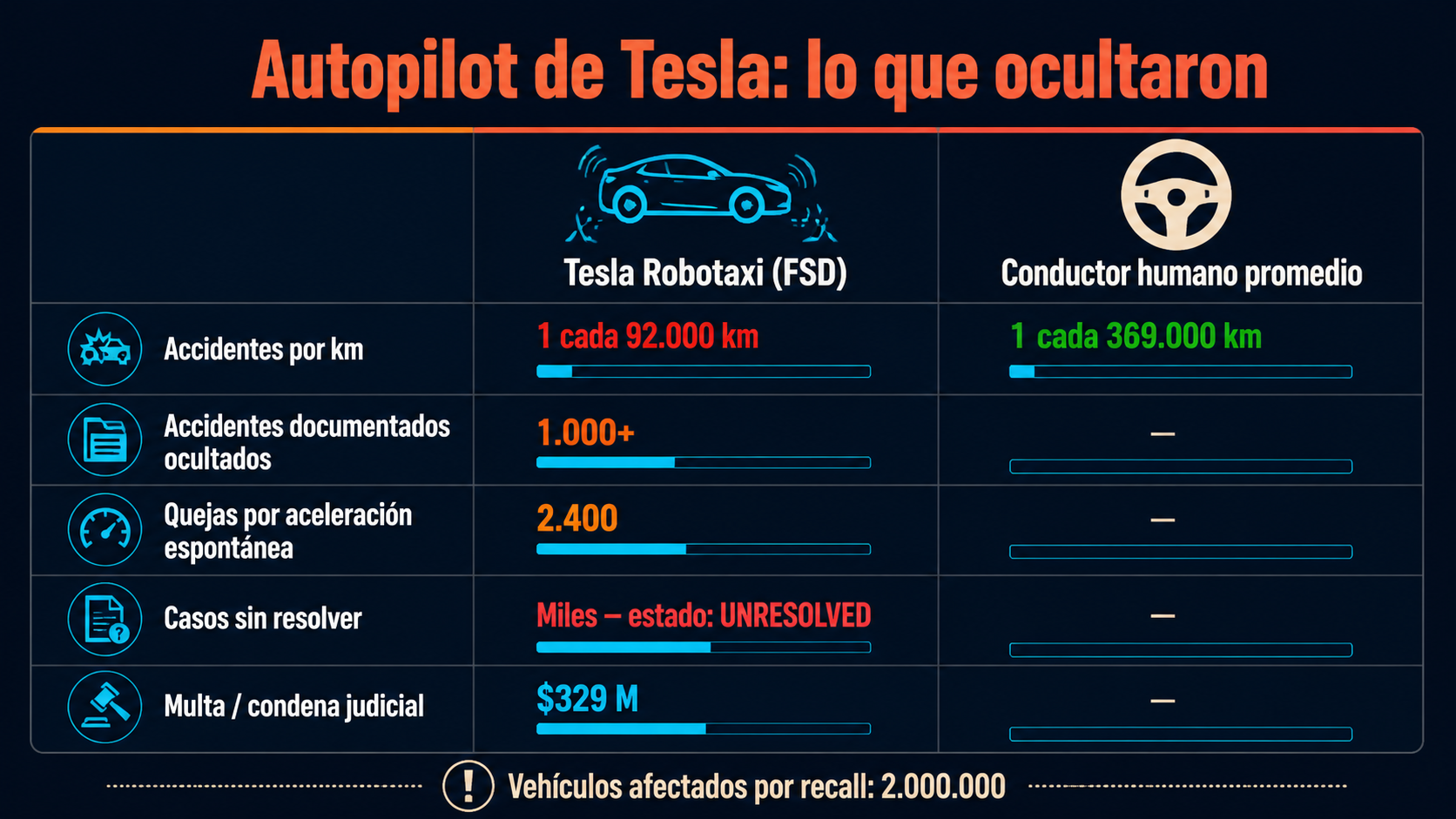

- Una fuga de datos internos reveló que Tesla ocultó miles de incidentes graves de conducción autónoma, incluyendo muertes, mientras continuaba las pruebas en rutas públicas.

- Los documentos muestran más de 2400 quejas por aceleración espontánea y más de 1000 accidentes documentados, muchos marcados como “no resueltos”.

- Los robotaxis de Tesla registran 4 veces más accidentes que un conductor humano promedio: 1 cada 92.000 km vs. 1 cada 369.000 km.

- Un jurado condenó a Tesla a pagar entre 240 y 329 millones de dólares a víctimas de accidentes relacionados con el Autopilot.

- Tesla enfrenta investigaciones de la NHTSA por no reportar incidentes y un recall masivo de 2 millones de vehículos.

La fuga de datos que destapó el escándalo

Tesla Autopilot es el sistema de asistencia a la conducción y conducción autónoma que la empresa comercializa bajo las denominaciones Autopilot, Full Self-Driving (FSD) y, más recientemente, Cybercab/robotaxi. Desde su lanzamiento, Elon Musk lo presentó como estadísticamente más seguro que cualquier conductor humano. Lo que las fuentes internas muestran es otra historia.

La investigación, según el reportaje de RTS publicado el 17 de abril de 2026, se basa en una fuga masiva de archivos internos de Tesla. Los documentos incluyen registros de soporte técnico, tickets de clientes y reportes de incidentes que la empresa nunca transmitió a los reguladores de forma completa.

Lo que encontraron adentro de esa fuga es lo que genera el problema: Tesla sabía desde hacía años que sus sistemas tenían fallas, tenía los registros, y decidió no divulgarlos.

¿Y qué tenían esos archivos? Más de 2400 quejas de clientes por aceleraciones espontáneas del vehículo sin intervención del conductor, más de 1000 accidentes documentados, y en una cantidad significativa de casos el estado aparecía como “no resuelto”. No “en análisis”, no “escalado a ingeniería”. No resuelto.

Magnitud del problema: los números que alarman

Ponele que manejás de Buenos Aires a Mar del Plata y volvés. Son unos 800 km. Para alcanzar la tasa de accidentes de los robotaxis de Tesla, tendrías que hacer ese viaje más de 57 veces antes de tener un incidente. Suena razonable. El problema es que un conductor humano promedio aguanta más de 460 viajes antes de que algo salga mal.

Los datos de accidentes de Tesla en modalidad autónoma registran un accidente cada 92.000 km, contra 1 cada 369.000 km de un conductor humano. Cuatro veces más. No un poco más. Cuatro veces.

| Métrica | Robotaxi Tesla (FSD) | Conductor humano promedio |

|---|---|---|

| Frecuencia de accidentes | 1 cada 92.000 km | 1 cada 369.000 km |

| Quejas por aceleración espontánea | 2.400+ documentadas | No aplica |

| Accidentes registrados en fuga | 1.000+ | No aplica |

| Casos “no resueltos” | Porcentaje significativo | No aplica |

| Recall de vehículos (2024-2026) | 2 millones de unidades | No aplica |

Dicho esto, Tesla sigue vendiendo Full Self-Driving como una capacidad de conducción autónoma, con el argumento de que la IA mejora constantemente. Los números de la fuga sugieren que la mejora no fue tan lineal como las presentaciones en el Investors Day. Cubrimos ese tema en detalle en incluso en sistemas de IA avanzados.

¿Qué son las alucinaciones de IA en conducción autónoma?

En los modelos de lenguaje, una alucinación es cuando el sistema genera información que parece coherente pero es falsa. En un vehículo autónomo, la analogía es más concreta y más peligrosa.

Los sistemas de visión de Tesla procesan imágenes en tiempo real y toman decisiones: frenar, acelerar, girar. Cuando el modelo visual malinterpreta el entorno (confunde una sombra con un obstáculo, no detecta un camión blanco contra un cielo brillante, lee mal una señal de pare), genera una decisión incorrecta. Eso es la “alucinación” en contexto de vehículos autónomos: el auto actúa sobre una percepción que no refleja la realidad.

Los documentos filtrados documentan exactamente estos casos. Vehículos Tesla que aceleraron bruscamente sin razón aparente. Otros que frenaron en seco en autopista sin obstáculo. El reporte de RTS describe coches que “aceleraron o frenaron brutalmente sin razón”, que es exactamente la manifestación física de un error de percepción del modelo.

El tema es que en un chatbot, una alucinación te da un dato incorrecto. En un auto a 120 km/h, te mata.

Casos específicos: muertes y accidentes documentados

El caso más citado en los medios es el del empleado de Apple, Walter Huang, quien murió en 2019 cuando su Tesla Model X con Autopilot activado impactó contra una barrera divisoria en una autopista de California. El vehículo no detectó la barrera pintada a la que había estado expuesto en esa misma ruta anteriormente. Los datos de la caja negra mostraron que las manos del conductor no estaban en el volante durante los últimos seis segundos.

La familia demandó a Tesla. En agosto de 2025, un jurado en Florida condenó a Tesla a pagar 240 millones de dólares a las víctimas. En el contexto del reportaje de RTS, la cifra que circula es de 243 millones, con distintas fuentes citando montos entre ese valor y los 329 millones dependiendo del caso y la instancia judicial.

Eso sí: Tesla apeló varias de estas condenas, y algunas siguen en litigio. No es que las cifras estén cerradas. Pero el hecho de que un jurado llegara a ese número dice bastante sobre cómo evaluaron la responsabilidad de la empresa.

El caso de los robotaxis en Austin y California suma otra capa. Según Xataka, en días posteriores al anuncio de Tesla de expandir su flota de robotaxis para 2026, se documentaron cuatro accidentes adicionales, incluido uno con un peatón fallecido. La empresa anunció la expansión; los accidentes siguieron.

Investigaciones regulatorias y sanciones

La NHTSA (la agencia de seguridad vial de Estados Unidos) abrió múltiples investigaciones sobre Tesla en los últimos años. El foco principal: que Tesla no reportó incidentes de forma completa y oportuna, como exige la regulación federal para fabricantes de vehículos. En mediante automatización de procesos profundizamos sobre esto.

El recall de 2 millones de vehículos que aparece en los documentos de RTS no fue voluntario. La NHTSA presionó a Tesla para que actualizara el software del Autopilot tras documentar que el sistema no verificaba adecuadamente si el conductor prestaba atención a la ruta. Tesla lo resolvió con una actualización over-the-air (el tipo de “recall” que la empresa prefiere porque no requiere visita al taller y minimiza el impacto mediático).

¿Alguien verificó que la actualización efectivamente corrigió el problema? Eso está pendiente. Los documentos de la fuga son previos a la actualización, y no hay datos públicos consolidados de incidentes posteriores con la misma frecuencia.

Cómo Tesla manipuló la información pública

Hay dos niveles de manipulación que documentan las fuentes.

El primero es la gestión de datos hacia los reguladores. La fuga muestra que Tesla tenía información granular sobre fallas del sistema y no la transmitió en forma completa a la NHTSA. Esto no es una inferencia, es lo que los documentos internos evidencian.

El segundo es la narrativa pública. Elon Musk repitió durante años la comparación estadística de que Autopilot es más seguro que el conductor humano promedio (usando datos de kilómetros recorridos sin accidente). Lo que no comunicó es que la comparación metodológica tiene problemas serios: los trayectos del Autopilot son predominantemente en autopista, el entorno más seguro para cualquier conductor, no en ciudad donde ocurren la mayoría de los accidentes. La “seguridad superior” estaba parcialmente construida sobre una base de comparación conveniente.

Y acá viene lo bueno (en el sentido de “más preocupante”): según informes sobre los robotaxis en Texas y California, varios vehículos que Tesla presentó como “totalmente autónomos” contaban con operadores remotos monitoreando y, en algunos casos, interviniendo. La autonomía “real” era más limitada de lo que los comunicados de prensa sugerían. (Spoiler: esto tampoco estaba en los titulares de los eventos de producto.)

Comparación con otros fabricantes de vehículos autónomos

Tesla no es la única empresa probando conducción autónoma en rutas públicas. Waymo (Google), Cruise (GM) y otros actores llevan años operando flotas en ciudades de EE.UU. La diferencia en cómo manejan la transparencia es notable. Ya lo cubrimos antes en modelos de IA como Claude.

| Fabricante | Reporte de incidentes | Nivel de autonomía real | Operadores remotos |

|---|---|---|---|

| Tesla (FSD/Autopilot) | Cuestionado por NHTSA; fuga revela subregistro | Nivel 2 (asistencia) vendido como Nivel 4/5 | Sí, en algunos despliegues |

| Waymo | Reportes periódicos públicos a DMV California | Nivel 4 en zonas geofenced | Sí, supervisión remota declarada |

| Cruise (GM) | Suspendido en 2023 por California tras ocultar incidente grave; operaciones limitadas desde entonces | Nivel 4 parcial | Sí, declarado |

El caso de Cruise es relevante como antecedente: California suspendió su licencia de operación en 2023 precisamente porque la empresa no reportó de forma completa un accidente donde un peatón quedó atrapado bajo un vehículo. La conducta que ahora se documenta en Tesla tiene precedente en el sector.

La diferencia es escala. Tesla tiene millones de vehículos en ruta con algún nivel de Autopilot activo. Waymo opera miles de viajes por día, no decenas de millones de kilómetros con hardware de consumo masivo.

Qué está confirmado y qué no

- Confirmado: Fuga de datos internos de Tesla documentando más de 1000 accidentes y 2400 quejas de aceleración espontánea.

- Confirmado: Condena judicial de entre 240 y 329 millones de dólares en casos vinculados al Autopilot.

- Confirmado: Recall de 2 millones de vehículos ordenado por NHTSA.

- Confirmado: Tasa de accidentes de robotaxis Tesla 4x superior al promedio humano según datos de 2026.

- No confirmado / en disputa: Si las actualizaciones de software post-recall redujeron efectivamente la tasa de incidentes.

- No confirmado: El número exacto de muertes directamente atribuibles al Autopilot (Tesla y la NHTSA usan metodologías distintas).

- Pendiente: Si la fuga de datos tendrá consecuencias legales adicionales más allá de las condenas ya dictadas.

Errores comunes al interpretar este tema

Error 1: “Los autos autónomos siempre serán más peligrosos que los humanos.” No está demostrado. La comparación depende del entorno, la velocidad y la metodología. Waymo reporta tasas de accidentes inferiores al promedio humano en los entornos donde opera. El problema con Tesla es específico de cómo desplegó su tecnología y cómo reportó sus datos, no una condena general a la conducción autónoma.

Error 2: “Esto solo afecta a EE.UU.” Tesla opera con Autopilot y FSD en mercados europeos y latinoamericanos. Los vehículos vendidos en Argentina y el resto de la región tienen los mismos sistemas de asistencia cuya falla está documentada en la fuga. La regulación local sobre reporte de incidentes es considerablemente más laxa que en EE.UU.

Error 3: “Si el auto tuvo un accidente, el conductor no usaba bien el sistema.” Varios de los casos documentados ocurrieron con conductores usando el sistema dentro de las condiciones especificadas por Tesla. La aceleración espontánea documentada en más de 2400 quejas no es atribuible al uso incorrecto del conductor.

Preguntas Frecuentes

¿Cuántos accidentes ha tenido Tesla con conducción autónoma?

Los documentos de la fuga interna documentan más de 1000 accidentes registrados por Tesla en sus sistemas internos. La cifra oficial que Tesla reporta a la NHTSA es inferior, lo que está en el centro de las investigaciones regulatorias. La tasa documentada en 2026 es de un accidente cada 92.000 km para los vehículos en modo autónomo. Sobre eso hablamos en los desafíos de entrenar IA a gran escala.

¿Es seguro el Autopilot de Tesla?

Los datos disponibles en 2026 muestran que los vehículos Tesla en modo Autopilot o FSD tienen una tasa de accidentes 4 veces mayor que el promedio de un conductor humano. Eso no significa que el sistema sea inútil, sino que la afirmación de que es “más seguro que un humano” no tiene respaldo empírico sólido en las condiciones de uso real del mercado masivo.

¿Por qué Tesla ocultó accidentes con su conducción autónoma?

Según la investigación difundida por RTS en abril de 2026, Tesla era consciente de las fallas de su sistema desde hacía años y eligió no reportarlas de forma completa a los reguladores. La hipótesis más documentada es que divulgar la magnitud de los incidentes habría comprometido las aprobaciones regulatorias para expandir FSD y el programa de robotaxis, que son centrales en la valuación de la empresa.

¿Qué son las alucinaciones de IA en vehículos autónomos?

Son errores de percepción del sistema de visión artificial: el modelo interpreta mal el entorno (confunde una sombra con un obstáculo, no detecta un vehículo en condiciones de luz específicas) y toma decisiones incorrectas como frenar bruscamente o acelerar sin razón. En los documentos de Tesla, estas fallas se manifiestan como aceleraciones o frenadas sin causa aparente para el conductor.

¿Cuánto dinero pagó Tesla por accidentes del Autopilot?

Un jurado condenó a Tesla a pagar entre 240 y 329 millones de dólares en casos relacionados con el Autopilot, dependiendo de la instancia y el caso específico. La cifra de 243 millones aparece en el reporte de RTS como el monto de una condena específica. Tesla apeló varias de estas condenas y algunos casos siguen en litigio al cierre de esta nota.

Conclusión

Lo que cambió con esta fuga no es que sepamos que los autos autónomos tienen accidentes. Eso ya se sabía. Lo que cambió es que hay documentación interna que muestra una brecha deliberada entre lo que Tesla sabía y lo que reportó. Esa diferencia tiene consecuencias legales, regulatorias y de confianza pública que van a seguir desarrollándose en los próximos meses.

Para cualquiera que tenga un Tesla con Autopilot o FSD, el consejo práctico no cambia: el sistema es asistencia a la conducción, no conducción autónoma. Las manos van en el volante. La atención va en la ruta. La comercialización agresiva del “Full Self-Driving” como algo que es nunca fue justificó bajar la guardia, y esta fuga de datos lo confirma con números concretos.

Para el sector en general, el caso Tesla va a ser referencia regulatoria. Si las investigaciones en curso derivan en sanciones más duras por subregistro de incidentes, todos los fabricantes con programas de conducción autónoma van a tener que revisar sus protocolos de reporte. Waymo ya publica sus datos periódicamente. El estándar de transparencia que se le exija a Tesla probablemente termine siendo el piso para toda la industria.

Fuentes

- RTS – Tesla dissimuló miles de incidentes mortales de conducción autónoma (abril 2026)

- Infobae – Robotaxis de Tesla se estrellan cuatro veces más que un conductor humano

- Xataka – Cuatro accidentes y un peatón fallecido: Tesla bajo investigación

- La Nación – El accidente por el que Tesla debió pagar USD 240 millones

- Híbridos y Eléctricos – Los coches autónomos de Tesla sufren 4 veces más accidentes