A partir del 9 de abril de 2026, Anthropic pasó a beta pública tres funcionalidades nuevas para Claude Managed Agents que cambian bastante cómo se construyen agentes de IA en producción: Dreaming (agentes que aprenden de sesiones anteriores), Outcomes (rúbricas automáticas de éxito) y Multi-Agent Orchestration (delegación inteligente entre agentes especializados). Con solo un mes en beta, ya hay casos de uso reales que muestran resultados concretos.

En 30 segundos

- Dreaming permite que los agentes de Claude revisen sesiones anteriores para mejorar su propia memoria. Desde su lanzamiento en beta (9 de abril), Harvey reportó un aumento de 6x en task completion rate.

- Outcomes introduce rúbricas automáticas para que el agente sepa si hizo bien la tarea. Wisedocs redujo su tiempo de revisión documental en un 50% desde que implementó la funcionalidad en abril.

- Multi-Agent Orchestration permite que un agente lead distribuya tareas entre agentes especializados en paralelo. Desde el lanzamiento en beta, Netflix ya lo usa para procesar logs de cientos de builds simultáneamente.

- Claude Security llegó a beta pública con foco en vulnerabilidades críticas: corrupción de memoria y authentication bypasses. Tiene un mecanismo interno para reducir falsos positivos.

- Los límites de Claude Code se duplicaron para todos los planes (Pro, Max, Team, Enterprise), aprovechando la alianza con SpaceX y sus 220.000 GPUs NVIDIA.

Claude es un modelo de lenguaje grande desarrollado por Anthropic para procesamiento y generación de texto. Realiza tareas de análisis, escritura, programación y conversación, y está disponible en múltiples versiones desde su lanzamiento en 2023.

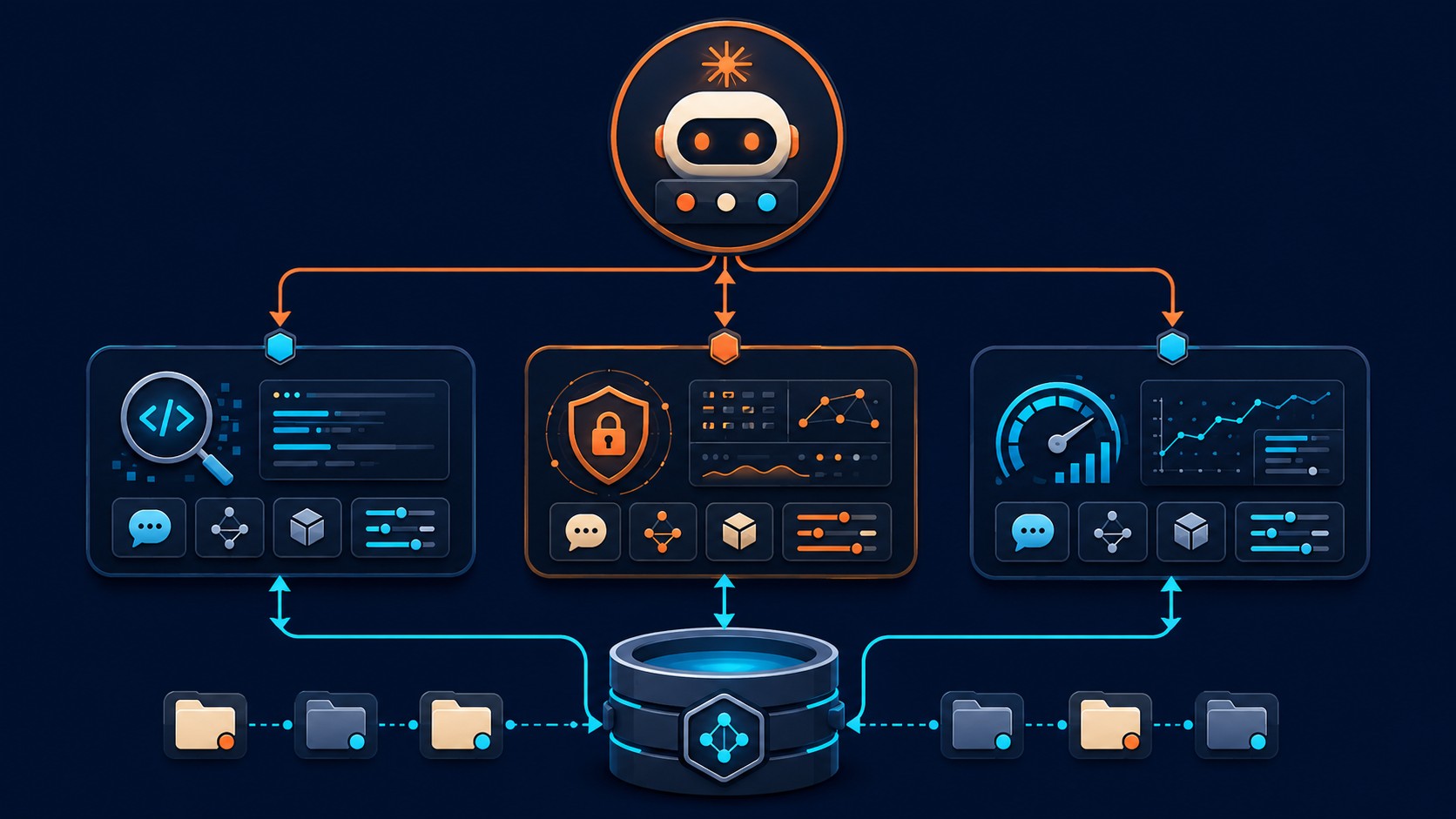

Las tres actualizaciones principales de Claude Managed Agents

Claude Managed Agents es la plataforma de Anthropic para construir agentes de IA que hacen trabajo autónomo: no solo responden preguntas, sino que ejecutan tareas largas, toman decisiones intermedias y operan con contexto persistente. Las tres funcionalidades que Anthropic lanzó en beta el 9 de abril apuntan exactamente a los problemas que tiene cualquiera que haya intentado llevar un agente a producción: que aprenda con el tiempo, que sepa cuándo hizo bien la tarea, y que pueda dividirse en equipos especializados cuando la tarea es demasiado grande para uno solo.

Las tres pasaron a beta pública el 9 de abril de 2026. No son features experimentales que “podrían llegar” después: están disponibles ahora para quien tenga acceso a la plataforma.

Dreaming: agentes que aprenden de sus propios errores

Ponele que tenés un agente jurídico que revisa contratos. Al principio comete errores: malinterpreta cláusulas, pasa por alto excepciones específicas de un cliente, olvida contexto de sesiones anteriores. Con el sistema tradicional, esos errores se van acumulando sin que el agente incorpore nada. Dreaming cambia eso.

Lo que hace es permitir que el agente, después de completar una tarea, revise la sesión para identificar patrones: qué funcionó, qué falló, qué información faltó. Esa revisión se incorpora a la memoria del agente para las sesiones siguientes. Según el anuncio de Anthropic, desde el lanzamiento en beta el 9 de abril, Harvey (una empresa de software legal) implementó Dreaming y reportó un aumento de 6x en su task completion rate. No es un número menor: básicamente el agente dejó de repetir los mismos errores en tareas similares.

Eso sí: no es actualización automática sin control. El equipo puede configurar si las actualizaciones de memoria se aplican automáticamente o requieren revisión manual antes. Para casos donde los errores de un agente pueden tener consecuencias legales o financieras, el control manual es la opción razonable. Para flujos de menor riesgo, la actualización automática ahorra tiempo.

Outcomes: definir el éxito antes de ejecutar

¿Alguien verificó si el agente realmente hizo bien la tarea? En la mayoría de los setups de agentes que vi, la respuesta es: a medias, o manualmente, o directamente no.

Outcomes resuelve eso con un sistema de rúbricas. Antes de que el agente ejecute una tarea, definís criterios concretos de éxito. Cuando termina, el sistema evalúa automáticamente el resultado contra esos criterios y marca si la tarea se completó correctamente o no. No es que el agente se autoevalúe de forma vaga: la evaluación sigue las rúbricas que definiste.

El caso más concreto que compartió Anthropic es Wisedocs, una empresa de procesamiento documental para seguros médicos. Desde que implementó Outcomes en abril de 2026, redujo el tiempo de revisión documental en un 50%. El agente ya sabía qué constituía un documento bien procesado, y cuando no cumplía los criterios, lo marcaba para revisión humana en vez de silenciosamente dejarlo pasar (que es lo que pasa sin este sistema).

Multi-Agent Orchestration: delegación inteligente de tareas

La orquestación multi-agente es el feature más complejo de los tres, y también el más interesante para equipos de desarrollo con tareas grandes.

La idea es esta: un agente “lead” recibe la tarea principal y la divide en subtareas que delega a agentes especializados. Cada uno de esos agentes especializados puede tener su propio modelo, su propio system prompt, sus propias herramientas. Y ejecutan en paralelo. Cuando terminan, el agente lead consolida los resultados.

Pensá en el proceso de análisis de un build de software grande, donde tenés logs de cientos de builds simultáneos. Desde el lanzamiento en beta, Netflix ya usa exactamente este setup para procesar ese volumen sin que todo caiga en un solo agente que colapsa con contexto masivo. Cada agente especializado toma una porción del problema, el lead coordina y arma el reporte final. Sobre eso hablamos en cómo Claude se compara con Gemini.

Para developers que construyen sobre Claude, esto significa que podés modelar workflows complejos que antes requerían arquitecturas propias de orquestación. No es que Claude reemplaza toda esa lógica, pero sí reduce bastante el código de plomería que tenés que escribir vos.

Claude Security en beta: foco en vulnerabilidades críticas

Anthropic también lanzó Claude Security en beta. El foco no es auditar todo el código, sino detectar vulnerabilidades de alta severidad: corrupción de memoria, authentication bypasses, los bugs que en producción tienen consecuencias serias.

Según la información disponible sobre el lanzamiento, el sistema usa un mecanismo de auto-cuestionamiento para reducir los falsos positivos. El problema clásico de las herramientas de análisis estático es que te inundan de alertas, y el equipo deja de prestarles atención. Claude Security intenta ser más selectivo: preguntarse a sí mismo si realmente es un problema antes de reportarlo.

Está en beta, así que tomalo con pinzas. No hay datos de comparación contra otras herramientas de análisis de seguridad, y el mecanismo de auto-cuestionamiento suena prometedor pero necesita validación externa.

Límites duplicados: el poder de Colossus en acción

La semana del 5 de mayo llegó otra novedad: los rate limits de Claude Code se duplicaron para todos los planes. Pro, Max, Team y Enterprise reciben el doble de capacidad en la ventana de 5 horas. Y según el reporte de KnightLi, el throttling en horas pico desapareció. También aumentaron los rate limits de la API para Claude Opus.

El contexto importa: Anthropic tiene una alianza con SpaceX que pone a disposición 220.000 GPUs NVIDIA bajo el proyecto Colossus. Ese músculo de cómputo es lo que permite duplicar límites sin subir precios (al menos por ahora). Si alguna vez te trabaste con el throttling de Claude Code en mitad de una sesión larga, este cambio es directamente relevante para tu flujo de trabajo diario.

Implicaciones prácticas para desarrolladores y startups

Juntá todo esto y tenés un stack de agentes bastante diferente al de hace seis meses. Antes, construir un agente que mejorara con el tiempo requería tu propio sistema de feedback loop, tu propia lógica de evaluación, tu propia arquitectura de orquestación. Hoy, Anthropic ofrece primitivas para los tres casos directamente en la plataforma. Tema relacionado: Claude frente a otros modelos de IA.

Para equipos pequeños, esto reduce el time-to-production de agentes complejos. Para equipos enterprise con workflows de miles de tareas diarias, la combinación de Dreaming + Outcomes + Orchestration permite construir sistemas que se optimizan solos dentro de los parámetros que definís.

| Feature | Qué hace | Caso de uso real | Resultado reportado |

|---|---|---|---|

| Dreaming | El agente aprende de sesiones anteriores | Harvey (software legal) | 6x task completion rate |

| Outcomes | Rúbricas automáticas de evaluación de tareas | Wisedocs (seguros médicos) | 50% menos tiempo de revisión |

| Multi-Agent Orchestration | Un lead delega a agentes especializados en paralelo | Netflix (análisis de builds) | Procesamiento masivo simultáneo |

| Claude Security | Detección de vulnerabilidades críticas (beta) | Equipos de desarrollo | En evaluación |

| Límites duplicados | 2x capacidad en Claude Code para todos los planes | Desarrolladores Claude Code | Sin throttling en horas pico |

El punto donde todavía no queda claro todo es la curva de adopción. Dreaming y Outcomes requieren que el equipo defina correctamente los criterios y configure la memoria: si eso no se hace bien, el agente puede aprender patrones incorrectos o evaluar contra criterios vagos. Son features poderosas que demandan trabajo inicial de diseño.

Errores comunes al implementar estas funcionalidades

Dejar Dreaming en automático sin revisar qué aprende el agente. Si el agente tomó decisiones incorrectas en una sesión y esa sesión alimenta su memoria, vas a reforzar patrones malos. Al menos al inicio, revisá manualmente qué actualizaciones de memoria aprueba el sistema.

Definir rúbricas de Outcomes demasiado amplias. “La tarea está bien hecha” no es una rúbrica. Tenés que especificar: qué campos tienen que estar completos, qué formato debe tener el output, qué condiciones de error lo invalidan. Si la rúbrica es vaga, la evaluación automática va a ser igual de vaga.

Armar la jerarquía de Multi-Agent Orchestration sin pensar en los puntos de falla. Si el agente lead cae o pierde contexto, el resultado de todos los subagentes puede quedar inutilizable. Diseñá el flujo con checkpoints intermedios donde el estado se guarda, no solo al final. En optimizar los costos de APIs de IA profundizamos sobre esto.

Si te importa mantener tus credenciales seguras, Oh Sweet Claude! cuenta la historia completa del robo.

Esto se conecta con Oh Sweet Claude!, donde lo cubrimos en profundidad.

Preguntas Frecuentes

¿Cuáles son las nuevas características de Claude en 2026?

A partir del 9 de abril de 2026, Anthropic pasó a beta pública Dreaming (agentes que aprenden de sesiones anteriores), Outcomes (evaluación automática de tareas con rúbricas) y Multi-Agent Orchestration (delegación de tareas entre agentes especializados). También lanzó Claude Security en beta para detección de vulnerabilidades críticas, y duplicó los rate limits de Claude Code para todos los planes.

¿Qué es Dreaming en Claude y cómo mejora los agentes?

Dreaming es un sistema que permite que los agentes de Claude revisen sus sesiones anteriores para identificar patrones y actualizar su memoria de trabajo. En la práctica, el agente mejora con el tiempo en vez de repetir los mismos errores. Harvey, una empresa de software legal, reportó un aumento de 6x en task completion rate después de implementarlo desde el lanzamiento en beta. La actualización de memoria puede configurarse como automática o con revisión manual.

¿Cómo funciona Multi-Agent Orchestration?

Un agente “lead” recibe la tarea principal y la divide en subtareas que delega a agentes especializados, cada uno con su propio modelo, system prompt y herramientas. Los subagentes ejecutan en paralelo y el lead consolida los resultados. Netflix usa este sistema para procesar logs de cientos de builds simultáneamente, lo que antes requería arquitecturas de orquestación custom.

¿Qué cambios hubo en los límites de Claude Code?

Desde la semana del 5 de mayo de 2026, el rate limit de la ventana de 5 horas se duplicó para todos los planes: Pro, Max, Team y Enterprise. El throttling en horas pico fue eliminado. Los rate limits de la API para Claude Opus también aumentaron. Estos cambios están respaldados por la alianza con SpaceX y sus 220.000 GPUs NVIDIA bajo el proyecto Colossus.

¿Es Claude ahora más seguro con Claude Security?

Claude Security llegó a beta pública en abril de 2026 con foco en vulnerabilidades de alta severidad: corrupción de memoria y authentication bypasses. Usa un mecanismo de auto-cuestionamiento para reducir falsos positivos, que es el problema clásico de las herramientas de análisis estático. Por ahora está en beta y no hay datos de comparación independiente con otras herramientas del mercado.

Conclusión

Lo que hizo Anthropic a partir de abril de 2026 no es un update cosmético. Dreaming, Outcomes y Multi-Agent Orchestration son cambios estructurales en cómo se construyen agentes: pasan de ser workflows estáticos a sistemas que aprenden, se autoevalúan y se dividen el trabajo de forma inteligente. Los casos de Harvey y Wisedocs son concretos y los números no son triviales.

Para quienes construyen sobre Claude, el mensaje es claro: la plataforma asume cada vez más responsabilidad en la orquestación y el aprendizaje, y deja al equipo enfocarse en definir criterios de negocio. El riesgo es delegar esa definición sin el rigor necesario, especialmente con Dreaming activo. Revisá bien qué aprende tu agente antes de darle autonomía completa sobre su propia memoria.

Si ya usás Claude Code, los límites duplicados son una mejora inmediata sin costo adicional. Si construís agentes para clientes o productos propios, estas tres funcionalidades merecen una prueba en beta antes de que pasen a general availability.

Fuentes

- 9to5Mac – Anthropic updates Claude Managed Agents with three new features

- Infobae – Anthropic agrega la capacidad de soñar a Claude para ayudar a los agentes de IA

- KnightLi – Anthropic Claude Code: límites más altos con el cómputo de SpaceX

- TecnoNoticias – Anthropic lanza Claude Security en beta para corregir fallas graves de código

- Simon Willison – Code with Claude 2026