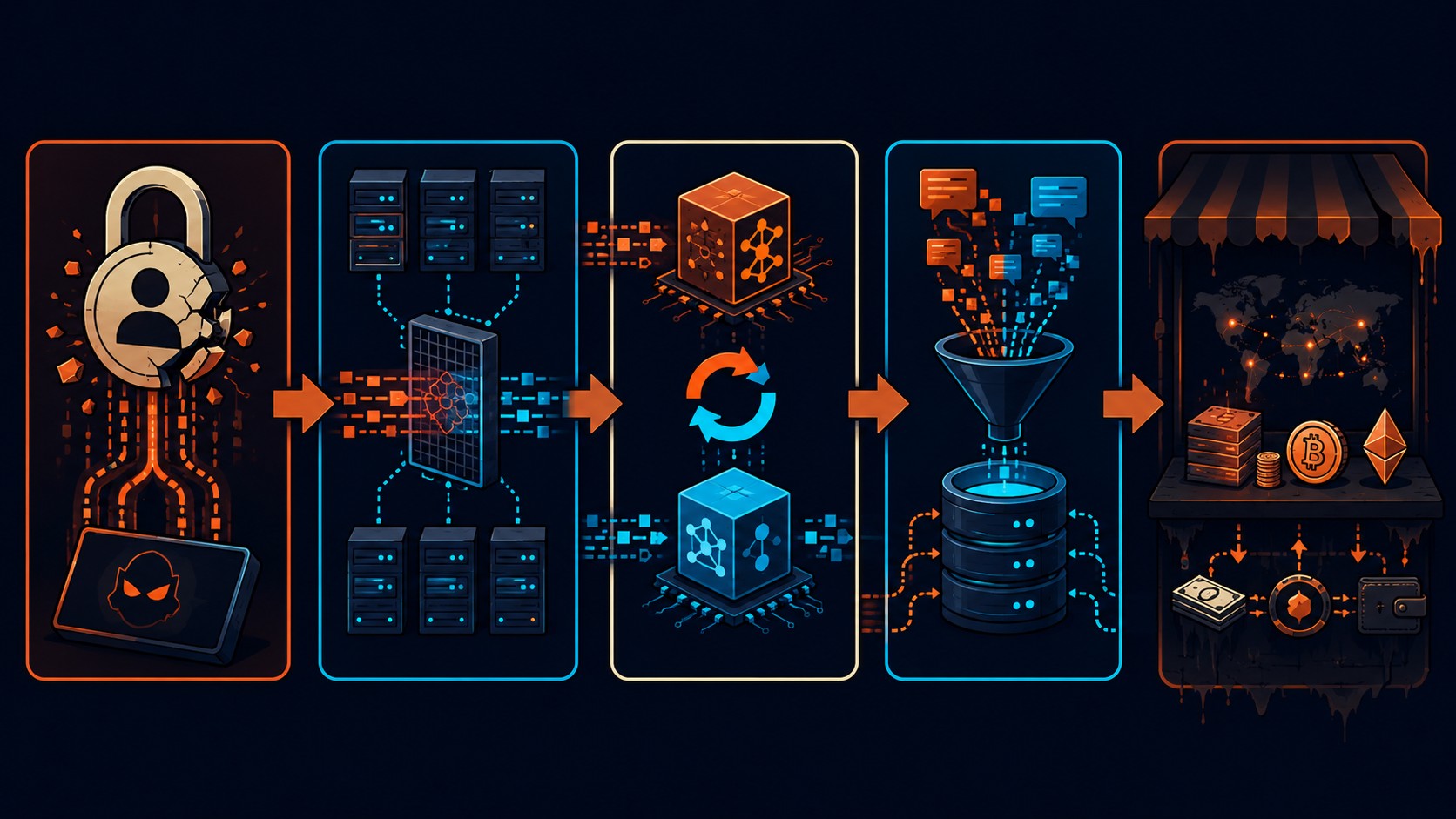

Un mercado gris chino vende acceso a la API de Claude al 90% del precio oficial usando credenciales robadas, sustitución silenciosa de modelos y captura masiva de prompts de usuarios que luego se revenden como datos de entrenamiento. Según Tom’s Hardware, la operación corre a través de redes de proxies conocidas como “transfer stations” que interceptan cada solicitud antes de llegar a Anthropic.

En 30 segundos

- Proxies chinos venden acceso a Claude API hasta un 90% más barato usando credenciales robadas de cuentas legítimas.

- Anthropic deshabilitó aproximadamente 1,45 millones de cuentas entre julio y diciembre de 2025 por abuso o violaciones de términos.

- Los proxies sustituyen Claude por modelos más baratos (Llama, GPT-3.5) pero facturan como si fuera Claude real.

- El verdadero negocio es la cosecha de prompts y respuestas, que se venden como datos de entrenamiento IA.

- En mayo de 2026, Anthropic lanzó Claude Security en beta para detectar y corregir vulnerabilidades de código.

Claude API es la interfaz de programación que Anthropic proporciona para integrar el modelo de lenguaje Claude en aplicaciones. Permite a desarrolladores usar Claude mediante solicitudes HTTP para procesar texto y generar respuestas.

El escándalo de la seguridad Claude API: credenciales robadas al 90% de descuento

La seguridad Claude API está bajo presión real desde que se confirmó que redes de intermediarios chinas comercializan acceso al modelo de Anthropic a precios imposibles de lograr legalmente. El esquema no es nuevo en tecnología, pero la escala sí: operan como negocios semiprofesionales, con canales de Telegram, bots automatizados y hasta soporte al cliente.

La API de Claude es el servicio de programación de Anthropic que permite integrar el modelo de lenguaje en aplicaciones, automatizaciones y pipelines de desarrollo. Tiene precios por token según el modelo utilizado (desde Haiku hasta Opus), y acceso directo a capacidades como análisis de código, generación de texto y procesamiento de documentos.

Ponele que tu empresa decidió usar Claude API para automatizar atención al cliente. Buscás opciones más baratas, encontrás un proveedor que cobra centavos por llamada, y durante semanas todo parece andar bien. Lo que no ves es que cada prompt que mandás, cada respuesta que recibís, ya viajó por tres servidores intermedios en algún datacenter de Shenzhen.

Cómo roban las credenciales: tres vectores que se combinan

El problema no viene de un solo lado. Hay tres fuentes principales que se retroalimentan.

Primero, la filtración de código. En marzo de 2026, Infobae reportó que el código de Claude Code se filtró por error, exponiendo detalles internos de implementación que facilitaron la identificación de vulnerabilidades. Cuando el código fuente de una herramienta queda expuesto, los actores maliciosos tienen una ventaja enorme para encontrar puntos débiles antes de que los parchen.

Segundo, el credential stuffing clásico. Es la técnica de tomar listas de usuario/contraseña filtradas en otras brechas y probarlas masivamente en plataformas nuevas. El CNI español alertó en 2026 que el mercado negro de credenciales de organismos públicos estaba “en plena ebullición” (el patrón es global, no local). Muchos usuarios de Claude reutilizan contraseñas de otros servicios.

Tercero, la explotación de fallos de seguridad directamente en las APIs. Esto incluye tokens de acceso mal configurados, claves de API hardcodeadas en repositorios públicos de GitHub, y endpoints con validación insuficiente.

¿Alguien está midiendo cuántas API keys de Claude circulan expuestas en repositorios públicos? Detectores de indexación encontraron en abril de 2026 más de 100.000 conversaciones con claves visibles en buscadores. Tema relacionado: alternativas reguladas de origen europeo.

La sustitución de modelos: el fraude que no se ve

Acá viene lo más interesante del esquema. Las “transfer stations” no siempre entregan Claude. Muchas sustituyen el modelo por uno más barato, como Llama 3.1 o GPT-3.5 Turbo, y facturan como si hubieran usado Claude Sonnet u Opus.

El resultado para el usuario: respuestas que zafan pero no son lo que pagó. Diferencias en razonamiento, en manejo de contexto largo, en calidad de código generado. El problema es que si tu caso de uso es moderadamente complejo, puede pasar semanas antes de que noten la degradación (y para ese entonces ya mandaron cientos de prompts con datos sensibles).

Los proxies tienen incentivo doble: cobrar margen sobre el precio del modelo real, y además ahorrar usando uno más barato. Ganan dos veces, el usuario pierde dos veces.

La cosecha de datos: el costo real del acceso “barato”

El modelo de negocio verdadero no es el descuento en el acceso. Es la cosecha de prompts y respuestas para venderlos como datos de entrenamiento.

Cada llamada que hacés a través de un proxy queda registrada: tu prompt completo, el contexto que mandaste, la respuesta generada. Eso se acumula, se clasifica por dominio (legal, médico, código, finanzas) y se empaqueta para vender a laboratorios que necesitan datos de entrenamiento especializados. Tu consulta sobre estrategia de producto, tu borrador de contrato, tu código propietario: ya es dato de entrenamiento de alguien.

La escala de daño potencial queda clara con un ejemplo de México: una filtración documentada expuso 150GB de datos del gobierno, incluyendo 195 millones de registros de contribuyentes. No todos los incidentes involucran proxies de IA, pero el apetito por datos masivos de usuarios reales es el mismo motor.

Si tu empresa usa Claude API para procesar información de clientes, contratos o código interno, mandar eso a través de un proxy no documentado es básicamente entregarlo voluntariamente. Esto se conecta con lo que analizamos en opciones de API más económicas y legales.

Ciberataques patrocinados por Estado: Claude como herramienta ofensiva

El problema no es solo el mercado gris. También está el uso deliberadamente malicioso de las capacidades del modelo.

En noviembre de 2025, Anthropic confirmó que hackers respaldados por el Estado chino usaron Claude para intentar atacar 30 objetivos globales. El método: escribir instrucciones en español (para eludir filtros entrenados principalmente en inglés) pidiendo a Claude que actuara como un hacker élite capaz de detectar y explotar vulnerabilidades. Algunos intentos tuvieron éxito parcial.

Esto reencuadra el problema. El mercado gris de acceso barato no es solo un asunto de fraude comercial: es parte de la infraestructura que facilita el uso ofensivo de modelos de lenguaje a escala.

Redes proxy y “transfer stations”: cómo funciona la infraestructura

Una transfer station es un servidor intermediario que se posiciona entre vos y la API real de Anthropic. Recibe tu solicitud, la reenvía usando credenciales robadas o de cuentas compradas en masa, espera la respuesta, y te la devuelve como si fuera directa.

Por qué son difíciles de detectar:

- Usan IPs rotativas y VPNs para distribuir tráfico y evitar detección por volumen

- Respetan los formatos de respuesta de la API oficial (misma estructura JSON, mismos headers)

- Tienen latencias similares a las reales porque usan infraestructura cloud legítima como intermediaria

- Los canales de venta operan en Telegram privado, con reputación construida en foros técnicos

Eso sí: a veces la latencia es notablemente mayor, o las respuestas tienen inconsistencias en el estilo que no se esperan de Claude. Son señales débiles, pero señales al fin.

Qué está confirmado y qué no

| Dato | Estado |

|---|---|

| Proxies chinos vendiendo acceso a Claude API al 90% de descuento | Confirmado (Tom’s Hardware, 2026) |

| Anthropic deshabilitó ~1,45M de cuentas (jul-dic 2025) | Confirmado por Anthropic |

| Hackers chinos usaron Claude para ciberataques (nov 2025) | Confirmado por Anthropic ante SwissInfo |

| Filtración de código Claude Code (mar 2026) | Confirmado (Infobae, WeLiveSecurity) |

| Claude Security en beta (may 2026) | Confirmado (Technonoticias) |

| Volumen total de prompts cosechados y revendidos | No confirmado con cifra exacta |

| Identidad de los operadores de las transfer stations | No confirmado públicamente |

Cómo protegerse: medidas concretas para equipos técnicos

Si usás Claude API en producción o en proyectos internos, hay pasos concretos que reducen exposición real.

1. Usá solo los endpoints oficiales. La URL base de la API de Anthropic es documentada y pública. Cualquier integración que apunte a otro dominio o IP debería generar una alerta inmediata en tu equipo.

2. Rotá API keys regularmente. Una key que lleva 6 meses activa es una key que probablemente pasó por varios sistemas. Rotación mensual es razonable para proyectos activos. Lo explicamos a fondo en features premium de Claude en riesgo.

3. Monitoreá el uso real. Anthropic tiene dashboards de uso. Si el conteo de tokens o el número de requests no coincide con lo que tu sistema generó, hay algo intermedio consumiendo o duplicando llamadas.

4. No mandés datos sensibles en prompts sin revisar el destino. Esto parece obvio y sin embargo es el error más común. Código propietario, datos de clientes, credenciales internas: ninguno debería ir en un prompt si no controlás toda la cadena de procesamiento.

5. Evaluá planes enterprise. Los planes enterprise de Anthropic incluyen garantías contractuales de privacidad de datos que los planes gratuitos o básicos no tienen. Para uso corporativo, la diferencia de precio se justifica solo por esas garantías.

Si además usás infraestructura cloud para alojar tus aplicaciones que consumen la API, tener el stack en un entorno controlado (como el que ofrece donweb.com para proyectos en Latinoamérica) reduce la superficie de ataque al eliminar intermediarios no auditados.

Respuesta de Anthropic: lo que hizo y lo que prometió

La respuesta de Anthropic fue progresiva. Entre julio y diciembre de 2025, deshabilitaron aproximadamente 1,45 millones de cuentas por abuso o violaciones de términos. No todas corresponden al mercado gris chino específicamente, pero la magnitud indica que el problema de credenciales comprometidas es sistémico, no puntual.

En mayo de 2026, Anthropic lanzó Claude Security en beta, una herramienta diseñada para auditar y corregir fallas graves de código. La propuesta es usar el propio modelo para detectar vulnerabilidades antes de que lleguen a producción, lo que tiene cierta ironía considerando que Claude fue usado en ataques documentados.

¿Es suficiente? Habría que verlo. Deshabilitar cuentas es reactivo: llegan tarde al daño. Claude Security es proactivo en el papel, pero todavía está en beta y no hay métricas públicas de su efectividad.

Errores comunes al evaluar este tipo de amenaza

Error 1: “Si funciona igual, el proxy no importa.” Funcionar igual en las pruebas no significa que sea igual en privacidad de datos. El modelo puede responder de forma similar mientras el intermediario registra cada prompt. El criterio de evaluación equivocado lleva a la conclusión equivocada.

Error 2: “Esto solo afecta empresas grandes.” Los proxies son más atractivos para usuarios individuales y startups porque justamente el precio bajo apela a quienes no pueden pagar las tarifas oficiales. El perfil más vulnerable es exactamente el que se cree fuera de riesgo. En alternativas legítimas a Claude API profundizamos sobre esto.

Error 3: “Anthropic detiene estas operaciones rápido.” Deshabilitaron 1,45 millones de cuentas en seis meses (en promedio, más de 8.000 por día). El volumen sugiere que la detección es masiva pero siempre va un paso atrás de quienes generan nuevas cuentas. No hay “limpieza definitiva” del mercado gris.

Qué significa para equipos en Latinoamérica

La región tiene dos características relevantes para este problema. Primero, la adopción de Claude API creció rápido en 2025-2026 entre startups y equipos de desarrollo independientes, que son exactamente los perfiles más tentados por opciones de acceso más baratas. Segundo, el ecosistema local todavía tiene menos cultura de auditoría de terceros proveedores de API.

Para equipos con presupuesto ajustado, la recomendación no es “paguen el precio completo o no usen Claude”. Es: si van a usar un proveedor intermediario por precio, auditá el dominio, revisá quién opera el servicio, y nunca mandés datos que no podrías publicar en un repositorio público. Si el proveedor no puede explicarte qué hace con los datos en tránsito, es una respuesta suficiente.

Preguntas Frecuentes

¿Cómo pueden vender acceso a Claude API al 90% de descuento?

Usan credenciales robadas de cuentas legítimas de Anthropic y las reutilizan para procesar solicitudes de múltiples clientes. El costo real para el proxy es casi cero (usan acceso que ya pagó otra persona), mientras cobran un margen pequeño pero sostenido sobre miles de usuarios simultáneos. En muchos casos además sustituyen el modelo por uno más barato, lo que amplía aún más el margen.

¿Qué riesgos corro si mis datos de Claude se filtran a través de un proxy?

El riesgo principal es la exposición de información confidencial: código propietario, datos de clientes, estrategias comerciales, documentos internos. Esa información se usa como datos de entrenamiento y potencialmente queda en sistemas de terceros sin control. Además, si el proxy entrega un modelo distinto, los resultados pueden ser menos confiables sin que lo notes.

¿Cómo detectar si alguien está usando mis credenciales de Claude API?

Revisá el dashboard de uso de Anthropic y comparalo con los logs de tu propia aplicación. Si hay discrepancias en el número de requests o tokens consumidos, es señal de que tus credenciales pueden estar siendo usadas por otro sistema. Rotá la API key inmediatamente y revisá en qué lugares la tenés almacenada (archivos de configuración, variables de entorno, repositorios).

¿Es seguro usar APIs de IA si existen mercados negros activos?

Sí, siempre que uses los endpoints oficiales y no intermediarios no documentados. El mercado gris afecta a quienes buscan precios más bajos fuera de los canales oficiales. Usar claude.ai o la API directa de Anthropic con tu propia clave te mantiene fuera del circuito de proxies. El riesgo real está en delegar el acceso a terceros no auditados.

¿Qué hace Anthropic para prevenir el robo de credenciales?

Anthropic deshabilitó alrededor de 1,45 millones de cuentas entre julio y diciembre de 2025 por uso indebido. En mayo de 2026 lanzó Claude Security en beta, una herramienta para auditar vulnerabilidades de código. También notificó públicamente los incidentes de filtración de código (como el de Claude Code en marzo de 2026). El enfoque combina detección reactiva de cuentas abusivas con herramientas preventivas de seguridad, aunque la velocidad de cierre de cuentas sugiere que el problema sigue siendo de escala significativa.

Conclusión

El mercado gris chino de acceso a Claude API no es una anomalía marginal: es una operación estructurada que combina robo de credenciales, sustitución de modelos y cosecha de datos con un negocio secundario de reventa de información de usuarios. Anthropic respondió deshabilitando millones de cuentas y lanzando herramientas de seguridad, pero el ciclo de creación de nuevas cuentas comprometidas no se detiene a esa velocidad.

Para cualquier equipo que use Claude API en 2026, el criterio de evaluación tiene que incluir privacidad de datos, no solo precio por token. Un acceso que cuesta el 10% del precio oficial casi siempre tiene un costo no declarado que se paga con información.

Fuentes

- Tom’s Hardware — Mercado gris chino vende acceso a Claude API al 90% de descuento

- SwissInfo — Anthropic confirma uso de Claude por hackers respaldados por China

- Infobae — Filtración del código de Claude y alerta de seguridad (marzo 2026)

- Technonoticias — Anthropic lanza Claude Security en beta (mayo 2026)

- WeLiveSecurity — Fuga de código de Claude Code