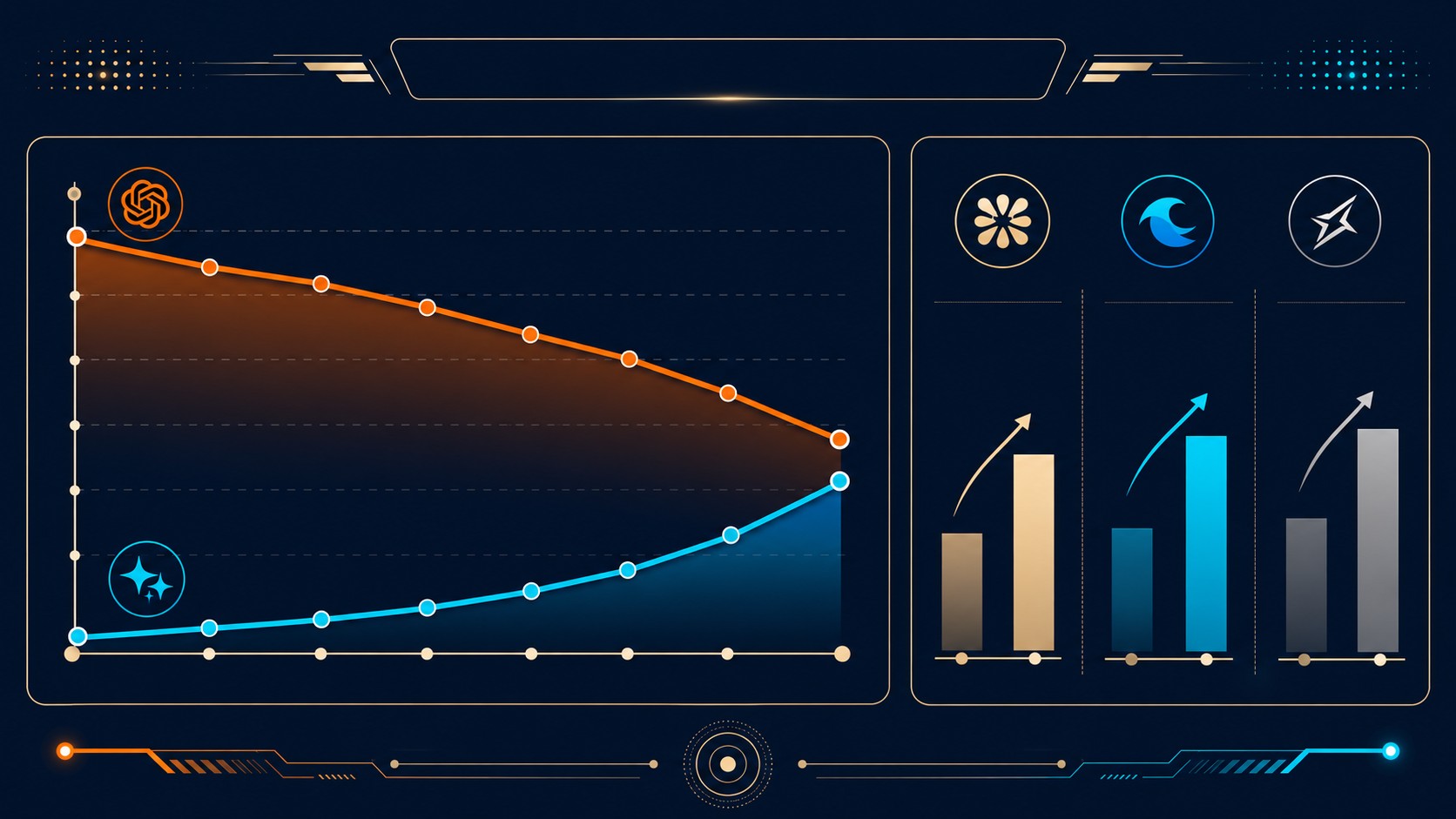

El declive de ChatGPT como líder indiscutido de IA es uno de los temas más discutidos de 2026. Lo que en 2022 parecía una hegemonía eterna hoy muestra grietas concretas: la cuota de mercado de OpenAI cayó del 86,7% en 2025 al 64,5% en enero de 2026, los servidores colapsaron bajo la demanda, y los competidores ya no son proyectos experimentales.

En 30 segundos

- La cuota de mercado de ChatGPT cayó del 86,7% (2025) al 64,5% (enero 2026), según datos de uso global.

- Caídas globales en febrero y abril de 2026 dejaron sin servicio a miles de usuarios y empresas que dependen de la API de OpenAI.

- Gemini pasó del 5,7% al 21,5% de cuota en 12 meses, el mayor crecimiento entre los competidores principales.

- El cofundador de OpenAI Ilya Sutskever confirmó que los resultados de ampliar el preentrenamiento “se han estancado”, señalando un techo técnico real.

- OpenAI ya cambió de estrategia: de “hacer modelos más grandes” a “más razonamiento en tiempo de inferencia” (modelo o1 y sucesores).

La era ChatGPT comenzó hace tres años, pero las grietas ya son visibles

ChatGPT es la interfaz conversacional de IA de OpenAI, lanzada en noviembre de 2022, que alcanzó 100 millones de usuarios en dos meses y se convirtió en el producto de software con mayor adopción inicial de la historia. En 2026, esa historia ya no es tan lineal.

El producto que definió lo que “IA generativa” significaba para el público general ahora enfrenta algo que sus primeros años no prepararon a nadie para esperar: el estancamiento. No es una caída dramática de acantilado, sino algo más parecido a lo que le pasa a cualquier producto maduro cuando los competidores dejan de tener miedo.

La cuota del 64,5% en enero de 2026 sigue siendo dominante, claro. Pero venía del 86,7%. Esa diferencia de 22 puntos porcentuales en menos de 12 meses no es ruido estadístico, es una tendencia.

Infraestructura colapsando: caídas, lentitud y límites que irritan

Ponele que tu empresa usa la API de OpenAI para atención al cliente. Febrero de 2026: falla masiva global, según reportes de la fecha. Tus clientes no tienen respuesta. Tu equipo no tiene herramienta. ¿Cuántas veces tolerás eso antes de empezar a mirar opciones?

En abril de 2026 hubo otra caída global que afectó tanto la interfaz web como la API y Codex, según registros de la interrupción. Sam Altman llegó a reconocer públicamente que las GPUs se estaban “derritiendo” bajo la demanda de la generación de imágenes con GPT-4o. La respuesta de OpenAI fue limitar a 3 imágenes por día para los usuarios gratuitos, según reveló Revista Cloud.

Los límites de uso cuentan una historia parecida. ChatGPT en el plan gratuito hoy impone restricciones de alrededor de 10 mensajes cada 5 horas con modelos avanzados. Claude, en comparación, permite 30 a 100 mensajes por día según el tier. Gemini tiene sus propios límites, pero en muchos casos más generosos para tareas cotidianas.

¿El resultado? Usuarios que llegan al tope a media tarde y buscan alternativas. Al principio como plan B. Después, como plan A.

El techo de los datos: el problema que nadie quería admitir

Acá viene la parte técnica que el marketing de OpenAI no grita muy fuerte. El modelo que conocés como ChatGPT se entrenó con una cantidad masiva de texto de internet. El problema es que ese recurso no es infinito, al menos no en la forma en que la industria lo usó. Tema relacionado: técnicas avanzadas de prompting.

Ilya Sutskever, cofundador y ex CTO de OpenAI, confirmó recientemente que “los resultados de ampliar el preentrenamiento se han estancado”. Eso significa que agregar más datos o más parámetros ya no produce las mejoras de calidad que produjo entre 2020 y 2023. El escalado que fue el motor del progreso encontró su límite práctico.

Hay también una restricción de hardware que no se menciona seguido. La comunicación entre racks de servidores es 8 veces más lenta que dentro de un mismo rack, lo que pone un techo práctico alrededor de 72 GPUs para ciertos tipos de entrenamiento distribuido. Escalar más allá de eso se vuelve exponencialmente más caro por unidad de mejora.

La respuesta de OpenAI fue cambiar de estrategia: de “hacé modelos más grandes” a “hacé que el modelo piense más en el momento de generar la respuesta”. Eso es lo que hace el modelo o1 y su familia. Es un cambio de arquitectura válido, pero también es una señal de que el camino anterior llegó a su límite.

Cambios de comportamiento: el modelo que ya no es el mismo

Los usuarios de Reddit llevan meses reportando algo concreto: las respuestas de ChatGPT se volvieron más cortas, más cautelosas y menos directas. No es percepción. OpenAI tuvo que retirar una actualización en abril de 2025 porque el modelo se había vuelto “demasiado adulador”, validando cualquier cosa que el usuario dijera en vez de dar respuestas útiles.

Eso sí: las causas reales de estos cambios de comportamiento son difusas. Hay presiones regulatorias, ajustes de seguridad y cambios por feedback de usuarios que van en direcciones opuestas. El resultado es un modelo que en algunos benchmarks sube, pero en uso cotidiano muchos lo perciben como menos útil que versiones anteriores.

Un ejemplo documentado que circuló bastante: GPT-4o no pudo etiquetar correctamente un mapa de Estados Unidos en una tarea que modelos previos resolvían sin problema (CNN reportó el caso). Puede ser un dato aislado. Pero es el tipo de regresión que genera desconfianza, porque si falló en eso, ¿en qué más está fallando que no noto?

Para desarrolladores, el problema es más práctico. La migración de GPT-4o a versiones más nuevas rompió workflows que funcionaban. Eso tiene un costo real: tiempo de debugging, ajuste de prompts, regresiones en producción. Lo explicamos a fondo en modelos con mejor rendimiento real.

Los competidores ya no son proyectos experimentales

El ascenso de Gemini es el movimiento de mercado más claro de los últimos 12 meses. Pasó del 5,7% al 21,5% de cuota, según datos de uso. Google tiene una ventaja estructural que ChatGPT no puede replicar: integración nativa con un ecosistema que mil millones de personas usan todos los días (Gmail, Drive, Docs, Search). No es solo un chatbot, es una capa de IA sobre herramientas que ya usás.

Claude (Anthropic) se posicionó diferente: sin intentar ganar en todo, apostó por escritura profesional de calidad y análisis profundo. Si necesitás redactar un informe técnico, un contrato, o analizar un documento extenso, Claude hoy le gana a ChatGPT en la percepción de muchos usuarios avanzados, según comparativas de La Nación de marzo de 2026.

DeepSeek, que emergió como la alternativa de código abierto más capaz, ataca el nicho del razonamiento sin las restricciones que OpenAI impone por decisiones de política. Para código complejo y matemáticas, sus benchmarks son competitivos.

Grok (xAI) juega en otro tablero: tiempo real y sin la hiperprecaución de sus competidores. No es para todos, pero para usuarios que necesitan información actual sin filtros de moderación excesivos, cubre una necesidad concreta.

Tabla comparativa: estado actual de las alternativas en 2026

| Plataforma | Cuota de mercado | Límite plan gratuito | Fortaleza principal | Debilidad conocida |

|---|---|---|---|---|

| ChatGPT (OpenAI) | 64,5% | ~10 msgs/5h (modelos avanzados) | Reconocimiento, ecosistema, plugins | Caídas, comportamiento cambiante, costo API |

| Gemini (Google) | 21,5% | ~750 requests/día (reducido 50%) | Integración Google Workspace, multimodal | Respuestas a veces genéricas |

| Claude (Anthropic) | N/D | 30-100 msgs/día según tier | Escritura larga, análisis de documentos | Sin búsqueda web nativa en versión base |

| DeepSeek | N/D | Sin límite claro publicado | Código, razonamiento, código abierto | Infraestructura menos madura |

| Grok (xAI) | N/D | Acceso via X Premium | Tiempo real, sin restricciones excesivas | Requiere suscripción a X |

¿Fin de la era ChatGPT o reajuste de mercado?

La pregunta honesta es esta: ¿ChatGPT está en declive o simplemente dejó de ser el único?

Ambas cosas a la vez. El producto en sí tiene problemas técnicos reales: infraestructura bajo presión, límites técnicos en el preentrenamiento, y un comportamiento que cambió en formas que no convencen a todos. Eso es declive relativo. Al mismo tiempo, el mercado maduró. En 2023 las alternativas eran proyectos prometedores. En 2026 son productos terminados con millones de usuarios activos.

OpenAI no está quieto. La apuesta por el razonamiento en tiempo de inferencia (o1, o3) es un cambio de paradigma válido que puede dar resultados. Pero el monopolio del “único chatbot que importa” ya se terminó, y eso no vuelve. Esto se conecta con lo que analizamos en alternativas como Gemini.

Para empresas que alojan sus aplicaciones IA y necesitan infraestructura confiable para correr modelos, la lección de las caídas de OpenAI es que diversificar tiene sentido: ya sea en el proveedor de modelo o en el proveedor de hosting donde corre tu lógica. En ese contexto, opciones locales como donweb.com tienen sentido para equipos que quieren reducir la dependencia de infraestructura extranjera.

Qué está confirmado y qué no

Confirmado

- Caída de cuota de mercado de 86,7% a 64,5% entre 2025 y enero 2026.

- Caídas globales del servicio en febrero y abril de 2026.

- OpenAI limitó la generación de imágenes a 3 por día por saturación de demanda.

- OpenAI retiró una actualización de GPT en 2025 por comportamiento “demasiado adulador”.

- Ilya Sutskever confirmó el estancamiento en los resultados del preentrenamiento a escala.

- Gemini creció del 5,7% al 21,5% de cuota en 12 meses.

No confirmado o en disputa

- Si la pérdida de cuota de mercado continuará al mismo ritmo en el segundo semestre de 2026.

- Cuánto del cambio de comportamiento en GPT es por regulación, cuánto por diseño y cuánto por problemas de entrenamiento.

- Si el enfoque en razonamiento en inferencia (o1/o3) recuperará la ventaja técnica de OpenAI sobre competidores.

- Los datos de cuota de mercado exactos de Claude y DeepSeek (OpenAI no los publica y los trackers independientes varían).

Qué hacer ahora: opciones concretas

Si sos usuario individual, la respuesta más sensata es dejar de depender de un solo modelo. Probá Claude para escribir documentos largos o analizar contratos. Usá Gemini si tu flujo de trabajo gira alrededor de Google Workspace. Probá DeepSeek si trabajás mucho con código o matemáticas. Perplexity tiene sentido cuando necesitás información reciente con fuentes citadas.

Si sos desarrollador o tenés aplicaciones que usan la API de OpenAI, revisá qué parte de tu stack es crítica y qué pasaría si la API cae dos horas. Las caídas de febrero y abril de 2026 no fueron de minutos. Considerar un fallback a otro proveedor de modelos no es pesimismo, es ingeniería básica de resiliencia.

Para equipos en empresas: diversificar proveedores de IA no es complicarlo todo. Es no poner todos los huevos en una sola canasta cuando esa canasta demostró que se puede caer.

La decisión técnica que más se subestima: elegir modelo por caso de uso, no por marca. Un modelo puede ser excelente para generación de código y mediocre para análisis de sentimiento. Ninguno gana en todo. La “mejor IA” es la que resuelve tu caso de uso específico con el costo y la disponibilidad que necesitás.

Errores comunes al evaluar el declive de ChatGPT

Error 1: Confundir cuota de mercado con calidad técnica. Que Gemini creció del 5,7% al 21,5% no significa que sea mejor en todo. Significa que más gente lo usa, probablemente porque ya tienen cuenta de Google. La cuota refleja adopción y distribución, no siempre rendimiento en benchmarks técnicos.

Error 2: Tratar los límites de uso como señal de declive técnico. Los límites de ChatGPT en el plan gratuito son una decisión de negocio (y de infraestructura bajo presión), no evidencia de que el modelo sea peor. Confundir el producto-servicio con el modelo subyacente lleva a conclusiones equivocadas.

Error 3: Migrar todo a una sola alternativa. El que reemplaza ChatGPT con “Claude para todo” o “Gemini para todo” está cometiendo el mismo error: dependencia excesiva de un proveedor. La respuesta a la fragilidad de OpenAI no es otra dependencia exclusiva. Ya lo cubrimos antes en herramientas más especializadas.

Preguntas Frecuentes

¿Está ChatGPT realmente empeorando en 2026?

Depende de qué medís. En benchmarks formales, los modelos más nuevos de OpenAI puntúan más alto que GPT-4 en muchas categorías. En experiencia de usuario cotidiana, hay reportes consistentes de respuestas más cautelosas, más cortas y menos directas que en versiones anteriores. OpenAI retiró una actualización en 2025 específicamente porque el modelo era “demasiado adulador”, lo que confirma que el comportamiento cambió en formas que ellos mismos consideraron problemáticas.

¿Por qué ChatGPT está tan lento y con tantas caídas?

La demanda superó la capacidad de la infraestructura en múltiples ocasiones durante 2026. Las caídas de febrero y abril afectaron tanto la interfaz web como la API. Sam Altman reconoció públicamente que las GPUs estaban bajo presión extrema por la demanda de generación de imágenes. Los límites de 3 imágenes por día que OpenAI impuso fueron una respuesta directa a esa saturación.

¿Cuál es la mejor alternativa a ChatGPT en 2026?

No hay una sola respuesta, depende del uso. Para escritura profesional y análisis de documentos largos, Claude (Anthropic) tiene buena reputación. Para tareas integradas con Google Workspace, Gemini tiene ventaja estructural. Para código y razonamiento sin restricciones excesivas, DeepSeek es competitivo. Para información en tiempo real, Grok (xAI). La comparativa de La Nación de marzo de 2026 identificó a Claude y Gemini como los modelos con mejor desempeño general en uso cotidiano.

¿Se acabó la era de ChatGPT como líder de IA?

El monopolio se terminó, la hegemonía no. Con el 64,5% de cuota de mercado, ChatGPT sigue siendo el líder claro, pero cayó 22 puntos porcentuales en menos de un año. Lo que cambió es que los competidores ya no son proyectos prometedores, son productos terminados con millones de usuarios. La “era ChatGPT” como período de hegemonía sin competencia real probablemente sí terminó. Lo que viene es un mercado de IA con varios jugadores serios.

¿Cuáles son las limitaciones reales de ChatGPT ahora?

Tres capas de limitaciones. Técnicas: el cofundador de OpenAI confirmó que el preentrenamiento a escala ya no produce mejoras proporcionales, lo que forzó un cambio de estrategia hacia el razonamiento en inferencia. De infraestructura: caídas frecuentes en 2026 y límites de uso que generan fricción cotidiana. De comportamiento: cambios en el modelo que varios usuarios y desarrolladores perciben como respuestas más cautelosas y menos útiles que en versiones previas.

Conclusión

El declive de ChatGPT como líder indiscutido no es una historia de un producto roto. Es la historia natural de un mercado que maduró más rápido de lo que nadie esperaba. En tres años pasamos de “ChatGPT es IA” a un ecosistema con cinco o seis alternativas serias que atacan nichos específicos con mejor resultado.

Los problemas técnicos son reales: infraestructura bajo presión, el techo del preentrenamiento, y cambios de comportamiento que generan desconfianza entre usuarios avanzados. Pero el mayor cambio no es que ChatGPT empeoró, es que los demás mejoraron lo suficiente para que la comparación importe.

Para cualquiera que tome decisiones tecnológicas hoy: diversificar no es complicarse la vida. Las caídas de febrero y abril de 2026 demostraron que depender de un solo proveedor tiene un costo operativo concreto. El mercado de 2026 ofrece alternativas maduras. Usarlas tiene más sentido que la lealtad a una marca.

Fuentes

- Infobae – ChatGPT pierde usuarios frente a Gemini en los últimos 12 meses

- WWWhatsnew – Caída global de ChatGPT en abril 2026: API, Codex y alternativas

- Revista Cloud – OpenAI impone límites a generación de imágenes por saturación

- La Nación – Gemini vs ChatGPT vs Claude: los mejores modelos de IA en 2026

- Blog Donweb – ChatGPT empeorando en 2026: análisis