GPT (Generative Pre-trained Transformer) es una familia de modelos de lenguaje de gran escala desarrollada por OpenAI, diseñados para generar y procesar texto en lenguaje natural mediante aprendizaje profundo. La serie fue introducida en 2018 con GPT-1 y evolucionó hasta GPT-4o en 2024, siendo reemplazada en febrero de 2026 por la serie GPT-5, que unificó todos los modelos de ChatGPT bajo una nueva arquitectura. ChatGPT, el producto de consumo basado en GPT, alcanzó más de 300 millones de usuarios semanales activos en 2025 antes de registrar una caída de cuota de mercado de 22 puntos porcentuales hacia enero de 2026.

Ejemplo práctico

Martina Rodríguez, desarrolladora freelance de Buenos Aires, usaba GPT-4o para generar documentación técnica de APIs en menos de 8 minutos por endpoint. Cuando OpenAI migró forzosamente a GPT-5 en febrero de 2026, su flujo de trabajo colapsó: los mismos prompts que antes producían respuestas directas ahora devolvían análisis extensos de razonamiento que duplicaban el tiempo de revisión y, en varios casos, rechazaban fragmentos de código por considerarlos “potencialmente sensibles”. En un proyecto con 40 endpoints documentados, el tiempo total pasó de 5 horas a más de 11 horas, con 6 rechazos que requirieron reformulación manual.

Martina probó ajustar sus prompts para limitar el razonamiento extendido, pero GPT-5.2 Extended Thinking no ofrecía control granular sobre ese comportamiento en el plan que tenía contratado. Terminó migrando parte del flujo a otra herramienta para las tareas de documentación rutinaria, manteniendo GPT-5 solo para consultas de arquitectura complejas donde el razonamiento profundo sí agregaba valor.

Resultado: Al dividir tareas entre herramientas según complejidad, Martina recuperó un tiempo promedio de 6,5 horas por proyecto de 40 endpoints —un 41% más rápido que con GPT-5 solo— aunque a costa de mantener dos suscripciones activas en lugar de una.

Cómo funciona

- Fragmentación del mercado: A medida que nuevos modelos como Gemini, Claude y otros ganan tracción, los usuarios migran desde ChatGPT hacia alternativas que perciben como más estables o útiles, reduciendo la concentración del mercado en un solo proveedor.

- Transición forzada de modelos: OpenAI discontinúa versiones anteriores (como GPT-4o) y obliga a todos los usuarios a adoptar la nueva serie GPT-5, sin opciones de retorno, lo que genera fricción y rechazo en segmentos que preferían el comportamiento anterior.

- Saturación de infraestructura: La demanda masiva sobre los nuevos modelos provoca cuellos de botella: velocidades de generación muy bajas, tiempos de respuesta degradados y rechazos de solicitudes, especialmente en horarios pico.

- Optimización para benchmarks sobre usabilidad: Los modelos GPT-5.x se ajustan para rendir mejor en evaluaciones técnicas de razonamiento, lo que modifica su tono y comportamiento cotidiano, resultando en respuestas que muchos usuarios encuentran menos naturales o prácticas.

- Impacto reputacional acumulado: Decisiones corporativas como acuerdos con organismos gubernamentales generan controversia pública, acelerando desinstalaciones y erosionando la confianza de usuarios que antes eran fieles a la plataforma.

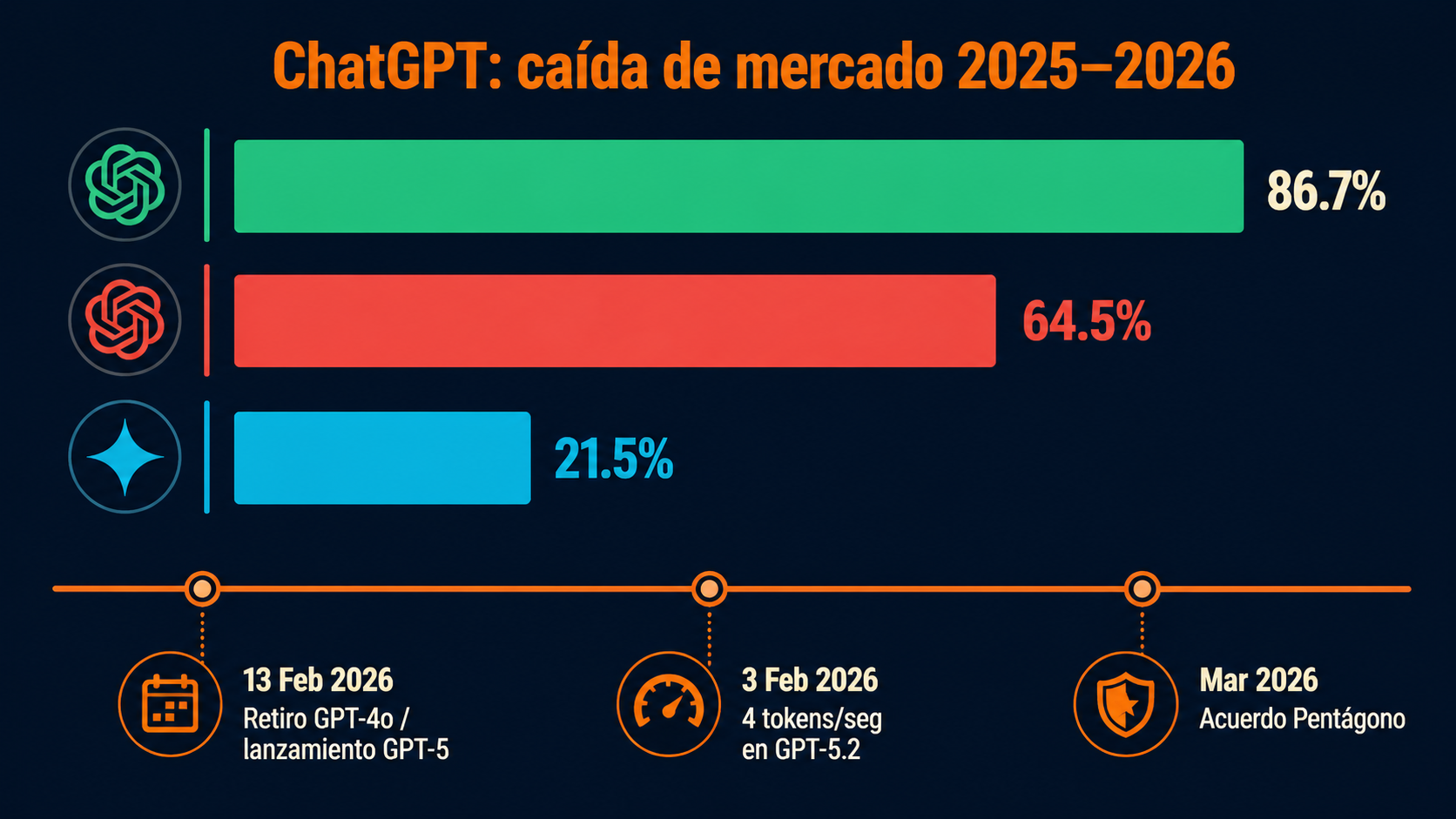

En pocas palabras: Sí, ChatGPT empeoró en 2026: perdió más de 22 puntos de cuota de mercado, pasando del 86.7% al 64.5% en enero de 2026. La transición forzada a GPT-5 en febrero, los colapsos de infraestructura y la optimización para benchmarks sobre utilidad práctica explican la caída.

ChatGPT está empeorando en 2026 y los datos lo confirman: la plataforma pasó de controlar el 86.7% del mercado de asistentes IA en 2025 a quedarse con el 64.5% en enero de 2026, según un informe de Infobea. La transición forzada a la serie GPT-5, los colapsos de infraestructura de febrero y los cambios de tono del modelo explican buena parte del malestar.

En 30 segundos

- ChatGPT perdió más de 22 puntos de cuota de mercado entre 2025 y enero de 2026, con Gemini subiendo al 21.5%.

- El 13 de febrero de 2026, OpenAI retiró GPT-4o y unificó todo bajo la serie GPT-5, generando quejas masivas de usuarios.

- GPT-5.2 Extended Thinking llegó a operar a 4 tokens por segundo en el pico de saturación de febrero.

- Los rechazos de solicitudes aumentaron con GPT-5.x, que OpenAI optimizó más para benchmarks de razonamiento que para utilidad práctica.

- El acuerdo con el Pentágono disparó desinstalaciones en marzo de 2026, según reportes de Infobea.

La caída del gigante: qué pasó con ChatGPT en 2026

ChatGPT es el asistente de inteligencia artificial conversacional de OpenAI, lanzado en noviembre de 2022 y que durante tres años dominó el mercado con una participación por encima del 80%. Lo que empezó como quejas dispersas en Reddit y Twitter se convirtió en tendencia global: #ChatGPTDown fue trending topic varias veces en febrero de 2026, y los reportes de degradación del servicio se acumularon en foros técnicos y comunidades de desarrolladores.

La caída no es solo de percepción. Es numérica. Pasar del 86.7% al 64.5% de cuota en menos de 12 meses es un desplome serio para cualquier producto, y más para uno que llegó a ser sinónimo del rubro. Gemini, que estaba marginalizado hace un año, hoy controla el 21.5% del mercado según análisis del sector.

¿Y qué explica este desplome? No una sola cosa. Es una combinación: cambios de modelo, problemas de infraestructura, decisiones de producto que priorizan seguridad sobre utilidad, y un contexto de competencia que ya no perdona errores.

Cambio de modelos: de GPT-4 a GPT-5.x

El 13 de febrero de 2026, OpenAI retiró GPT-4o del acceso estándar y unificó su oferta bajo la serie GPT-5. Según las notas de versión oficiales de OpenAI, la consolidación buscaba simplificar la experiencia del usuario evitando que tuviera que elegir entre GPT-4o, GPT-4o mini, o los distintos sabores de la serie 5.

El problema es que simplificar no siempre mejora. GPT-4o era un modelo con un perfil conocido: los usuarios sabían qué esperar, cómo redactar los prompts para sacarle partido, y en qué fallaba. La serie GPT-5 tiene una arquitectura diferente, con Extended Thinking integrado en algunas variantes, y ese cambio rompió flujos de trabajo que funcionaban bien.

Ponele que tenés un sistema de prompts armado durante meses para extraer JSON estructurado de documentos legales. Migrás a GPT-5.1, y de repente el modelo empieza a agregar texto explicativo que antes no ponía, o cambia el formato de salida sin que vos lo hayas pedido. No es que el modelo sea peor objetivamente (eso es debatible). Es que cambió el contrato implícito con el usuario.

Respuestas más cortas: el modelo que aprendió a resumir cuando no debía

Una de las quejas más consistentes en comunidades técnicas es la reducción de profundidad en las respuestas. Antes de la transición, si le pedías a ChatGPT que implementara una función de autenticación en Python, te daba el código completo con manejo de errores, validaciones y comentarios. Con GPT-5.x, varios usuarios reportan recibir esqueletos de código con comentarios del tipo # agregar lógica aquí. Más contexto en técnicas de prompting más avanzadas.

Esto tiene lógica desde adentro de OpenAI: los modelos con Extended Thinking tienden a ser más concisos en la salida porque el “razonamiento” ocurre en una etapa previa no visible. El modelo considera que ya procesó el problema y que dar una respuesta larga es redundante. Para benchmarks de razonamiento, eso es correcto. Para un desarrollador que necesita código funcional, es un problema.

El otro factor es que OpenAI ajustó en varias ocasiones los parámetros de longitud de respuesta durante 2025 (algo que quedó documentado en sus notas de versión), y algunos de esos ajustes claramente sobrecompensaron hacia la brevedad.

Lentitud extrema: 4 tokens por segundo en febrero de 2026

El colapso de febrero fue el punto más visible. Según Excelsior, el 3 de febrero de 2026 el servicio registró una caída masiva con latencias que llegaron a 4 tokens por segundo en GPT-5.2 Extended Thinking, cuando lo normal está entre 40 y 80 tokens por segundo dependiendo de la carga.

OpenAI reaccionó ese mismo día reduciendo el tiempo de razonamiento de Extended Thinking para aliviar la infraestructura. Al día siguiente, el 4 de febrero, restauró los tiempos originales una vez estabilizados los servidores. El parche funcionó, pero el daño reputacional ya estaba hecho: miles de usuarios en producción tuvieron horas de servicio degradado sin aviso previo.

La saturación de infraestructura no es sorpresa. El lanzamiento de GPT-5 atrajo a usuarios nuevos y reactivó a usuarios inactivos, todo al mismo tiempo que la arquitectura de Extended Thinking demanda más cómputo por query que los modelos anteriores. La ecuación es simple: más demanda, más cómputo por consulta, misma infraestructura. Algo tenía que ceder.

Más rechazos y menos cooperación

GPT-5.x llegó con un ajuste fino que priorizó los benchmarks de razonamiento y los parámetros de seguridad sobre lo que en OpenAI llaman “helpfulness” (ser un asistente útil). El resultado práctico: más refusals. Relacionado: soluciones empresariales más seguras.

Los usuarios que trabajan con contenido de marketing, análisis de competidores, redacción de contratos o simplemente con temas que rozan áreas grises reportan que el modelo ahora rechaza solicitudes que GPT-4o manejaba sin problema. No porque las solicitudes sean ilegales o dañinas, sino porque el nuevo threshold de seguridad es más conservador.

Esto no es accidental. Según análisis de profesionales en LinkedIn, los cambios de tono del modelo durante 2025 respondieron a presiones regulatorias y de imagen pública, no a feedback de usuarios de pago. El modelo se volvió más “cuidadoso” (entre comillas) a costa de ser menos directo y cooperativo.

¿Alguien validó esto de forma independiente con estudios controlados? Todavía no hay un paper peer-reviewed específico sobre la degradación de GPT-5.x en tareas de asistencia. Pero los patrones de queja son demasiado consistentes como para ignorarlos.

Competencia emergente: Gemini y el contexto del mercado

Mientras ChatGPT perdía terreno, Gemini subió del 8-9% de cuota que tenía a principios de 2025 al 21.5% en enero de 2026. Es el primer competidor que logra quitarle cuota real a OpenAI, no solo usuarios marginales.

El timing no es inocente. Gemini mejoró justo cuando ChatGPT empeoró su experiencia de usuario. Los usuarios que probaron la transición a GPT-5 y quedaron disconformes tenían una alternativa que antes no era tan sólida.

Hubo otro golpe en marzo de 2026: OpenAI firmó un acuerdo con el Pentágono para uso de sus modelos en aplicaciones de defensa. Las desinstalaciones de la app se dispararon después del anuncio, especialmente entre usuarios que asociaban a OpenAI con una postura más alineada con valores de apertura tecnológica. Es un factor difícil de cuantificar en términos de uso real, pero el sentimiento importa.

Qué dicen los usuarios en redes y comunidades

Las quejas no son abstractas. En febrero, #ChatGPTDown fue tendencia múltiples veces. En Reddit, hilos como “Is it just me or is ChatGPT being a dick lately?” (sin ironía, ese es el título real que circuló) acumularon miles de respuestas con patrones coincidentes: respuestas más cortas, más rechazos, más lentitud, cambio de “personalidad” del modelo. En modelos de IA más especializados profundizamos sobre esto.

Lo interesante es que no son solo usuarios casuales. Desarrolladores y equipos técnicos que usan la API reportan el mismo fenómeno: migrar a GPT-5.x rompió workflows que funcionaban bien con GPT-4o. Algunos volvieron a versiones anteriores donde estaban disponibles, otros exploraron alternativas.

La experiencia del usuario y la experiencia del desarrollador divergieron. Para el primero, el problema es subjetivo pero real: el modelo “se siente diferente”. Para el segundo, hay métricas concretas: más tokens para la misma tarea, más latencia, más rechazos que hay que manejar en el código.

Cuadro comparativo: ChatGPT antes y después del cambio

| Aspecto | GPT-4o (hasta feb 2026) | GPT-5.x (desde feb 2026) |

|---|---|---|

| Velocidad promedio | 40-80 tokens/seg | 4-60 tokens/seg (variable, con picos de saturación) |

| Longitud de respuestas | Respuestas multi-párrafo en consultas complejas | Tendencia a respuestas más cortas, especialmente en código |

| Frecuencia de refusals | Moderada | Alta, especialmente en temas de contenido limítrofe |

| Cuota de mercado OpenAI | 86.7% (2025) | 64.5% (enero 2026) |

| Competidor principal | Gemini ~8-9% | Gemini 21.5% |

| Disponibilidad | Estable | Caídas documentadas en febrero 2026 |

Qué está confirmado / Qué no

Confirmado

- La caída de cuota de mercado de 86.7% a 64.5% entre 2025 y enero 2026 (fuente: Infobea, enero 2026).

- El retiro de GPT-4o el 13 de febrero de 2026 y la unificación bajo GPT-5 (fuente: notas de versión oficiales de OpenAI).

- Los problemas de velocidad el 3-4 de febrero, incluyendo la reducción temporal de tiempos de razonamiento por parte de OpenAI (fuente: Excelsior, reportes de usuarios).

- El aumento de desinstalaciones post-acuerdo con el Pentágono en marzo de 2026 (fuente: Infobea, marzo 2026).

No confirmado / con reservas

- La magnitud exacta del aumento de refusals no tiene medición independiente publicada. Los reportes son consistentes pero anecdóticos.

- Si la reducción de profundidad en respuestas es un cambio intencional de política o un efecto colateral de la arquitectura Extended Thinking. OpenAI no lo aclaró.

- Cuánto del abandono se explica por el acuerdo con el Pentágono versus la degradación técnica. Difícil separar las variables.

Errores comunes cuando evaluás si ChatGPT empeoró

Error 1: Comparar GPT-5 con GPT-4o para el mismo prompt sin ajustar. GPT-5.x con Extended Thinking procesa diferente. Un prompt optimizado para GPT-4o puede dar resultados subóptimos en GPT-5 no porque el modelo sea peor, sino porque el estilo de interacción cambió. Antes de concluir que empeoró, probá reformulando.

Error 2: Asumir que la lentitud es permanente. Los picos de 4 tokens/seg fueron durante la saturación de febrero. La velocidad promedio normalizó después del 4 de febrero. Si te quejás de lentitud hoy, verificá que no sea tu conexión o un problema puntual antes de atribuírselo al modelo.

Error 3: Generalizar la experiencia de la versión gratuita a la de pago. ChatGPT Plus y la API tienen prioridad de recursos. Los colapsos de febrero afectaron más a usuarios free. Si tomás reportes de usuarios gratuitos como representativos de la calidad del servicio completo, la comparación no es justa. Complementá con usos creativos de GPT.

Si te pasó lo mismo con ChatGPT, acá tenemos todo lo que pasó en Is it just me or is ChatGPT being a dick lately?.

Preguntas Frecuentes

¿Por qué ChatGPT está empeorando en 2026?

La degradación percibida responde a tres factores simultáneos: la transición forzada de GPT-4o a GPT-5.x en febrero de 2026, los problemas de infraestructura que generaron lentitud extrema durante ese mismo mes, y ajustes en los parámetros del modelo que priorizan benchmarks de seguridad sobre comportamiento de asistente útil. Los datos de cuota de mercado confirman que no es solo percepción: OpenAI pasó del 86.7% al 64.5% en menos de 12 meses.

¿Qué cambió en ChatGPT con GPT-5?

GPT-5 incorpora Extended Thinking en algunas variantes, lo que cambia cómo el modelo procesa y responde consultas complejas. La salida tiende a ser más concisa porque el razonamiento ocurre en una etapa previa no visible para el usuario. Además, GPT-5.x tiene un threshold de seguridad más alto que GPT-4o, lo que se traduce en más rechazos para solicitudes en áreas grises. OpenAI retiró GPT-4o el 13 de febrero de 2026 y unificó todo bajo la serie 5.

¿Por qué ChatGPT es tan lento ahora?

El pico de lentitud ocurrió el 3 de febrero de 2026, cuando GPT-5.2 Extended Thinking llegó a 4 tokens por segundo por saturación de infraestructura. OpenAI redujo temporalmente los tiempos de razonamiento y restauró la velocidad el 4 de febrero. Fuera de ese episodio, la lentitud relativa respecto a GPT-4o se explica porque Extended Thinking demanda más cómputo por consulta.

¿ChatGPT ahora rechaza más solicitudes que antes?

Sí, según reportes consistentes de usuarios y análisis de profesionales del sector. GPT-5.x fue ajustado con un threshold de seguridad más conservador que GPT-4o, lo que aumenta la frecuencia de refusals en contenido limítrofe. No hay un benchmark independiente publicado que cuantifique el aumento exacto, pero el patrón es demasiado consistente en múltiples comunidades como para descartarlo.

¿Vale la pena cambiar a Gemini u otra alternativa?

Depende del caso de uso. Gemini subió al 21.5% de cuota de mercado en enero de 2026 y mejoró en tareas de razonamiento y generación de código. Para workflows que se rompieron con la transición a GPT-5.x, probar Gemini tiene sentido. Dicho esto, ninguna alternativa es superior en todos los aspectos, y migrar un sistema en producción tiene costos propios. La recomendación es evaluar con los prompts reales que usás antes de decidir.

Conclusión

ChatGPT no se rompió, pero sí cambió. Y cambió de formas que a muchos usuarios les resultaron negativas: respuestas más cortas, más rechazos, un colapso de infraestructura mal gestionado en febrero, y una transición de modelo que rompió flujos de trabajo sin aviso adecuado. La pérdida de 22 puntos de cuota de mercado en 12 meses no se explica solo por las mejoras de Gemini, sino también por decisiones propias de OpenAI que priorizaron otras variables sobre la experiencia del usuario.

Lo que sigue es incierto. OpenAI tiene los recursos y el talento para corregir el rumbo, y los ajustes de febrero mostraron que pueden reaccionar rápido cuando el problema es técnico. El desafío más complicado es el estructural: recuperar la confianza de usuarios que ya migraron, y encontrar el balance entre seguridad y utilidad que GPT-5.x todavía no terminó de resolver.

Si sos desarrollador o equipo que decidís qué herramienta usar, el consejo práctico es este: no migres ni te quedes por inercia. Probá las tareas críticas de tu workflow en ambos modelos con datos reales. La herramienta que funciona mejor para tu caso específico es la correcta, independientemente de quién lidera el mercado.

¿Es ChatGPT todavía útil en 2026?

Sí, ChatGPT sigue siendo útil, pero con limitaciones nuevas: respuestas más cortas, lentitud ocasional y más rechazos. GPT-5.x optimiza benchmarks de razonamiento sobre practicidad. Si tu workflow dependía de GPT-4o, probablemente necesites ajustar prompts o considerar alternativas como Gemini o Claude.

¿Cuál es la mejor alternativa a ChatGPT ahora?

Gemini es la que más creció (21.5% de cuota en enero 2026). Otros como Claude, Copilot o LLaMA también ganaron tracción. La mejor alternativa depende de tu caso de uso: Gemini si necesitás velocidad, Claude si valorás seguridad y precisión, LLaMA si querés privacidad en local.

¿OpenAI arregló los problemas de infraestructura de febrero?

OpenAI estabilizó los servidores después del colapso del 3-4 de febrero, reduciendo el tiempo de Extended Thinking temporalmente. Sin embargo, el daño reputacional persiste: usuarios en producción reportan lentitud variable y comportamientos inconsistentes en GPT-5.x hasta hoy.