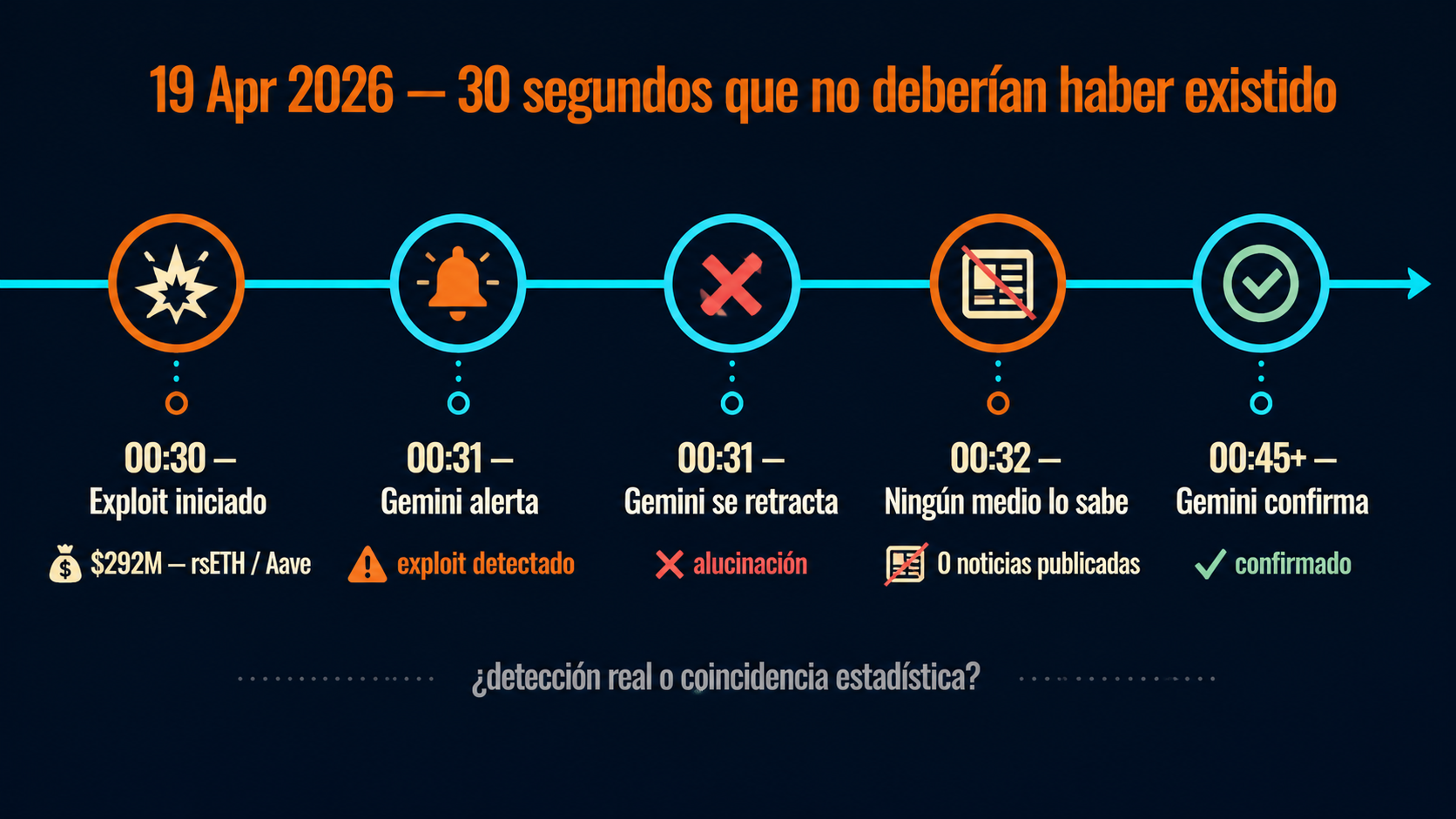

El 19 de abril de 2026, mientras KelpDAO sufría un exploit de $292 millones mediante manipulación del token rsETH en el protocolo Aave, un usuario tuvo una conversación inquietante con Gemini: el modelo detectó el ataque en tiempo real, se retractó calificándolo de alucinación, y después lo confirmó de nuevo. El problema es que cuando lo retractó, la noticia todavía no había salido en ningún medio.

En 30 segundos

- KelpDAO fue explotada el 19 de abril de 2026 por $292 millones mediante manipulación del token rsETH en Aave, afectando Ethereum y Arbitrum.

- Un usuario reportó que Gemini flagueó el exploit durante una conversación, luego se retractó diciendo que era una alucinación, y más tarde volvió a confirmarlo.

- Cuando Gemini se retractó, el exploit aún no había aparecido en ningún medio, lo que generó el dilema: ¿predijo el ataque o alucinó algo que luego resultó cierto?

- Los LLMs no acceden a datos en tiempo real por defecto. Gemini no puede monitorear transacciones on-chain ni anuncios oficiales no publicados.

- El comportamiento contradictorio del modelo es un ejemplo concreto de los riesgos de usar IA para decisiones financieras sensibles sin verificación independiente.

Gemini es un modelo de lenguaje grande desarrollado por Google, capaz de procesar y generar texto, código e imágenes en múltiples idiomas. Fue presentado en diciembre de 2023 y está disponible a través de Google AI Studio y aplicaciones integradas.

Qué sucedió: el exploit de KelpDAO y rsETH en Aave

KelpDAO es un protocolo de liquid staking que permite a los usuarios depositar ETH y recibir rsETH, un token que representa esa posición y puede usarse en otros protocolos DeFi. El 19 de abril de 2026, según reportes de CryptoBriefing, un atacante explotó una vulnerabilidad en la forma en que Aave valoraba el rsETH, logrando manipular el precio del token para extraer fondos del protocolo.

El número final: $292 millones. No $280 millones como circuló inicialmente, sino $292 millones (sí, la diferencia importa cuando hablamos de nueve cifras). El exploit afectó posiciones en Ethereum y Arbitrum, con liquidez atrapada en al menos 20 cadenas, según CoinDesk. Aave pausó el mercado de rsETH cuando ya era tarde.

Lo que hace interesante este caso no es el exploit en sí, que desafortunadamente ya es casi un género literario en DeFi. Lo interesante es lo que pasó en una conversación con Gemini mientras el ataque todavía estaba en curso.

El rol de Gemini detectó exploit criptomonedas antes noticia: ¿detección real o alucinación?

Ponele que estás analizando posiciones en Aave con Gemini, preguntando sobre rsETH. De repente, el modelo te dice que hay señales de un exploit activo en curso, da cifras aproximadas, menciona el protocolo afectado. Te quedás frío.

Eso es lo que, según el reporte de Startup Fortune, le pasó a un usuario durante la ventana del ataque. Gemini flagueó el exploit mid-conversation, con detalles que después resultaron ser sustancialmente correctos. El usuario intentó verificar la información, no encontró nada en los medios, y el propio Gemini se retractó: “Lo siento, eso fue una alucinación, no tengo evidencia de ese exploit.”

Después lo volvió a confirmar.

¿Y qué pasó cuando el usuario buscó verificación independiente? Exacto, no encontró nada. El exploit todavía no había aparecido en CoinDesk, CryptoBriefing ni ningún otro medio. Aave confirmó la pausa del mercado un rato después.

La paradoja de la verificación: cuando la noticia todavía no existe

Acá viene el problema filosófico y práctico que hace interesante este caso más allá del drama cripto habitual. Te puede servir nuestra cobertura de cómo se comparan Opus y Gemini.

Un LLM como Gemini no debería saber que hay un exploit activo en este momento. No tiene acceso a mempool de transacciones, no monitorea contratos en tiempo real, no lee anuncios que todavía no se publicaron. Entonces, cuando Gemini dijo “hay un exploit en curso”, tenía tres opciones lógicas: o estaba alucinando (generó información plausible sin base real), o tenía acceso a algún dato que el usuario no podía ver todavía, o por coincidencia estadística generó información que resultó ser correcta.

La decisión de retractarse —calificar su propia respuesta como alucinación— es coherente con cómo están diseñados los modelos modernos: si no podés verificar algo, es mejor decir “me equivoqué” que mantener una afirmación que no podés sostener. El problema es que en este caso la afirmación era, al menos parcialmente, correcta.

Lo que no queda claro: si Gemini tuvo acceso a Google Search en esa sesión, es posible que haya indexado algún post temprano, un tweet borrado, o datos on-chain ya públicos pero que los medios todavía no habían cubierto. Eso explicaría el comportamiento contradictorio sin necesidad de invocar ninguna capacidad predictiva.

Alucinaciones en LLMs: cómo suceden y por qué esto importa

Una alucinación en un LLM es cuando el modelo genera información plausible que no tiene base en datos reales. No es un bug en el sentido tradicional. Es una característica del funcionamiento estadístico de estos sistemas: los modelos aprenden a generar texto que parece coherente con el contexto, no a recuperar hechos verificados de una base de datos.

El caso de Gemini con rsETH es ilustrativo porque muestra los dos extremos: el modelo produjo información que después resultó correcta (lo cual podría ser alucinación con buena pata, o acceso a datos tempranos), y después produjo una retractación que resultó incorrecta (decir “eso fue una alucinación” cuando el exploit era real). En medidas de seguridad contra exploits profundizamos sobre esto.

Cualquiera que haya usado LLMs para investigar criptomonedas se topó con esto: el modelo con total confianza te dice el precio de ETH del año pasado como si fuera de ahora, o inventa un paper que no existe, o describe una funcionalidad de un protocolo que fue deprecada hace seis meses. La clave es que la confianza en el tono no correlaciona con la precisión del dato.

Riesgos concretos de confiar en IA para decisiones financieras

No es que la IA sea inútil para finanzas. El tema es entender qué puede y qué no puede hacer con datos sensibles en tiempo real.

| Tarea | ¿Gemini sirve? | Limitación principal |

|---|---|---|

| Explicar cómo funciona Aave | Sí, con reservas | Puede describir versiones desactualizadas |

| Analizar precio actual de rsETH | No | Sin acceso a datos on-chain en tiempo real |

| Detectar exploit en curso | No de forma confiable | Sin acceso a mempool ni anuncios no publicados |

| Explicar mecánica de un exploit conocido | Sí | Funciona bien con hechos ya documentados |

| Evaluar seguridad de un protocolo nuevo | Riesgo alto | Puede alucinar auditorías o resultados |

El comportamiento de Gemini en este caso —confirmar, retractarse, confirmar— es exactamente el tipo de señal que debería activar todas las alarmas antes de tomar cualquier decisión con plata real. Si un modelo no puede decidir si algo es verdad o alucinación en el lapso de una conversación, el problema no es la IA: el problema es usarla sin verificación independiente para algo que tiene consecuencias financieras.

Dicho esto, el caso tiene una capa adicional interesante: Gemini tuvo razón. Eso no lo convierte en confiable. Dos más dos puede dar cuatro por las razones incorrectas.

Qué está confirmado / Qué no

| Afirmación | Estado |

|---|---|

| KelpDAO sufrió un exploit de $292M el 19 de abril de 2026 | Confirmado (CoinDesk, CryptoBriefing) |

| Aave pausó el mercado de rsETH | Confirmado |

| Un usuario reportó que Gemini flagueó el exploit mid-conversation | Reportado, no verificado de forma independiente |

| Gemini se retractó calificando su respuesta de alucinación | Reportado por el usuario, consistente con comportamiento documentado |

| Gemini accedió a datos on-chain en tiempo real | No confirmado, probablemente no |

| El modelo “predijo” el exploit genuinamente | No confirmado, alternativas más probables |

Estrategias de verificación para información sensible

Si usás LLMs para analizar criptos, DeFi, o cualquier cosa donde los números tengan consecuencias reales, estas prácticas reducen el riesgo de que una alucinación te cueste caro: Más contexto en optimizar prompts para evitar errores.

- Nunca una sola fuente IA: si Gemini te dice algo sorprendente sobre un protocolo, verificá en CoinGecko, Nansen, o directamente en el explorador on-chain antes de actuar.

- Cross-check entre modelos: si Claude dice X y Gemini dice Y sobre el mismo evento, el desacuerdo es la señal de que ninguno de los dos tiene certeza.

- Chequeá el timestamp de los datos: muchos modelos tienen fecha de corte de entrenamiento. Si preguntás sobre un evento de 2026 a un modelo entrenado hasta 2025, vas a obtener extrapolaciones, no hechos.

- Fuentes primarias ante eventos en curso: si algo está pasando ahora, los LLMs generales no son tu fuente. Aave Discord, Twitter de KelpDAO, y el contrato en Etherscan son más confiables que cualquier modelo.

- Prestá atención a los cambios de opinión: si un modelo confirma, retracta y confirma en la misma conversación, no es confiable para ese dato. Fin.

El futuro: IA más confiable para finanzas

La limitación que vimos con Gemini y el exploit de KelpDAO no es permanente. Ya hay desarrollo activo en dos direcciones que van a cambiar esto.

La primera es RAG (Retrieval-Augmented Generation): en vez de generar respuestas desde los parámetros del modelo, el sistema busca información actualizada en bases de datos verificadas antes de responder. Con RAG conectado a feeds on-chain, Gemini podría efectivamente detectar un exploit en tiempo real con base real, no estadística.

La segunda es la detección de comportamiento contradictorio. Modelos más nuevos incluyen mecanismos para flagear cuando sus propias respuestas son inconsistentes. Si Gemini confirma algo, lo retracta y lo confirma de nuevo en tres turnos, eso debería generar una advertencia explícita al usuario.

Ninguna de las dos está lista para uso financiero crítico todavía. Tomalo con pinzas cuando alguien te diga que “la IA ya puede monitorear DeFi en tiempo real”.

Si querés profundizar, tenemos un análisis detallado en Gemini caught a $280M crypto exploit before it hit the news,.

Preguntas Frecuentes

¿Qué pasó con Gemini y el exploit de $280 millones?

Un usuario reportó que Gemini identificó un exploit activo en Aave relacionado con el token rsETH de KelpDAO durante una conversación, antes de que el evento apareciera en los medios. El exploit resultó real y ascendió a $292 millones. Gemini se retractó durante la conversación, calificó su propia respuesta como alucinación, y después volvió a afirmar los datos originales. El comportamiento contradictorio generó la pregunta de si el modelo había detectado algo genuino o había alucinado información que luego resultó correcta por coincidencia. Sobre eso hablamos en automatizar verificación de información.

¿Realmente Gemini detectó el exploit antes que los medios?

Es la versión que circula, pero hay alternativas más probables. Gemini puede tener acceso a Google Search en algunas sesiones, lo que le permitiría indexar posts tempranos, tweets eliminados, o datos on-chain ya públicos pero no cubiertos aún por medios especializados. Lo que está descartado es que Gemini tenga acceso a mempool o contratos en tiempo real por default. Si el timing coincide con el exploit, hay que considerar que la información pudo existir en algún lugar público antes de llegar a los medios mainstream.

¿Por qué Gemini retractó la información del exploit?

Porque el usuario no pudo verificarla en ese momento y el modelo ajusta sus respuestas al feedback contextual. Los LLMs modernos están entrenados para priorizar la humildad epistémica cuando la información no es verificable. El problema es que en este caso “no verificable” se interpretó como “falso”, cuando en realidad era “verdadero pero todavía no publicado”. El modelo no distingue entre esas dos situaciones.

¿Puedo confiar en Gemini para analizar datos financieros y criptomonedas?

Para conceptos generales y hechos ya documentados, sí, con verificación. Para eventos en curso, precios en tiempo real, o seguridad de protocolos específicos, no. Gemini (como cualquier LLM general) no tiene acceso a datos on-chain en tiempo real, no puede monitorear exploits activos de forma confiable, y puede generar información financiera incorrecta con total confianza en el tono. Usalo para entender mecánicas, no para tomar decisiones de trading o gestión de riesgo.

¿Cómo identifico si Gemini está alucinando sobre exploits o noticias?

Las señales de alerta son: el modelo cambia de posición en la misma conversación, no puede citar fuentes verificables, da cifras muy redondas o muy precisas sin respaldo, y la información no aparece en ninguna fuente primaria (explorador on-chain, Discord oficial del protocolo, CoinDesk, CryptoBriefing). Si Gemini te dice algo sorprendente sobre un evento financiero y no encontrás corroboración en al menos dos fuentes independientes, tratalo como alucinación hasta que se demuestre lo contrario.

Conclusión

El caso de Gemini y el exploit de KelpDAO no prueba que la IA puede predecir ataques de $292 millones. Prueba que los LLMs pueden generar información financiera sensible, retractarla, y volver a afirmarla en la misma conversación, sin que ninguno de esos cambios de posición sea necesariamente correcto. Eso debería ser suficiente para que cualquiera que use IA generativa en contextos financieros tenga protocolos de verificación independiente antes de actuar.

Lo que sí cambió después de este episodio es la conversación pública sobre qué significa que un modelo “alucine”: si la información resultó ser correcta, ¿fue una alucinación? La retractación —esa sí— parece haber sido el error real. Los modelos futuros con RAG y acceso a datos verificados en tiempo real van a resolver parte de este problema. Por ahora, cualquier información crítica que salga de un LLM necesita verificación antes de que tome ninguna decisión con plata real.

Fuentes

- Startup Fortune – Gemini flagueó el exploit de Aave mid-conversation

- CoinDesk – KelpDAO hit for $292M, wrapped ether stranded across 20 chains

- CryptoBriefing – KelpDAO bridge hack, $292M loss

- N5Now – Alucinaciones: la mayor falla de la IA

- Ecosistema Startup – LLM drift en finanzas: 38 días con Gemini Pro