GPT-Realtime-2 es el modelo de voz de OpenAI con capacidades de razonamiento GPT-5, lanzado en mayo de 2026 como parte de la nueva generación de la Realtime API. Las pruebas de herramientas de GPT-Realtime-2 confirman que el modelo ejecuta llamadas paralelas a múltiples herramientas dentro de una misma respuesta de voz, con una ventana de contexto de 128K tokens y mejoras medibles en benchmarks de tool calling respecto a su predecesor.

En 30 segundos

- OpenAI lanzó GPT-Realtime-2 en mayo de 2026 junto con otros dos modelos de audio: gpt-realtime-translate y gpt-realtime-whisper.

- El modelo sube de 32K a 128K tokens de contexto, lo que habilita sesiones de voz largas con historial completo.

- En ComplexFuncBench, según benchmarks de abril/mayo 2026, GPT-Realtime-2 alcanzó 66.5% frente al 49.7% de la versión anterior, un salto de casi 17 puntos.

- Zillow reportó una mejora de 26 puntos en métricas de herramientas al migrar a este modelo en pruebas de abril 2026.

- El pricing es $32/M tokens de audio input, $0.40 para cached input, y $64/M para output, a partir de mayo 2026.

Qué es GPT-Realtime-2 y sus capacidades principales

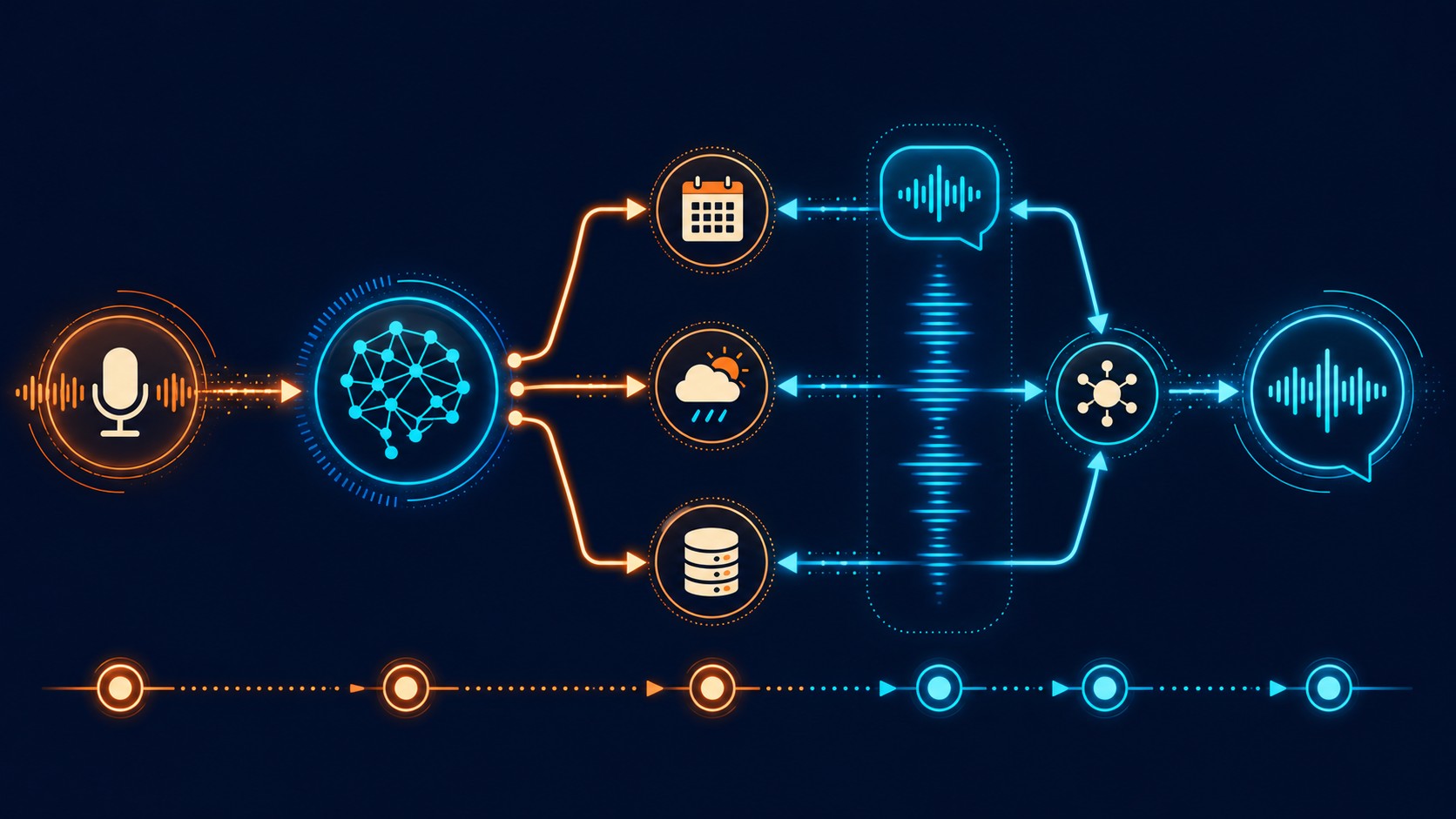

GPT-Realtime-2 es el último modelo de voz de OpenAI integrado en la Realtime API, diseñado para manejar conversaciones de audio en tiempo real con capacidades de razonamiento equivalentes a GPT-5. Reemplaza a gpt-realtime-1.5 y trae tres cambios estructurales: soporte para llamadas paralelas a herramientas, contexto expandido de 128K tokens, y manejo de interrupciones del usuario sin perder el hilo de la conversación.

OpenAI lo lanzó junto con dos modelos complementarios: gpt-realtime-translate (para traducción de voz en tiempo real) y gpt-realtime-whisper (transcripción mejorada). Pero el que importa para los casos de uso de agentes es claramente GPT-Realtime-2.

Lo que diferencia a este modelo de sus predecesores no es solo la potencia bruta de razonamiento. El detalle técnico que más le interesa a quien desarrolla agentes de voz es el ajuste dinámico de tono: el modelo puede leer el contexto emocional de una conversación y cambiar su respuesta en consecuencia, sin que el desarrollador lo configure explícitamente.

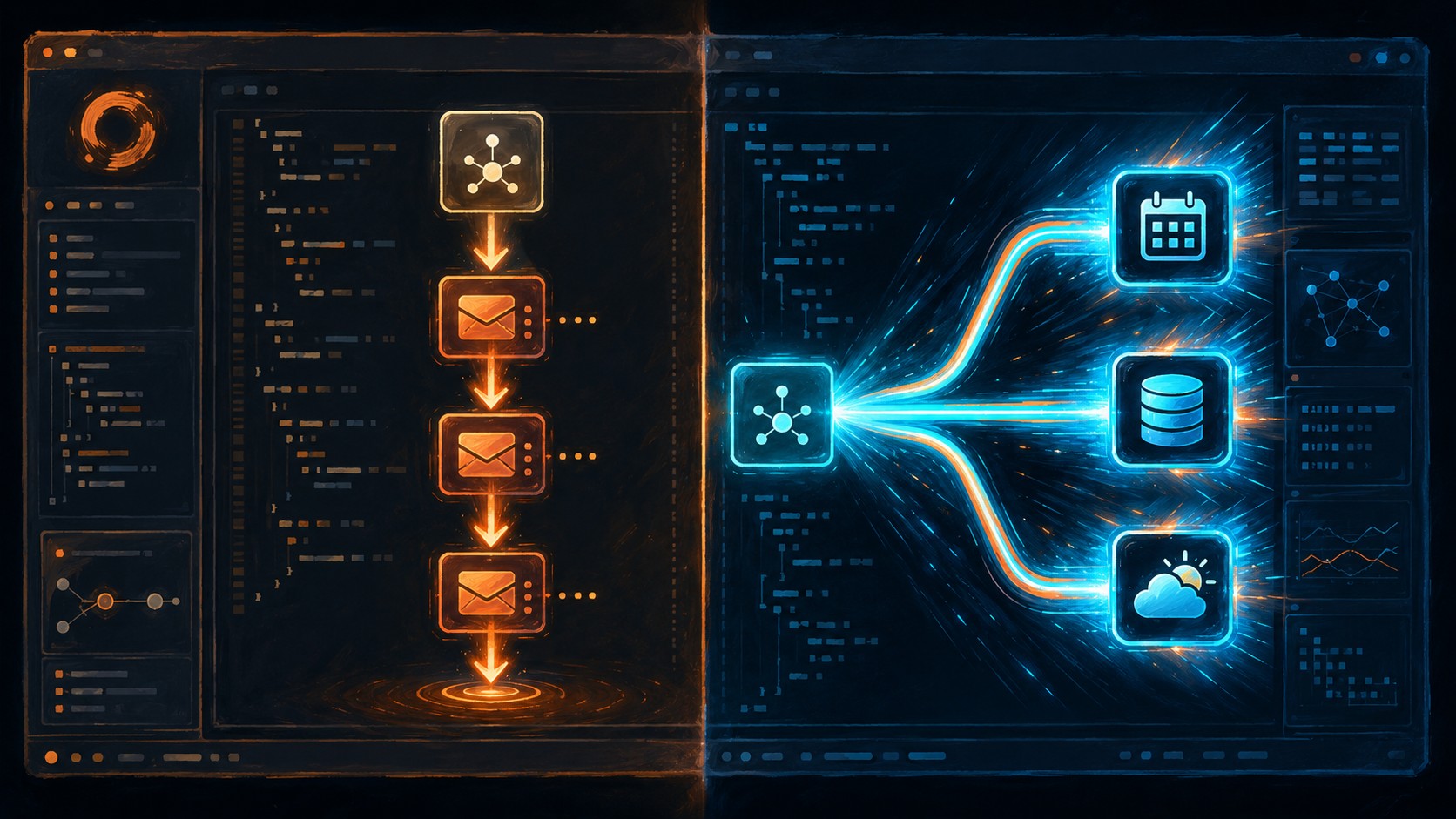

Mejoras en tool calling: llamadas paralelas y benchmark

Acá viene lo bueno. Según el anuncio oficial de OpenAI, GPT-Realtime-2 puede ejecutar múltiples llamadas a herramientas en paralelo dentro de una sola respuesta de voz. En la versión anterior, si una consulta requería datos de dos fuentes distintas, el modelo tenía que secuenciar las llamadas. Ahora puede lanzarlas al mismo tiempo.

El benchmark que usan es ComplexFuncBench. GPT-Realtime-2 logró 66.5% contra el 49.7% de Realtime-1.5, según benchmarks de abril/mayo 2026. Son casi 17 puntos porcentuales de diferencia en un benchmark que justamente está armado para estresar el manejo de herramientas complejas (parámetros anidados, llamadas encadenadas, validación de tipos).

Zillow lo probó en producción en abril 2026 y publicó sus métricas: 26 puntos de mejora en sus indicadores de tool calling al migrar desde la versión anterior. No es un caso de laboratorio. Es una empresa con millones de usuarios probando en producción. Relacionado: en nuestra comparativa detallada de modelos.

Otro detalle que suma a la experiencia del usuario: los “preambles”. Antes de ejecutar una herramienta, el modelo puede decir algo como “dejame revisar eso” o “un segundo” mientras procesa. (Sí, en serio, el modelo aprende a comprar tiempo como cualquier humano en una llamada.) Esto reduce la sensación de silencio incómodo durante la ejecución de herramientas.

Contexto en vivo: de 32K a 128K tokens

La ventana de contexto de Realtime-1.5 era de 32K tokens. GPT-Realtime-2 la cuadruplica a 128K. Para conversaciones cortas no cambia nada. Para sesiones largas o agentes que mantienen contexto de una sesión entera, la diferencia es concreta: podés mantener el historial completo de una reunión de una hora sin tener que truncar ni resumir.

El manejo de interrupciones también mejoró. Si el usuario corta al modelo a mitad de una respuesta, GPT-Realtime-2 incorpora ese corte al contexto en lugar de simplemente descartar lo que iba a decir. Esto permite que el agente ajuste su respuesta siguiente teniendo en cuenta que fue interrumpido, lo cual es relevante para flujos de negociación o asistencia técnica donde la interrupción suele ser una señal de urgencia.

Cómo probar GPT-Realtime-2 sin código: Playground de OpenAI

Si querés ver el modelo en acción antes de escribir una línea de código, el Playground de OpenAI es el camino más corto. El acceso está en platform.openai.com, sección “Playground”, seleccionando el modo “Realtime” en el menú de modelo.

Una vez adentro, podés configurar tres parámetros clave antes de arrancar la sesión:

- Reasoning effort: low, medium o high. Para tool calling complejo usá medium o high; low es para respuestas de conversación simple donde la latencia importa más.

- System prompt: donde definís el comportamiento base del agente y las instrucciones de tono.

- Tools: el Playground te deja agregar herramientas con schema JSON sin salir de la interfaz.

Para testear tool calling básico, definí una herramienta sencilla (por ejemplo, una función que devuelve el clima de una ciudad con un parámetro de ciudad) y preguntá algo que la dispare. Después agregá una segunda herramienta y formulá una pregunta que requiera ambas. Ahí vas a ver si el modelo las llama en paralelo o en secuencia. Cubrimos ese tema en detalle en frente a alternativas como Claude.

Integración en aplicaciones: API, SDK y capacidades extendidas

Para integrar GPT-Realtime-2 en una aplicación, el punto de entrada es la Realtime API de OpenAI con el SDK oficial. El setup de sesión define el modelo, las herramientas disponibles, el prompt de sistema y el nivel de razonamiento. La documentación oficial de la Realtime API tiene los ejemplos de inicialización de sesión.

Lo que agregó esta versión en términos de capacidades de integración:

- Soporte para MCP servers remotos: podés conectar herramientas externas vía Model Context Protocol sin tener que implementarlas localmente.

- Entrada de imágenes: el modelo puede recibir imágenes como parte del contexto, útil para agentes de soporte visual o flujos que combinan análisis de documentos con conversación.

- SIP phone calling: integración directa con sistemas de telefonía IP, lo que abre el modelo para call centers y aplicaciones de voz empresarial.

Si usás Codex para generar el código de integración, el contexto del modelo que le pasés importa. Incluí el schema completo de tus herramientas y un ejemplo de conversación con interrupciones para que el código generado maneje esos casos desde el arranque.

Escenarios de testing: qué probar y qué suele romperse

Ponele que migrás un agente de soporte que ya funciona con Realtime-1.5. Hay tres escenarios que tenés que estresar específicamente antes de ir a producción.

Interrupciones a mitad de respuesta

Probá cortar al modelo justo cuando está en medio de una explicación larga. El comportamiento esperado es que GPT-Realtime-2 registre la interrupción y la tenga en cuenta para lo siguiente. Si el agente simplemente ignora que fue interrumpido y sigue el script original, hay algo mal en cómo configuraste el manejo de turn_detection en el setup de sesión.

Herramientas en paralelo

Formulá una pregunta que requiera consultar dos fuentes distintas, por ejemplo: “¿Cuál es el estado de mi pedido 1234 y cuánto me queda de saldo en la cuenta?” Si el modelo hace las dos llamadas al mismo tiempo, el paralelismo está activo. Si las hace en secuencia, revisá si tu schema de herramientas tiene dependencias implícitas que el modelo esté interpretando como bloqueantes.

¿Y qué pasa si alguna herramienta falla a mitad de una llamada paralela? En los tests iniciales esto generó respuestas incompletas sin notificación de error. Hay que manejar explícitamente los casos de falla en el callback de las herramientas.

Ajuste de tono según contexto emocional

Para probar esto, armá una sesión donde el usuario exprese frustración explícita (“esto no me está funcionando, llevo una hora con esto”). El modelo debería cambiar hacia un tono más directo y empático. Si la respuesta sigue siendo igual de neutral que ante una consulta rutinaria, el sistema prompt no está configurado para habilitar ese ajuste, o el reasoning effort está en low. Sobre eso hablamos en sin disparar los costos de testing.

Tabla comparativa: GPT-Realtime-2 vs Realtime-1.5

| Característica | Realtime-1.5 | GPT-Realtime-2 |

|---|---|---|

| Ventana de contexto | 32K tokens | 128K tokens |

| Llamadas a herramientas paralelas | No | Sí |

| ComplexFuncBench | 49.7% | 66.5% |

| Preambles (“dejame revisar”) | No | Sí |

| Ajuste de tono emocional | Limitado | Sí |

| Manejo de interrupciones | Básico | Mejorado |

| Soporte MCP remoto | No | Sí |

| Entrada de imágenes | No | Sí |

| SIP phone calling | No | Sí |

| Audio input (por M tokens) | $20 | $32 |

| Audio output (por M tokens) | $40 | $64 |

Pricing y limitaciones conocidas

El costo subió respecto a Realtime-1.5. Según DataCamp, los precios a partir de mayo 2026 son $32/M tokens de audio input, $0.40/M para input cacheado, y $64/M para output de audio. Para aplicaciones con mucho contexto repetido entre sesiones, el caching puede reducir bastante el costo neto, pero hay que implementarlo explícitamente.

Lo que no está completamente resuelto (tomalo con pinzas hasta que salgan actualizaciones): hay un issue documentado con parámetros de objeto anidados en el schema de herramientas. Específicamente, herramientas con objetos dentro de objetos dentro de arrays pueden generar respuestas con tipos incorrectos en ciertas combinaciones de reasoning effort. El workaround por ahora es aplanar el schema donde sea posible y validar el output antes de procesar.

Si venís migrando desde Realtime-1.5, la recomendación es no asumir que el comportamiento anterior se reproduce igual. El modelo es más capaz pero también más sensible a cómo están escritas las instrucciones del sistema. Hacé un test exhaustivo de regresión, especialmente en los flujos críticos.

Qué está confirmado y qué no

| Item | Estado | Fuente |

|---|---|---|

| Lanzamiento mayo 2026 | Confirmado | Anuncio oficial OpenAI |

| 128K tokens de contexto | Confirmado | Documentación API |

| 66.5% en ComplexFuncBench | Confirmado | OpenAI |

| Mejora de 26 puntos en Zillow | Confirmado | Caso reportado por OpenAI |

| Bug con objetos anidados | Reportado, sin fix oficial | Comunidad de desarrolladores |

| Pricing final para enterprise | Pendiente de acuerdos comerciales | N/A |

| SIP calling disponible globalmente | En beta, cobertura parcial | OpenAI |

Errores comunes al migrar a GPT-Realtime-2

Dejar el reasoning effort en low para todo. El modo low reduce la latencia, pero también desactiva buena parte del razonamiento que hace interesante a este modelo para tool calling complejo. Si estás viendo resultados mediocres en herramientas, antes de culpar al modelo fijate si estás usando low por default.

Asumir que el schema de herramientas de Realtime-1.5 funciona igual. El modelo nuevo es más estricto con los tipos. Un campo que antes toleraba string o null ahora puede fallar si el schema no lo declara explícitamente. Revisá todos los schemas antes de migrar.

No configurar el manejo de interrupciones en el session setup. El modelo soporta mejor las interrupciones, pero eso no es automático si el cliente no está configurado para detectarlas y pasarlas correctamente. Si el usuario interrumpe y el agente sigue como si nada, el problema está en el lado del cliente, no en el modelo.

Ignorar los preambles en el UI. Los preambles son útiles para el usuario, pero si la interfaz espera solo el resultado de la herramienta y el modelo emite texto antes, pueden romperse flows que procesan la respuesta sin esperar el evento de fin de turn. Actualizá el handler para tolerar turnos que empiezan con texto antes de ejecutar herramientas. Te puede servir nuestra cobertura de limitaciones documentadas en Codex.

Qué significa para equipos y empresas en Latinoamérica

Los casos de uso más directos para la región son agentes de atención al cliente telefónica, sistemas de reservas por voz, y soporte técnico con acceso a bases de datos en tiempo real. La ventana de 128K y el paralelismo de herramientas hacen viable lo que antes requería arquitecturas más complicadas: un solo agente de voz puede consultar múltiples sistemas (CRM, inventario, historial) dentro de una respuesta, sin silencios largos ni múltiples turnos de conversación.

Para los que desarrollan en la región y alojan sus servicios localmente, el modelo se integra por API sin requerir infraestructura específica de OpenAI. Si el backend que conecta las herramientas está en un servidor propio, donweb.com ofrece VPS con buena conectividad para ese tipo de carga. El costo del modelo es el limitante más relevante para proyectos chicos: $64/M tokens de output es caro para aplicaciones de alto volumen sin caching bien configurado.

Preguntas Frecuentes

¿Cómo pruebo GPT-Realtime-2 con llamadas a herramientas?

Lo más rápido es usar el Playground de OpenAI en platform.openai.com, modo Realtime, donde podés agregar herramientas con schema JSON sin código. Para testing integrado, usás el SDK oficial de OpenAI y configurás las herramientas en el setup de sesión antes de iniciar la conexión WebSocket.

¿Cuál es la diferencia entre GPT-Realtime-2 y Realtime-1.5 en tool calling?

GPT-Realtime-2 ejecuta llamadas a herramientas en paralelo (Realtime-1.5 lo hacía en secuencia), tiene 128K de contexto contra 32K, y logró 66.5% en ComplexFuncBench frente al 49.7% de la versión anterior, según benchmarks de abril/mayo 2026. También agrega preambles (el modelo “compra tiempo” verbalmente mientras ejecuta herramientas) y mejor manejo de interrupciones del usuario.

¿Puedo hacer llamadas a múltiples herramientas simultáneamente en GPT-Realtime-2?

Sí, es una de las novedades principales. El modelo puede ejecutar varias herramientas en paralelo dentro de una misma respuesta de voz. Para que funcione, las herramientas no deben tener dependencias explícitas entre sí en el schema. Si el modelo detecta que una herramienta necesita el output de otra para funcionar, las ejecuta en secuencia igual.

¿Cuánto cuesta GPT-Realtime-2?

El precio a partir de mayo 2026 es $32/M tokens de audio input, $0.40/M para input cacheado, y $64/M para audio output. El caching es clave para reducir costos en aplicaciones donde el system prompt y el contexto base se repiten entre sesiones. Sin caching, el costo es el doble que Realtime-1.5.

¿Cómo integro el contexto en vivo en agentes de voz con OpenAI?

La ventana de 128K tokens de GPT-Realtime-2 permite pasar contexto extenso en el setup de sesión: historial de conversaciones previas, datos del usuario, documentación relevante. El contexto se carga al iniciar la sesión y se puede actualizar entre turnos. Para datos que cambian en tiempo real (inventario, estado de pedidos), lo correcto es usar herramientas que consulten la fuente en el momento, no pre-cargar datos dinámicos en el contexto.

Conclusión

GPT-Realtime-2 es un salto concreto respecto a Realtime-1.5, sobre todo para casos de uso donde el tool calling importa. El benchmark de ComplexFuncBench de abril/mayo 2026, los 26 puntos de mejora que reportó Zillow en pruebas de abril 2026, y la capacidad de llamadas paralelas son datos verificables que justifican la migración para aplicaciones de agentes de voz en producción.

Lo que frena es el costo: $64/M tokens de output es significativo para aplicaciones de alto volumen. Si no tenés caching bien configurado y tus conversaciones son largas, el presupuesto se va rápido. El issue reportado con objetos anidados en schemas también es algo a monitorear antes de hacer un deploy completo.

Dicho esto, si venís trabajando en agentes de voz con tool calling y el modelo anterior te quedaba corto, esta es la actualización que estabas esperando. Arrancá por el Playground, estresá los tres escenarios que describí (interrupciones, paralelismo, tono), y después migrá gradualmente.

Fuentes

- OpenAI — Advancing Voice Intelligence with New Models in the API (anuncio oficial)

- OpenAI Developers — Guía oficial de la Realtime API

- MarkTechPost — OpenAI lanza tres modelos de audio en la Realtime API

- DataCamp — GPT-Realtime-2: análisis y pricing

- Ecosistema Startup — GPT-Realtime-2 y razonamiento GPT-5 en voz