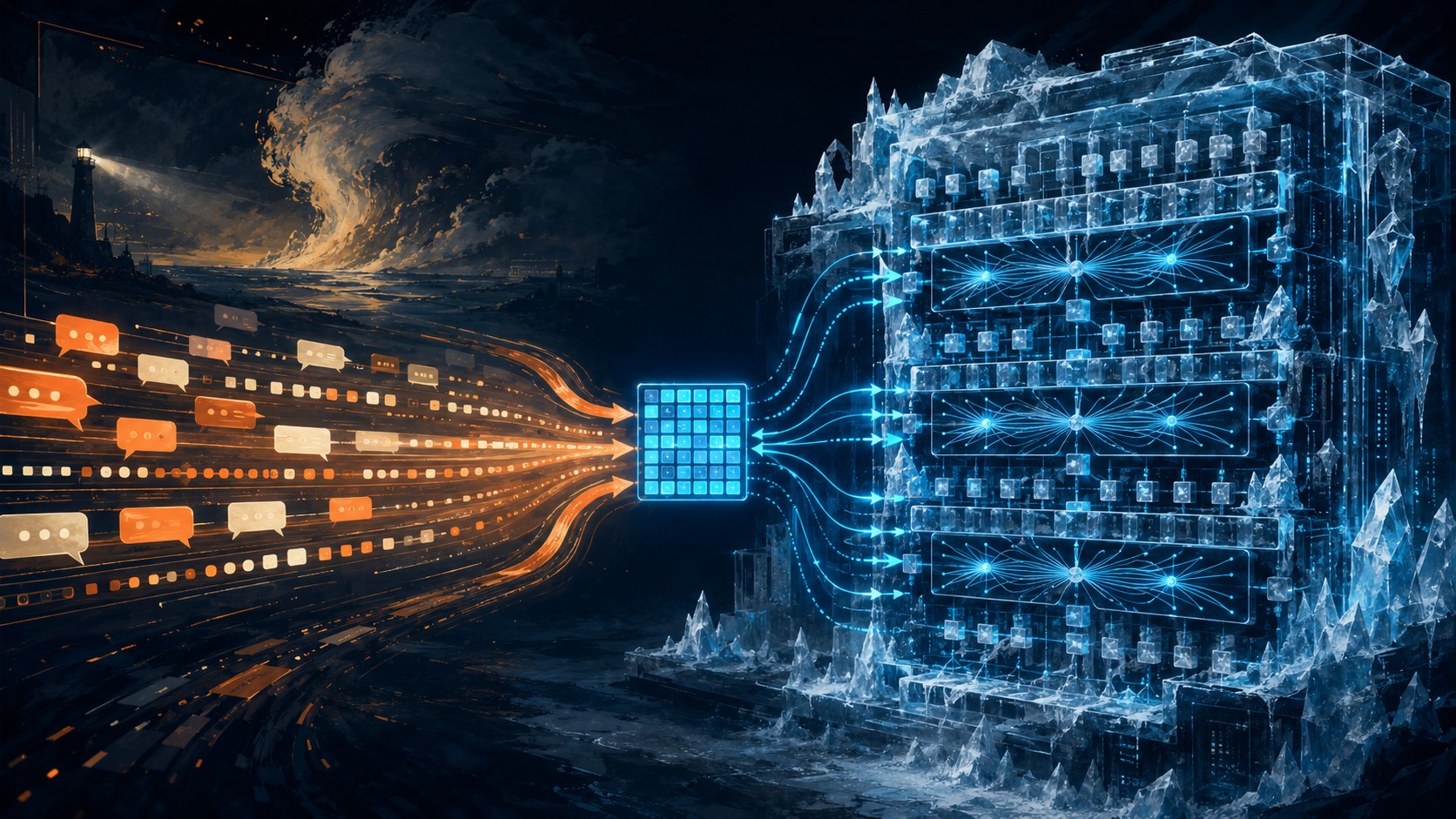

Δ-Mem es un mecanismo de memoria online para modelos de lenguaje que mejora la memoria eficiente en LLM sin expandir la ventana de contexto ni reentrenar el modelo base. Según el paper publicado en arXiv, logra una mejora promedio de 1.10× sobre el modelo base y 1.15× sobre otros baselines de memoria, con hasta 1.31× en el benchmark MemoryAgentBench.

En 30 segundos

- Δ-Mem agrega una matriz de estado 8×8 al backbone congelado del LLM, comprimiendo información pasada sin tocar los pesos originales.

- Funciona con modelos actuales como Qwen3 y SmolLM3, disponible en el repositorio oficial.

- Mejora 1.31× en MemoryAgentBench y 1.20× en LoCoMo comparado con el modelo sin memoria.

- No requiere aumentar el contexto ni hacer fine-tuning completo: solo se entrena la capa de memoria añadida.

- Es distinto a RAG: en vez de recuperar documentos externos, integra memoria directamente en la atención del modelo.

¿Qué es Δ-Mem y por qué importa?

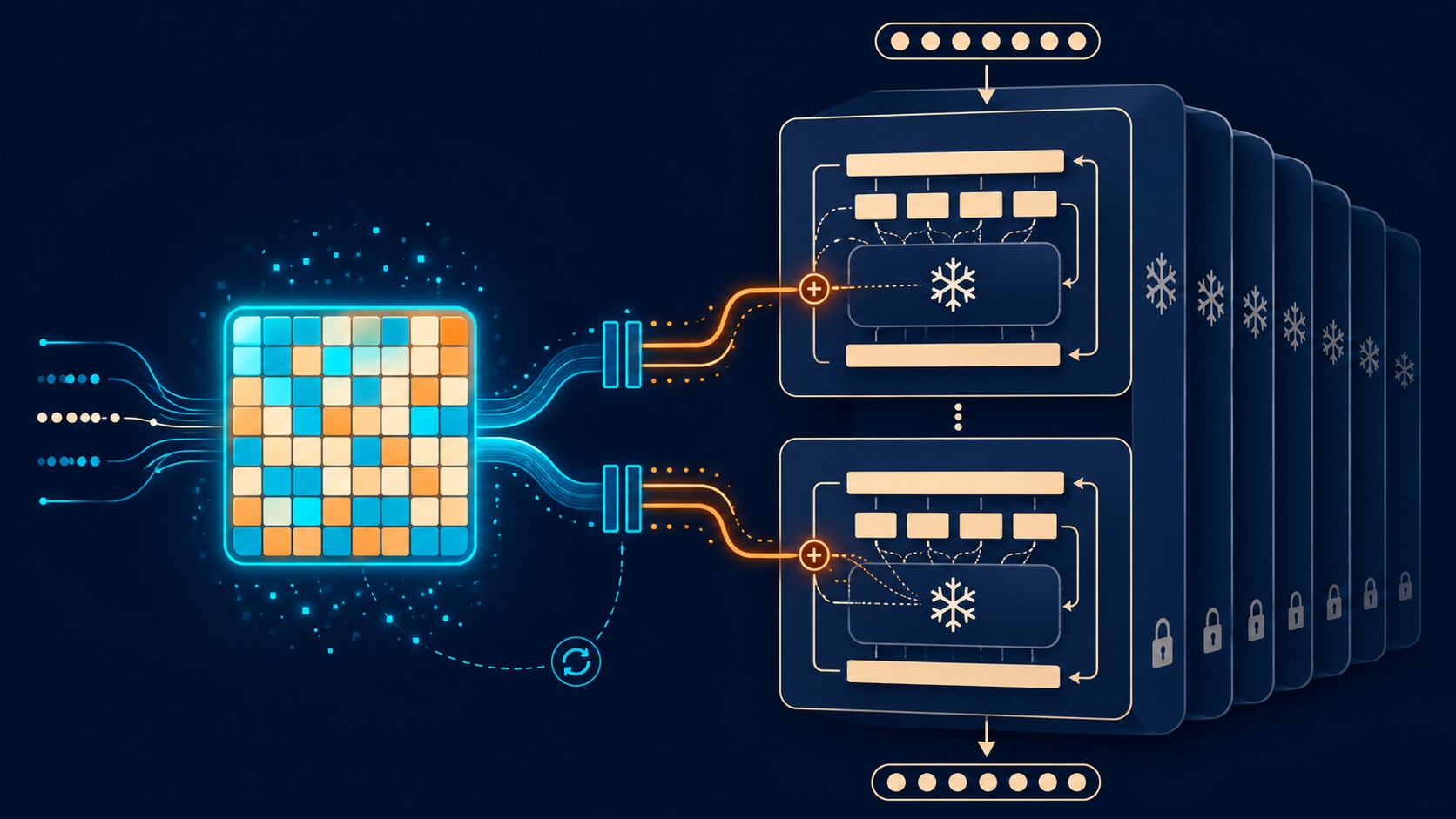

Δ-Mem es un módulo de memoria online que se agrega sobre cualquier LLM preentrenado sin modificar sus pesos. La idea central es simple: en vez de pedirle al modelo que “recuerde” metiéndole más tokens en el contexto, añadís una matriz de estado compacta (8×8) que aprende a comprimir información pasada usando el principio delta-rule. Ese estado se actualiza a medida que el modelo procesa texto, como una memoria de trabajo.

El problema que resuelve es real. Cualquiera que haya corrido un agente sobre documentos largos sabe que en algún punto el modelo empieza a olvidar lo que había al principio, los costos de inferencia se van a las nubes, y la calidad baja. Δ-Mem ataca eso de frente, con un overhead mínimo.

El problema del contexto limitado en LLMs

Ponele que tenés un agente de soporte técnico que atiende conversaciones de 50 turnos. Para el turno 40, el modelo ya no “recuerda” bien lo que se dijo al principio. No es que se equivoca siempre, pero la degradación es real y documentada. El fenómeno tiene nombre: “Lost in the Middle”, y varios papers lo midieron: los LLMs procesan mejor información que está al principio o al final del contexto, no en el medio.

La solución obvia, expandir la ventana de contexto, tiene dos problemas serios. Primero, la atención tiene complejidad cuadrática: si duplicás el contexto, el costo de cómputo no se duplica, se cuadruplica. Segundo, más contexto no garantiza mejor memoria: el modelo puede tener 128K tokens disponibles y aun así ignorar lo que está en el token 20.000.

Esto es lo que Δ-Mem intenta resolver de otra manera.

Cómo funciona Δ-Mem: delta-rule learning

La arquitectura tiene tres componentes clave. El backbone del LLM queda completamente congelado, lo que significa que podés aplicar Δ-Mem a un modelo que ya tenés sin reentrenarlo. Sobre ese backbone, se agrega una matriz de estado de 8×8 que actúa como memoria comprimida. Cada vez que el modelo procesa un fragmento de texto, esa matriz se actualiza aplicando correcciones de bajo rango (low-rank corrections) a la capa de atención. Te puede servir nuestra cobertura de optimizar contenido para LLMs modernos.

El delta-rule, que viene de la literatura de aprendizaje hebbiano, define cómo se actualiza esa matriz: básicamente, cada nuevo fragmento de información modifica el estado en proporción al error entre la predicción actual y lo que se observó. Es decir, el modelo aprende qué vale la pena retener y qué descartar, de manera online, sin batch training.

¿Y qué tan grande es ese overhead? Eso es lo interesante: la matriz 8×8 es minúscula comparada con los miles de millones de parámetros del backbone. La idea es que la compresión sea agresiva pero inteligente. En la práctica, según el paper, las estrategias de escritura en la matriz tienen impacto en el rendimiento, y el repositorio documenta cuáles dan mejores resultados en distintos escenarios.

Δ-Mem vs RAG vs Fine-tuning: comparativa

Antes de hablar de métricas, conviene tener claro cuándo usar qué. Las tres opciones atacan el problema de la memoria en LLMs pero de maneras distintas:

| Característica | RAG | Δ-Mem | Fine-tuning |

|---|---|---|---|

| Reentrenamiento del modelo base | No | No | Sí |

| Dónde vive la memoria | Base de datos externa | Matriz interna 8×8 | En los pesos del modelo |

| Dinamismo en runtime | Alto (recupera en tiempo real) | Alto (se actualiza online) | Bajo (fijo post-entrenamiento) |

| Complejidad de implementación | Media-alta (vectorstore, embeddings) | Baja (módulo sobre backbone) | Alta (datos, GPU, infra) |

| Costo operativo | Medio (búsquedas vectoriales) | Bajo (overhead mínimo) | Alto (reentrenamiento periódico) |

| Memoria persistente entre sesiones | Sí (externa) | No (por sesión) | Parcialmente |

RAG sigue siendo la opción cuando necesitás buscar en bases de conocimiento externas: documentos, wikis, productos. Δ-Mem brilla cuando necesitás que el modelo mantenga coherencia dentro de una sesión larga sin inflar el contexto. Fine-tuning tiene sentido cuando querés que el modelo “sepa” algo de forma permanente y estás dispuesto a pagar el costo.

El punto es que no son mutuamente excluyentes. Un sistema bien diseñado podría usar RAG para la base de conocimiento y Δ-Mem para la memoria de sesión. Eso sí, cada capa que agregás suma complejidad operativa. Para más detalles técnicos, mirá trabajar con modelos en proyectos grandes.

Métricas de rendimiento e impacto real

Los números del paper son concretos. Δ-Mem logra una mejora promedio de 1.10× sobre el modelo base en benchmarks generales, y de 1.15× sobre otros baselines de memoria. Los dos números más llamativos son en benchmarks específicos de memoria para agentes:

- MemoryAgentBench: 1.31× sobre el modelo base. Este benchmark evalúa agentes que necesitan retener información de pasos anteriores para completar tareas multistep.

- LoCoMo: 1.20×. LoCoMo evalúa comprensión de conversaciones largas donde la información relevante está distribuida en toda la sesión.

¿Alguien verificó estos números de forma independiente fuera del equipo de declare-lab? Todavía no hay réplicas publicadas. Los benchmarks son del propio paper, así que tomalo con pinzas hasta que la comunidad tenga tiempo de reproducirlos. Dicho esto, 1.31× en MemoryAgentBench no es trivial y los benchmarks elegidos son razonablemente estándar en la comunidad.

Lo que sí parece sólido es que las capacidades generales del modelo no se degradan. Eso es importante: algunos enfoques de memoria mejoran retención pero bajan rendimiento en tareas sin memoria involucrada. Acá el backbone está congelado, así que por construcción no debería haber regresión.

Implementación práctica en sistemas reales

El código está disponible en declare-lab/delta-Mem en GitHub. Los modelos soportados al momento de publicación son Qwen3 y SmolLM3, dos opciones en el rango eficiente que tienen sentido para despliegues donde los recursos son limitados.

La integración básica sigue este flujo: partís del modelo base preentrenado, inicializás la matriz de estado, y durante la inferencia el módulo Δ-Mem se encarga de actualizar ese estado con cada chunk de texto procesado. No necesitás modificar el pipeline de tokenización ni el formato de entrada.

El repositorio documenta distintas estrategias de escritura en la matriz, que tienen impacto en cuánto se retiene y qué se descarta. Para agentes de soporte técnico, por ejemplo, puede convenir una estrategia que priorice los últimos N intercambios. Para análisis de documentos, quizás preferís distribución uniforme. La documentación cubre estos trade-offs, aunque a esta altura la cantidad de experimentos comunitarios es todavía limitada (el paper es de mayo de 2026). Tema relacionado: aplicaciones prácticas de modelos IA.

Si pensás desplegarlo y necesitás hosting con soporte para cargas de cómputo variable, donweb.com tiene opciones de cloud que zafan para pruebas de este tipo.

Casos de uso en agentes de IA

Agente de soporte técnico que atiende tickets de varias horas: en el turno 35, el usuario retoma un error que mencionó al principio. Con contexto plano, el modelo puede no conectar los puntos. Con Δ-Mem, la información sobre ese error está comprimida en la matriz de estado y puede influir en la atención de los tokens actuales.

Asistentes personalizados que acumulan preferencias durante la sesión, sin necesidad de meter todo el historial como contexto. Si el usuario dijo que prefiere respuestas cortas en el turno 3, eso debería estar disponible en el turno 40 sin ocupar tokens.

Análisis de documentos largos donde el problema “Lost in the Middle” es especialmente crítico. Ponele que estás procesando un contrato de 80 páginas y necesitás que el modelo recuerde las cláusulas de la sección 2 cuando está respondiendo sobre la sección 7. Δ-Mem es exactamente el tipo de mecanismo pensado para eso.

Automatización empresarial con múltiples pasos: workflows donde cada acción depende de lo que pasó antes, pero no podés ni querés meter todo el log como contexto en cada llamada al modelo.

Errores comunes al implementar memoria en LLMs

Confundir contexto largo con memoria real. Expandir la ventana de contexto a 128K tokens no resuelve el problema de fondo. El modelo sigue teniendo dificultad para relacionar información que está alejada dentro de ese contexto. Δ-Mem ataca la representación interna, no el tamaño del buffer. Complementá con integrar APIs de LLMs en producción.

Asumir que RAG reemplaza memoria de sesión. RAG recupera bien información de bases de conocimiento externas, pero no mantiene coherencia intra-sesión de forma automática. Si tu agente necesita recordar lo que el usuario dijo hace 20 turnos en la misma conversación, RAG solo no alcanza.

Ignorar el costo de las estrategias de escritura. Δ-Mem tiene distintas políticas para actualizar la matriz de estado, y elegir mal puede degradar el rendimiento en tu caso de uso específico, aunque los benchmarks generales sean buenos. El repositorio tiene ejemplos, pero vas a necesitar experimentar con tus datos.

Preguntas Frecuentes

¿Qué es Δ-Mem y cómo funciona?

Δ-Mem es un módulo de memoria online que se agrega sobre un LLM preentrenado sin modificar sus pesos. Usa una matriz de estado 8×8 que se actualiza mediante delta-rule learning a medida que el modelo procesa texto, comprimiendo información pasada en correcciones de bajo rango sobre la atención. El resultado es que el modelo retiene coherencia en conversaciones largas sin necesidad de expandir la ventana de contexto.

¿Cuál es la diferencia entre Δ-Mem y RAG?

RAG recupera información de una base de datos externa en tiempo de inferencia, útil cuando necesitás acceder a documentos o conocimiento que no está en el contexto. Δ-Mem integra la memoria directamente dentro del modelo, actualizando un estado interno durante la sesión. RAG es mejor para bases de conocimiento externas; Δ-Mem es mejor para mantener coherencia dentro de una conversación larga sin agregar tokens externos.

¿Δ-Mem requiere reentrenar el modelo base?

No. El backbone del LLM queda completamente congelado. Solo se entrena la capa de memoria añadida (la matriz 8×8 y sus conexiones), lo que reduce considerablemente el costo comparado con fine-tuning completo. Esto también significa que podés aplicarlo sobre modelos que ya tenés en producción sin riesgos de regresión en las capacidades generales.

¿Qué modelos soporta Δ-Mem actualmente?

Al momento de publicación del paper en mayo de 2026, el repositorio oficial soporta Qwen3 y SmolLM3. Ambos son modelos en el rango eficiente, adecuados para despliegues con recursos limitados. La arquitectura es agnóstica al backbone en principio, pero la implementación actual está validada sobre esos dos modelos.

¿Dónde implementar Δ-Mem en mis agentes de IA?

Tiene más sentido en agentes que manejan conversaciones largas, análisis de documentos extensos, o workflows multistep donde cada acción depende de contexto anterior. El código está en declare-lab/delta-Mem con documentación de integración. Para sistemas en producción, combinarlo con RAG para el conocimiento externo y usar Δ-Mem para la memoria de sesión es una estrategia razonable.

Conclusión

Δ-Mem es una propuesta técnica sólida para el problema real de la memoria eficiente en LLM: no expande el contexto, no toca los pesos del modelo base, y logra mejoras medibles en benchmarks de agentes (1.31× en MemoryAgentBench). El enfoque de matriz de estado compacta actualizada online es elegante y barato de implementar sobre modelos existentes.

Lo que falta: réplicas independientes, soporte para más modelos, y experiencias comunitarias sobre qué estrategias de escritura funcionan mejor en cada dominio. Es un paper de mayo de 2026, así que habría que ver cómo evoluciona en los próximos meses. Por ahora, si tenés agentes que sufren por contextos largos y no querés ni expandir la ventana ni reentrenar nada, vale la pena revisar el repositorio y hacer las pruebas con tus casos de uso específicos.

Fuentes

- arXiv 2605.12357 – Δ-Mem: Efficient Online Memory for Large Language Models (paper original)

- GitHub declare-lab/delta-Mem – Repositorio oficial con código e implementación

- Hugging Face Papers – Δ-Mem (discusión comunitaria)

- Redis – Guía de memoria para agentes de IA

- Microsoft Azure – RAG vs Fine-tuning para aumentar LLMs