Entrenar tu propio LLM desde cero es el proceso de construir un modelo de lenguaje de gran escala partiendo de datos crudos y sin reutilizar pesos de modelos existentes. En 2026, con repositorios como LLMs-from-scratch de Sebastian Raschka y frameworks como h2o LLM Studio, esto dejó de ser territorio exclusivo de Google o Meta para convertirse en algo que un equipo pequeño puede experimentar.

En 30 segundos

- Entrenar un LLM desde cero requiere datos propios, hardware con GPU y entre horas y semanas de entrenamiento según la escala del modelo.

- Un modelo de 9 millones de parámetros tipo GuppyLM se puede entrenar en 5 minutos desde una laptop con GPU modesta.

- La diferencia clave entre entrenamiento desde cero y fine-tuning es si partís de pesos vacíos o de un modelo pre-entrenado.

- La calidad de los datos importa más que la cantidad: un dataset limpio de 1 GB supera a 10 GB de texto sucio.

- Los errores más comunes son sesgo en los datos, falta de validación y objetivos de entrenamiento mal definidos desde el arranque.

Entrenar vs. fine-tuning: entendé la diferencia

Un LLM entrenado desde cero es exactamente eso: empezás con pesos aleatorios, construís la arquitectura Transformer vos mismo (o usás una implementación de referencia), y le das millones o miles de millones de tokens hasta que el modelo aprende a predecir texto de forma coherente. No hay nada heredado de GPT ni de Llama.

El fine-tuning, en cambio, toma un modelo que ya aprendió el lenguaje y le da un empujón adicional con datos específicos de tu dominio. Mucho más barato, mucho más rápido. Entonces, ¿cuándo tiene sentido el entrenamiento desde cero?

Tiene sentido cuando necesitás que el modelo hable un idioma o dialecto técnico que los modelos comerciales manejan pésimo: terminología médica hiperespecializada, jerga legal de un país específico, o idiomas con muy poca representación en internet como el quechua o el mapudungún. También cuando los datos que tenés son confidenciales y no podés mandarlos a una API externa. O cuando querés control total sobre la arquitectura, el vocabulario del tokenizer y el sesgo del modelo.

Para todo lo demás, el fine-tuning zafa. Y zafa bien.

Requisitos técnicos: lo que necesitás realmente

Acá viene lo bueno: no necesitás un supercomputador para empezar.

Un modelo pequeño de 9 millones de parámetros, como los ejemplos que circulan en repositorios educativos tipo how-to-train-your-gpt, se entrena en 5 minutos en una GPU de consumo. Una RTX 3060 de 12 GB de VRAM alcanza para experimentar. Con una RTX 4090 o acceso a una A100 via Google Colab Pro o servicios cloud, podés escalar a modelos de cientos de millones de parámetros.

Los requisitos mínimos para un experimento serio:

- GPU con mínimo 8 GB de VRAM (idealmente 16-24 GB para modelos de más de 100M de parámetros)

- 32 GB de RAM del sistema para manejar el dataset en memoria

- PyTorch 2.x o TensorFlow 2.x como framework base

- Dataset de entre 1 GB y varios terabytes según la escala objetivo

- Python 3.10+ y familiaridad básica con numpy y tensores

Si querés escalar a modelos de miles de millones de parámetros, ahí sí entrás al territorio de clusters con múltiples GPUs y herramientas como DeepSpeed o Megatron-LM. Pero para aprender el proceso, ese nivel de hardware no te hace falta.

Preparación de datos: el paso más crítico

Ponele que tenés 50 GB de texto web scrapeado. Parecería suficiente. El problema es que ese texto probablemente incluye HTML sin limpiar, texto duplicado, spam, contenido en idiomas que no querés y errores tipográficos. Metés ese dataset sucio en el entrenamiento y obtenés un modelo que genera exactamente esa calidad de texto. Te puede servir nuestra cobertura de facturación por tokens en 2026.

El proceso de preparación tiene cuatro pasos que no podés saltear:

Recopilación: Usá fuentes conocidas. Datasets públicos como TinyStories (textos simples en inglés diseñados para modelos pequeños) o The Pile son buenos puntos de partida. Si querés datos en español, Common Crawl filtrado por idioma es la opción más accesible.

Limpieza: Deduplicación de textos, eliminación de HTML, filtrado por idioma, remoción de contenido con alta proporción de caracteres especiales. Herramientas como datatrove o ftfy simplifican esto.

Tokenización: El tokenizer convierte texto en números. Los LLMs modernos usan Byte Pair Encoding (BPE), el mismo algoritmo que usa GPT. Si entrenás tu propio tokenizer con el vocabulario de tu dominio, el modelo va a manejar mejor terminología específica. Hugging Face Tokenizers lo implementa en minutos.

Validación: Separá un 5-10% del dataset para evaluación. Si no tenés un conjunto de validación limpio, no vas a saber si el modelo está aprendiendo o memorizando.

Frameworks y herramientas que existen hoy

El ecosistema de herramientas para entrenar LLMs creció bastante. Acá va una comparación honesta. Para contexto sobre costos, consultar nuestra cobertura de cambios en los planes premium.

| Herramienta | Requiere código | Escala | Ideal para | Costo |

|---|---|---|---|---|

| PyTorch (manual) | Sí, mucho | Pequeño a grande | Aprender la arquitectura | Gratis |

| Axolotl | Poco (YAML config) | Mediano a grande | Fine-tuning y preentrenamiento | Gratis |

| DeepSpeed | Sí | Grande a muy grande | Multi-GPU, reducción de memoria | Gratis |

| h2o LLM Studio | No (interfaz visual) | Mediano | Equipos sin perfil técnico | Gratis/pago |

| LLMs-from-scratch | Sí (educativo) | Pequeño | Aprender desde cero | Gratis |

El repositorio rasbt/LLMs-from-scratch de Sebastian Raschka es el recurso más recomendado en 2026 para entender qué pasa adentro del modelo antes de usar abstracciones de alto nivel. Implementa un GPT pequeño paso a paso con código claro y comentado. BabyGPT sigue una línea similar pero más compacta.

Para equipos que necesitan entrenar sin escribir código, h2o LLM Studio ofrece una interfaz visual que cubre los casos más comunes (según su propia documentación). El trade-off es menos control sobre la arquitectura y los hiperparámetros.

Arquitectura Transformer: lo mínimo que tenés que entender

Un Transformer es, en el fondo, una máquina que aprende qué palabras prestar atención cuando genera la siguiente. Eso es el mecanismo de atención.

Los componentes principales que vas a configurar antes de entrenar:

- Embeddings: vectores que representan cada token en espacio matemático. Un modelo de 768 dimensiones de embedding tiene más “espacio” para representar matices que uno de 128.

- Capas de atención (attention heads): cuántas perspectivas paralelas el modelo usa para relacionar tokens entre sí. GPT-2 small tiene 12 heads; modelos grandes tienen 96 o más.

- Capas Feed-Forward: redes densas que procesan la representación de cada token después de la atención.

- Contexto (context length): cuántos tokens el modelo puede considerar a la vez. 512, 2048, 32768. A mayor contexto, mayor uso de VRAM.

Para un modelo pequeño de práctica: 6 capas, 6 attention heads, embedding de 384 dimensiones, contexto de 512 tokens. Con ese tamaño, el entrenamiento en CPU es viable para experimentos cortos.

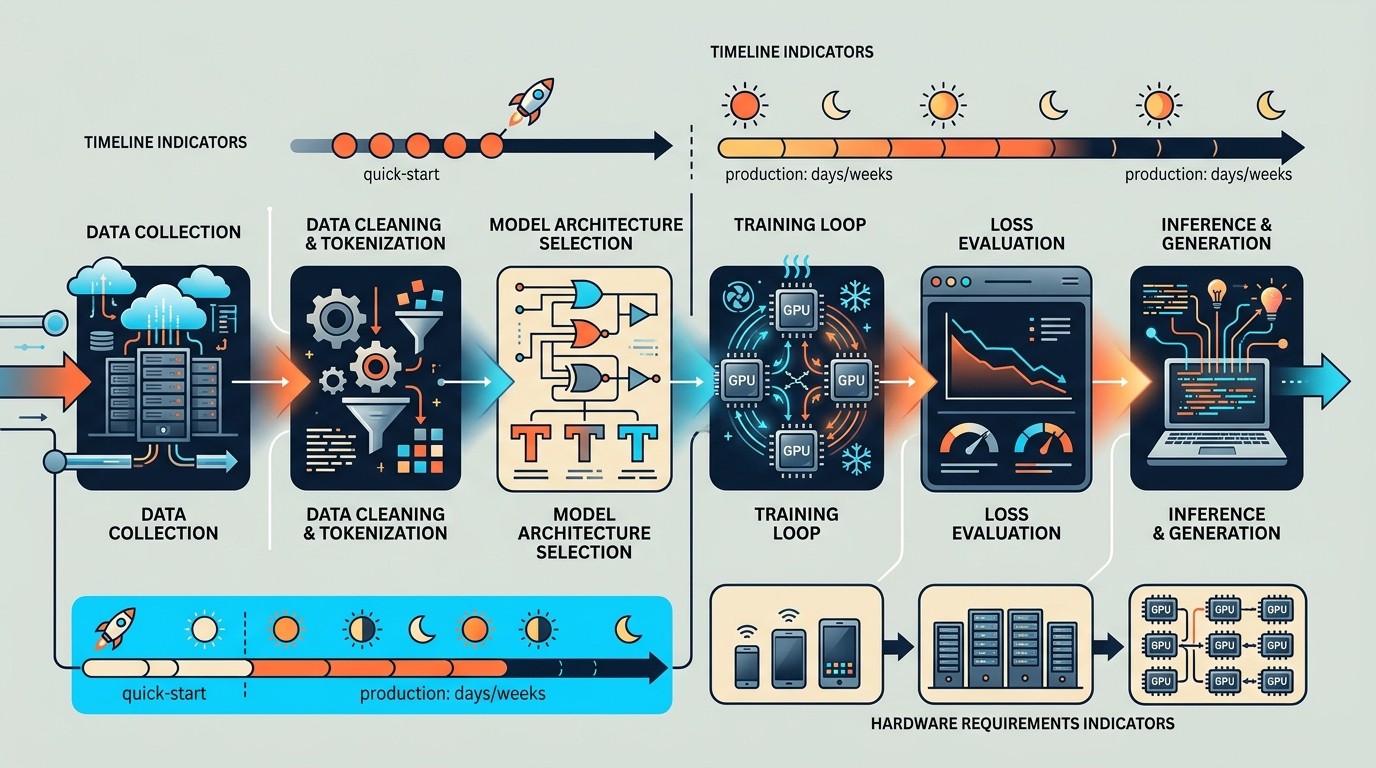

El proceso de entrenamiento, paso a paso

El loop de entrenamiento tiene tres pasos que se repiten millones de veces: forward pass, cálculo de pérdida, backpropagation.

El modelo recibe una secuencia de tokens, intenta predecir el siguiente, y compara su predicción con la respuesta correcta usando una función de pérdida (cross-entropy loss). Si la predicción fue mala, backpropagation calcula cuánto contribuyó cada peso a ese error, y el optimizador (AdamW en casi todos los LLMs modernos) ajusta los pesos en la dirección contraria.

Repetí eso 10 millones de veces. Eso es entrenar un LLM.

Los hiperparámetros que más importan en la práctica son el learning rate (si es muy alto, el modelo diverge; si es muy bajo, aprende lentísimo), el batch size (cuántas secuencias procesás en paralelo, limitado por VRAM), y el número de epochs (cuántas veces pasás el dataset completo). Ya lo cubrimos antes en limitaciones de capacidad de servicios.

Tiempos realistas según escala:

- Modelo de 9M parámetros en dataset pequeño: 5-15 minutos en GPU de consumo

- Modelo de 125M parámetros en 10 GB de texto: 24-48 horas en RTX 4090

- Modelo de 7B parámetros: semanas en un cluster de 8xA100

Casos de uso reales: cuándo tiene sentido hacerlo

Hay tres escenarios donde entrenar desde cero gana sobre usar un modelo existente.

Idiomas con baja representación. Si querés un asistente que entienda quechua boliviano o mapudungún, los modelos comerciales actuales te van a decepcionar. Ningún GPT-4 ni Claude 3 tiene cobertura decente. Un modelo pequeño entrenado en un corpus específico de ese idioma va a ganarle en su dominio.

Dominio técnico hiperespecializado. Una empresa farmacéutica con miles de informes clínicos internos puede entrenar un modelo que entiende su terminología específica, sus abreviaciones propias y sus flujos de trabajo. Ese conocimiento no existe en ningún modelo público. Y si los datos son confidenciales, tampoco los querés mandar a una API externa.

Control total sobre el comportamiento base. Si necesitás que el modelo nunca genere cierto tipo de contenido, o que siempre responda en cierto formato, es mucho más fácil hardcodearlo en el entrenamiento que parcharlo con prompts y filtros encima de un modelo comercial.

Para proyectos de hosting o infraestructura donde el modelo corre en servidores propios, podés deployarlo en un VPS o servidor dedicado. donweb.com tiene opciones de servidores con GPU que pueden servir para inferencia de modelos pequeños sin depender de cloud externo.

Errores comunes y cómo evitarlos

Error 1: Dataset sin validación de calidad. El modelo va a reproducir los patrones del dataset. Si el dataset tiene sesgos (solo textos de cierta demografía, cierta época, cierto idioma regional), el modelo los va a amplificar. Según estudios sobre errores en LLMs, los sesgos en datos de entrenamiento son la fuente más común de comportamiento problemático. La solución: auditoría del dataset antes de empezar, con análisis de distribución por fuente, tema y demografía cuando aplique.

Error 2: No tener métricas de evaluación desde el día uno. Muchos proyectos definen el objetivo (“que el modelo responda bien”) pero no tienen cómo medirlo. Sin un benchmark específico para tu dominio, no sabés si el entrenamiento mejoró algo o empeoró. Definí tus métricas antes de empezar: perplexity sobre el conjunto de validación, accuracy en tareas específicas de tu dominio, evaluación humana de una muestra de outputs. Cubrimos ese tema en detalle en técnicas avanzadas de prompting.

Error 3: Saltarse el overfitting. Si el modelo memoriza el training set sin generalizar, empieza a reproducir texto casi textual de los datos de entrenamiento. Señal: la pérdida de entrenamiento baja mientras la pérdida de validación sube. La solución es early stopping (parar cuando la validación deja de mejorar) y técnicas de regularización como dropout.

Error 4: Learning rate demasiado alto al inicio. Es el error más común entre quienes vienen de otros tipos de modelos. Un LR de 1e-3 que funciona para una red convolucional puede hacer que el Transformer diverja en los primeros pasos. Para LLMs, partí de 1e-4 o menos, con un warm-up de los primeros mil pasos.

Preguntas Frecuentes

¿Cómo entrenar tu propio LLM desde cero si no soy experto en deep learning?

El repositorio LLMs-from-scratch es el punto de entrada más recomendado: implementa un GPT pequeño con código comentado, progresa desde modelos bigram hasta Transformers completos, y requiere conocimiento básico de Python y PyTorch. h2o LLM Studio es la alternativa visual si no querés escribir código. Ambos están disponibles gratis en 2026.

¿Se puede entrenar un modelo de lenguaje sin un supercomputador?

Sí, con límites claros. Un modelo de 9 millones de parámetros se entrena en 5 minutos en una GPU de consumo como la RTX 3060. Para modelos de 100-500 millones de parámetros necesitás una GPU de 16-24 GB de VRAM y entre 12 y 72 horas. Los modelos de escala real (7B+) sí requieren hardware especializado o acceso a cloud con A100/H100.

¿Cuántos datos necesito para entrenar un LLM?

Depende del tamaño del modelo y del objetivo. Para un modelo educativo pequeño (menos de 50M de parámetros), datasets de 100 MB a 1 GB de texto limpio alcanzan para resultados coherentes. Para modelos de escala producción (1B+), se habla de terabytes. La regla práctica es que la calidad del dato supera a la cantidad: 500 MB de texto bien curado produce mejores resultados que 5 GB de texto web sin procesar.

¿Cuál es la diferencia entre entrenar desde cero y fine-tuning?

Entrenar desde cero implica pesos iniciales aleatorios y aprendizaje completo del lenguaje desde el primer token. El fine-tuning parte de un modelo pre-entrenado (Llama, Mistral, etc.) y ajusta los pesos con datos específicos de tu dominio. El fine-tuning es entre 10 y 100 veces más barato en recursos, pero heredás el comportamiento base del modelo original. El entrenamiento desde cero da control total pero requiere inversión significativa.

¿Qué errores evitar al entrenar un LLM?

Los cuatro errores más frecuentes son: no auditar el dataset antes de usarlo (sesgos que el modelo amplifica), no definir métricas de evaluación desde el inicio, ignorar las señales de overfitting en el conjunto de validación, y usar un learning rate demasiado alto que hace divergir el entrenamiento. Todos son evitables con una checklist básica antes de lanzar el primer run de entrenamiento.

Conclusión

Entrenar tu propio LLM desde cero pasó de ser territorio de laboratorios de investigación a ser algo que un equipo técnico mediano puede intentar en 2026, gracias a repositorios educativos de alta calidad y frameworks que abstraen la complejidad de la infraestructura. El proceso requiere saber claramente qué problema querés resolver: si el objetivo es adaptar un modelo general a un dominio, el fine-tuning es la respuesta correcta casi siempre. Si el objetivo es control total, idiomas no representados o datos confidenciales que no pueden salir de tu infraestructura, el entrenamiento desde cero tiene sentido.

Lo que no cambió es que los datos siguen siendo el cuello de botella. El modelo que entrenés va a ser exactamente tan bueno como el dataset que le des. Invertí ahí antes de preocuparte por la arquitectura.

Fuentes

- rasbt/LLMs-from-scratch — Implementación educativa de GPT desde cero con PyTorch

- raiyanyahya/how-to-train-your-gpt — Tutorial práctico de entrenamiento de GPT

- TatevKaren/BabyGPT — Construcción de GPT desde cero, enfoque compacto

- DataCamp — Cómo entrenar un LLM con PyTorch

- A Vueltas con la IA — Errores y sesgos en LLMs