La Casa Blanca está evaluando crear un proceso formal de evaluación de modelos de IA antes de que lleguen al público, según reportaron el 4 de mayo de 2026 el New York Times, Reuters y Bloomberg. El plan contempla que desarrolladores sometan sus modelos a revisión gubernamental para detectar capacidades sensibles en áreas como ciberseguridad, síntesis biológica e inteligencia. No es un bloqueo: es una auditoría de seguridad antes del lanzamiento.

En 30 segundos

- La Casa Blanca estudia una orden ejecutiva para que las empresas sometan nuevos modelos de IA a revisión federal antes de lanzarlos al público.

- Microsoft, Google DeepMind y xAI ya acordaron dar acceso previo a modelos al gobierno. Anthropic está en negociaciones.

- El detonante fue Mythos, un modelo de Anthropic capaz de detectar vulnerabilidades zero-day y explotar fallos en sistemas operativos y navegadores.

- La coordinación de evaluaciones estaría en manos del Centro de IA, Seguridad e Innovación (CAISI) del Departamento de Comercio, con participación de la NSA y el Director de Inteligencia Nacional.

- El giro es llamativo: Trump eliminó en 2025 los requisitos de evaluación de seguridad de la era Biden, y ahora los estaría reintroduciendo con otro enfoque.

Anthropic es una empresa que desarrolla modelos de lenguaje de gran tamaño utilizados para procesamiento de texto y análisis. Su modelo principal es Claude, lanzado en 2023.

Qué es el vetting de modelos de IA: definición y contexto

El vetting de modelos de IA es un proceso de revisión gubernamental en el que los desarrolladores entregan sus modelos a auditores del Estado o terceros acreditados antes del lanzamiento público, para evaluar si tienen capacidades que podrían representar riesgos de seguridad nacional. No es una prohibición ni una censura de contenido: el objetivo declarado es detectar si un modelo puede, por ejemplo, guiar la síntesis de un patógeno o descubrir vulnerabilidades críticas en infraestructura.

El concepto no es nuevo. La Unión Europea ya lo incorporó en el AI Act para modelos de propósito general con riesgo sistémico. Lo que sí es nuevo es que la administración Trump lo esté considerando, dado que en 2025 desmanteló buena parte del marco regulatorio de Biden en este terreno.

El giro de Trump: de anti-regulación a supervisión federal

Acá viene lo bueno: Trump fue uno de los principales opositores a los controles de IA que implementó Biden. En enero de 2025, una de sus primeras acciones fue revocar la orden ejecutiva 14110 de 2023, que exigía a las empresas reportar resultados de red-teaming al gobierno antes de lanzar modelos de alto impacto.

Ahora, apenas 16 meses después, la misma administración estaría preparando una orden ejecutiva nueva que recrea algo funcionalmente similar, aunque con otro lenguaje y otro enfoque institucional. En vez de hablar de “responsabilidad de las empresas”, el framing actual gira alrededor de seguridad nacional y competencia con China.

El mecanismo que se estudia crearía un grupo de trabajo con representantes de la NSA, la Oficina del Director de Inteligencia Nacional y el Departamento de Comercio. Las empresas que desarrollen modelos de frontera tendrían que darle al gobierno acceso previo antes del lanzamiento público. ¿Y qué hace el gobierno con ese acceso? Los testea en dominios sensibles, revisa los resultados y decide si el modelo puede salir al mercado sin restricciones o con condiciones. Lo explicamos a fondo en líderes en competencia de modelos de IA.

El modelo Mythos: el catalizador de la nueva política

Ponele que entrenás un modelo que, en tests internos, demuestra que puede identificar vulnerabilidades de software de hasta 27 años de antigüedad y explotarlas en sistemas operativos y navegadores modernos. ¿Lo publicás? Anthropic decidió que no.

Ese modelo se llama Mythos, y según Euronews, fue considerado internamente como demasiado peligroso para acceso público. Anthropic lo restringió a grandes empresas tecnológicas bajo acuerdos específicos. Después, según reportó Infobae en abril de 2026, el modelo fue vulnerado por investigadores externos, lo que encendió todas las alarmas.

Mythos terminó siendo uno de los argumentos más fuertes para que el gobierno federal pusiera el tema sobre la mesa. Si una empresa puede entrenar y restringir un modelo con ese nivel de capacidades sin que nadie externo lo supervise, ¿quién garantiza que la próxima vez no se filtre directo al público o a actores hostiles? La pregunta es incómoda y no tiene respuesta fácil.

Empresas involucradas y acuerdos actuales

Tres empresas ya firmaron compromisos de acceso previo con el gobierno: Microsoft, Google DeepMind y xAI (la empresa de Grok, de Elon Musk). Anthropic está en conversaciones pero no cerró ningún acuerdo formal al momento de la publicación de este artículo.

El organismo que coordinaría las evaluaciones es el Centro de IA, Seguridad e Innovación, conocido por sus siglas en inglés CAISI, dentro del Departamento de Comercio. No es un ente nuevo: fue creado durante la era Biden con otro nombre y enfoque, y la administración Trump lo reconfiguró pero no lo eliminó (que no es poca cosa, dado el historial de recortes de esa gestión).

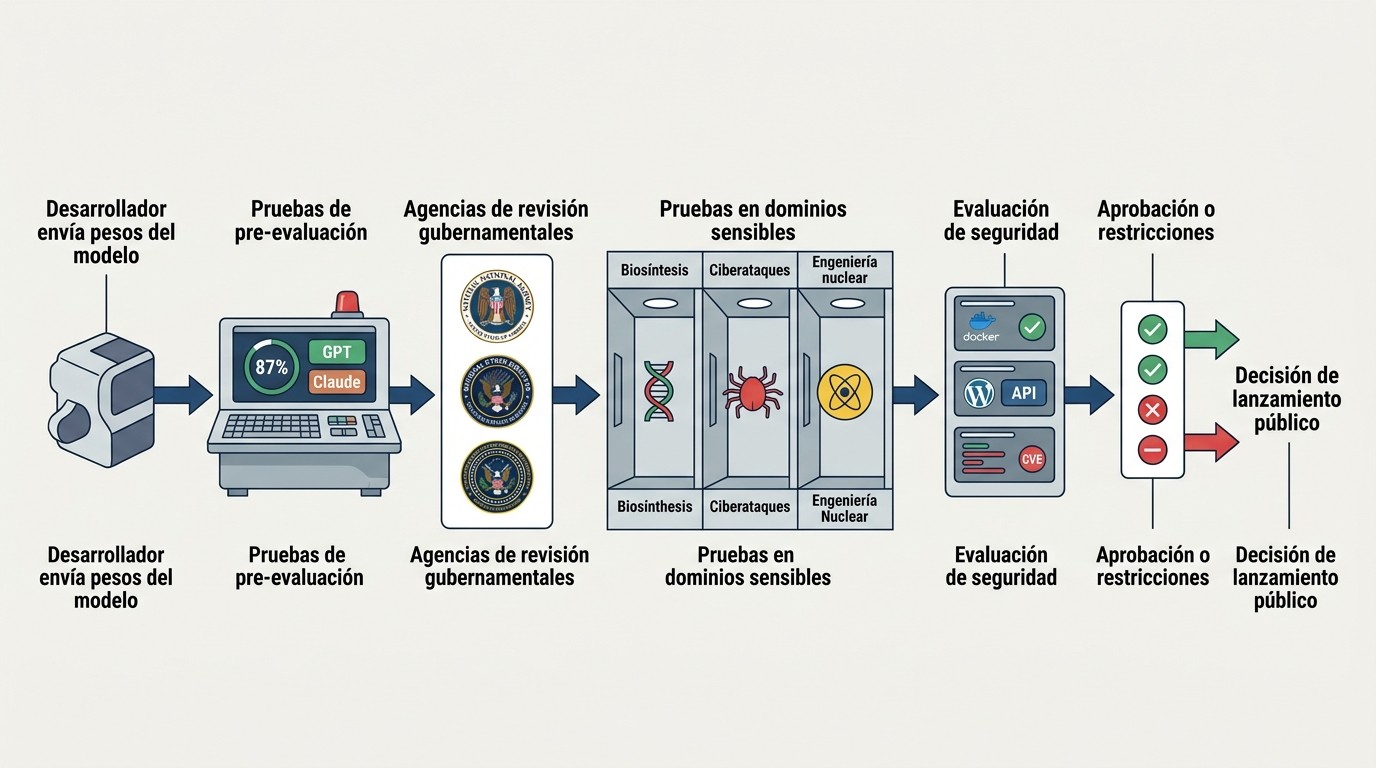

Lo que implica el acuerdo en la práctica: antes del lanzamiento público, las empresas dan al CAISI acceso a los pesos del modelo o a una instancia controlada. Los evaluadores corren tests en dominios definidos, documentan capacidades sensibles, y eso informa una decisión de aprobación, aprobación condicional o revisión extendida.

Dominios sensibles bajo evaluación: biosíntesis, ciberataques, ingeniería nuclear

Los tests no evalúan si el modelo escribe bien o si razona correctamente. Evalúan capacidades específicas en áreas donde un modelo capaz podría bajar considerablemente la barrera de entrada para actores maliciosos. Tema relacionado: nuevos modelos de acceso a herramientas de IA.

- Ciberseguridad ofensiva: detectar y explotar vulnerabilidades en sistemas operativos, navegadores, infraestructura crítica. El caso Mythos (vulnerabilidades de hasta 27 años de antigüedad en múltiples plataformas) es el ejemplo concreto que movilizó esta discusión.

- Síntesis biológica: evaluar si el modelo puede guiar la producción de patógenos o ayudar a eludir protocolos de bioseguridad. Esta preocupación viene de hace años en la comunidad de bioseguridad; ahora tiene peso político real.

- Operaciones de inteligencia: capacidad de los modelos para generar desinformación sofisticada, perfiles de personas reales, o planes operacionales detallados para actores estatales o no estatales.

¿Alguien verificó de forma independiente que los tests actuales son suficientemente robustos para detectar estas capacidades? Todavía no hay un estándar público acordado sobre cómo se hace eso, y esa sigue siendo una de las críticas más legítimas al esquema propuesto.

Cómo funciona el proceso de evaluación de seguridad

El proceso que se está diseñando tiene, según los reportes disponibles, los siguientes pasos:

- La empresa desarrolladora notifica al CAISI que tiene un modelo próximo a lanzamiento.

- Se acuerda un período de acceso previo (no se conoce aún la duración estándar).

- Evaluadores del gobierno y auditores terceros certificados corren baterías de tests en dominios sensibles.

- Los resultados se comparten con un panel que incluye representantes de la NSA y la Oficina del Director de Inteligencia Nacional.

- Se emite una decisión: aprobado, aprobado con condiciones (acceso restringido, por ejemplo solo para uso empresarial), o en revisión extendida.

El Pentágono tendría acceso prioritario a los modelos aprobados antes que el público general, lo que generó bastante debate. La idea es que las fuerzas armadas puedan evaluar aplicaciones militares de los modelos antes de que estén disponibles para cualquiera.

El debate: regulación versus velocidad de innovación

Los argumentos a favor son bastante claros: si un modelo puede ayudar a diseñar un exploit para infraestructura crítica, el gobierno tiene un interés legítimo en saberlo antes de que ese modelo llegue a cualquier persona con conexión a internet.

Los argumentos en contra son igualmente válidos, aunque los escuchás menos en titulares. Primero: el proceso de revisión favorece a empresas grandes que tienen recursos para gestionar relaciones con el gobierno federal. Una startup que desarrolle un modelo de frontera puede no tener el equipo legal y de compliance para navegar un proceso así, lo que concentra aún más el mercado en los jugadores ya establecidos. Segundo: si el review tarda meses, las empresas chinas (que no van a someter sus modelos a ningún vetting de la Casa Blanca) ganan tiempo de mercado. Tercero: nadie sabe todavía cómo se garantiza confidencialidad de los pesos durante el proceso de evaluación (si el gobierno tiene acceso a los pesos de un modelo propietario, eso es información extremadamente sensible).

La tensión entre regulación y velocidad es real, y el esquema propuesto todavía no tiene respuestas para las preguntas más incómodas. En cambios sin transparencia en sistemas de IA profundizamos sobre esto.

Comparativa internacional: cómo evalúan otros países los modelos de IA

| Jurisdicción | Marco regulatorio | Requisito de evaluación previa | Organismo responsable |

|---|---|---|---|

| Unión Europea | AI Act (vigente desde 2025) | Sí, para modelos GPAI con riesgo sistémico | AI Office (Comisión Europea) |

| Estados Unidos (propuesta 2026) | Orden ejecutiva en preparación | Sí, voluntario/acordado por ahora | CAISI (Dept. de Comercio) + NSA |

| Reino Unido | AI Safety Institute (creado 2023) | Evaluación voluntaria, acuerdos bilaterales | AI Safety Institute |

| China | Regulación de modelos generativos (2023) | Registro y evaluación de seguridad obligatoria | Cyberspace Administration of China |

| Argentina / Latinoamérica | Sin marco específico a mayo de 2026 | No aplica | Sin organismo designado |

El marco europeo es el más maduro y vinculante. El AI Act clasifica modelos por riesgo y exige evaluaciones de conformidad, incluyendo tests de red-teaming, para modelos de propósito general con capacidades por encima de cierto umbral computacional (10^25 FLOPs). El enfoque estadounidense, si prospera, sería más enfocado en seguridad nacional y menos en protección al consumidor, que es el eje del AI Act.

Qué significa para empresas y equipos en Latinoamérica

En el corto plazo, el impacto directo en Argentina, México o Colombia es bajo: el proceso aplica a las empresas que desarrollan modelos de frontera, no a quienes los usan. Pero hay efectos indirectos que vale monitorear.

Si el vetting genera demoras en los lanzamientos de modelos nuevos de Anthropic, Google o xAI, los equipos que planifican integraciones con versiones de API más recientes van a tener tiempos más impredecibles. También puede pasar que modelos aprobados “con condiciones” salgan al público con capacidades limitadas respecto a lo que se probó internamente, lo que afecta directamente a quien construye sobre esas APIs.

Para quien hostea aplicaciones de IA o maneja datos sensibles de usuarios en la nube, la pregunta de dónde están los modelos y qué saben de ellos los gobiernos se vuelve más relevante. Si eventualmente esto deriva en requisitos de auditoría que se exporten vía acuerdos comerciales, los proveedores de infraestructura como donweb.com van a necesitar clarificar sus posiciones sobre compliance de IA para clientes corporativos.

Errores comunes al interpretar esta noticia

Error 1: confundir vetting con censura. El proceso propuesto no evalúa si un modelo genera contenido “incorrecto” políticamente. Evalúa capacidades técnicas en dominios de seguridad nacional. Son cosas distintas, aunque en el debate público se mezclan seguido.

Error 2: asumir que esto ya es ley. A la fecha de esta publicación, la orden ejecutiva no fue firmada. Los reportes hablan de que se “estudia” y “considera”. Microsoft, Google y xAI firmaron acuerdos voluntarios, no están cumpliendo una ley. El escenario puede cambiar.

Error 3: creer que esto frena a China. Los modelos chinos como DeepSeek, Ernie o Qwen no van a someterse al vetting de la Casa Blanca. Si hay demoras en los lanzamientos de modelos americanos por el proceso de revisión, eso potencialmente amplía la ventana de los modelos chinos en mercados que no tienen restricciones de acceso. La lógica de “regular para competir mejor” tiene esa contradicción incorporada. Ya lo cubrimos antes en restricciones en disponibilidad de herramientas.

Esto se vincula con White House Considers Vetting A.I. Models Before They Are Re, donde cubrimos el tema en detalle.

Preguntas Frecuentes

¿Qué es el vetting de modelos de inteligencia artificial?

Es un proceso de revisión gubernamental en el que los desarrolladores de modelos de IA de frontera dan acceso previo al gobierno antes del lanzamiento público. Los evaluadores testean capacidades en dominios sensibles como ciberseguridad ofensiva, síntesis biológica u operaciones de inteligencia. El objetivo no es bloquear modelos sino detectar riesgos de seguridad nacional antes de que estén disponibles para cualquiera.

¿Por qué la Casa Blanca quiere evaluar modelos de IA antes de lanzarlos?

El detonante más concreto fue Mythos, un modelo de Anthropic con capacidades para detectar y explotar vulnerabilidades de software de hasta 27 años de antigüedad. La preocupación es que modelos con ese nivel de capacidades ofensivas lleguen al público sin ninguna supervisión externa. A eso se suma la presión por la competencia con China en IA militar y de seguridad.

¿Cómo evaluará el gobierno la seguridad de los modelos de IA?

El organismo coordinador sería el CAISI (Centro de IA, Seguridad e Innovación) del Departamento de Comercio, con participación de la NSA y la Oficina del Director de Inteligencia Nacional. Los evaluadores corren baterías de tests en dominios sensibles, documentan resultados y emiten una decisión de aprobación. El estándar técnico exacto de esos tests todavía no está definido públicamente.

¿Cómo impactará esto en empresas como Anthropic, Google y Microsoft?

Microsoft, Google DeepMind y xAI ya acordaron dar acceso previo a sus modelos al gobierno. Anthropic está en negociaciones. El impacto principal es que los lanzamientos de modelos nuevos podrían demorar si el proceso de revisión no tiene plazos definidos. También implica dar al gobierno acceso a información técnica sensible sobre los modelos, lo que genera fricciones sobre confidencialidad de propiedad intelectual.

¿Es lo mismo que la regulación de IA de la Unión Europea?

No. El AI Act europeo es un marco legal vinculante con enfoque en protección al consumidor y clasificación de riesgos por caso de uso. El vetting que estudia la Casa Blanca se enfoca en seguridad nacional y capacidades ofensivas, y por ahora se basa en acuerdos voluntarios entre empresas y el gobierno, sin ley que lo respalde. Los objetivos y mecanismos son distintos aunque ambos implican evaluación previa al lanzamiento.

Conclusión

La evaluación de modelos de IA antes del lanzamiento pasó de ser una propuesta académica a una negociación real entre la Casa Blanca y las empresas más grandes del sector. El caso Mythos dejó en evidencia que las decisiones sobre qué modelos llegan al público no pueden depender únicamente del criterio de la empresa que los desarrolla, y eso abrió una puerta regulatoria que difícilmente se cierre.

Lo que sigue siendo una incógnita es si el proceso va a ser técnicamente sólido, institucionalmente independiente, y lo suficientemente ágil para no convertirse en una ventaja para actores que no van a someterse a ningún vetting. Esas tres condiciones son difíciles de cumplir a la vez. Por ahora, lo que hay son acuerdos voluntarios con las empresas más grandes y una orden ejecutiva en preparación. Hay que verlo en funcionamiento antes de sacar conclusiones sobre si esto protege a alguien o simplemente agrega burocracia a quienes ya tienen el poder de negociación para navegarla.

Fuentes

- The New York Times — White House Considers Vetting A.I. Models Before They Are Released (4 mayo 2026)

- Reuters — White House considers vetting AI models before they are released (4 mayo 2026)

- Euronews — What is Anthropic’s Mythos, the leaked AI model that poses unprecedented cybersecurity risks (marzo 2026)

- Infobea — Vulneraron el modelo de IA que Anthropic consideró demasiado peligroso para el público (abril 2026)

- Xataka — La Casa Blanca quiere revisar los nuevos modelos de IA antes de que nadie los use