La orquestación multi-agentes MCP permite coordinar múltiples agentes de IA especializados usando Model Context Protocol como capa de comunicación estándar. En 2026, herramientas como agent-harness-kit (ahk) dan la infraestructura base para correr estos sistemas sin escribir scaffolding desde cero.

En 30 segundos

- La orquestación multi-agentes coordina agentes especializados que trabajan en paralelo o en cadena para resolver tareas complejas.

- Model Context Protocol (MCP) es el estándar abierto que permite que agentes, herramientas y LLMs se comuniquen sin depender de un proveedor específico.

- Agent-harness-kit (ahk) provee servidor MCP local, SQLite para persistencia, cola de tareas y health gate en un solo paquete instalable.

- Los patrones principales son orquestación centralizada (un supervisor), descentralizada (consenso entre pares) y jerárquica (capas de comando).

- Frameworks activos en 2026: CrewAI, LangGraph, mcp-agent, Mastra y OpenAI Agents SDK, cada uno con distinto tradeoff entre flexibilidad y curva de aprendizaje.

Qué es la orquestación multi-agentes

Un agente único puede hacer mucho. Pero poné a ese agente a resolver un análisis de contrato legal mientras simultáneamente busca jurisprudencia actualizada, verifica datos en una base interna y redacta el resumen ejecutivo. Solo, se traba. Con un equipo de agentes especializados coordinados, ese flujo se resuelve.

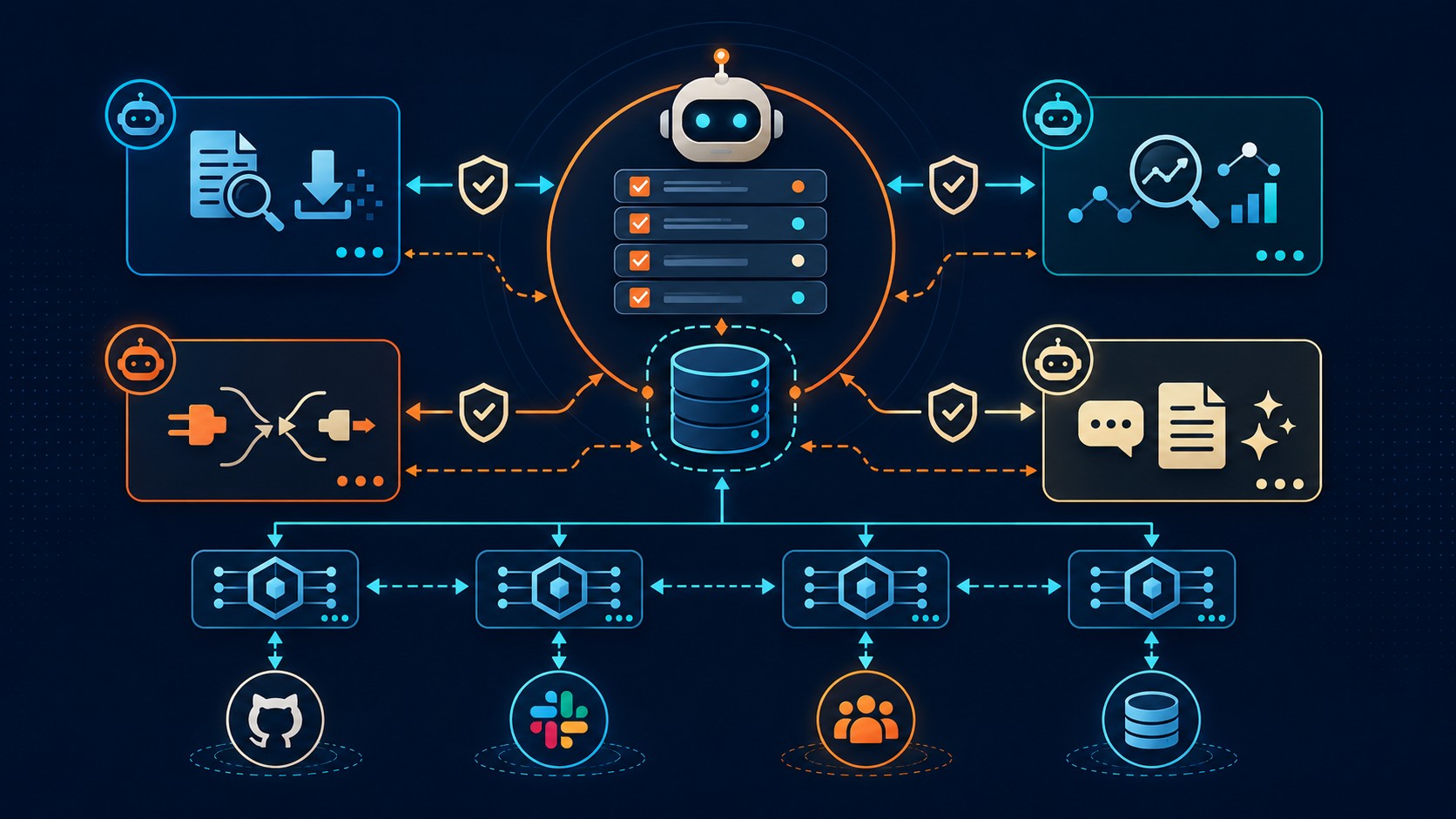

La orquestación multi-agentes es el conjunto de patrones, protocolos e infraestructura que permite que varios agentes de IA trabajen juntos sin pisarse. Cada agente tiene un rol definido, recibe tareas concretas, y devuelve resultados que otros agentes pueden consumir. El patrón más básico es Agent + Supervisor: un agente coordinador que delega subtareas a agentes especializados y consolida las respuestas.

Los beneficios son tres. Primero, especialización: cada agente hace bien una cosa en vez de hacer todo más o menos. Segundo, paralelismo: tareas independientes corren al mismo tiempo, no en secuencia. Tercero, escalabilidad: agregás agentes sin tocar los existentes.

El tema es que coordinar agentes no es trivial. ¿Cómo se pasan el contexto entre sí? ¿Cómo sabe el supervisor que un agente terminó? ¿Qué pasa cuando uno falla? Ahí entra MCP.

Model Context Protocol: el estándar para conectar agentes

Model Context Protocol es un protocolo abierto que estandariza cómo los LLMs se conectan con herramientas externas, fuentes de datos y otros agentes. Anthropic lo desarrolló y lo abrió a la comunidad; hoy Claude, ChatGPT (con plugins MCP), Cursor y la mayoría de los frameworks de agentes lo soportan de alguna forma. Para más detalles técnicos, mirá modelos con facturación por tokens.

La diferencia con una integración HTTP tradicional: MCP define un contrato de comunicación bidireccional con tipado, descubrimiento de capacidades y manejo de contexto incorporado. Un servidor MCP expone “tools” (funciones que el LLM puede llamar), “resources” (datos que puede leer) y “prompts” (plantillas reutilizables). El agente no necesita saber cómo está implementado el servidor, solo qué ofrece.

En un sistema multi-agentes, cada agente puede ser a la vez cliente MCP (consumiendo herramientas de otros) y servidor MCP (exponiendo sus capacidades). Eso crea una red donde los agentes se descubren, se llaman y se componen sin acoplamiento duro. Xataka explica el protocolo en detalle con ejemplos de cómo lo usan los asistentes actuales.

¿Qué herramientas lo soportan hoy? Claude via Anthropic API, Cursor, Windsurf, la mayoría de los frameworks Python de agentes y varios servicios de automatización como n8n. La adopción creció rápido en el primer trimestre de 2026.

Scaffolding multi-agentes: agent-harness-kit

Ponele que arrancás un proyecto de agentes desde cero. Necesitás: un servidor MCP que los agentes puedan consultar, algún lugar donde guardar el estado de las tareas, un mecanismo para encolar trabajo, y algo que detecte cuándo un agente se cayó. Si escribís todo eso vos, es fácil llegar a 400 líneas de código de infraestructura antes de escribir la primera línea de lógica de negocio.

Agent-harness-kit (ahk) empaqueta exactamente eso. Según su documentación oficial, incluye cuatro componentes: servidor MCP local, SQLite como capa de persistencia, task backlog para manejar la cola de trabajo, y un health gate que supervisa el estado de los agentes. La filosofía es que el scaffolding no debería ser parte de tu codebase de producto.

La comparación con código manual es concreta. Sin ahk, cada proyecto replica la misma infraestructura con variaciones sutiles que introducen bugs difíciles de detectar. Con ahk, ese código vive en un paquete versionado que podés actualizar independientemente.

Inngest argumentó en 2026 que el problema del ecosistema de agentes no es la falta de frameworks, sino la falta de harnesses: infraestructura de soporte que corra debajo de cualquier framework. La distinción importa: un framework te dice cómo estructurar los agentes, un harness te da lo que necesitan para correr de forma confiable.

Patrones y arquitecturas de orquestación

No hay una arquitectura universal. La que mejor funciona depende del tipo de tarea, la cantidad de agentes y cuánta tolerancia al fallo necesitás.

Orquestación centralizada

Un agente supervisor recibe la tarea, la descompone, delega a agentes especializados y consolida. Es el patrón más fácil de entender y debuggear porque hay un punto central de control. El problema: el supervisor es un cuello de botella y un single point of failure. Si se cae o alucina en la descomposición de tareas, todo el flujo se rompe. En cambios en herramientas disponibles profundizamos sobre esto.

Cuándo usarlo: flujos con dependencias claras entre subtareas, equipos chicos de agentes (2-5), casos donde la trazabilidad es crítica.

Orquestación descentralizada

Los agentes se coordinan por consenso, sin un supervisor central. Cada agente puede tomar iniciativa, proponer acciones y vetar las de otros. Más resiliente, pero mucho más difícil de implementar bien. Los loops infinitos y los deadlocks son problemas reales. (Spoiler: la mayoría de los tutoriales omiten convenientemente este punto.)

Cuándo usarlo: tareas donde el orden de ejecución es flexible, sistemas que necesitan alta disponibilidad, investigación o exploración abierta.

Orquestación jerárquica

Capas de supervisores. Un supervisor top-level delega a supervisores de nivel medio, que a su vez coordinan agentes operativos. Escala bien para sistemas grandes, pero la latencia aumenta con cada capa y la complejidad de debugging crece exponencialmente.

Cuándo usarlo: proyectos grandes con equipos distintos de agentes para distintos dominios, o cuando necesitás políticas de acceso diferenciadas por nivel.

Frameworks y herramientas disponibles en 2026

| Framework | Lenguaje | Soporte MCP | Curva de aprendizaje | Mejor para |

|---|---|---|---|---|

| CrewAI | Python | Sí (via MCP tools) | Media | Flujos de agentes en roles definidos |

| LangGraph | Python | Sí | Alta | Flujos con estado complejo y branching |

| mcp-agent | Python | Nativo | Baja-Media | Proyectos MCP-first desde cero |

| Mastra | TypeScript | Sí | Media | Stack JS/TS, integración con Next.js |

| OpenAI Agents SDK | Python/TS | Parcial | Baja | Prototipos rápidos con GPT-4o |

| n8n + MCP | Visual/JS | Sí | Baja | Automatización sin mucho código |

mcp-agent de LastMile AI merece atención especial porque está diseñado MCP-first: los workflows se construyen componiendo servidores MCP en vez de conectar librerías propietarias. Eso lo hace más portable entre providers. ClickHouse publicó una comparativa de 12 frameworks con benchmarks de latencia y overhead, vale revisarla antes de comprometerse con uno.

Una advertencia sobre el ecosistema: varios de estos frameworks cambiaron sus APIs entre diciembre 2025 y marzo 2026. Si encontrás tutoriales de esa época, revisá la versión antes de copiar el código. Esto se conecta con lo que analizamos en restricciones de acceso a herramientas.

Implementación con agent-harness-kit: lo que necesitás saber

La instalación es simple. Lo que no es simple es definir bien los límites de cada agente antes de arrancar.

El flujo básico con ahk: instalás el paquete, levantás el servidor MCP local, definís cada agente en su propio archivo de configuración (ahk recomienda máximo 4 archivos para proyectos chicos), configurás qué servidores MCP externos necesita cada agente, y levantás el health gate para que supervise el estado del sistema.

El task backlog de ahk funciona como una cola persistente. Si un agente se cae a mitad de una tarea, la tarea no se pierde: queda en SQLite y se reasigna cuando el agente vuelve o cuando el health gate detecta que hay capacidad disponible en otro agente compatible. Eso es lo que diferencia un sistema de producción de un prototipo.

Para testing local, ahk incluye un modo de simulación donde podés inyectar respuestas mock por agente y verificar que la orquestación se comporta como esperás antes de gastar tokens en pruebas reales. Quien haya quemado presupuesto de API debuggeando flujos de agentes en producción sabe que eso no es un detalle menor.

Si tu proyecto necesita correr en un servidor propio, donweb.com tiene planes de VPS y cloud donde podés desplegar estos sistemas con Python y Node.js sin complicaciones.

Casos de uso reales en producción

Soporte automatizado multiagente: un agente de clasificación recibe el ticket, lo categoriza y lo pasa al agente especializado correspondiente (facturación, técnico, cancelaciones). Cada agente tiene acceso solo a las herramientas que necesita. El supervisor consolida y decide si escalar a humano. Tiempo promedio de resolución de primer nivel: mucho menor que con un agente generalista que hace todo.

Procesamiento de documentos en cadena: agente extractor de texto, agente de normalización, agente de análisis semántico, agente de generación de resumen. Cada uno recibe el output del anterior via MCP. El pipeline puede pausar en cualquier punto, el estado persiste en SQLite, y podés reinspeccionar cada paso. Relacionado: integración de visión en workflows.

¿Y en revisión de código? Un agente detecta el diff, otro evalúa seguridad, otro revisa cobertura de tests, otro genera el comentario final. Cada uno especializado, corriendo en paralelo donde las dependencias lo permiten. El tiempo total es menor que un agente único que hace las cuatro cosas en secuencia.

Dicho esto, la mayoría de los casos de uso en producción hoy son relativamente lineales. Los sistemas con más de 5 agentes coordinados en paralelo real siguen siendo más demostración que producto. Tomalo con pinzas cuando leas benchmarks de sistemas “de 20 agentes”: el overhead de coordinación crece rápido.

Errores comunes al implementar orquestación multi-agentes

Errores de arquitectura que vale evitar:

- Darle demasiadas responsabilidades a un agente “generalista”: Si un agente puede hacer 15 cosas distintas, no es un sistema multi-agente, es un agente único con una interfaz confusa. La especialización es el punto central del patrón. Si el agente A hace análisis legal Y redacción Y búsqueda de jurisprudencia, perdiste los beneficios.

- Ignorar la gestión de contexto entre agentes: Pasar el contexto completo de cada turno entre agentes a través de MCP escala pésimo. Necesitás una estrategia de compresión o summarización de contexto antes de que el sistema llegue a flujos reales. Muchos prototipos que funcionan bien en demos se rompen con conversaciones largas por este motivo.

- No testear los fallos de agentes individuales: El escenario más común en producción es que un agente falle o devuelva una respuesta degenerada, no que todo funcione perfecto. Si el health gate y el sistema de retry no están probados explícitamente, descubrís sus bugs en el peor momento.

- Elegir el framework por popularidad, no por el caso de uso: LangGraph tiene una comunidad enorme, pero si tu caso es relativamente lineal y sin mucho branching, su complejidad es overhead puro. La guía de Javadex para empresas en 2026 tiene una tabla de decisión útil para elegir basándose en el tipo de flujo.

Preguntas Frecuentes

¿Qué es la orquestación multi-agentes MCP?

La orquestación multi-agentes con MCP es la coordinación de múltiples agentes de IA especializados usando Model Context Protocol como capa de comunicación estándar y agnóstica de proveedor. Cada agente expone sus capacidades como servidor MCP y consume las de otros como cliente. El resultado es un sistema donde agentes pueden colaborar sin depender de una librería específica o de un solo LLM.

¿Cómo funciona agent-harness-kit (ahk)?

Agent-harness-kit provee cuatro componentes de infraestructura: un servidor MCP local para comunicación entre agentes, SQLite para persistencia del estado, un task backlog para manejar la cola de trabajo, y un health gate que monitorea la disponibilidad de cada agente. Se instala como paquete Python y permite definir el sistema de agentes en archivos de configuración separados. Su principal ventaja es que el scaffolding técnico vive fuera del código de producto.

¿Cuál es la diferencia entre orquestación centralizada y descentralizada?

La orquestación centralizada tiene un agente supervisor que coordina todo: más fácil de debuggear pero es un punto de fallo único. La descentralizada permite que los agentes se coordinen entre sí sin supervisor: más resiliente pero más compleja de implementar correctamente. Para la mayoría de los proyectos en 2026, la arquitectura centralizada es el punto de partida recomendado hasta que el sistema demuestre necesitar otra cosa.

¿Qué frameworks puedo usar para construir sistemas multi-agentes con MCP?

En 2026 los más activos son: mcp-agent (Python, nativo MCP), CrewAI (Python, roles definidos), LangGraph (Python, flujos complejos con estado), Mastra (TypeScript, ecosistema JS) y OpenAI Agents SDK (Python/TS, prototipado rápido). Para casos sin mucho código, n8n integra servidores MCP visualmente. La elección depende del lenguaje del proyecto, la complejidad del flujo y si ya usás un proveedor específico de LLMs.

¿MCP es solo para Claude o funciona con otros LLMs?

MCP es un protocolo abierto, no está atado a Claude ni a Anthropic. Funciona con cualquier LLM que tenga soporte para llamada de herramientas (tool use / function calling). ChatGPT, Gemini, Mistral y los modelos open-source más populares pueden integrarse con servidores MCP. Esa es la ventaja principal del protocolo: podés cambiar el LLM subyacente sin reescribir la capa de integración.

Conclusión

El scaffolding siempre fue el trabajo sucio que nadie quería hacer dos veces. Con agent-harness-kit, ese trabajo queda encapsulado y la orquestación multi-agentes MCP pasa de ser un ejercicio de arquitectura a algo que podés levantar en un día. No es magia: todavía necesitás pensar bien los límites de cada agente y testear los escenarios de fallo. Pero la barrera de entrada bajó.

Lo que más cambia en 2026 es que MCP empieza a funcionar como lingua franca real entre herramientas de distintos proveedores. Eso significa que los agentes que construyas hoy con un LLM son más portables que los que construiste hace dos años con SDKs propietarios. Vale la pena invertir en entender el protocolo bien, no solo en aprender a usar el framework de moda.

Si estás evaluando si escalar tu sistema actual de agente único a multi-agentes, la pregunta concreta es: ¿hay subtareas que hoy corren en secuencia pero no tienen dependencias entre sí? Si la respuesta es sí, el paralelismo de multi-agentes tiene sentido. Si no, un agente bien configurado sigue siendo la opción más simple y la más fácil de mantener.

Fuentes

- Agent Harness Kit (ahk) – Documentación oficial del scaffolding MCP

- mcp-agent en GitHub – Framework MCP-first de LastMile AI

- Inngest – Por qué los agentes necesitan un harness, no un framework

- ClickHouse – Comparativa de 12 frameworks para construir agentes con MCP

- Javadex – Guía de agentes IA con MCP para empresas 2026