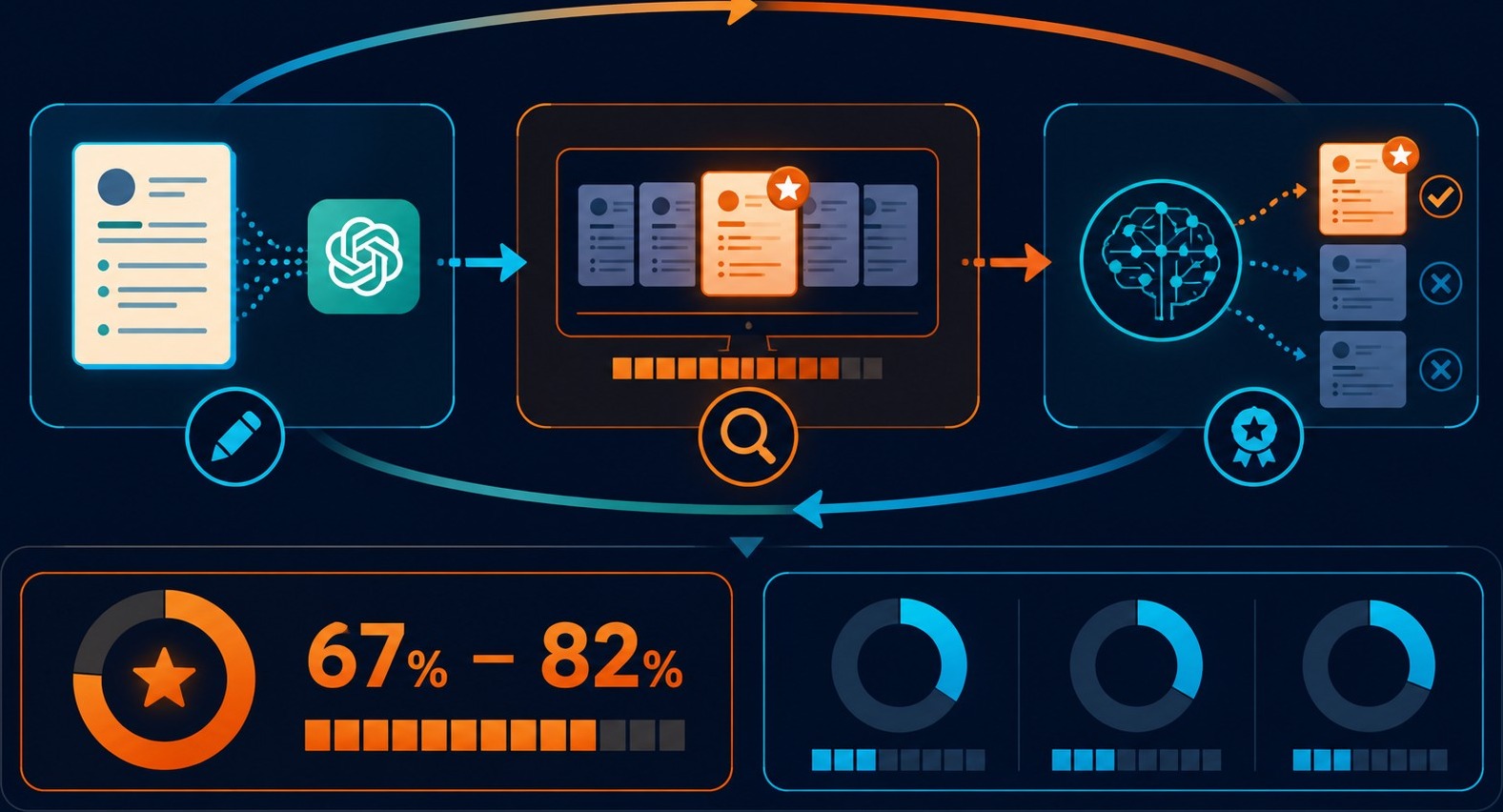

Los modelos de lenguaje prefieren consistentemente los currículos que ellos mismos generaron sobre los escritos por humanos o por otros modelos. Un estudio publicado en arXiv encontró que los LLMs eligen su propio contenido entre el 67% y el 82% de los casos, lo que significa que un candidato que usó el mismo modelo que el evaluador tiene entre 23% y 60% más chances de avanzar en un proceso de selección.

En 30 segundos

- Los LLMs eligen su propio contenido en el 67-82% de los casos al evaluar currículos en competencia directa.

- Candidatos que usan el mismo modelo que el evaluador tienen hasta un 60% más de chances de pasar el filtro.

- El sesgo LLM en selección de candidatos no se limita a resumes: afecta resúmenes académicos, descripciones de productos y cualquier texto evaluado por IA.

- Intervenciones como el CV ciego o el uso de múltiples modelos reducen el sesgo más del 50%.

- El 66% de las personas encuestadas rechazan que la IA tome decisiones finales de contratación, pero los sistemas ATS con IA son ya mayoría en empresas medianas y grandes.

Qué es el sesgo de auto-preferencia de LLMs

El sesgo de auto-preferencia es la tendencia de un modelo de lenguaje a calificar más alto el contenido que él mismo generó cuando se le pide comparar textos. No es un error de programación ni una decisión de diseño consciente: es un comportamiento emergente del proceso de entrenamiento, donde el modelo aprendió que cierto tipo de construcciones son “buenas” porque las produjo miles de veces y las asoció con respuestas aprobadas por revisores humanos. El sesgo LLM en selección de candidatos es una manifestación concreta de ese patrón en contextos donde los modelos evalúan resumes, cartas de presentación o perfiles.

Lo que hace que este problema sea difícil de detectar en producción es que el sistema no sabe que está eligiendo su propio trabajo. Para él, simplemente está evaluando calidad.

Las estadísticas clave del problema en contratación

El paper de arXiv (disponible como arXiv:2509.00462) analizó cómo distintos LLMs evalúan resumes cuando algunos fueron generados por IA y otros por humanos. Los resultados no dan mucho margen para la duda.

Entre el 67% y el 82% de las veces, el modelo elige el curriculum que él mismo generó cuando compite contra uno escrito por un humano o por otro modelo. La ventaja para candidatos que usan el mismo modelo que el sistema de evaluación llega al 23-60% según el sector. Los sectores más afectados son ventas y contabilidad, donde el formato del resume tiende a ser más estandarizado y la similitud de estructura entre lo que genera el modelo y lo que evalúa es más alta.

¿Y qué pasa cuando se compara contra otro modelo, no contra un humano? El sesgo se mantiene. GPT prefiere GPT. Claude prefiere Claude. No se trata de “IA vs. humano” sino de “yo vs. el resto”.

Cómo surge este sesgo: el ciclo de retroalimentación

El mecanismo es bastante claro una vez que lo ves. Un candidato genera su resume con ChatGPT. La empresa usa el mismo modelo (o una versión similar) en su sistema ATS para hacer el primer filtro. El modelo lee el texto, reconoce los patrones de vocabulario, la estructura de los bullets, las frases de transición, y los asocia con “calidad” porque son los mismos patrones que él produce cuando se le pide redactar bien. Lo profundizamos en nuestro artículo sobre plataformas de evaluación profesional.

El problema se amplifica con el tiempo. Más candidatos usan IA para escribir resumes, más empresas usan IA para evaluarlos, más datos de aprobación van a entrenar las siguientes versiones del modelo, y el ciclo vuelve a empezar. Lo que empezó como un atajo conveniente para el candidato se convierte en una señal de selección involuntaria para el evaluador.

Este patrón aparece también fuera de los resumes. Según el mismo estudio, el fenómeno se reproduce en descripciones de productos (preferencia de 89% para contenido IA vs. 36% para contenido humano), resúmenes académicos (78% vs. 61%) y resúmenes de películas (70% vs. 58%). El resume es el caso más urgente porque tiene consecuencias directas sobre el empleo de personas reales.

Comparativa: contenido generado por IA vs. escrito por humanos en evaluaciones de LLMs

| Tipo de contenido | Preferencia por contenido IA (%) | Preferencia por contenido humano (%) |

|---|---|---|

| Resumes (promedio) | 67-82% | 18-33% |

| Descripciones de productos | 89% | 36% |

| Resúmenes académicos | 78% | 61% |

| Resúmenes de películas | 70% | 58% |

Ojo con cómo leer esta tabla: los porcentajes de la columna “humano” no son el complemento de los de IA porque en algunos tests los evaluadores tenían que rankear múltiples opciones. Lo que importa es la brecha: en todos los casos, el contenido generado por IA sale ganando ante un evaluador que también es IA.

Ejemplos de sesgo en sistemas de contratación reales

El caso más citado en discusiones sobre sesgo en IA de RRHH sigue siendo el algoritmo de selección de Amazon que, según reportes de 2018, penalizaba resumes que incluían la palabra “mujeres” (como en “capitana del equipo de mujeres de ajedrez”) porque el modelo aprendió de datos históricos donde la mayoría de los candidatos aprobados eran hombres. Amazon terminó descartando ese sistema.

Ese caso ilustra algo que el paper de arXiv extiende: el sesgo no necesita ser intencional ni demográfico para afectar resultados. Podés tener un sistema que discrimina entre “escribió el resume con ChatGPT” y “lo escribió con sus propias palabras” sin que nadie lo haya diseñado para hacer eso, pero lo hace igual.

Hoy, la mayoría de los sistemas ATS medianos y grandes en Latinoamérica usan alguna forma de procesamiento de lenguaje natural para hacer el primer filtro. Muchos de esos sistemas corren sobre modelos de la misma familia que los que usan los candidatos para escribir sus CVs. El escenario que describe el paper no es hipotético: está pasando ahora. Lo explicamos en detalle en nuestro artículo sobre cómo demuestra ChatGPT en tests.

Características que distinguen un resume generado por IA de uno escrito por humanos

Si alguna vez leíste diez resumes generados con ChatGPT seguidos, sabés de qué hablo. Hay un patrón inconfundible: bullet points que empiezan con “Lideré”, “Optimicé”, “Implementé”, oraciones perfectamente simétricas, transiciones formales casi idénticas, y una densidad de palabras como “impacto”, “sinergias” y “entorno dinámico” que ningún humano pondría tantas veces sin que le duela.

Los modelos tienen vocabulario preferido. Investigaciones sobre las palabras más frecuentes en texto generado por ChatGPT mostraron que términos como “crucial”, “pivotal”, “tailored”, “realm” y “commendable” aparecen con una frecuencia muy por encima de la del uso humano promedio. En resumes en español, el equivalente son construcciones como “contribuí al crecimiento sostenido” o “desarrollé competencias clave en entornos ágiles”: perfectamente correctas, perfectamente inodoras, perfectamente predecibles.

Un resume humano tiene irregularidades: una frase cortada, un cargo con la puntuación un poco rara, una descripción que suena más coloquial que las demás. Esas imperfecciones, que en teoría son defectos, son exactamente lo que hace que un evaluador humano sienta que hay una persona real detrás del documento. Para un LLM evaluador, esas mismas irregularidades pueden leerse como señales de menor “calidad”.

Soluciones y estrategias de mitigación

El mismo paper que documentó el problema también probó intervenciones. Las conclusiones son alentadoras: con los cambios correctos, el sesgo se reduce más del 50%.

Las estrategias con mejor resultado son tres. Primero, el curriculum ciego: evaluar el texto sin metadatos de autoría (sin nombre, sin foto, sin datos que correlacionen con grupos demográficos). Segundo, usar múltiples modelos para la evaluación en vez de uno solo, lo que diluye la preferencia de auto-reconocimiento de cualquier modelo individual. Tercero, auditar los patrones de vocabulario específicos de cada modelo y filtrarlos activamente del pipeline de evaluación.

Dicho esto, ninguna de estas soluciones está implementada en la mayoría de los sistemas ATS comerciales hoy. El mercado de software de RRHH se movió rápido para incorporar IA, pero los frameworks de fairness existentes fueron diseñados pensando en sesgos demográficos (género, etnia, edad), no en sesgos de origen del texto. Hay un gap regulatorio real acá.

Implicaciones éticas y lo que viene

Hay algo estructuralmente incómodo en un sistema donde la ventaja la tiene quien usó la misma herramienta que el evaluador. No es meritocracia, es compatibilidad de estilos entre generadores de texto. Cubrimos ese tema en detalle en nuestro análisis sobre modelos de lenguaje avanzados.

Los frameworks de fairness en IA van a tener que expandirse. Análisis de sesgos algorítmicos en modelos generativos ya señalan que los marcos regulatorios actuales no contemplan este tipo de discriminación indirecta. No discriminás por quién sos sino por cómo escribiste. O más preciso: por si usaste la herramienta “correcta”.

Las encuestas también muestran resistencia social: el 66% de las personas consultadas rechaza que la IA tome decisiones finales de contratación. El problema es que “decisión final” y “primer filtro que nadie revisa” son categorías difíciles de distinguir en la práctica cuando el filtro elimina el 80% de los candidatos antes de que un humano vea un solo resume.

La necesidad de transparencia en las decisiones de IA en contratación va a ser un tema regulatorio concreto en los próximos años. La UE ya tiene el AI Act con requisitos específicos para sistemas de alto riesgo en empleo. Latinoamérica no tiene ese marco todavía, aunque Argentina y Brasil tienen proyectos en discusión.

Qué significa para empresas y equipos que contratan hoy

Si tu empresa usa algún sistema de filtro automatizado de resumes, vale preguntarse: ¿qué modelo subyace a ese sistema? ¿Lo saben? ¿Hay auditoría de los resultados por grupo de candidatos? ¿Alguien revisó si el sistema está filtrando candidatos perfectamente calificados que simplemente escribieron sus CVs a mano?

Para candidatos, la situación es complicada. Si no sabés qué modelo usa el sistema ATS de la empresa a la que aplicás, no podés optimizar para él. Y si todos optimizan para el modelo dominante, el resume “humano” queda en desventaja estructural. La alternativa de usar IA para escribir el CV y luego editarlo con tu voz real es probablemente el punto medio más razonable hoy.

Errores comunes al abordar este problema

Creer que el problema es “IA vs. humanos” y no “IA vs. IA diferente”. El sesgo más documentado no es que los LLMs discriminen el contenido humano en abstracto, sino que prefieren su propio estilo. Un texto de Claude evaluado por Claude sale bien. Un texto de Claude evaluado por GPT puede salir mal. La variable relevante es la compatibilidad de modelos, no la autoría humana o artificial.

Asumir que si el sistema ATS usa IA “avanzada” está libre de sesgos. La complejidad del modelo no reduce el sesgo de auto-preferencia. Según el paper, los modelos más grandes y capaces también muestran el patrón, en algunos casos con mayor consistencia porque son más capaces de identificar sus propios patrones de escritura. Complementá con nuestro análisis de lo que también sucede en Google.

Pensar que la solución es prohibir el uso de IA en la escritura de resumes. Eso es inviable de aplicar y probablemente contraproducente. El foco tiene que estar en el lado del evaluador: diversificar los modelos usados en screening, implementar CV ciego, y auditar resultados. Pedirle al candidato que no use herramientas disponibles no resuelve el sesgo del evaluador.

Preguntas Frecuentes

¿Por qué los modelos de lenguaje prefieren resumes generados por IA?

Los LLMs asocian ciertos patrones de vocabulario y estructura con “calidad” porque los aprendieron durante el entrenamiento. Cuando esos patrones coinciden con los propios (auto-preferencia), el modelo los califica más alto. No es una decisión consciente: es un efecto emergente del proceso de aprendizaje por refuerzo con feedback humano.

¿Cuánto sesgo tienen los LLMs al evaluar currículos?

Entre el 67% y el 82% de las evaluaciones, el LLM elige el resume que él mismo generó. Para candidatos que usaron el mismo modelo que el evaluador, la ventaja es de 23% a 60% más chances de avanzar, dependiendo del sector. Los sectores con formatos más estandarizados (ventas, contabilidad) muestran sesgos más altos.

¿Cómo afecta el sesgo de IA a candidatos con CV escrito por humanos?

Un candidato que escribió su CV sin asistencia de IA compite en desventaja cuando el sistema de evaluación usa un LLM. Las irregularidades del texto humano (variaciones de estilo, vocabulario menos estandarizado) que son naturales para un lector humano se leen como señales de menor calidad para el evaluador automatizado. El impacto es mayor en el primer filtro, donde el humano todavía no intervino.

¿Cómo se puede reducir el sesgo de LLMs en procesos de contratación?

Las intervenciones más efectivas según el estudio reducen el sesgo más del 50%: usar CV ciego (sin datos de autoría), diversificar los modelos en el pipeline de evaluación (que ningún modelo evalúe solo), y auditar activamente los patrones de vocabulario asociados a cada modelo. Ninguna de estas medidas requiere eliminar la IA del proceso, solo cambiar cómo se aplica.

¿Qué diferencias concretas hay entre un currículum generado por IA y uno escrito por humanos?

Los resumes generados por IA tienen alta simetría estructural, bullet points con verbos de impacto estandarizados (“lideré”, “optimicé”, “implementé”), y vocabulario repetitivo asociado al modelo (en inglés: “crucial”, “pivotal”, “tailored”; en español: “contribuí al crecimiento sostenido”, “entornos ágiles”). Los textos humanos tienen más variación de estilo, imperfecciones naturales y vocabulario más idiosincrático. Esas diferencias son detectables estadísticamente incluso sin herramientas especializadas.

Conclusión

El sesgo LLM en selección de candidatos no es un problema futuro: está ocurriendo en cualquier empresa que use sistemas ATS con IA para el primer filtro, que a esta altura son la mayoría. El paper de arXiv documenta con números lo que muchos sospechaban: usar el modelo “equivocado” para escribir tu resume puede costarte una oportunidad laboral sin que nadie en el proceso lo sepa o lo haya decidido conscientemente.

Para empresas que contratan, la pregunta ya no es si usar IA en RRHH sino cómo auditarla. Diversificar los modelos de evaluación y revisar los resultados por subgrupos de candidatos debería ser el mínimo no negociable. Para candidatos, la realidad es que escribir el CV con la misma herramienta que usa el evaluador puede ser una ventaja real, aunque eso dice bastante sobre el estado actual del sistema.

Los frameworks regulatorios van a llegar, pero van lento. Hasta entonces, el sesgo lo absorben los candidatos que eligieron escribir con sus propias palabras.

Fuentes

- arXiv:2509.00462 — Paper original sobre auto-preferencia de LLMs en evaluación de resumes

- Katrank — Sistemas de IA muestran preferencia por contenido generado por IA

- Blog Donweb — ChatGPT y el vocabulario predecible de la IA

- Fundar — Sesgos algorítmicos y representación social en modelos de lenguaje generativo

- Red Seguridad — Discriminación e IA: sesgos en casos reales