El 90% de los agentes IA en producción falla antes de completar tareas reales de negocio, según múltiples análisis de implementaciones enterprise en 2026. El problema no es el modelo de lenguaje: los LLMs razonan bien. El problema es que los workflows fueron diseñados para mundos que no existen.

En 30 segundos

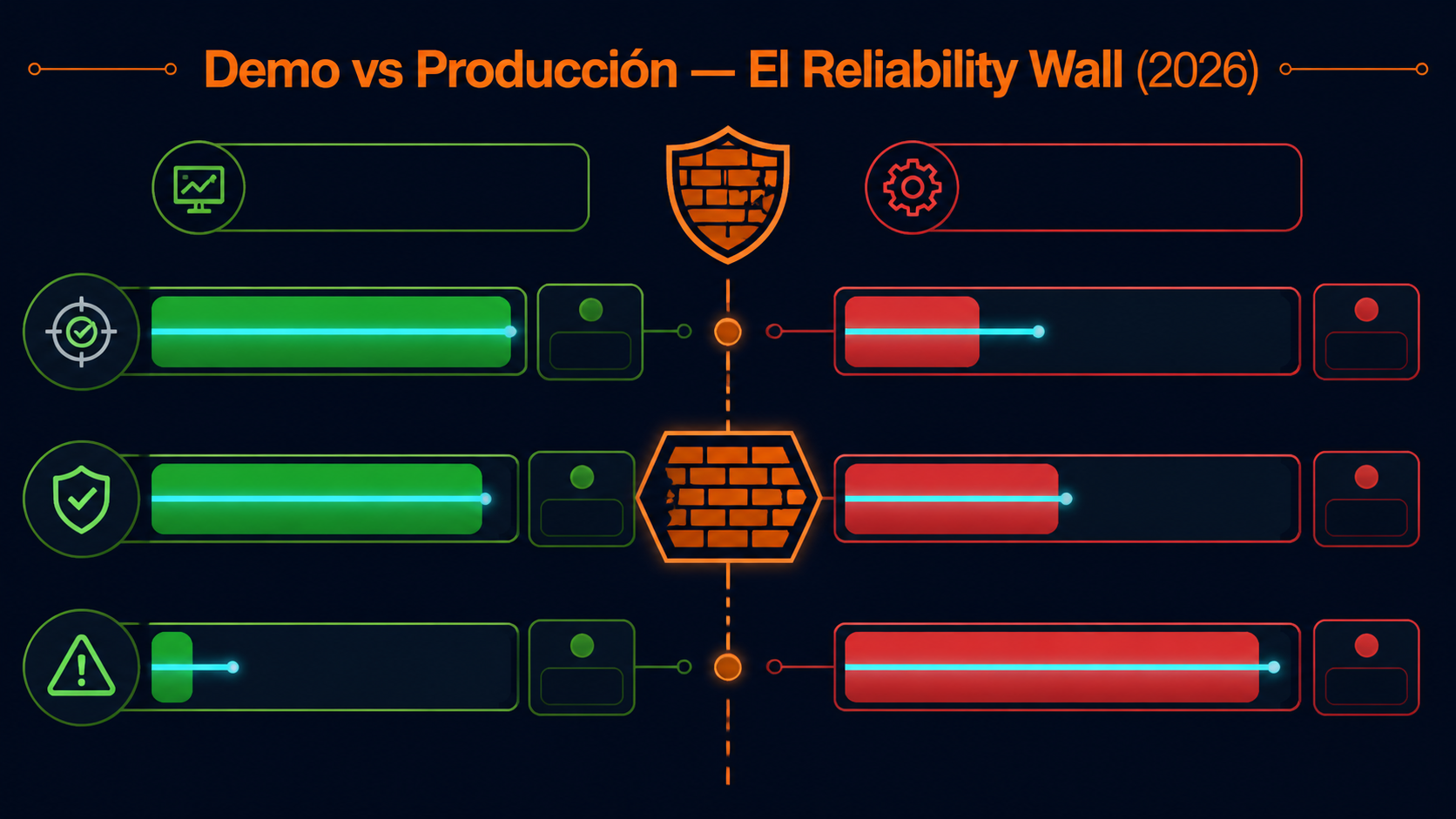

- Solo el 30-35% de agentes IA completan tareas multiturno en entornos de producción real, contra casi 100% en demos controladas.

- El “Reliability Wall” es la barrera entre demos perfectas y producción real: la mayoría de workflows asumen sincronía y determinismo que el mundo real no tiene.

- El problema más frecuente: agentes que no pueden manejar verificación de email, eventos externos o esperas asincrónicas.

- Falta de contexto, hallucinations y ausencia de supervisión humana multiplican los errores en cascada.

- Arquitecturas con manejo explícito de asincronía, retry logic y supervisión humana clara son lo que diferencia los agentes que funcionan.

La brecha demo vs producción: por qué el 90% falla

El Reliability Wall es la barrera invisible que separa a un agente IA que funciona en un entorno controlado de uno que falla sistemáticamente en producción. No es una falla del modelo. Es una falla de arquitectura.

Ponele que armás un agente en n8n para automatizar el registro a una prueba gratuita de un SaaS. Lo probás en local: el agente navega el formulario, llena los campos, genera el request. Funciona perfecto. Lo mandás contra el sistema real y el workflow se detiene. ¿Por qué? Porque el servicio envió un email de verificación y el agente no tiene forma de recibirlo ni de esperar (spoiler: esto rompe el 80% de los flujos de onboarding automatizados).

Según el análisis publicado en Dev.to en abril de 2026, este patrón es el que quiebra la mayoría de pipelines de agentes en plataformas de orquestación: fueron diseñados para sistemas determinísticos y síncronos, pero la web real es asincrónica y depende de eventos externos.

La demo siempre funciona porque vos controlás todas las variables. La producción no.

Qué es el Reliability Wall y por qué existe

El Reliability Wall no es un concepto de marketing. Es el nombre que le puso la comunidad al patrón recurrente donde agentes que pasan todos los tests internos se rompen al tocar usuarios reales, APIs reales, tiempos reales.

La raíz del problema tiene tres capas:

- Asincronía no contemplada: el agente toma una decisión correcta pero el resultado depende de un evento futuro (un email, un webhook, una aprobación humana) que el workflow no puede esperar.

- Variables externas impredecibles: CAPTCHAs, rate limits, cambios de UI en terceros, sesiones que expiran, errores transitorios de red.

- Contexto incompleto: el modelo razona bien con la información que tiene, pero le falta información que nadie le dio.

Lo que hace al Reliability Wall especialmente frustrante es que según Xataka, los agentes se equivocan en más del 70% de los casos en tareas del mundo real. El modelo genera respuestas fluidas y coherentes. Da la sensación de que está funcionando. Y de repente tomó una decisión basada en datos que no tiene, inventó un parámetro de API que no existe, o lleva tres intentos enviando el mismo formulario porque nunca recibió confirmación.

El problema de los sistemas asincrónicos: email, webhooks y esperas

Fijate en este escenario: un agente tiene que crear una cuenta en un servicio para completar una tarea. El flujo es claro: elegir plan, llenar datos, hacer clic en “Crear cuenta”. Hasta ahí, perfecto. El problema es lo que viene después. Sobre eso hablamos en estándares de seguridad robustos.

El servicio manda un email de verificación. El agente no tiene bandeja de entrada. No puede hacer polling a un servidor IMAP en tiempo real. No sabe si esperar 30 segundos o 5 minutos. El workflow queda suspendido en el vacío, o peor, falla con un timeout genérico que no le dice nada a nadie.

Este no es un edge case raro. Es el estándar de la web moderna. Prácticamente todo flujo de onboarding serio usa verificación de email, 2FA, o algún tipo de confirmación asincrónica. Los agentes diseñados para APIs limpias y documentadas no están preparados para esto.

La solución no es trivial. Requiere diseñar el workflow desde el inicio con la asincronía como ciudadana de primera clase: inbox temporal dedicado al agente, lógica de espera con timeout explícito, manejo del “qué hago si no llega el email en 10 minutos”, y una salida elegante en vez de un crash sin contexto.

Falta de contexto y gobernanza: cuando el agente toma malas decisiones

Hay un segundo tipo de falla que es más silencioso y más peligroso: el agente toma decisiones que parecen razonables pero son incorrectas porque le falta contexto crítico.

Ponele que el agente tiene que clasificar tickets de soporte y redirigirlos al equipo correcto. Le das acceso a la base de conocimiento, le explicás las categorías, arranca bien. Pero nadie le dijo que los tickets marcados con una cierta etiqueta interna son de clientes VIP que van directo al equipo senior, sin importar la categoría técnica del problema. El agente clasifica correctamente según las reglas que conoce, y manda tickets de un cliente que paga USD 50.000 por mes a la cola general.

Según Ecosistema Startup, este tipo de error de contexto incompleto es uno de los más frecuentes en implementaciones de agentes en software crítico. Y el problema de gobernanza que genera es serio: ¿quién audita las decisiones del agente? ¿cómo sabés cuándo se equivocó? ¿hay un humano que pueda interceptar antes de que el daño sea irreversible?

Las hallucinations agravan todo. El modelo puede inventar un endpoint de API que no existe, un parámetro con un nombre levemente incorrecto, o una función que “debería” estar en el SDK pero no está. Todo con la misma confianza narrativa que cuando acierta (que es lo que hace especialmente difícil detectar el error). En con plataformas LLM principales profundizamos sobre esto.

La curva exponencial de precisión: por qué pasar del 80% al 95% es casi imposible

Acá viene lo bueno, o más bien lo incómodo: llegar al 70% de precisión en una tarea de agente es relativamente rápido. Cualquier modelo decente con buenos prompts llega ahí en pocas iteraciones.

Pasar de 70% a 80% ya requiere trabajo. De 80% a 90% es una ingeniería seria. Y pasar el 90% hacia algo que puedas llamar “confiable” para producción… eso con modelos generativos actuales es el tipo de promesa que conviene tomar con pinzas.

El problema estructural es que los modelos de lenguaje son probabilísticos. El mismo input puede producir outputs ligeramente diferentes. En tareas de escritura o síntesis, eso está bien. En tareas donde un solo paso incorrecto rompe todo el workflow downstream, el 5% de error en cada nodo se multiplica: si tenés 10 pasos en cadena con 95% de éxito cada uno, la probabilidad de completar el flujo entero sin error es 0.95^10 = 59.9%. O sea, fallás en 4 de cada 10 ejecuciones.

Nadie publicita ese número en las demos.

Qué está confirmado y qué no sobre el Reliability Wall

| Aspecto | Estado | Detalle |

|---|---|---|

| Tasa de fallo en producción (90%) | Confirmado | Múltiples análisis independientes de 2026 coinciden en que la gran mayoría de agentes falla en tareas reales multiturno |

| El problema principal es la asincronía | Confirmado | Email verification, webhooks y eventos externos son las causas más frecuentes según Dev.to y análisis de n8n |

| Hallucinations en APIs | Confirmado | Modelos generan endpoints y parámetros inexistentes con alta confianza narrativa |

| Solución con arquitecturas robustas | Parcialmente confirmado | Los patrones existen, pero no hay un estándar adoptado ampliamente; varía mucho por plataforma |

| Cuándo los modelos llegarán a 99%+ confiabilidad | Sin confirmar | No hay estimaciones verificables; los fabricantes hablan de “mejoras continuas” sin fechas concretas |

Soluciones: cómo diseñar agentes confiables desde el inicio

La buena noticia es que el Reliability Wall no es una ley de la física. Es una consecuencia de malas decisiones de arquitectura que se pueden corregir.

Los patrones que funcionan en producción, según el análisis de CIO, comparten tres características: supervisión humana explícita en puntos críticos, manejo de asincronía desde el diseño inicial, y testing riguroso de edge cases antes de ir a producción.

Diseñar para la asincronía

Si tu workflow va a interactuar con servicios externos, asumí desde el principio que habrá esperas, timeouts y eventos que llegan en momentos impredecibles. Creá mailboxes temporales dedicados al agente para recibir verificaciones. Definí timeout handlers explícitos con salidas elegantes. Nunca dejés que el workflow quede suspendido sin un plan B.

Supervisión humana en puntos de alto riesgo

No todos los pasos necesitan supervisión humana, pero algunos sí. Identificá los puntos donde un error es difícil de revertir (enviar un email a 10.000 clientes, procesar un pago, borrar datos) y poné un checkpoint humano antes. No como excepción: como parte del diseño. Relacionado: optimizando los prompts de entrada.

Retry logic con contexto, no retry a ciegas

Reintentar una acción que falló por timeout es razonable. Reintentar una acción que falló porque el agente inventó un parámetro de API solo va a fallar de nuevo. El retry logic tiene que distinguir entre errores transitorios y errores de razonamiento, y escalar al humano cuando corresponde.

Caso práctico: cuándo n8n + agentes funciona y cuándo no

n8n es una plataforma de orquestación genuinamente capaz. Maneja node chaining, branching, retries y credential management de forma limpia. Cuando lo conectás con un LLM via el nodo AI Agent, el agente puede razonar sobre inputs, llamar APIs externas y decidir qué hacer. Para muchos casos de uso, esto alcanza.

Los casos donde funciona bien son claros: scraping de datos estructurados, llamadas a APIs con lógica condicional, generación de contenido desde templates, clasificación y ruteo de datos entrantes. El LLM maneja la ambigüedad, n8n maneja la orquestación.

Los casos donde falla son igualmente claros:

- Flujos con dependencias de email o SMS (verificaciones, 2FA, confirmaciones)

- Interacción con sistemas legacy que no tienen APIs limpias

- Workflows que requieren esperar feedback del usuario antes de continuar

- Tareas donde un error en el paso 3 hace irreversible todo lo anterior

El criterio práctico: si el workflow puede describirse como “llamar API A, procesar resultado, llamar API B”, probablemente va a funcionar. Si necesita “esperar a que el usuario haga X” o “recibir confirmación externa antes de continuar”, necesitás una arquitectura diferente desde el principio.

Qué significa esto para equipos en Latinoamérica

La presión para implementar agentes IA en producción es real. Los directores de tecnología reciben demos impecables y quieren el mismo resultado en sus sistemas. El gap entre la expectativa y la realidad está generando proyectos que fracasan silenciosamente, o peor, que funcionan el 80% del tiempo y nadie sabe cuándo son el 20%.

Para equipos que están evaluando agentes para automatización de procesos, la recomendación práctica es empezar con casos de uso donde la asincronía no es un factor, donde los errores son detectables y reversibles, y donde hay un humano que puede supervisar las primeras 200 ejecuciones antes de automatizar completamente. Si necesitás infraestructura para alojar estos workflows, plataformas con servidores en la región como donweb.com reducen la latencia y simplifican la parte operativa.

Errores comunes al implementar agentes IA

Error 1: usar la demo como prueba de concepto válida

Una demo exitosa no es evidencia de que el agente va a funcionar en producción. La demo usa datos limpios, sistemas controlados y escenarios sin variables externas. El piloto real necesita datos reales, sistemas reales y el permiso de fallar de formas inesperadas. Si no probaste con email verification, con rate limits reales, con timeouts de red reales, no probaste nada. Cubrimos ese tema en detalle en al orquestar flujos automatizados.

Error 2: asumir que retry automático soluciona todo

Agregar retry logic sin distinguir el tipo de error es uno de los errores más caros. Un agente que falla porque inventó un endpoint que no existe va a seguir fallando en el reintento número 10. Y en el 11. Mientras tanto gastó créditos de API, escribió logs inútiles y posiblemente dejó datos a medias en sistemas externos. El retry tiene que tener lógica de diagnóstico antes de decidir si reintentar o escalar.

Error 3: no definir qué hace el agente cuando no sabe qué hacer

Los modelos de lenguaje no dicen “no sé” con facilidad. Tienden a generar una respuesta plausible aunque no tengan los datos para respaldarla. Si el agente llega a un punto del workflow donde le falta información crítica y no tiene una salida definida, va a inventar algo. Definí explícitamente las condiciones de parada y los puntos de escalada humana antes de que el agente empiece a improvisar.

Podés leer más sobre esto en The “Reliability Wall”: Why 90% of AI Agents fail at real-wo.

Esto se conecta con The “Reliability Wall”: Why 90% of AI Agents fail at real-wo, donde profundizamos en los problemas reales de los agentes.

Para profundizar en esto, mirá The “Reliability Wall”: Why 90% of AI Agents fail at real-wo.

Esto se conecta directo con The “Reliability Wall”: Why 90% of AI Agents fail at real-wo, donde analizamos el tema en profundidad.

Esto se conecta con The “Reliability Wall”: Why 90% of AI Agents fail at real-wo, donde cubrimos el tema en detalle.

Preguntas Frecuentes

¿Por qué mi agente IA falla en producción si funciona perfecto en demos?

Las demos usan entornos controlados donde todas las variables son predecibles. En producción aparece asincronía real: emails de verificación, timeouts de red, rate limits, usuarios que hacen cosas inesperadas. El agente no está roto, el workflow fue diseñado para un mundo que no existe. La solución es rediseñar con asincronía y manejo de errores desde el principio.

¿Qué es el Reliability Wall en agentes IA?

El Reliability Wall es el nombre con el que la comunidad técnica describe la barrera entre agentes que funcionan en demos controladas y los que falvan al escalar a tareas reales con usuarios reales. El 90% de los agentes no supera esta barrera. La causa principal no es el modelo de lenguaje sino la arquitectura del workflow, que no contempla asincronía, variables externas ni puntos de falla reales.

¿Cómo hacemos que los agentes IA sean confiables en producción?

Los tres patrones que funcionan son: diseñar explícitamente para asincronía (mailboxes temporales, timeout handlers, webhooks), incluir supervisión humana en puntos de alto riesgo antes de automatizar completamente, y usar retry logic que distingue errores transitorios de errores de razonamiento. Empezar con casos de uso donde los errores son detectables y reversibles reduce significativamente el riesgo.

¿Por qué los agentes IA tienen problemas con la verificación de email?

Porque la mayoría de workflows de agentes están diseñados para sistemas síncronos y determinísticos. La verificación de email requiere esperar un evento externo en un tiempo indeterminado, con una cuenta de correo que el agente pueda realmente leer. Plataformas como n8n no resuelven esto automáticamente: hay que diseñar el workflow con un inbox temporal dedicado, lógica de polling y manejo del caso donde el email nunca llega.

¿Qué tasa de éxito real tienen los agentes IA en tareas multiturno?

Análisis de 2026 estiman que entre 30% y 35% de los agentes completan tareas multiturno en producción real. El número cae aún más cuando los workflows tienen 10 o más pasos, porque los errores se multiplican: con 95% de éxito por paso, la probabilidad de completar 10 pasos sin error cae al 59.9%. Llegar a 99%+ de confiabilidad con modelos generativos actuales sigue siendo un objetivo sin fecha confirmada.

Conclusión

El Reliability Wall no desaparece solo con mejores modelos. Mientras los workflows sigan siendo diseñados para el mundo ideal de las demos, van a seguir fallando en el mundo real. La diferencia entre el 10% de agentes que funciona en producción y el 90% que no está en la arquitectura: cómo manejan la asincronía, qué hacen cuando les falta contexto, dónde tienen un humano que puede interceptar antes del daño.

Si estás evaluando implementar agentes en 2026, el punto de partida no es elegir el mejor modelo. Es hacer la lista honesta de todo lo que puede salir mal en producción, y diseñar para eso desde el día uno. Los casos de uso donde n8n más LLMs funcionan bien existen y son valiosos. El problema es venderlos como solución universal antes de haberlos probado en condiciones reales.

Fuentes

- Dev.to (Franco Fuji) – Why AI Agents in n8n Fail on Real-World Workflows

- Xataka – Tenemos un gran problema: los agentes IA se equivocan el 70% de las veces

- CIO – Tres enfoques para reducir los fallos de los agentes de IA

- Ecosistema Startup – Por qué fallan los agentes de IA en software clave: el contexto

- blog.donweb.com – Qué impide la ejecución en sistemas agentes