En 2026, las alternativas a Fireworks AI más veloces son Groq (456 tokens/segundo, latencia 0.19s), Together AI (917 TPS, 200+ modelos open-source), WaveSpeedAI (acceso exclusivo a modelos de ByteDance) y Lepton AI (serverless sin cold starts). La elección depende del caso de uso: velocidad pura, variedad de modelos o presupuesto ajustado.

En 30 segundos

- Groq lidera en velocidad bruta con 456 TPS y TTFT menor a 300ms gracias a sus LPUs propios, ideal para chat en tiempo real.

- Together AI ofrece 917 TPS y más de 200 modelos open-source, con fine-tuning incluido en la plataforma.

- WaveSpeedAI da acceso exclusivo a modelos de ByteDance (Seedream, Kling) para casos multimodales con imagen y video.

- Lepton AI y Replicate apuntan a startups con precios bajos y sin penalización por arranque en frío.

- Fireworks AI sigue siendo competitivo para DeepSeek (27.32s TTFT vs 128.46s en la API oficial), pero no es la única opción.

¿Por qué buscar alternativas a Fireworks AI?

Fireworks AI es una plataforma de inferencia LLM que permite correr modelos open-source —como Llama, Mistral o DeepSeek— a través de una API optimizada para baja latencia. Funciona sobre GPUs compartidas con configuraciones personalizadas que, en muchos casos, mejoran notoriamente los tiempos de respuesta respecto a las APIs oficiales de los modelos.

Dicho eso, no es la solución perfecta para todo. Hay tres escenarios donde empezás a mirar para otro lado:

- Necesitás velocidad extrema para voz o chat en tiempo real y cada milisegundo cuenta.

- Querés hacer fine-tuning sobre el modelo que estás usando, y Fireworks cobra aparte por eso.

- Tu caso de uso es multimodal (imagen, video) y los modelos disponibles no alcanzan.

Además, el pricing por token en Fireworks es competitivo pero no el más barato del mercado en todos los segmentos. Según el comparativo de InfraBase, dependiendo del modelo y el volumen, hay alternativas que recortan costos hasta un 40%.

Groq: el especialista en velocidad pura

Groq es la opción que se nombra cada vez que alguien pregunta por alternativas a Fireworks AI 2026 con foco en latencia. La razón concreta: usa LPUs (Language Processing Units), hardware propio diseñado específicamente para inferencia de LLMs, no GPUs reutilizadas de otra cosa.

Los números que maneja Groq en benchmarks de 2026: 456 tokens por segundo, TTFT (time-to-first-token) menor a 300ms, latencia promedio de 0.19 segundos. Para una aplicación de voz o un chat donde el usuario está esperando respuesta, esa diferencia se siente. Ya lo cubrimos antes en procesamiento visual rápido con ChatGPT.

La contrapartida es clara: el catálogo de modelos es limitado. Groq soporta Llama 3 (8B y 70B), Mixtral, Gemma y algunos modelos más, pero si necesitás algo más específico o experimental, no lo vas a encontrar ahí. Tampoco tienen fine-tuning. Es una apuesta por velocidad, no por versatilidad.

Pricing: alrededor de USD 0.10 por millón de tokens de entrada en Llama 3 70B (según el benchmark de Toolhalla), lo que lo pone en un rango competitivo con Fireworks para ese modelo específico.

Together AI: versatilidad más velocidad competitiva

Together AI apunta a otro segmento. No es el más rápido en latencia pura, pero tiene 200+ modelos open-source disponibles, incluidos algunos que no encontrás en Groq ni en Fireworks, y ofrece fine-tuning integrado en la misma plataforma.

En throughput, los números son llamativos: 917 TPS en sus configuraciones más agresivas, con una latencia de alrededor de 0.78 segundos. Para inferencia en batch o aplicaciones donde el throughput importa más que el TTFT, Together puede ser más eficiente que Groq.

¿Cuándo tiene sentido usarlo? Cuando estás experimentando con modelos distintos sin querer migrar de plataforma cada vez, o cuando necesitás fine-tuning y querés que todo esté en el mismo lugar. También si trabajás con Mistral, CodeLlama o variantes menos mainstream de Llama.

El fine-tuning en Together parte desde USD 3 por hora de GPU A100. No es barato, pero tampoco implica armar infraestructura propia. En integración ágil de Gemini profundizamos sobre esto.

WaveSpeedAI y Mistral: opciones para casos específicos

WaveSpeedAI es interesante si tu aplicación no es solo texto. Según su propio blog de 2026, la plataforma tiene acceso exclusivo a modelos de ByteDance como Seedream y Kling para generación de imagen y video. Si estás construyendo algo multimodal, eso es un diferenciador real.

El catálogo total supera los 600 modelos entre texto, imagen y video. Para LLM puro, la velocidad es competitiva pero no excepcional. Donde brilla es en esa intersección de texto con generación visual.

Mistral, por otro lado, es una opción válida si tu caso es LLM puro en español o francés y querés un proveedor europeo con modelos propios optimizados. Sus APIs son directas, bien documentadas, y los modelos Mistral Large y Mixtral tienen buen desempeño en tareas de razonamiento. Lo que no tiene es el catálogo amplio ni las velocidades extremas de Groq.

Lepton AI y Replicate: inferencia serverless para presupuestos reales

Ponele que estás armando un MVP, tenés tráfico variable y no querés pagar por GPU idle. Lepton AI y Replicate son las opciones para ese escenario.

Lepton ofrece inferencia serverless sin cold starts perceptibles, con precios por token competitivos y sin compromiso de volumen. La latencia no es la de Groq, pero para una aplicación que no es tiempo real estricto, zafa bien. También aloja DeepSeek con velocidades comparables a Fireworks en muchos benchmarks.

Replicate tiene un modelo similar: pagás por segundo de cómputo, tiene una variedad grande de modelos disponibles como API, y es especialmente fuerte en modelos de imagen (Stable Diffusion y derivados). Para LLM puro es menos optimizado que las otras opciones, pero si tu aplicación mezcla texto con imagen, puede simplificar la arquitectura. Sobre eso hablamos en alternativas europeas de IA.

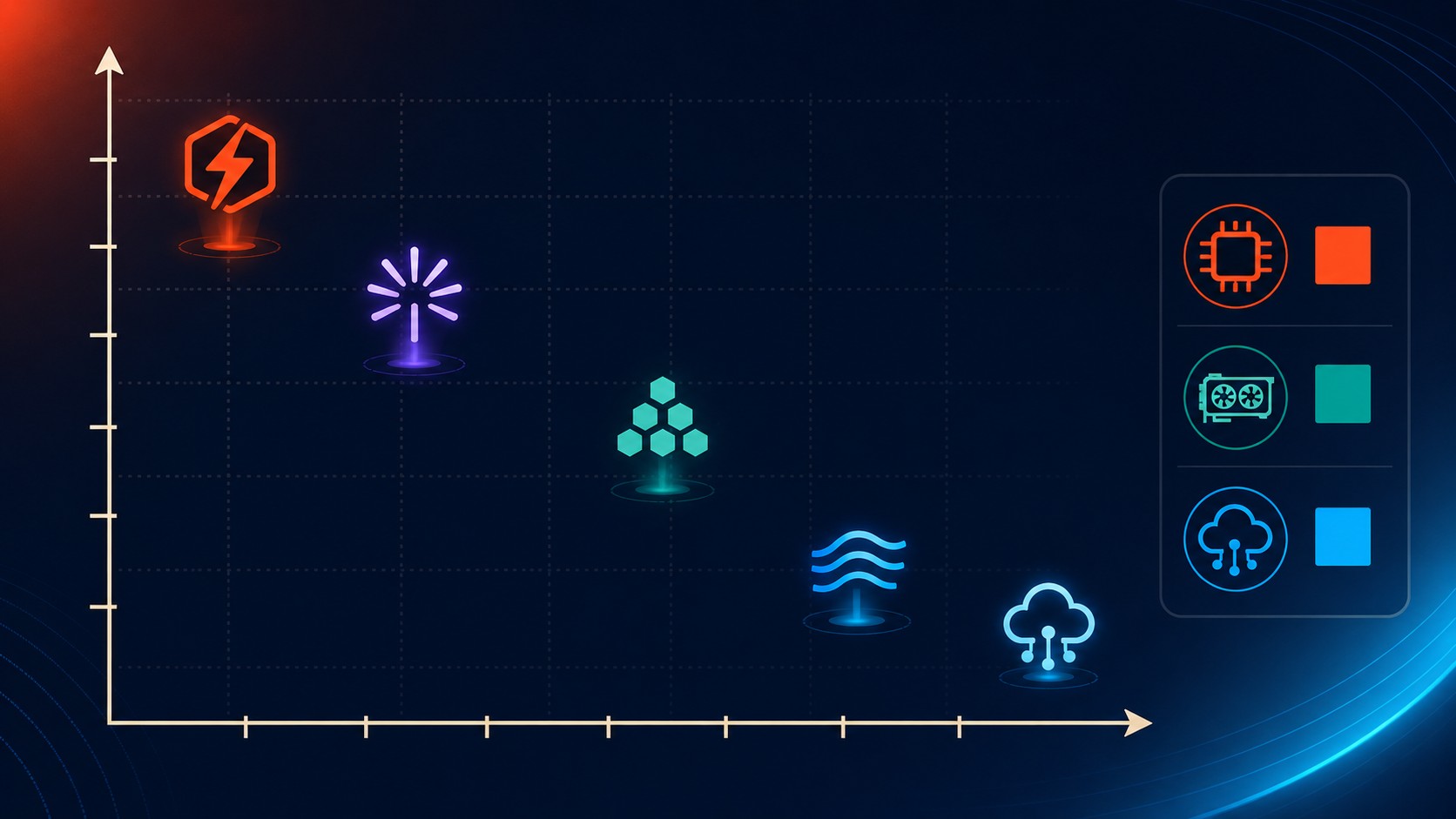

Comparativa: velocidad, costo y variedad de modelos

| Plataforma | TPS | TTFT (aprox.) | Modelos disponibles | Fine-tuning | Precio aprox. (M tokens entrada) |

|---|---|---|---|---|---|

| Fireworks AI | ~200-300 | ~0.4s | ~50 curados | Sí (adicional) | USD 0.20 |

| Groq | 456 | <0.3s | ~15 seleccionados | No | USD 0.10 |

| Together AI | 917 | ~0.78s | 200+ | Sí (integrado) | USD 0.18 |

| WaveSpeedAI | Variable | ~0.5s | 600+ (multimodal) | No | Variable |

| Lepton AI | ~150-250 | ~0.6s | ~30 | No | USD 0.15 |

| Replicate | Variable | Variable | Alta variedad | No | Por segundo GPU |

Los números de TPS no son comparables uno a uno: dependen del modelo, la longitud del prompt y la configuración. Tomalo como orientación, no como benchmark definitivo (especialmente los del propio fabricante, que siempre miden en el escenario más favorable para ellos).

DeepSeek en Fireworks versus otras plataformas

Un caso concreto donde Fireworks brilla: DeepSeek. Según benchmarks de latencia de 2026, Fireworks logra un TTFT de 27.32 segundos para DeepSeek R1, versus 128.46 segundos en la API oficial del modelo. Esa diferencia es enorme para una aplicación real.

¿Alguien más lo iguala? Sí, pero no siempre. Together AI y Lepton también alojan DeepSeek con velocidades competitivas, aunque los números varían según la versión del modelo y la carga del servidor en cada momento. SiliconFlow, una plataforma menos conocida en Latinoamérica, también aloja DeepSeek con TTFT comparable en sus pruebas internas (que aún no tienen verificación independiente amplia).

El punto es que si DeepSeek es tu modelo principal, Fireworks sigue siendo muy buena opción, pero ya no es la única.

Cómo elegir la alternativa correcta para tu caso

La decisión no es complicada si tenés claro qué estás construyendo.

- Chat en tiempo real o voz: Groq, sin dudas. La diferencia en TTFT se traduce directamente en experiencia de usuario.

- Aplicación SaaS en producción con modelo definido: Fireworks sigue siendo sólido. Buena latencia, buen soporte, optimizaciones para modelos populares.

- Investigación, experimentación o fine-tuning: Together AI. Variedad de modelos y fine-tuning en el mismo lugar.

- Caso multimodal (texto + imagen + video): WaveSpeedAI, especialmente si necesitás los modelos de ByteDance.

- Presupuesto limitado o tráfico variable: Lepton AI o Replicate. Serverless, sin compromiso de volumen.

Si tu equipo necesita infraestructura web para desplegar la aplicación, donweb.com ofrece VPS y hosting con soporte en español para equipos latinoamericanos que no quieren lidiar con soporte en inglés.

Errores comunes al migrar de Fireworks AI

Comparar solo por TPS sin medir TTFT. El throughput alto no te sirve de nada si tu aplicación es conversacional y el primer token tarda 2 segundos. Medí los dos. En producción, el TTFT es lo que percibe el usuario; el TPS es lo que percibís vos en el costo.

Asumir que el mismo modelo da los mismos resultados. Llama 3 70B en Groq y en Together puede dar respuestas levemente distintas porque las configuraciones de inferencia (temperatura base, cuantización, etc.) no son idénticas. Antes de migrar en producción, corré tu suite de evaluación en el nuevo proveedor. Te puede servir nuestra cobertura de Llama como opción económica.

Ignorar la variabilidad según carga. Los benchmarks suelen medirse con servidores en horario valle. Tu aplicación va a competir por capacidad con otros clientes. Medí en horario pico antes de comprometerte con un proveedor.

Preguntas Frecuentes

¿Cuáles son las mejores alternativas a Fireworks AI en 2026?

Groq lidera para velocidad pura (456 TPS, TTFT bajo 300ms). Together AI es la mejor opción si necesitás variedad de modelos o fine-tuning. WaveSpeedAI aplica para casos multimodales. Lepton AI y Replicate son las alternativas más económicas para tráfico variable.

¿Groq es más rápido que Fireworks AI?

En TTFT, sí: Groq logra menos de 300ms versus los ~400ms promedio de Fireworks. En throughput, Groq también supera a Fireworks en la mayoría de los benchmarks de 2026. El costo es un catálogo de modelos mucho más limitado.

¿Dónde puedo correr DeepSeek con baja latencia?

Fireworks AI es la opción más documentada: 27.32s TTFT versus 128.46s en la API oficial. Together AI y Lepton también alojan DeepSeek con latencias competitivas. La diferencia entre estas plataformas tiende a achicarse con las versiones más recientes del modelo.

¿Cuánto cuesta Together AI comparado con Fireworks?

Together AI cobra alrededor de USD 0.18 por millón de tokens de entrada en Llama 3 70B; Fireworks ronda USD 0.20 en el mismo modelo. La diferencia es marginal para bajo volumen, pero puede ser relevante a escala. El fine-tuning en Together parte de USD 3/hora de GPU A100.

¿WaveSpeedAI sirve para LLM de texto puro?

Funciona, pero no es su fuerte. WaveSpeedAI brilla en casos multimodales con imagen y video, especialmente con los modelos exclusivos de ByteDance. Para LLM de texto puro, Groq, Together o Fireworks dan mejor rendimiento y más opciones de modelos.

Conclusión

Fireworks AI sigue siendo una opción sólida en 2026, sobre todo para DeepSeek y para equipos que ya tienen su stack armado ahí. Pero el mercado de inferencia LLM maduró: ya hay alternativas reales con ventajas concretas en casos específicos.

Groq ganó la carrera de velocidad con hardware propio. Together AI ganó la de versatilidad. WaveSpeedAI abrió el juego multimodal. Lepton y Replicate bajaron la barrera de entrada para equipos chicos.

La pregunta que vale hacerte: ¿tu aplicación necesita el primer token en menos de 300ms, o necesita acceso a 200 modelos distintos? Esa respuesta te lleva directo al proveedor correcto, sin necesidad de benchmark exhaustivo.