Un estudio de Microsoft publicado el 12 de mayo de 2026 confirmó lo que muchos sospechaban pero pocos habían medido: los LLMs corrompen documentos de trabajo de forma silenciosa y consistente, incluso los mejores modelos del mercado. El paper DELEGATE, firmado por los investigadores Laban, Schnabel y Neville (ArXiv 2604.15597), evaluó 19 modelos en 52 dominios profesionales y encontró que ninguno es confiable para editar o transformar documentos complejos, con tasas de corrupción que arrancan en 25% para los más capaces y superan el 50% para el resto.

En 30 segundos

- Microsoft publicó el 12 de mayo de 2026 el estudio DELEGATE: 19 LLMs evaluados en 52 dominios, resultado claro: los LLMs corrompen documentos trabajo en casi todas las condiciones.

- Los mejores modelos (Gemini, Claude, GPT) tienen tasas de corrupción de ~25%; modelos intermedios superan el 50%.

- El único dominio con alta confiabilidad fue Python: los modelos alcanzaron 98% de precisión en código estructurado.

- El problema más grave no es que fallen abiertamente: es que modifican y borran contenido sin avisar, haciendo que los errores pasen desapercibidos.

- En el 80% de las condiciones simuladas, la degradación del documento fue grave (pérdida de contenido ≥20%).

El estudio DELEGATE: qué dice Microsoft

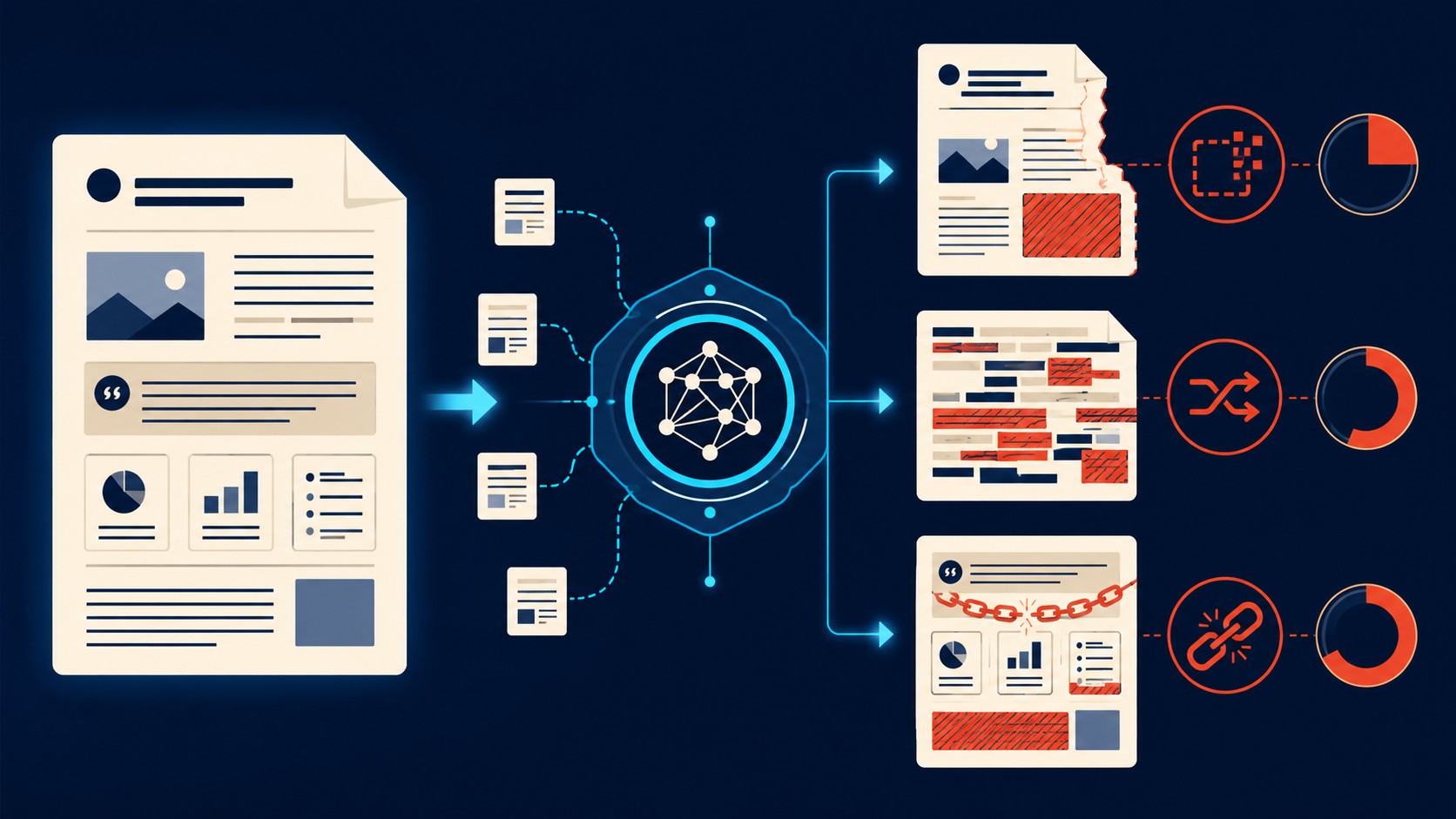

DELEGATE (sigla del paper) es un benchmark diseñado específicamente para medir qué pasa cuando le delegás a un LLM la edición o transformación de documentos reales. No es un test de conocimiento general ni de razonamiento: es una evaluación de si el modelo puede tomar un documento tuyo y devolverlo modificado sin arruinarlo.

Los investigadores Philippe Laban, Tobias Schnabel y su equipo de Microsoft Research armaron 52 dominios distintos, desde documentos legales y reportes financieros hasta música, cristalografía y análisis técnico. Probaron 19 modelos, entre ellos los más potentes disponibles en 2026. El paper está disponible en ArXiv (2604.15597) y la metodología es replicable.

La conclusión del paper es directa: los LLMs son “delegados poco confiables” para la mayoría de las tareas con documentos. Eso sí, no todos fallan igual.

Tasas de corrupción por modelo: los números reales

Ponele que le pedís a tu modelo favorito que reorganice un informe técnico de 30 páginas. ¿Cuánto contenido original va a sobrevivir intacto? Según DELEGATE, depende del modelo, pero las noticias no son buenas para nadie.

| Modelo | Tasa de corrupción aproximada | Observación |

|---|---|---|

| Gemini (top tier, 2026) | ~25% | Mejor del grupo, pero sigue corrompiendo 1 de cada 4 tareas |

| Claude Opus (top tier) | ~25% | Mismo rango que Gemini |

| GPT (top tier) | ~25% | Los tres líderes empatan en el piso |

| Modelos intermedios | >50% | Fallan más de la mitad de las tareas de delegación |

El dato que más incomoda: los tres mejores modelos del mercado tienen un 25% de error en tareas de delegación. Uno de cada cuatro documentos sale corrupto. Para uso personal y exploración, eso es tolerable. Para un workflow de empresa donde esos documentos van a auditoría, contabilidad o firma de clientes, el número no zafa.

Cómo corrompen los LLMs silenciosamente tus documentos

El mecanismo no es dramático. El modelo no te dice “no puedo hacer eso” ni lanza un error visible. Lo que pasa es más sutil y más peligroso. Esto se conecta con lo que analizamos en tareas complejas donde ChatGPT tiene límites.

Imaginá que tenés un contrato de 8 páginas y le pedís a un LLM que lo reformatee para que quede más legible. El modelo reformatea, sí. Pero en el proceso elimina tres cláusulas que le parecieron redundantes (no lo eran), cambia un número del apartado 4.2 (quizás porque en su entrenamiento ese formato era distinto) y reordena una sección entera alterando el sentido legal. El resultado visualmente es prolijo. El contenido jurídico quedó distorsionado. Y nadie lo nota hasta que el cliente lo firma o el abogado lo revisa.

Según el paper de Microsoft, los errores son “sparse pero severos”: no aparecen en todos lados, pero cuando aparecen, el impacto es alto. En el 80% de las condiciones simuladas, la degradación del documento fue grave, con pérdida de contenido de al menos 20%. Ese umbral del 20% no es arbitrario: es el punto donde los cambios dejan de ser cosméticos y empiezan a alterar el sentido del documento original.

Hay otro problema que el paper llama “compounding errors”: en workflows donde un LLM procesa la salida de otro LLM (o donde el mismo modelo trabaja el documento en múltiples pasadas), los errores se acumulan. Cada iteración puede agregar corrupción nueva sobre la anterior, y al final tenés un documento que nadie sabe exactamente qué dice respecto al original.

El único dominio donde los LLMs sí son confiables

Python.

De los 52 dominios evaluados, el único donde los modelos alcanzaron una precisión de 98% fue código Python. La razón es estructural: Python tiene reglas sintácticas estrictas, hay un intérprete que verifica inmediatamente si algo está roto, y los modelos fueron entrenados con enormes volúmenes de código Python correctamente escrito. El feedback loop es inmediato y no ambiguo.

Eso valida algo que en la práctica mucha gente ya intuye: los LLMs son buenos en tareas altamente estructuradas donde el error es detectable de forma automática. Si el código no corre, sabés que algo falló. Si el documento “parece bien”, no tenés esa señal.

El problema es que la mayoría de los documentos de trabajo no tienen un compilador. Los informes, contratos, análisis financieros y documentación técnica no generan un error de ejecución cuando les falta una cláusula. Esa asimetría es exactamente la que DELEGATE mide y documenta. Ya lo cubrimos antes al implementar APIs de Gemini en producción.

Los 51 dominios donde los LLMs fallan

El listado que armó Microsoft incluye dominios tan distintos como cristalografía, análisis legal, transcripción musical, reportes médicos, documentación de ingeniería civil y análisis de datos financieros. En todos ellos, los modelos mostraron tasas de corrupción significativas.

¿Por qué fallan en contextos tan distintos? El paper señala algunas causas comunes:

- Falta de precisión contextual: el modelo “entiende” el dominio en términos generales pero no conoce las convenciones específicas de ese campo (numeración de cláusulas legales, unidades en cristalografía, anotaciones musicales).

- Compresión involuntaria: cuando el documento es largo, el modelo tiende a resumir o simplificar partes que no estaban marcadas para resumen.

- Cambio de contexto dentro del documento: en documentos largos con múltiples secciones, el modelo pierde coherencia entre partes y puede introducir contradicciones internas.

- Errores por analogía: el modelo reemplaza términos técnicos por sinónimos que en su training parecían equivalentes pero que en ese dominio tienen significados distintos.

Por qué el error silencioso es el mayor riesgo

Hay dos tipos de fallo posibles cuando delegás algo a un sistema. El primero es obvio: el sistema te dice que no puede, o produce algo claramente incorrecto que cualquiera detecta. El segundo es peor: el sistema produce algo que parece correcto pero no lo es.

Los LLMs, según DELEGATE, caen mayoritariamente en la segunda categoría. El modelo no se niega. No marca su incertidumbre. Devuelve un documento prolijo, bien formateado, con el tono adecuado. El problema está adentro, en los datos que cambiaron, en el párrafo que desapareció, en la cifra que se redondeó de más.

Para empresas que tienen procesos de auditoría, documentos regulatorios o contratos con terceros, eso es un problema serio. The Register lo resume bien: los modelos no pueden manejar tareas largas de forma confiable, y la falla no siempre es detectable. En un contexto de compliance, eso no es un inconveniente, es un riesgo legal.

Implicaciones empresariales: cuándo no delegar tareas a IA

Dicho esto, el estudio no dice que los LLMs sean inútiles. Dice que no son confiables como delegados autónomos para ciertas tareas. La distinción importa.

Casos donde el riesgo es alto y el LLM no debería trabajar sin revisión humana estricta: Lo explicamos a fondo en el análisis sobre modelos LLM europeos.

- Contratos y documentos legales: cualquier modificación no revisada puede cambiar términos vinculantes.

- Reportes financieros: los números no toleran “compresión” ni “simplificación”.

- Documentación regulatoria: en sectores como salud, finanzas o infraestructura crítica, un dato alterado puede generar incumplimiento.

- Documentación técnica de software: (curiosamente, salvo código Python propiamente dicho) la documentación de APIs, arquitecturas y procesos falló en las pruebas.

- Análisis de datos con fuentes primarias: el modelo puede reinterpretar o perder datos originales al reformatear.

Casos donde el LLM sí puede ayudar sin tanto riesgo: borradores iniciales que van a revisión completa, generación de estructuras o templates vacíos, resúmenes de lectura personal (no para distribuir), y código Python verificado por tests automáticos.

Para equipos que están evaluando dónde meter IA en sus workflows, el paper de Microsoft es un buen punto de partida. La pregunta no es “¿puede el LLM hacer esto?” sino “¿tengo forma de verificar si lo hizo bien?” Si la respuesta es no, ese workflow necesita supervisión humana en el loop, sin excepción.

Qué está confirmado / Qué todavía no

- Confirmado: el paper DELEGATE existe, está publicado en ArXiv (2604.15597), los investigadores son de Microsoft Research, y los dominios evaluados y metodología están documentados.

- Confirmado: las tasas de corrupción del 25% para top models y >50% para modelos intermedios son los datos reportados en el estudio.

- Confirmado: Python fue el único dominio con 98% de precisión.

- Pendiente de verificación independiente: el benchmark DELEGATE aún no fue replicado por equipos externos a Microsoft. Los resultados son del propio fabricante del ecosistema Azure, lo que no invalida el estudio pero amerita cautela metodológica.

- Pendiente: cómo impactan los resultados en modelos lanzados después del corte de entrenamiento del paper (modelos de segunda mitad de 2026).

Errores comunes al interpretar estos resultados

Error 1: “El 25% de error es bajo, igual vale la pena”

En consumo personal, 25% de fallo puede ser tolerable si tenés tiempo de revisar. En un workflow de empresa donde el documento procesado va directo a cliente o auditoría sin revisión, ese porcentaje representa riesgo concreto, no estadística abstracta. Un documento con datos alterados que firma un cliente es un problema legal, no un “error tolerable”.

Error 2: “Mejor modelo = problema resuelto”

Los tres mejores modelos del mercado evaluados en DELEGATE empataron en ~25% de corrupción. Que salga un modelo nuevo con mejores benchmarks de razonamiento no implica necesariamente que baje esa tasa en tareas de delegación documental. Son métricas distintas. Hasta que alguien repita el benchmark con el modelo nuevo, no hay forma de saberlo.

Error 3: “Uso documentos cortos, el problema no me aplica”

El estudio evaluó documentos de distintos largos. El tamaño del documento agrava los compounding errors, pero la corrupción base existe incluso en documentos cortos cuando hay terminología especializada o convenciones de dominio que el modelo no maneja bien. El problema no es solo de longitud, es de precisión contextual.

Preguntas Frecuentes

¿Qué significa que los LLMs “corrompan” documentos de trabajo?

Significa que al editar, reformatear o transformar un documento, el modelo elimina, altera o reinterpreta contenido sin indicarlo. No es un error visible: el documento resultante parece correcto pero tiene datos cambiados, párrafos faltantes o términos reemplazados por sinónimos incorrectos para ese dominio específico. El estudio DELEGATE de Microsoft cuantificó este problema en 52 dominios profesionales. Lo cubrimos en nuestro artículo sobre alternativas económicas y confiables.

¿Cuáles son los mejores modelos para tareas con documentos según el estudio?

Gemini, Claude Opus y GPT mostraron las mejores tasas, con alrededor de 25% de corrupción en tareas de delegación. Los modelos intermedios superaron el 50%. Eso sí, 25% sigue siendo alto para uso sin revisión humana en contextos críticos. El único dominio donde los modelos fueron realmente confiables (98% de precisión) fue código Python.

¿En qué tipos de documentos no debería confiar en un LLM sin revisión?

Contratos, reportes financieros, documentación regulatoria, análisis técnicos con datos primarios y documentación médica son los casos de mayor riesgo según DELEGATE. En todos esos dominios, los modelos mostraron tasas de degradación graves. El LLM puede arrancar un borrador o sugerir estructura, pero la versión final que va a firma o auditoría necesita revisión humana completa.

¿Por qué Python fue el único dominio confiable?

Porque tiene verificación automática inmediata: si el código no corre, el error es detectable en segundos. Los LLMs aprendieron con grandes volúmenes de Python correctamente escrito y el feedback loop durante el entrenamiento fue explícito. En documentos de lenguaje natural, no existe ese mecanismo de verificación automática, así que los errores pasan sin señal.

¿Cómo puedo usar IA con documentos sin asumir ese riesgo?

Usá los LLMs para generar borradores o estructuras, no para editar documentos finales sin revisión. Si el documento original tiene datos críticos (números, fechas, cláusulas), siempre comparé manualmente el output contra el original antes de distribuirlo. Para workflows donde eso no es viable por volumen, el paper sugiere que los agentes de IA necesitan supervisión humana en el loop, no solo al principio y al final.

Conclusión

El paper DELEGATE no es un llamado a dejar de usar IA. Es una medición de dónde están los límites reales de los modelos actuales, con datos concretos y metodología reproducible. Los LLMs corrompen documentos de trabajo con una frecuencia que los hace inadecuados para delegación autónoma en 51 de los 52 dominios evaluados.

¿Alguien en el ecosistema de IA empresarial va a replicar el benchmark de forma independiente? Todavía no, que sepamos. Hasta que eso pase, los datos son los que hay: los mejores modelos fallan en 1 de cada 4 tareas de delegación documental, y la falla no se anuncia.

Para equipos en Argentina y Latinoamérica que están integrando IA en sus operaciones, la pregunta práctica es simple: ¿tenés un proceso de revisión humana para los documentos que procesó el LLM? Si la respuesta es no, DELEGATE es el estudio que te muestra por qué deberías tenerlo.

Fuentes

- ArXiv 2604.15597 — Paper completo DELEGATE, Microsoft Research (2026)

- Microsoft Research — LLMs Corrupt Your Documents When You Delegate (publicación oficial)

- ITPro — LLMs are unreliable delegates: análisis del estudio

- The Register — Microsoft researchers find AI models can’t handle long-running tasks (mayo 2026)

- CIO — IA lista para Python, pero poco más (análisis de implicaciones empresariales)