Fast-Slow Training (FST) es un paradigma de entrenamiento de LLMs presentado por GEPA-AI en mayo de 2026 que combina dos tipos de actualización: prompts y capas de contexto como “pesos rápidos”, y los parámetros de red como “pesos lentos”. Según el blog de GEPA-AI, FST iguala el rendimiento de RL con hasta 3x menos pasos de entrenamiento, logrando 70% menos divergencia KL respecto al modelo base. Eso, en términos de adaptación continua de modelos IA, cambia bastante el panorama.

En 30 segundos

- FST separa el aprendizaje en dos capas: pesos rápidos (prompts + contexto) para adaptación específica por tarea, y pesos lentos (parámetros de red) para capacidades generales.

- Iguala el rendimiento de Reinforcement Learning con hasta 3x menos pasos de entrenamiento, según benchmarks en matemáticas, código y razonamiento general.

- Logra 70% menos divergencia KL respecto al modelo base, preservando la plasticidad: la capacidad de seguir aprendiendo después de especializarse.

- Los entrenamientos solo-pesos se estancan cuando cambia la tarea. FST mantiene el rendimiento incluso con múltiples cambios de tarea consecutivos.

- No es un producto ni una herramienta: es un enfoque de entrenamiento publicado como investigación abierta en mayo de 2026.

El problema fundamental: adaptación sin olvidar

Ponele que tenés un LLM de propósito general que funciona bárbaro en razonamiento lógico. Querés que ahora también sea bueno en código Python. Lo fine-tuneás con datasets de código. Funciona mejor en código. Y cuando volvés a probarlo en razonamiento, notás que perdió algo. No mucho, pero algo. Ese es el problema clásico del olvido catastrófico, y no tiene una solución simple.

El dilema es estructural. Cuando actualizás los parámetros de una red neuronal para que aprenda algo nuevo, esos parámetros son los mismos que codifican todo lo que ya sabía. Estás sobreescribiendo encima del conocimiento existente. Cuanto más específico es el nuevo entrenamiento, más erosionás la capacidad general del modelo. Es como tratar de grabar dos canciones distintas en el mismo cassette sin borrar la anterior.

La alternativa obvia es optimizar solo el prompt, sin tocar los pesos. Esto preserva el modelo base. El problema es que la optimización de prompts tiene un techo de rendimiento: llega hasta cierto punto y no puede subir más. Los parámetros de red pueden llegar más lejos. Así que el campo quedó atrapado entre dos opciones, ninguna ideal.

¿Qué es Fast-Slow Training?

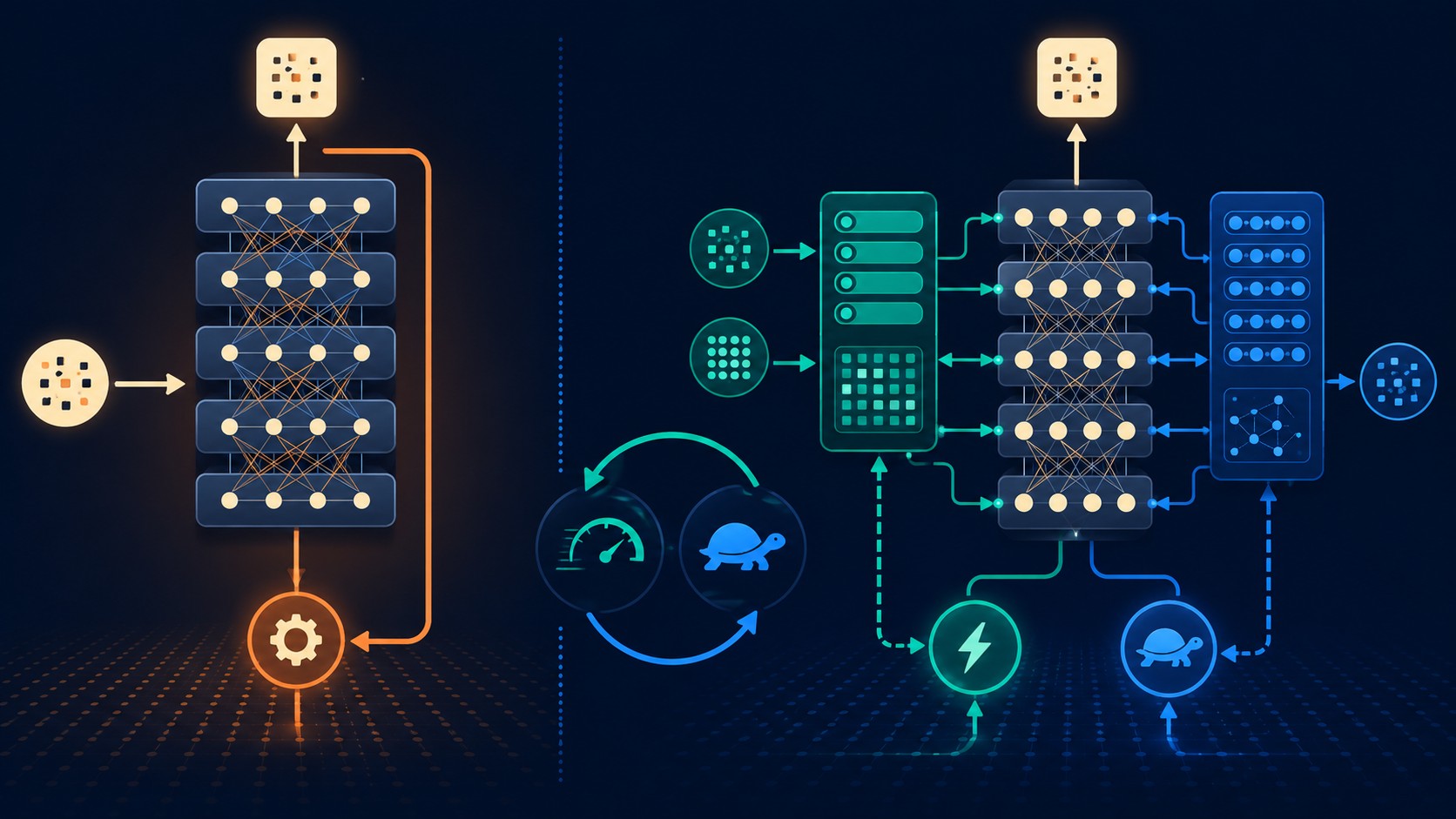

Fast-Slow Training es el intento de salir de ese callejón. GEPA-AI lo presentó en mayo de 2026 como un paradigma de entrenamiento que optimiza dos tipos de representaciones de forma intercalada: los “pesos rápidos” (la capa de agente y contexto, incluyendo prompts) y los “pesos lentos” (los parámetros de red tradicionales).

La idea viene de la psicología cognitiva. Daniel Kahneman describió dos sistemas de pensamiento: uno rápido, intuitivo, especializado; otro lento, deliberado, general. FST toma esa analogía y la lleva al entrenamiento de modelos. Los pesos rápidos codifican los matices específicos de cada tarea. Los pesos lentos, liberados de tener que memorizar cada particularidad, pueden enfocarse en capacidades generales. Tema relacionado: aplicaciones visuales de modelos adaptativos.

No es una herramienta que podés instalar mañana. Es un enfoque de investigación, publicado en el paper de OpenReview, con resultados en benchmarks concretos. La implementación práctica depende de quién adopte el paradigma en producción.

Pesos rápidos vs pesos lentos: la arquitectura de FST

Los pesos rápidos en FST son básicamente la capa de contexto: los prompts del sistema, las instrucciones de tarea, los ejemplos few-shot. Todo lo que está “encima” de los parámetros de red y que puede cambiar sin tocar los pesos subyacentes. Son rápidos porque pueden actualizarse para cada tarea nueva sin comprometer lo que está debajo.

Los pesos lentos son los parámetros tradicionales de la red. Lo que normalmente se actualiza en un fine-tuning estándar. En FST, estos también se actualizan, pero de una manera distinta: como los pesos rápidos ya están absorbiendo los matices específicos de la tarea, los pesos lentos reciben señales de entrenamiento más “limpias”, orientadas a capacidades generales de razonamiento.

El truco está en la intercalación. No es que primero optimizás prompts y después parámetros. Las dos actualizaciones ocurren de forma entrelazada durante el mismo proceso de entrenamiento. Eso es lo que diferencia FST de un pipeline de dos etapas separadas.

Resultados concretos: FST vs entrenamientos tradicionales

Los números que publica GEPA-AI son concretos. En benchmarks de matemáticas, código y razonamiento general:

- FST iguala el rendimiento de Reinforcement Learning (RL) con hasta 3x menos pasos de entrenamiento.

- Supera a RL en el techo de rendimiento asintótico (el mejor resultado alcanzable con más entrenamiento).

- Logra 70% menos divergencia KL respecto al modelo base comparado con entrenamiento solo-pesos.

- En aprendizaje continuo (múltiples cambios de tarea), FST mantiene rendimiento donde el entrenamiento solo-pesos se estanca.

| Métrica | Entrenamiento solo-pesos | FST |

|---|---|---|

| Pasos para igualar RL | Baseline (referencia) | Hasta 3x menos |

| Divergencia KL del base | Alta (referencia) | 70% menor |

| Techo asintótico | Igual a RL | Superior a RL |

| Cambio de tarea (continual learning) | Se estanca | Mantiene rendimiento |

| Plasticidad post-entrenamiento | Reducida | Preservada |

¿Alguien midió esto de forma independiente? Todavía no. Los benchmarks son del propio equipo de GEPA-AI, así que hay que tomarlo con pinzas hasta que otros grupos los reproduzcan.

Plasticidad: el costo oculto de la especialización

Plasticidad en redes neuronales es la capacidad de seguir aprendiendo. Un modelo con alta plasticidad puede adaptarse a nuevas tareas sin requerir millones de ejemplos adicionales. Un modelo con plasticidad erosionada sigue funcionando bien en lo que ya sabe, pero tiene cada vez más dificultad para incorporar conocimiento nuevo. Relacionado: implementar LLMs adaptativos en tu código.

El fine-tuning tradicional destruye plasticidad.

Cuando actualizás los parámetros de un modelo para que aprenda una tarea específica, los pesos se mueven hacia una región del espacio de parámetros optimizada para esa tarea. Con cada ronda de entrenamiento especializado, el modelo se “asienta” más en esa región. Recuperar flexibilidad requiere recalibrar desde el base o hacer algún tipo de regularización costosa.

FST ataca este problema directamente. Con 70% menos divergencia KL respecto al modelo base, los pesos lentos no se alejan tanto de su punto de partida. Quedan en una zona más “central” del espacio de parámetros, desde donde pueden aprender nuevas tareas con mayor facilidad. Los pesos rápidos absorben la especialización; los pesos lentos no tienen que hacerlo solos.

Aprendizaje continuo: cómo FST evita el estancamiento

Imaginá esto: entrenás un modelo en matemáticas durante una semana. Después lo entrenás en código. Después en razonamiento legal. Con entrenamiento solo-pesos, en algún punto de esa secuencia el modelo empieza a saturarse. Las actualizaciones dejan de mejorar el rendimiento. Los gradientes se vuelven pequeños o ruidosos. El modelo se estanca.

Esto es el problema de “task switching” en aprendizaje continuo. Cada cambio de dominio compite con el anterior en el mismo espacio de parámetros. El modelo no tiene dónde “guardar” el conocimiento nuevo sin sobreescribir el viejo.

FST maneja esto mejor porque los pesos rápidos pueden reconfigurarse para cada tarea sin modificar los pesos lentos. Cuando cambia el dominio, los pesos rápidos cambian para capturar los matices del nuevo dominio. Los pesos lentos siguen acumulando capacidades generales. El resultado, según los benchmarks de GEPA-AI, es que FST mantiene rendimiento en cambios de tarea donde los enfoques solo-pesos se detienen. Esto se conecta con lo que analizamos en diferentes estrategias de desarrollo de LLMs.

Implicaciones para la adaptación continua de modelos IA

El objetivo declarado del paper es avanzar hacia sistemas de IA de propósito general que puedan adaptarse a una amplia variedad de tareas sin perder capacidad en las anteriores. FST no resuelve eso solo. Pero es un paso metodológico concreto en esa dirección.

Lo que cambia, si el enfoque escala, es el ciclo de vida de los modelos. Hoy, un equipo que quiere especializar un LLM en su dominio enfrenta una elección: fine-tuning (mejor rendimiento, menor generalización) o prompt engineering (mayor generalización, rendimiento limitado). FST propone que esa elección no tiene que ser binaria.

Para equipos que trabajan con infraestructura de IA en Argentina o Latinoamérica y que consideran alojar o desplegar modelos propios (con servicios como los que ofrece donweb.com para workloads cloud), esta investigación tiene relevancia práctica indirecta: los paradigmas de entrenamiento que preservan plasticidad reducen el costo de reentrenar cuando los datos o las tareas cambian.

Eso sí: todavía es investigación. No hay implementación de referencia open-source que cualquier equipo pueda bajar y usar mañana (al menos no al momento de publicación del paper, en mayo de 2026). Habría que esperar a que esto llegue a frameworks como Hugging Face o similares.

Qué está confirmado / Qué no

| Aspecto | Estado |

|---|---|

| FST presentado por GEPA-AI en mayo de 2026 | Confirmado (blog oficial + OpenReview) |

| 3x menos pasos que RL en benchmarks de GEPA-AI | Confirmado (benchmarks internos) |

| 70% menos divergencia KL | Confirmado (benchmarks internos) |

| Reproducción independiente de los resultados | Pendiente |

| Implementación open-source disponible | No anunciada aún |

| Adopción por frameworks de producción | No confirmada |

Errores comunes al interpretar este tipo de investigación

Error 1: asumir que “supera a RL” significa que reemplaza RL. FST usa actualizaciones de pesos, igual que RL. Lo que dice el paper es que FST puede igualar el rendimiento de RL con menos pasos, y superar su techo asintótico. No es que RL desaparece del toolkit; es que FST puede ser más eficiente en ciertos regímenes de entrenamiento.

Error 2: confundir los pesos rápidos con simples prompts de usuario. Los pesos rápidos en FST incluyen la capa de agente y contexto en su conjunto, no solo el texto de un prompt. La optimización de prompts en FST es un proceso de entrenamiento, no simplemente escribir mejores instrucciones a mano. Son cosas distintas. Cubrimos ese tema en detalle en optimizar eficiencia y costos en LLMs.

Error 3: dar por sentado que los benchmarks internos representan el rendimiento en producción. Los benchmarks de matemáticas, código y razonamiento general son útiles, pero cada implementación real tiene sus particularidades: distribuciones de datos distintas, tareas con matices que los benchmarks no capturan, constraints de latencia. Hasta que haya evaluaciones independientes en dominios reales, los números son una señal, no una garantía.

Preguntas Frecuentes

¿Qué es Fast-Slow Training y por qué es importante?

Fast-Slow Training es un paradigma de entrenamiento de LLMs desarrollado por GEPA-AI y presentado en mayo de 2026. Optimiza dos tipos de representaciones de forma intercalada: pesos rápidos (prompts y capas de contexto) para adaptar el modelo a tareas específicas, y pesos lentos (parámetros de red) para capacidades generales. Su importancia está en que logra mejor rendimiento que el entrenamiento solo-pesos con menos pasos, mientras preserva la capacidad del modelo de seguir aprendiendo (plasticidad).

¿Por qué los modelos olvidan al adaptarse a nuevas tareas?

Porque todos los conocimientos del modelo comparten el mismo espacio de parámetros. Cuando ajustás los pesos para una tarea nueva, estás modificando los mismos parámetros que codifican lo que el modelo ya sabía. Cuanto más específico es el ajuste, más se “mueven” los pesos hacia la nueva tarea y más se alejan de lo anterior. Esto se llama olvido catastrófico, y es uno de los problemas centrales del aprendizaje continuo en redes neuronales.

¿Cuáles son las ventajas de FST sobre fine-tuning tradicional?

Según los benchmarks de GEPA-AI, FST logra el mismo rendimiento de RL con hasta 3x menos pasos de entrenamiento y supera su techo asintótico. Además, logra 70% menos divergencia KL respecto al modelo base, lo que significa que el modelo se aleja menos de sus capacidades originales. En aprendizaje continuo (cambios de tarea en secuencia), FST mantiene rendimiento donde el fine-tuning tradicional se estanca.

¿Cómo logran los modelos mantener su flexibilidad mientras se especializan?

En FST, los pesos rápidos absorben la especialización específica de la tarea. Eso libera a los pesos lentos de tener que codificar matices particulares, y les permite recibir señales de entrenamiento orientadas a capacidades generales. El resultado es que los parámetros de red no se “asientan” tanto en una región especializada del espacio de parámetros, preservando la plasticidad: la capacidad de incorporar conocimiento nuevo en el futuro sin requerir recalibración desde cero.

¿FST ya está disponible para usar en proyectos propios?

No, al menos no al momento del anuncio en mayo de 2026. FST es investigación publicada en OpenReview por GEPA-AI, sin una implementación open-source de referencia anunciada públicamente. Para que sea usable en producción, necesita ser adoptado por frameworks de entrenamiento populares o que los propios equipos lo implementen desde el paper. Por ahora, el valor está en entender el paradigma y monitorear si los proveedores de modelos lo incorporan.

Conclusión

FST no resuelve la IA general. Pero señala algo concreto: el costo de especializar un modelo no tiene que ser perder flexibilidad, si separás qué tipo de representación absorbe qué tipo de aprendizaje. Los números que publica GEPA-AI son prometedores, con la cavedad de que vienen del propio equipo y todavía esperan validación independiente.

Lo que vale la pena monitorear ahora es si otros grupos reproducen los benchmarks y si los frameworks de entrenamiento empiezan a incorporar actualizaciones intercaladas de pesos rápidos y lentos. Si FST escala a modelos más grandes y domina en benchmarks independientes, el impacto en cómo se entrena y especializa la próxima generación de LLMs va a ser real. Si los resultados no se reproducen fuera del laboratorio de GEPA-AI, habrá sido un paper interesante pero no más.

La adaptación continua de modelos IA es uno de los problemas más importantes del campo. FST es una propuesta con datos concretos. Eso ya es más de lo que la mayoría de los papers de mayo de 2026 ofrecen.

![FST: LLMs que se adaptan sin olvidar (mayo 2026) 1 Learning, Fast and Slow: Towards LLMs That Adapt Continually [R] - ilustracion](https://blog.donweb.com/wp-content/uploads/2026/05/fast-slow-training-adaptacion-continua-modelos-ia-hero.jpg)