La automatización de indexación SEO es el proceso por el cual un sistema notifica a Google, Bing e IndexNow de forma automática cada vez que se publica contenido nuevo, sin que nadie tenga que hacer nada manualmente. Sin esa capa, todo lo que construís encima, el escritor de IA, el optimizador de keywords, el generador de clusters, es un castillo sin cimientos: el contenido existe pero los motores no lo ven.

En 30 segundos

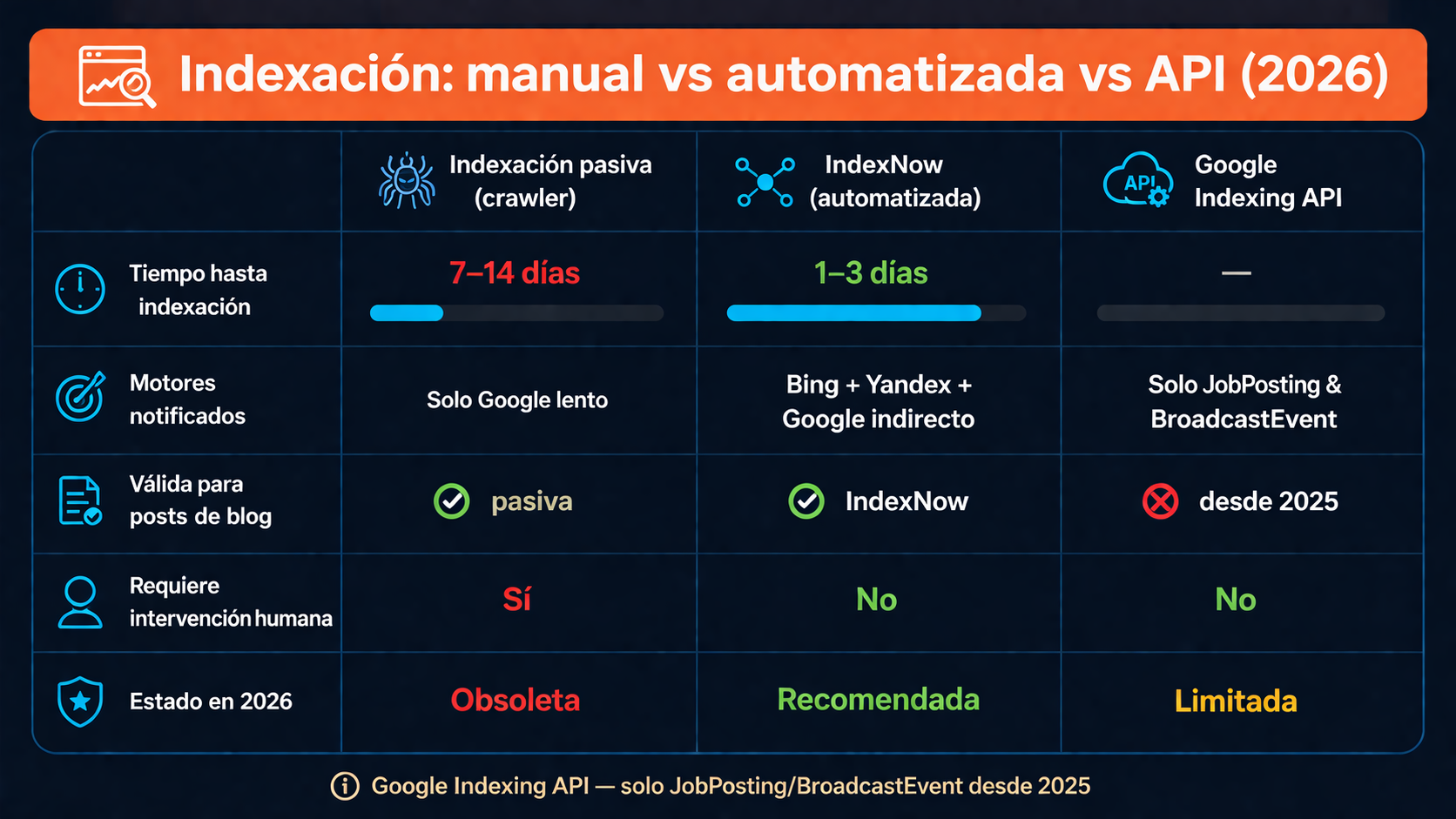

- La indexación manual tarda entre 7 y 14 días; la automatizada baja ese tiempo a 1-3 días según el tipo de contenido y la autoridad del sitio.

- Google Indexing API no funciona para páginas normales desde 2025: solo acepta JobPosting y BroadcastEvent. Si la usás para posts de blog, no hace nada.

- IndexNow es la alternativa real: un ping y Bing, Yandex y otros motores se enteran en minutos. Google lo soporta vía Bing de forma indirecta.

- En un stack agentico completo (discovery → research → escritura → optimización → publicación → monitoreo), la indexación automática es la capa que conecta publicación con visibilidad. Sin ella, el ciclo no cierra.

- En 2026, indexar solo para Google ya no alcanza: los crawlers de IA como Perplexity, Claude.ai y SearchGPT tienen sus propios mecanismos de descubrimiento y necesitan acceso explícito.

SEO es el conjunto de técnicas y prácticas para mejorar la visibilidad de un sitio web en resultados de búsqueda orgánica de Google, Bing y otros motores. Incluye optimizaciones técnicas, de contenido y de enlazado dirigidas a mejorar el ranking e indexación.

Qué es indexación automática en el contexto agentico (2026)

La indexación automática es el mecanismo que notifica a los motores de búsqueda, sin intervención humana, que una URL nueva existe o fue actualizada. La diferencia con la indexación pasiva es simple: en la pasiva, esperás que el crawler de Google pase por tu sitio en algún momento. En la automática, vos le avisás.

Eso suena trivial hasta que lo ponés en contexto de un sistema agentico que publica 5, 10 o 30 artículos por día. Ponele que tu agente escribe un análisis de las últimas CVEs de WordPress a las 3 AM, lo publica, y Googlebot pasa a recrawlear tu sitio recién en 10 días. Para ese momento, otros tres sitios ya rankearon el tema y el tuyo llega tarde. La indexación automática es la diferencia entre publicar y existir.

El cambio que trajo 2026 es que los stacks de SEO agentico se volvieron lo suficientemente complejos como para que cada capa tenga que ser explícita. Según el análisis de Frase.io sobre agentes IA para SEO, los sistemas modernos ejecutan ciclos completos end-to-end: desde el descubrimiento de topics hasta el monitoreo post-publicación. La indexación no es un extra: es el pivote entre “publicado” y “visible”.

Por qué debe ser la primera capa del stack agentico

La arquitectura de un stack agentico de SEO tiene una secuencia lógica: descubrimiento de noticias o topics, investigación de keywords, escritura, optimización on-page, publicación, y después monitoreo. La mayoría de los equipos invierte tiempo y plata en las primeras cuatro capas y se olvida de la quinta.

El problema es que sin indexación, las capas anteriores no cierran el ciclo. Es como tener una base de datos impecablemente normalizada pero sin actualizar los índices: las queries no encuentran lo que buscás aunque el dato esté ahí.

Lo que hacen los agentes agenticos es ejecutar esos ciclos en bucle, muchas veces al día. Cada publicación genera una deuda de visibilidad que la indexación automática salda en minutos en vez de días. Según Data SEO Academy, los agentes de IA para SEO que no incluyen indexación automática en su pipeline pierden entre 3 y 7 días de ventana competitiva por artículo publicado. A escala, eso es mucho.

Eso sí: indexación automática no significa ranking automático. Son dos cosas distintas y confundirlas es el error más común. Cubrimos ese tema en detalle en estrategias modernas de SEO con IA.

Google Indexing API vs IndexNow vs alternativas

Acá viene lo que mucha gente no sabe y sigue implementando mal.

Google Indexing API tiene una limitación que Google dejó en claro desde 2025: solo acepta notificaciones para dos tipos de structured data, JobPosting y BroadcastEvent. Si mandás una URL de un post de blog a la Indexing API, la solicitud se procesa pero no tiene el efecto que esperás. La documentación oficial de Google lo dice explícito en el quickstart, aunque con la letra chica que nadie lee.

Entonces, ¿qué funciona realmente?

IndexNow

IndexNow es un protocolo abierto que notifica simultáneamente a Bing, Yandex, Seznam y otros motores que lo implementan. Un solo ping, múltiples destinos. Google no participa directamente en el protocolo, pero Bing le pasa la información, así que hay un efecto indirecto. La implementación es un archivo de verificación en el servidor y una llamada HTTP. Nada más.

Rank Math y Yoast integran IndexNow de un click en WordPress. Si corrés uno de esos plugins, ya tenés indexación automática en Bing y compañía sin escribir una línea de código.

Sitemaps dinámicos

El sitemap XML actualizado en tiempo real sigue siendo el mecanismo más confiable para Google. No es instantáneo (Googlebot tiene que pasar), pero combinado con IndexNow y una cuenta verificada en Google Search Console, acelera notablemente el proceso. La mayoría de los CMS lo hace automático.

WebSub / PubSubHubbub

Para feeds RSS/Atom, WebSub notifica a los agregadores en segundos. Útil si tu contenido se distribuye también vía feed. Google lo usa para descubrimiento de noticias.

| Mecanismo | Latencia | Motores cubiertos | Aplica para blogs | Setup |

|---|---|---|---|---|

| IndexNow | Minutos | Bing, Yandex, Seznam | Sí | Bajo (plugin o HTTP) |

| Google Indexing API | Minutos | Solo Google | No (solo JobPosting/BroadcastEvent) | Medio (OAuth2 + service account) |

| Sitemap dinámico + GSC | Horas a días | Google principalmente | Sí | Muy bajo (automático en WP) |

| WebSub/PubSubHubbub | Segundos | Agregadores RSS, Google News | Sí (para contenido de noticias) | Bajo (plugin o webhook) |

| Fetch como Google (GSC) | Horas | Solo Google | Sí | Manual (no escala) |

Implementación: flujo automatizado end-to-end

El flujo concreto en un stack con WordPress se ve así: el autor o el agente publica un post → el CMS dispara un webhook → un servicio recibe la notificación con la URL → la URL entra a una cola → un worker en background manda el ping a IndexNow, actualiza el sitemap, y notifica a GSC.

Según el análisis de TrySight sobre integración de APIs de indexación, el componente crítico no es el ping en sí sino la lógica de retry. Las APIs de indexación tienen rate limits y pueden fallar con 429 o 5xx. Sin reintentos con backoff exponencial, perdés indexaciones silenciosamente y no te enterás hasta que revisás el Coverage Report en GSC días después.

Un pseudocódigo del flujo básico:

URL publicada → enqueue(url, timestamp) → worker toma la URL → POST a IndexNow API → si 200: log OK → si 4xx/5xx: requeue con delay 2^intento × 30s → max 3 reintentos → si falla 3 veces: alert + dead-letter queue. Te puede servir nuestra cobertura de orquestar la automatización sin código.

La dead-letter queue es lo que separa un sistema que funciona de uno que parece funcionar. Sin ella, no sabés qué URLs nunca se indexaron.

Impacto real en velocidad de indexación y rankings

Los números: indexación pasiva (esperar al crawler) tarda entre 7 y 14 días para sitios con baja frecuencia de crawl. Con IndexNow + sitemap dinámico + GSC verificada, ese tiempo baja a 1-3 días. Para sitios con alta autoridad y crawl budget generoso, puede ser horas.

¿Eso mejora el ranking? Acá hay que ser honesto.

La indexación es un prerequisito, no un factor de ranking. Un artículo que Google indexa rápido pero que tiene contenido flojo sigue rankeando en la posición 47. Lo que cambia es el time-to-ranking: el período entre que publicás y que el artículo puede competir. Reducir ese período de 14 días a 2 días le da más tiempo a tu contenido para acumular señales de engagement antes de que la competencia llegue al mismo tema.

¿Alguien lo verificó de forma independiente en 2026? El Coverage Report de GSC te muestra cuándo se indexó cada URL. Con eso podés medir el delta. El benchmark del “1-3 días” viene de sitios con moderada a alta autoridad; en sitios nuevos puede tardar más sin importar cuántos pings mandes.

Arquitectura del stack agentico completo

Las herramientas que están definiendo el SEO agentico en 2026 tratan la indexación como una capa explícita de la arquitectura, no como un afterthought.

BrightEdge Autopilot y Surfer AI incluyen módulos de notificación de indexación integrados al flujo de publicación. Alli AI tiene lo que llaman “AI Crawler Enablement”: configuración automática de los headers y robots.txt para permitir acceso a crawlers de IA como GPTBot (OpenAI) y ClaudeBot (Anthropic). Search Atlas OTTO va más lejos y combina indexación con structured data deployment automático. Complementá con fundamentos de los LLMs modernos.

El estándar MCP (Model Context Protocol) que Anthropic abrió en 2024 y que se volvió mainstream en 2026 permite que los agentes de IA interactúen directamente con sistemas externos, incluyendo APIs de indexación, sin que un humano tenga que orquestar cada paso. Un agente que escribe, publica y notifica la indexación en un solo ciclo autónomo ya es posible hoy con MCP.

Según el análisis de Stridec sobre herramientas de SEO agentico, los stacks más completos en 2026 tienen entre 6 y 8 capas, y la indexación aparece en la capa 5 o 6 en todos los que muestran resultados consistentes. Los que la omiten o la dejan manual muestran gaps de cobertura que solo se descubren semanas después.

El cambio en 2026: de indexación de Google a indexación multi-motor

Durante años, “indexación” fue sinónimo de “que Google me vea”. Eso cambió.

Perplexity, SearchGPT, Claude.ai y Gemini tienen sus propios mecanismos de descubrimiento y sus propios crawlers. GPTBot de OpenAI, ClaudeBot de Anthropic, PerplexityBot: cada uno necesita acceso explícito vía robots.txt y, en algunos casos, registro en programas específicos.

La “indexación” para AI search no funciona igual que para Google. Perplexity y ChatGPT no usan el mismo sistema de índice invertido; usan embeddings y retrieval semántico sobre corpora que actualizan con frecuencias variables (Perplexity dice que actualiza en tiempo casi real para ciertos contenidos; SearchGPT tiene ciclos de semanas). Eso significa que el structured data, los microformatos y la accesibilidad para crawlers de IA son ahora parte del problema de indexación, no solo del de optimización.

Para alojar el servidor que corre estos agentes o el CMS donde publicás, si usás infraestructura argentina, donweb.com tiene planes de VPS que soportan bien el volumen de un stack agentico activo.

Qué está confirmado / Qué no

Confirmado

- Google Indexing API no funciona para páginas de blog desde 2025 (documentación oficial de Google).

- IndexNow notifica a Bing, Yandex y Seznam en minutos (especificación del protocolo, verificable vía Bing Webmaster Tools).

- GPTBot y ClaudeBot respetan robots.txt: si no los habilitás explícitamente, no crawlean tu sitio.

- Rank Math y Yoast integran IndexNow de forma nativa en sus versiones actuales.

No confirmado / habría que verificar

- El impacto exacto de IndexNow sobre rankings en Google (el efecto es indirecto vía Bing; Google no confirmó que los datos de IndexNow influyan en su índice).

- La frecuencia real de actualización de los corpora de SearchGPT y Perplexity para contenido en español.

- Si el registro en programas de AI search (como el de Perplexity para publishers) afecta materialmente el crawl de sitios medianos.

Errores comunes

Usar Google Indexing API para posts normales

Es el error más extendido. Mucha gente configuró la Indexing API con su service account, mandó URLs de artículos, y creyó que estaba indexando. La API responde 200 OK, pero para contenido que no es JobPosting ni BroadcastEvent, ese OK no significa que Google va a crawlear la URL más rápido. La corrección: usá IndexNow para posts normales y guardá la Indexing API para structured data compatible.

Confundir indexación con ranking

Indexar rápido no te da posiciones. Te da la posibilidad de competir antes. Si el artículo no tiene profundidad, autoridad temática o backlinks, va a indexar rápido y rankear en la página 8. La indexación automática es una condición necesaria, no suficiente.

No monitorear fallos de indexación

Mandás el ping, te olvidás, y asumís que todo se indexó. El Coverage Report de GSC te muestra URLs con errores de crawl, redirects rotos, o contenido duplicado que bloquea la indexación. Si no lo revisás al menos una vez por semana, podés tener decenas de URLs publicadas que Google nunca procesó bien. La corrección: un script semanal que cruce las URLs publicadas contra el Coverage Report y alerte si hay discrepancias. Lo explicamos a fondo en capacidades del modelo Sonnet 4.6.

Podés profundizar en Indexing automation should be the first layer in any agentic, donde el tema toma más cuerpo.

Esto se conecta directamente con nuestro artículo sobre Indexing automation should be the first layer in any agentic, donde lo cubrimos en detalle.

Tocamos exactamente esto en Indexing automation should be the first layer in any agentic, clave para entender cómo funcionan los agentes.

Mirá lo que comentamos sobre Indexing automation should be the first layer in any agentic acá.

Profundizamos en esto en nuestro artículo sobre Indexing automation should be the first layer in any agentic.

Preguntas Frecuentes

¿Cómo automatizar la indexación de mis artículos en Google?

La forma más efectiva hoy es implementar IndexNow (que Bing y otros motores adoptan) más un sitemap dinámico verificado en Google Search Console. En WordPress, Rank Math o Yoast lo hacen automático. Para Google específico, el sitemap + GSC verificada sigue siendo el mecanismo más confiable; la Indexing API ya no aplica para posts normales.

¿Cuál es la diferencia entre Google Indexing API e IndexNow?

Google Indexing API solo acepta JobPosting y BroadcastEvent como tipos de contenido; para posts de blog no tiene efecto práctico. IndexNow es un protocolo abierto que notifica a Bing, Yandex y Seznam; Google no participa directamente pero Bing le pasa señales de forma indirecta. Para la mayoría de los sitios, IndexNow + sitemap dinámico cubre el 90% de las necesidades de indexación automática.

¿Cuánto tiempo tarda la indexación automática vs manual?

Indexación pasiva (esperar al crawler sin hacer nada): 7 a 14 días en sitios con baja frecuencia de crawl. Con IndexNow + sitemap dinámico + GSC verificada: 1 a 3 días. En sitios con alta autoridad y crawl budget elevado, puede bajar a horas. Los sitios nuevos o con baja autoridad pueden tardar más sin importar qué mecanismos usen.

¿Qué herramientas usan los agentes de IA para indexación automática?

Las principales en 2026 son BrightEdge Autopilot, Surfer AI, Alli AI (con su módulo AI Crawler Enablement) y Search Atlas OTTO. Para implementación propia, la combinación de un webhook desde el CMS + worker en background + IndexNow API es el stack más común y más fácil de mantener. Rank Math y Yoast cubren el caso de WordPress sin código adicional.

¿La indexación automática mejora los rankings?

De forma directa, no: la indexación no es un factor de ranking. Lo que mejora es el time-to-ranking: reducís el período entre publicación y competencia activa de semanas a días, lo que le da más tiempo a tu contenido para acumular señales antes de que otros cubran el mismo tema. El impacto real depende de la calidad del contenido, la autoridad del sitio y la competencia de las keywords.

Conclusión

Lo que cambió en 2026 es la escala y la complejidad del problema. Cuando publicás 1 artículo por semana, la indexación pasiva zafa. Cuando un stack agentico publica 10 o 30 piezas por día en múltiples sitios, cada día de delay es tráfico que no llega y posiciones que otros ocupan primero.

La automatización de indexación SEO no requiere infraestructura compleja: IndexNow + sitemap dinámico + GSC verificada cubre la mayor parte del problema con herramientas que ya existen en cualquier instalación de WordPress decente. Lo que sí requiere es tratarlo como una capa explícita del sistema, no como algo que “ya debe estar funcionando”.

Y si construís para 2026, acordate de los crawlers de IA. GPTBot, ClaudeBot, PerplexityBot: cada uno necesita acceso, robots.txt actualizado y, en algunos casos, registro activo. La visibilidad en Google sigue siendo crítica, pero ya no es toda la ecuación.