Claude Code vs Codex en comparativas ciegas muestran que Claude ganó el 67% de los enfrentamientos directos contra el 25% de Codex, editó 36 archivos en proyectos complejos frente a 28, y costó $2.50 contra $2.04 en la misma tarea. El 8% de diferencia de costo esconde una diferencia de calidad bastante más grande.

En 30 segundos

- Claude Code editó 36 archivos por tarea frente a 28 de Codex en proyectos de mediana complejidad

- Costo por tarea: $2.50 Claude Code vs $2.04 Codex — diferencia de $0.46 por ejecución agentic

- Codex tiene un problema documentado de infinite loop en tareas de refactoring complejo (issue #16556 en GitHub)

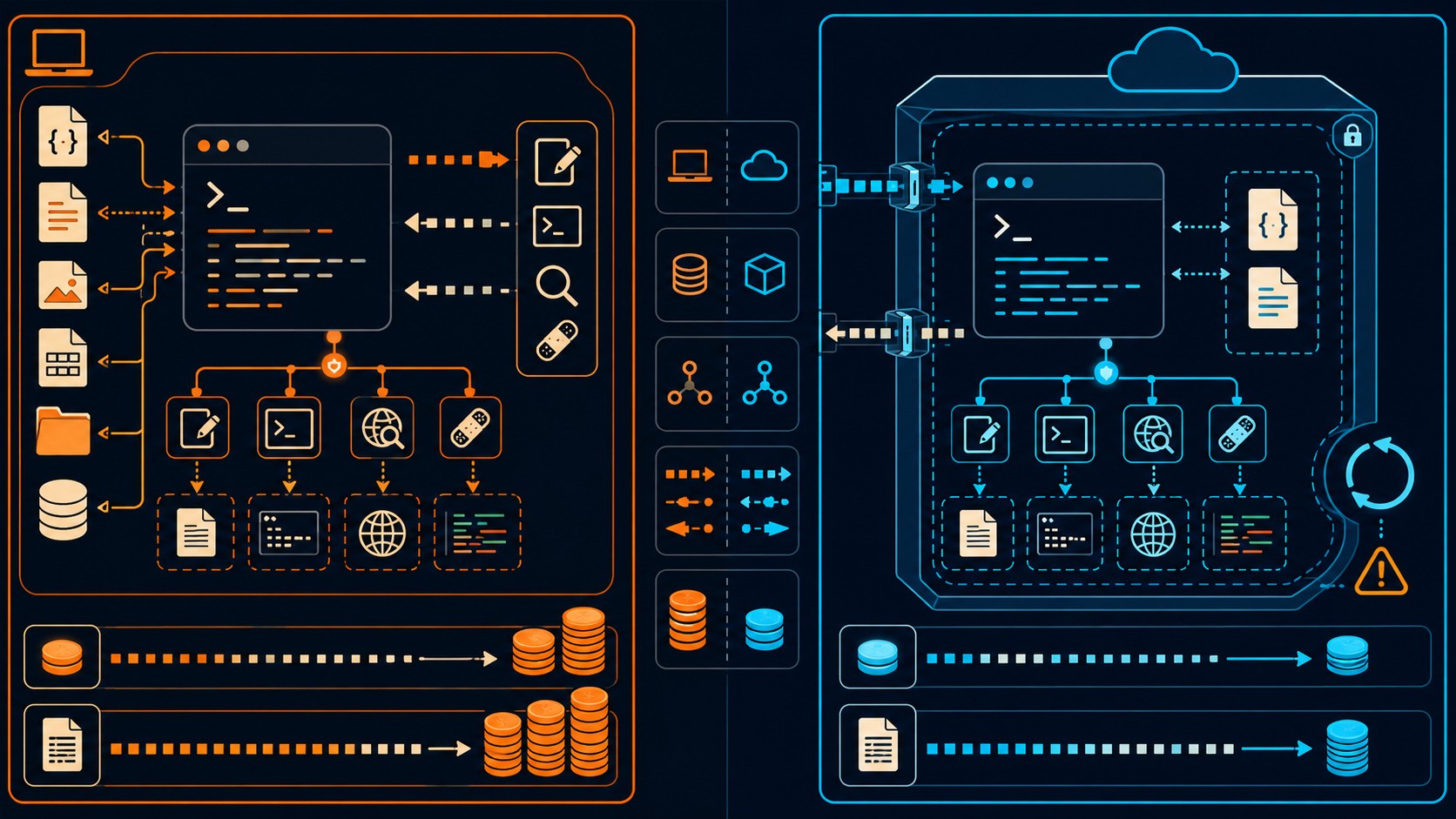

- Claude Code corre local en tu terminal; Codex ejecuta en sandbox cloud de OpenAI

- Claude Code: $5 input / $25 output por 1M tokens (Opus 4.7); GPT-5 Codex: $1.25-$5 input / $10-$30 output

Claude Code es una herramienta CLI de Anthropic que permite a los desarrolladores interactuar con Claude directamente desde la terminal para tareas de programación agentic, manteniendo el código en la máquina local. Codex es el agente de codificación de OpenAI basado en GPT-5, ejecutado en entornos sandbox en la nube y disponible vía VS Code, CLI, y ChatGPT web.

El estado de los agentes IA de codificación en 2026

A principios de 2026, la categoría de agentes IA para código dejó de ser experimental. Claude Code, lanzado por Anthropic en abril de 2026, llegó tarde pero pegó fuerte. Codex ya estaba establecido como la opción natural para quienes viven en el ecosistema OpenAI.

Las cifras de adopción lo dicen con bastante claridad: según datos de extensiones VS Code relevados en mayo de 2026, Claude Code tiene 5.2 millones de instalaciones activas frente a 4.9 millones de Codex. La diferencia es pequeña, pero el contexto importa: Codex tiene más de un año de ventaja en el mercado.

¿Y por qué importa comparar esto ahora? Porque los flujos agentic reales, donde el modelo toma decisiones encadenadas sin intervención humana, consumen muchos más tokens de lo que parece en un demo. Un desarrollador que usa cualquiera de estos agentes ocho horas por día no paga $20/mes de suscripción. Paga mucho más. Y la diferencia entre $2.04 y $2.50 por tarea, multiplicada por cientos de tareas diarias, deja de ser anecdótica.

Arquitectura: local vs cloud, ¿cuál es la diferencia real?

Acá viene lo bueno: la diferencia arquitectónica entre Claude Code y Codex no es solo técnica, tiene consecuencias prácticas directas. Más contexto en como vimos en análisis de modelos LLM.

Claude Code corre en tu terminal. El código nunca sale de tu máquina salvo para la llamada a la API de Anthropic. Podés interceptar eventos del ciclo de vida con hooks propios, revisar cambios antes de que se apliquen, y básicamente tener control total sobre qué modifica el agente y cuándo. Para equipos con restricciones de compliance, datos sensibles, o simplemente paranoia razonable sobre propiedad intelectual, esto es un argumento sólido.

Codex, en cambio, ejecuta en un entorno sandbox de OpenAI en la nube. Tu código sube a los servidores de OpenAI para que el agente lo procese. Eso tiene ventajas (no necesitás computadora potente, el ambiente está aislado y controlado) pero también implica que el código sale de tu red. La política de retención de datos de OpenAI para la API dice que no usa tus inputs para entrenar modelos por defecto, pero el código sale igual.

Para la mayoría de los proyectos, esto no es un problema. Para proyectos con datos de clientes, código propietario sensible, o entornos regulados, es una conversación que hay que tener antes de elegir.

Precios reales: costo por token y suscripciones en 2026

La comparativa de precios tiene trampas. Te doy los números y te explico dónde está el engaño.

| Concepto | Claude Code (Opus 4.7) | Codex / GPT-5 |

|---|---|---|

| Input por 1M tokens | USD 5 | USD 1.25 – 5 (según tier) |

| Output por 1M tokens | USD 25 | USD 10 – 30 (según tier) |

| Suscripción mensual base | USD 20 (Claude Pro) | USD 20 (ChatGPT Plus) |

| Descuento batch | 50% (Batches API) | 50% (Batch API) |

| Costo por tarea agentic real | USD 2.50 | USD 2.04 |

| Contexto máximo | 1M tokens | 128K tokens |

El truco es que los modelos más baratos de GPT-5 (el tier de $1.25 input) no son los que usa Codex en modo agentic complejo. En tareas de múltiples pasos, el agente termina escalando a modelos más caros. La diferencia de $0.46 por tarea que reportan comparativas independientes como la de Blake Crosley ya contempla eso.

Ojo: si tu equipo hace 200 tareas agentic por día (que no es un número raro en un equipo de 5 devs activos), estás hablando de $92/día vs $75/día. En un mes: $2,760 vs $2,250. La diferencia de $510/mes ya es el salario de una hora de un dev senior. Para algunos equipos importa, para otros no.

Rendimiento técnico: velocidad, calidad de código, y el infinite loop de Codex

Ponele que le pedís a tu agente que refactorice un módulo de autenticación de 800 líneas, con tests incluidos y sin romper la interfaz pública. Ahí es donde las diferencias se hacen visibles. Tema relacionado: cuando la seguridad está en juego.

Claude Code, según los benchmarks de DataCamp de mayo 2026, ganó el 67% de 36 comparativas ciegas en tareas de código complejas, contra el 25% de Codex (el 8% restante terminó en empate). En proyectos de mediana escala, Claude editó un promedio de 36 archivos por tarea contra 28 de Codex. Eso no siempre es mejor (más archivos modificados puede ser señal de scope creep), pero en tareas de refactoring amplio sugiere mayor cobertura.

El contexto de 1M tokens de Claude también es una ventaja real. Si trabajás con bases de código grandes y necesitás que el agente “lea” decenas de archivos antes de modificar algo, la diferencia entre 128K y 1M tokens no es teórica.

Ahora bien, Codex es más rápido en respuestas simples. Autocompletado, sugerencias inline, revisión rápida de una función de 50 líneas: ahí Codex responde antes. Para pair programming en tiempo real donde la latencia importa, eso pesa.

El elephant in the room: el issue #16556 en el repositorio de Codex en GitHub, abierto en mayo 2026 y con más de 140 comentarios, documenta un problema de infinite loop en tareas de refactoring complejo. El agente entra en un ciclo de corrección/re-corrección sin converger. OpenAI lo reconoció y está trabajando en el fix, pero al cierre de este artículo no hay parche publicado. ¿Alguien verificó que esté resuelto de forma independiente? Todavía no.

Integración con herramientas: dónde vive cada agente

Claude Code vive en la terminal. Eso es su fortaleza y su límite al mismo tiempo. Tenés hooks para interceptar eventos del ciclo de vida (pre-commit, post-edit, etc.), podés revisar cada cambio antes de que se aplique, y la integración con git es directa. El flujo es tuyo, el agente se adapta.

Codex tiene más puntos de entrada: VS Code como extensión, CLI propia, ChatGPT web, y la aplicación macOS. Para devs que trabajan mayormente dentro del IDE, la integración de Codex se siente más fluida. El autocompletado inline dentro de VS Code es difícil de superar en comodidad.

La pregunta es qué tipo de flujo de trabajo tenés. Si programás desde la terminal, usás vim/neovim o simplemente querés control granular sobre cada acción del agente, Claude Code encaja mejor. Si tu IDE es VS Code y querés algo que funcione “sin configurar nada”, Codex es más cómodo de arrancar.

Casos de uso reales: cuándo usar cada uno

Cuándo Claude Code tiene más sentido

Proyectos con bases de código grandes donde el agente necesita contexto de decenas de archivos simultáneamente. Refactoring complejo con dependencias cruzadas. Decisiones arquitectónicas donde querés que el agente razone largo antes de modificar. Código sensible que no puede salir de tu infraestructura. Equipos que ya trabajan desde la terminal y valoran el control de cada paso. Te puede servir nuestra cobertura de en análisis de capacidades de procesamiento.

Cuándo Codex tiene más sentido

Autocompletado inline en tiempo real dentro de VS Code. Revisión rápida de snippets o funciones cortas. Proyectos pequeños donde el contexto de 128K alcanza. Equipos que no quieren configurar nada y prefieren usar el mismo login que ya tienen en ChatGPT. Tareas de bajo contexto y alta frecuencia donde la latencia importa más que la profundidad.

Costo total de propiedad: la cuenta que nadie te hace

La suscripción de $20/mes es el precio de entrada, no el precio real. Un desarrollador activo usando cualquiera de estos agentes en modo agentic consume tokens a un ritmo que la suscripción base no cubre.

Según datos de uso de mayo 2026, los desarrolladores activos en modo agentic generan entre 2.000 y 8.000 llamadas diarias a la API (sumando todas las interacciones encadenadas de una sesión). Con ese ritmo, el costo real mensual por desarrollador está entre $400 y $1,500, dependiendo de la complejidad de las tareas.

El punto de equilibrio económico es interesante: si Claude Code resuelve tareas 15-20% más complejas con mayor coverage (esos 36 archivos vs 28), y el desarrollador necesita menos tiempo de revisión posterior, el $0.46 extra por tarea puede ser rentable. Si tu caso de uso es mayormente autocompletado simple, Codex es más barato para lo mismo.

Un punto que vale mencionar para equipos que también necesitan pensar en su infraestructura: si ya tienen hosting con donweb.com u otro proveedor cloud, el costo de los agentes se suma a la factura mensual de infra, y conviene calcularlo junto.

Lo que está confirmado y lo que no

Confirmado

- Claude Code ganó el 67% de 36 comparativas ciegas en tareas complejas (DataCamp, mayo 2026)

- Claude Code: $5 input / $25 output por 1M tokens con Opus 4.7 (pricing oficial de Anthropic)

- Issue de infinite loop en Codex documentado en GitHub con más de 140 comentarios (issue #16556)

- Claude Code escribe 135,000 commits por día en GitHub según datos de actividad de mayo 2026

- Codex ejecuta en sandbox cloud; Claude Code mantiene el código localmente

Pendiente de confirmación

- El fix del infinite loop de Codex: OpenAI lo reconoció pero no publicó parche hasta la fecha

- Los precios de GPT-5 en modo agentic complejo: varían según tier y el pricing oficial no especifica qué modelo usa Codex por defecto

- Las cifras de adopción (5.2M vs 4.9M instalaciones): no tienen fuente primaria oficial, son estimaciones de terceros

Errores comunes al elegir entre estos agentes

Error 1: comparar solo el precio de suscripción. “Ambos cuestan $20/mes” es verdad y es irrelevante. El costo real está en el consumo de tokens agentic, que puede ser 10x la suscripción base en equipos activos. Calculá el TCO con tu volumen real de uso.

Error 2: asumir que más archivos modificados = mejor resultado. Claude Code toca 36 archivos vs 28 de Codex en proyectos complejos. Eso puede significar mejor cobertura, o puede significar que el agente modifica archivos que no debería tocar. Antes de dar por bueno un resultado agentic, revisá qué modificó y por qué. Lo explicamos a fondo en en nuestra guía de integración de APIs.

Error 3: ignorar el infinite loop de Codex en tareas de refactoring. Si usás Codex para refactoring complejo y el agente empieza a hacer correcciones circulares sin converger, no es un error de tu prompt. Es un bug conocido. Documentalo y usá Claude Code para esas tareas hasta que OpenAI publique el fix.

Error 4: elegir el agente por el IDE y no por la tarea. Codex se integra mejor con VS Code, y eso puede sesgar la decisión. Pero si tu proyecto tiene una base de código grande y necesitás contexto profundo, el agente mejor integrado con tu IDE puede ser el menos capaz para la tarea real.

Preguntas Frecuentes

¿Cuál es mejor, Claude Code o Codex?

En tareas de código complejas con múltiples archivos, Claude Code ganó el 67% de 36 comparativas ciegas frente al 25% de Codex (DataCamp, mayo 2026). Para autocompletado inline en VS Code y tareas simples de bajo contexto, Codex es más rápido y más cómodo. La respuesta depende de tu tipo de tarea predominante.

¿Cuánto cuesta cada herramienta mensualmente en 2026?

La suscripción base es $20/mes para ambos (Claude Pro y ChatGPT Plus). El costo real en uso agentic activo está entre $400 y $1,500/mes por desarrollador, según volumen. Claude Code cuesta $5 input/$25 output por 1M tokens (Opus 4.7); GPT-5 Codex varía entre $1.25 y $5 input, $10 y $30 output según el tier del modelo utilizado.

¿Qué diferencias hay en la arquitectura de estos agentes?

Claude Code corre localmente en tu terminal: el código se procesa en tu máquina y solo salen las llamadas a la API de Anthropic. Codex ejecuta en entornos sandbox en la nube de OpenAI, lo que significa que tu código sube a sus servidores para el procesamiento. Para proyectos con datos sensibles o restricciones de compliance, esta diferencia es relevante.

¿Claude Code es más rápido que Codex?

No en respuestas simples. Codex tiene menor latencia en sugerencias inline y revisiones rápidas de snippets cortos. Claude Code tarda más por tarea pero procesa mayor volumen de contexto (hasta 1M tokens vs 128K de Codex) y cubre más archivos en tareas complejas. Para pair programming en tiempo real, Codex se siente más ágil; para tareas agentic largas, la velocidad de Claude Code es comparable.

¿Cuál consume menos tokens en proyectos reales?

Codex consume menos tokens por tarea promedio ($2.04 vs $2.50), pero en proyectos complejos la diferencia se achica porque el agente necesita más iteraciones para alcanzar el mismo nivel de cobertura. Claude Code hace más en cada tarea (36 archivos vs 28), con un costo marginal mayor pero potencialmente menor cantidad de tareas totales necesarias para completar un proyecto.

Conclusión

Si llegaste hasta acá esperando una respuesta definitiva, la tenés: para tareas agentic complejas con bases de código grandes, Claude Code gana por calidad y cobertura. Para autocompletado en tiempo real dentro de VS Code y equipos que no quieren fricción de configuración, Codex sigue siendo la opción más cómoda.

El infinite loop de Codex en refactoring complejo es un problema real que todavía no tiene fix publicado. Eso solo debería inclinar la balanza en Claude Code para cualquier flujo agentic no trivial hasta que OpenAI resuelva el issue.

El $0.46 de diferencia por tarea no es el factor decisivo. Lo que importa es el costo total de propiedad y si la calidad superior de Claude Code en tareas complejas te ahorra tiempo de revisión posterior. Para la mayoría de los equipos con proyectos reales, probablemente sí.

Fuentes

- Anthropic — Precios oficiales de Claude Code y modelos

- Blake Crosley — Comparativa independiente Claude Code vs Codex (mayo 2026)

- DataCamp — Benchmarks y análisis de rendimiento comparativo

- GitHub — Issue #16556: infinite loop en Codex en tareas de refactoring

- Ecosistema Startup — Claude Code 2026: precios reales y alternativas