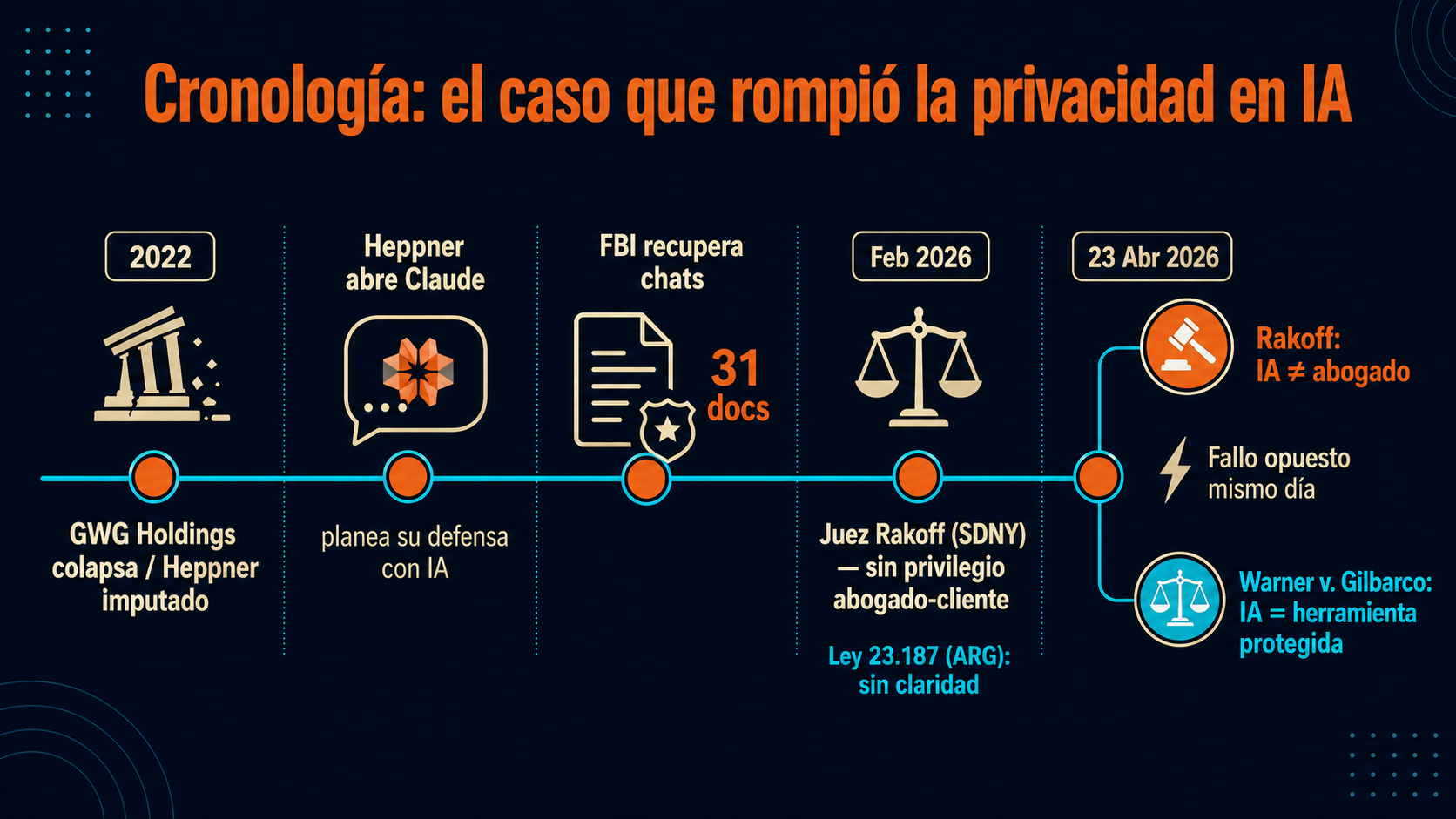

Un juez federal del Distrito Sur de Nueva York dictaminó en febrero de 2026 que las conversaciones con Claude no están protegidas por el privilegio abogado-cliente, permitiendo que 31 documentos recuperados por el FBI se usaran como prueba contra Bradley Heppner, ex-CEO de GWG Holdings. El mismo día, otro juez llegó a la conclusión opuesta en un caso diferente. El sistema legal estadounidense no sabe qué hacer con esto todavía.

En 30 segundos

- El juez Jed Rakoff (SDNY) falló que Claude no tiene estatus de abogado y que usarlo para planear una defensa no genera privilegio legal.

- El FBI recuperó 31 documentos de conversaciones que Heppner creyó haber borrado, y se usaron como evidencia en el juicio.

- El mismo 23 de abril de 2026, un juez diferente dictaminó lo contrario en Warner v. Gilbarco: la IA es una “herramienta” protegida por work product doctrine.

- En Argentina, el secreto profesional del artículo 51 de la Ley 23.187 protege las comunicaciones con abogados, pero no hay claridad sobre si eso se extiende a lo que vos le contás a una IA.

- Si compartiste información legal sensible con ChatGPT o Claude, asumí que un juez podría ordenar su producción en un litigio.

Claude es un modelo de lenguaje grande desarrollado por Anthropic, entrenado para generar texto, responder preguntas y asistir en tareas de análisis y programación. Fue lanzado en 2023 y se accede principalmente a través de Claude.ai, una interfaz web, y una API.

El caso que cambió todo: Heppner vs. el juez Rakoff

Bradley Heppner era el CEO de GWG Holdings cuando la empresa colapsó en 2022. Mientras enfrentaba cargos federales, hizo algo que muchos profesionales hacen hoy sin pensarlo dos veces: abrió Claude y le preguntó cómo estructurar su defensa.

El problema es que el FBI llegó antes que su abogado a esas conversaciones.

Según el fallo del juez Jed Rakoff del Distrito Sur de Nueva York, los investigadores recuperaron 31 documentos de las sesiones con Claude que Heppner consideraba eliminadas. La defensa argumentó que esas conversaciones estaban protegidas por attorney-client privilege porque Heppner las usó para prepararse legalmente. Rakoff rechazó el argumento sin demasiado rodeo.

El razonamiento es bastante directo: para que exista privilegio abogado-cliente hace falta, como mínimo, un abogado. Claude no es un abogado. No tiene licencia, no tiene obligación de lealtad hacia el cliente, no tiene deber de confidencialidad ante un tribunal. Hablarle a Claude sobre tu defensa es, legalmente, como hablarle a tu cuaderno (y tu cuaderno también puede ser incautado).

¿Por qué la IA no es un abogado? El razonamiento judicial

El privilegio abogado-cliente en Estados Unidos requiere cuatro elementos: una comunicación confidencial, entre un cliente y un abogado licenciado, hecha con el propósito de obtener asesoramiento legal, sin presencia de terceros. La IA falla en prácticamente todos.

Primero, Anthropic (la empresa detrás de Claude) tiene sus propios términos de servicio y políticas de privacidad que pueden permitir acceso a las conversaciones bajo ciertas circunstancias legales. No hay “confidencialidad” en el sentido que exige el privilegio. Segundo, y esto es lo que más le interesó a Rakoff, usar una IA para planear una defensa no es análogo a consultar a un abogado. Es más parecido a googlear “cómo no ir preso” y anotar los resultados.

¿Y la work product doctrine, que protege la preparación de defensa? Acá viene lo bueno: la defensa de Heppner intentó ese argumento también, y el juez lo rechazó en este contexto específico porque Heppner no estaba siendo representado por un abogado al momento de usar Claude. La doctrina protege el trabajo de los abogados, no el de sus clientes hablando solos con una IA. Complementá con modelos de IA más seguros y regulados.

La contradicción: el mismo día, el fallo opuesto

El 23 de abril de 2026, mientras el fallo de Rakoff circulaba en los medios legales, otro juez federal firmaba exactamente la decisión contraria en Warner v. Gilbarco Veeder-Root.

En ese caso, la empresa demandada usó ChatGPT como herramienta de investigación durante la preparación de su defensa, con abogados involucrados en el proceso. El juez dictaminó que la IA actuaba como un “lápiz electrónico” (en sus palabras): una herramienta al servicio del trabajo legal, no un tercero que rompe la confidencialidad. Bajo esa lógica, las conversaciones quedaban cubiertas por work product doctrine.

¿Cómo pueden existir dos fallos opuestos el mismo día sobre la misma tecnología? Porque los hechos importan mucho: en un caso hay un CEO sin representación legal usando IA para planear su defensa; en el otro hay un equipo legal usando IA como apoyo de investigación. Los jueces distinguen contextos, y en este momento no hay una guía clara del sistema federal sobre cómo tratar esto de manera uniforme.

El resultado práctico para cualquier abogado corporativo en 2026: total incertidumbre. Decrypt reportó que estudios jurídicos de todo el país están revisando sus políticas de uso de IA de urgencia.

Recuperación de conversaciones “borradas”: lo que los fiscales ya saben hacer

Ponele que borrás el historial de ChatGPT o de Claude. ¿Desaparecen los datos? No exactamente.

Las técnicas que usan los fiscales para recuperar chats eliminados incluyen análisis de metadata del dispositivo, solicitudes directas a OpenAI o Anthropic bajo órdenes judiciales, logs de acceso almacenados en los servidores de la empresa, y copias de seguridad automáticas en servicios de nube empresariales. En el caso Heppner, el FBI obtuvo los 31 documentos combinando solicitudes formales a Anthropic con análisis forense del dispositivo de Heppner.

Hay otros dos casos que ilustran esto bien. En el caso Masimo (el CEO Joe Kiani enfrentando litigio corporativo), los fiscales recuperaron conversaciones con ChatGPT que Kiani usó para evaluar su exposición legal, conversaciones que incluían admisiones sobre conocimiento previo de ciertos problemas. En el caso Krafton contra Changhan Kim (que involucra un earnout de USD 250 millones), los fiscales obtuvieron sesiones de ChatGPT donde Kim discutió estrategia de negociación confidencial. Más contexto en diferencias críticas entre herramientas de IA.

La lección es la misma en todos: “borrado” en la interfaz no es lo mismo que “destruido”. Los servidores de estas empresas guardan mucho más de lo que la mayoría de los usuarios imagina.

Privacidad en Argentina: ¿Es diferente acá?

La Ley 23.187 establece el secreto profesional del abogado argentino, y está reforzada por el artículo 18 de la Constitución Nacional. En papel, la protección es sólida. El tema es que fue redactada décadas antes de que existiera ChatGPT.

El análisis es este: si vos le contás algo a tu abogado y él toma notas, esas notas son privilegiadas. Si vos le contás lo mismo a ChatGPT y le mandás el resultado a tu abogado, ¿qué parte está protegida? Probablemente la comunicación con el abogado, pero no necesariamente lo que está en los servidores de OpenAI.

Según un análisis publicado en Abogados.com.ar, la jurisprudencia argentina todavía no tiene casos concretos sobre esto, pero la tendencia doctrinal es que el privilegio protege el contenido cuando el destinatario es el abogado, no cuando es una empresa tecnológica estadounidense. La IA está en el medio de esa cadena, y ese medio no está protegido.

Hay un antecedente que suma contexto: en 2026, un juez argentino anuló parcialmente una sentencia porque el tribunal auxiliar había usado ChatGPT para redactar parte de su fundamentación sin declararlo. El caso llegó a cámara. No resuelve la cuestión del privilegio directamente, pero muestra que el Poder Judicial argentino ya está procesando activamente estos temas.

Riesgos reales para empresas y ejecutivos

Los CEOs y directivos legales son el target más obvio, pero el riesgo se distribuye bastante más amplio.

Pensá en los contextos donde la gente usa IA para “pensar en voz alta” sobre temas sensibles: análisis de exposición legal antes de una auditoría, evaluación de responsabilidad en accidentes o productos defectuosos, estrategia en procesos de M&A, planificación de respuesta ante investigaciones regulatorias. Todos esos usos generan texto que podría ser discoverable. Tema relacionado: por qué las plataformas restringen acceso a IA.

El riesgo corporativo tiene otra capa que muchos subestiman. Google Workspace y Microsoft 365 capturan las interacciones con Gemini y Copilot dentro de sus plataformas empresariales. En un litigio donde se pide producción de documentos electrónicos (eDiscovery), esas conversaciones pueden entrar en el alcance. El departamento legal de tu empresa puede tener una política de uso de IA; el equipo de finanzas probablemente no.

Ojo con esto: las conversaciones que generan más riesgo no son las que parecen comprometedoras a primera vista. Son las casuales, las de “a ver qué me dice la IA sobre esta situación”, donde la gente tiende a ser más franca precisamente porque cree que no hay consecuencias.

Guía práctica: cómo usar IA de forma segura en contextos legales

Si ya compartiste información legal sensible con una IA, no hay mucho que puedas hacer retroactivamente excepto documentar el contexto (para qué lo usaste, quién lo autorizó) y consultarlo con tu abogado si estás en medio de un litigio.

Para el uso futuro, las reglas que están emergiendo de los estudios jurídicos más cautos son bastante concretas:

- Asumí que todo es discoverable. Si escribís algo en ChatGPT o Claude que no querrías ver en un tribunal, no lo escribas ahí.

- La versión paga/privada no es suficiente protección. Las empresas siguen teniendo obligación de responder a órdenes judiciales independientemente del plan de suscripción.

- Usá IA para tareas genéricas, no para análisis de tu caso específico. “Explicame la work product doctrine” está bien. “Analizá si tengo exposición en este contrato y adjunto el contrato” es otro nivel de riesgo.

- Si sos abogado y usás IA para trabajo de clientes, documentá el proceso. El caso Warner v. Gilbarco muestra que la protección existe cuando hay un abogado licenciado supervisando el uso como herramienta de trabajo.

- Revisá las políticas de retención de datos de las herramientas que usás. Muchas plataformas empresariales de IA tienen configuraciones de retención que se pueden ajustar.

Para empresas con equipos legales, la prioridad ahora mismo es tener una política escrita sobre uso de IA en contextos de litigio o investigación regulatoria. No es paranoia, es gestión de riesgo básica.

| Caso | Año | Resultado | Razón clave |

|---|---|---|---|

| Heppner (GWG Holdings) | 2026 | Sin privilegio — evidencia admitida | No había abogado en la ecuación; CEO usó IA solo para planear defensa |

| Warner v. Gilbarco | 2026 | Con privilegio — work product doctrine | Abogados supervisaban el uso de IA como herramienta de investigación |

| Masimo (Joe Kiani) | 2025-2026 | Conversaciones recuperadas y admitidas | FBI obtuvo chats sobre exposición legal directamente de OpenAI |

| Krafton v. Changhan Kim | 2025-2026 | Sesiones de ChatGPT producidas en discovery | Discusión de estrategia de negociación confidencial en plataforma de tercero |

Errores comunes que conviene evitar

Creer que “modo privado” o “sin historial” protege algo

No activa. Los modos de navegación privada o el “chat temporal” de ChatGPT afectan lo que se muestra en tu interfaz, no lo que queda en los servidores de la empresa. Una orden judicial puede acceder a eso independientemente del modo que usaste. En cómo se protegen las cuentas en IA profundizamos sobre esto.

Confundir confidencialidad de privacidad con privilegio legal

Son cosas distintas. OpenAI puede tener una política de privacidad excelente y aun así estar obligada a producir documentos ante un tribunal. La privacidad comercial y el privilegio abogado-cliente tienen orígenes y alcances completamente diferentes.

Asumir que lo que aplica en EE.UU. no aplica acá

Si tu empresa tiene operaciones o litigios en Estados Unidos, las reglas de discovery estadounidenses pueden alcanzar documentos generados en Argentina. Y aunque el litigio sea local, un juez argentino puede pedir producción de datos a empresas tecnológicas extranjeras vía cartas rogatorias. La jurisdicción no es un escudo automático.

Preguntas Frecuentes

¿Están protegidas mis conversaciones con ChatGPT si hablo de temas legales?

No, salvo en circunstancias muy específicas. El fallo del juez Rakoff en el caso Heppner (febrero 2026) estableció que ChatGPT y Claude no tienen estatus de abogado, por lo que las conversaciones con estas herramientas no generan privilegio abogado-cliente. La excepción que surge de Warner v. Gilbarco aplica cuando un abogado licenciado usa la IA como herramienta de trabajo supervisada, no cuando el cliente la usa por su cuenta.

¿Qué pasó exactamente en el caso Heppner?

Bradley Heppner, ex-CEO de GWG Holdings, usó Claude para planear su defensa en un proceso penal federal. Creyó haber borrado las conversaciones. El FBI las recuperó y obtuvo 31 documentos que el juez Jed Rakoff admitió como evidencia, determinando que no había privilegio abogado-cliente porque Claude no es un abogado licenciado y no existe relación profesional privilegiada con una IA.

¿Pueden usar mis chats con IA como prueba en un juicio?

Sí, en la mayoría de los contextos. Si estás en un litigio donde se requiere producción de evidencia digital (eDiscovery), las conversaciones con herramientas de IA pueden ser solicitadas mediante orden judicial. Las empresas como OpenAI y Anthropic están obligadas a responder a esas órdenes. Borrar el historial en la interfaz no destruye necesariamente los datos en los servidores.

¿Cómo recuperan los fiscales conversaciones borradas?

Principalmente a través de solicitudes formales directamente a las empresas de IA (OpenAI, Anthropic) bajo órdenes judiciales, análisis forense de dispositivos, y logs de acceso almacenados en servidores. Las plataformas de nube empresarial como Google Workspace o Microsoft 365 también pueden retener copias de sesiones de Gemini o Copilot. “Borrado” en la interfaz del usuario raramente equivale a destrucción permanente del dato.

¿Qué debo hacer si ya compartí información legal sensible con una IA?

Primero, documentá el contexto: para qué usaste la herramienta, quién lo sabía, si había abogados involucrados en el proceso. Segundo, si estás en medio de un litigio o investigación, consultalo con tu abogado de inmediato antes de tomar cualquier acción adicional. No intentes “borrar más” retroactivamente sin asesoramiento, porque eso puede agregar problemas de obstrucción.

Conclusión

El fallo sobre el caso Heppner y la contradicción inmediata de Warner v. Gilbarco no resolvieron nada, pero sí dejaron claro que el sistema legal ya está procesando activamente estos temas. Lo que antes era una zona gris vaga ahora tiene casos concretos, nombres de jueces y precedentes que los abogados van a citar.

La situación actual en 2026 es esta: si usás IA sin un abogado licenciado en el medio, no hay privilegio que valga. Si la usás como herramienta dentro de un proceso legal supervisado por abogados, hay chances de protección, pero no está garantizado y depende del juez. En Argentina, la incertidumbre es todavía mayor porque no hay jurisprudencia clara.

La recomendación concreta no cambia con los matices jurídicos: asumí que todo lo que le contás a una IA sobre temas legales puede aparecer en un tribunal. Eso no significa que no uses estas herramientas, sino que tenés que ser deliberado sobre qué información ponés ahí.

Fuentes

- Technology.org — Federal judge rules AI chatbot conversations can be used as evidence in court (abril 2026)

- StartupFortune — Dos fallos opuestos sobre privilegio en IA el mismo día

- Minnesota Lawyer — Análisis del caso Rakoff/Heppner y privilegio abogado-cliente

- Decrypt — Tu IA en tu contra: estudios jurídicos reorganizando políticas

- Abogados.com.ar — Confidencialidad abogado-cliente e IA en el derecho argentino