La resistencia anti-IA luddismo que prolifera en foros y redes en 2026 tiene un problema de fondo: según el análisis de Steffen Kirkegaard, criticar el AI slop y el mal uso es legítimo, pero rechazar toda herramienta IA por tribalismo ideológico es el equivalente moderno de decir “los agricultores de verdad no usan tractores”. Y ya se está volviendo tedioso.

En 30 segundos

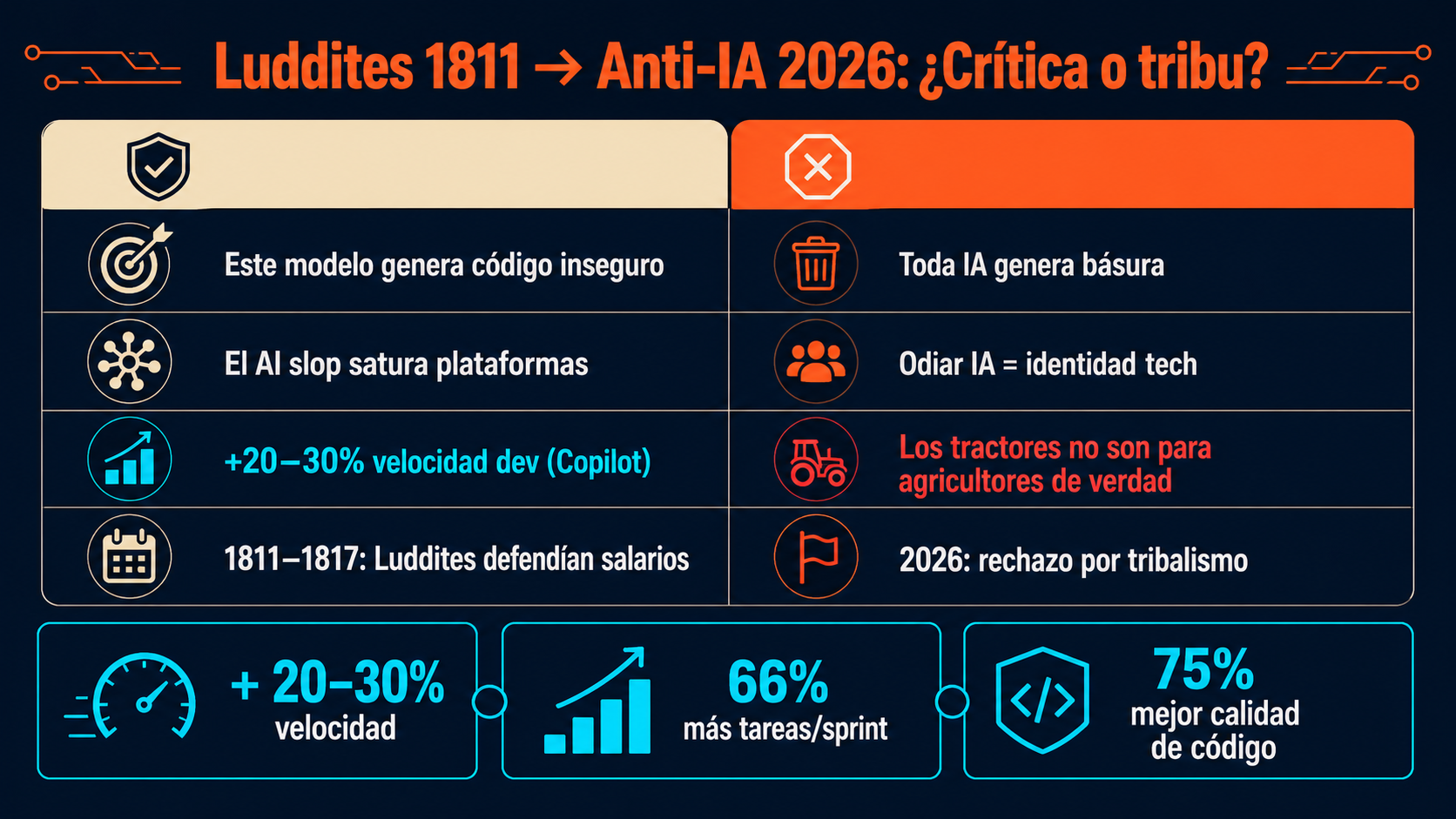

- La crítica legítima al AI slop (contenido basura generado por IA) se convirtió en identidad tribal: odiar todo lo IA-adjacent es ahora una señal de pertenencia en ciertos círculos tech.

- Los Luddites originales (1811-1817) no rechazaban la tecnología por principio; defendían sus empleos y salarios. El paralelo con el anti-IA de 2026 es parcialmente válido pero no exacto.

- El AI slop y la “slopaganda” son problemas reales: contenido incoherente, emocionalmente cargado, que satura plataformas y afecta la capacidad crítica de quien lo consume.

- Los datos de productividad para desarrolladores que usan IA son concretos: 20-30% más velocidad, 66% completan más tareas por sprint, 75% reportan mejor calidad de código.

- La postura inteligente no es adopción ciega ni rechazo tribal, sino evaluar cada herramienta por sus méritos reales.

Copilot es un asistente de inteligencia artificial desarrollado por GitHub (subsidiaria de Microsoft) y OpenAI que genera sugerencias de código para programadores.

La tribalización de la crítica anti-IA

Ponele que abrís LinkedIn a las 9 de la mañana. En el feed hay tres posts “inspiracionales” que claramente pasaron por ChatGPT, dos artículos sobre productividad que podrían ser el mismo artículo con distintas fotos de stock, y un anuncio de empresa que termina con “¿Qué pensás? Contanos en los comentarios”. Todo huele a IA. Y nadie lo niega: el AI slop existe, es abundante y es un problema genuino.

El tema es que, en algún punto de 2025, la crítica razonable a ese contenido vacío mutó en algo diferente. Hoy, en comunidades de desarrollo, rechazar cualquier cosa que tenga “AI” en el nombre pasó a ser una forma de identidad. Una señal de que sos “de los buenos”. Que pensás por vos mismo. Que no caíste en el hype (lo que implica, claro, que todos los que usan GitHub Copilot sí cayeron).

¿El resultado? Gente que descarta herramientas que podrían ayudarle a trabajar mejor, no porque las probó y no le funcionaron, sino porque ya decidió de antemano que son parte del problema.

La verdadera historia de los Luddites

Cuando alguien llama “luddita” a un crítico de la IA, generalmente lo dice como insulto: alguien irracional, miedoso, atrasado. Pero vale la pena entender de qué habla el término antes de usarlo.

Los Luddites originales eran artesanos especializados en la industria textil inglesa que entre 1811 y 1817 destruyeron maquinaria en fábricas. No porque odiaran la tecnología en abstracto. Sino porque la automatización que llegaba los dejaba sin trabajo, bajaba los salarios del sector y desvalorizaba una habilidad que habían tardado años en desarrollar. Era una respuesta a una amenaza económica concreta, con un contexto político específico (la postguerra napoleónica, la pobreza extrema, la falta de regulación laboral). Te puede servir nuestra cobertura de herramientas como Copilot que enfrentan resistencia.

El paralelo con la IA moderna es parcialmente válido (hay trabajadores cuyas habilidades se devalúan con la automatización) pero también tiene sus límites. Un desarrollador que usa Copilot para escribir tests boilerplate no está reemplazando artesanos calificados; está automatizando la parte más aburrida de su propio trabajo. La situación es bastante distinta.

El problema real: AI slop y slopaganda

Antes de defender la IA, hay que reconocer que el AI slop es un problema genuino y tiene ejemplos concretos que justifican el escepticismo.

El AI slop es contenido de baja calidad generado masivamente con herramientas de IA, publicado sin revisión ni criterio. Libros digitales baratos en Amazon que son resúmenes de resúmenes, publicaciones de redes con afirmaciones falsas pero fluidas, código generado que compila pero hace cosas incorrectas. El término “slop” se popularizó durante 2024-2025 precisamente para nombrarlo: no toda IA es slop, pero el slop siempre usa IA.

Hay algo peor todavía: la “slopaganda”, que combina AI slop con propaganda. Contenido incoherente, emocionalmente cargado, producido en volumen para saturar plataformas y reducir la capacidad crítica de quien lo consume. No es solo molesto; es un vector de desinformación a escala industrial.

Eso sí: que el mal uso de una herramienta sea problemático no convierte a la herramienta en inútil. Los motores de búsqueda también se llenaron de spam SEO en los 2000. No por eso dejamos de buscar en Google.

Lo que la IA realmente hace por desarrolladores

Acá vienen los datos que a veces quedan afuera de la discusión tribal.

Según datos relevados por CIO Magazine sobre IA generativa en desarrollo de software, los equipos que incorporaron herramientas como GitHub Copilot reportan entre un 20% y 30% de mejora en velocidad de desarrollo. El 66% de desarrolladores encuestados dice completar más tareas por sprint. El 75% reporta mejor calidad de código (menos bugs que llegan a revisión).

No son números abstractos. Son desarrolladores que usaron la herramienta, la midieron y reportaron resultados. Podés discutir el metodología de cada estudio (y deberías, si tenés razones), pero no podés ignorar que hay evidencia acumulada.

Lo que hacen concretamente: generan bloques de código repetitivo (tests, getters/setters, configuración), aceleran la depuración al sugerir causas probables, ayudan a navegar APIs y frameworks nuevos sin leer documentación completa. Si alguna vez configuraste un proyecto de cero en un framework que no conocías bien, sabés cuánto tiempo se va en buscar ejemplos. Eso es exactamente lo que Copilot acorta (spoiler: no elimina la necesidad de entender lo que estás haciendo). Relacionado: las controversias recientes alrededor de Copilot.

Crítica legítima vs. rechazo irracional

La distinción importa, y conviene hacerla explícita.

| Crítica legítima | Rechazo irracional |

|---|---|

| Esta herramienta genera código inseguro sin aviso | Toda IA genera basura, no uso ninguna |

| El output de este modelo requiere revisión constante, no ahorra tiempo real | Los que usan Copilot no saben programar de verdad |

| La concentración de poder en 3 empresas de IA es un problema estructural | Usar IA es hacerle el juego a las corporaciones |

| Este caso de uso específico tiene riesgos de privacidad con mi código propietario | La IA va a reemplazar a todos los desarrolladores, así que para qué aprenderla |

| El modelo alucina referencias y hay que verificar todo lo que genera | No necesito IA, yo pienso solo |

La columna de la izquierda describe problemas reales que se pueden investigar, medir y resolver. La de la derecha describe posturas que se adoptaron antes de analizar nada.

¿Y quiénes son exactamente los que más deberían evaluar esto con criterio? Los desarrolladores. Porque tienen las herramientas para probarlas, medir resultados y distinguir entre lo que zafa y lo que no.

Cómo evaluar herramientas IA sin ser dogmático

Un framework práctico para no caer en ninguno de los dos extremos (evangelismo ni rechazo tribal):

- ¿Mejora un flujo específico? No “¿es útil en general?”, sino “¿para escribir tests de integración me ahorra tiempo real?”. Medilo en tu contexto.

- ¿Cuál es la calidad del output en ese caso de uso? Un modelo puede ser excelente para refactoring y pésimo para arquitectura. No es todo o nada.

- ¿Qué costo tiene el error? Usar IA para generar un primer borrador de documentación tiene bajo costo de error. Usarla para generar lógica de autenticación sin revisión tiene costo alto.

- ¿El marketing dice “AI” o hay sustancia técnica? Muchas herramientas 2025-2026 pusieron “AI” en el nombre para subirse al hype. Algunas son envoltorio de una API de terceros con markup del 300%. Esas merecen el escepticismo.

La “inteligencia artificial” como etiqueta de marketing no te dice nada. Tenés que mirar qué hace concretamente la herramienta, qué modelo usa y si los resultados son medibles.

El futuro del trabajo: adaptación vs. nostalgia

Hay una pregunta que la discusión tribal evita: ¿qué ganás rechazando herramientas que tus colegas están usando? Tema relacionado: prompts avanzados que demuestran capacidades reales.

No es una pregunta retórica orientada a la presión social. Es una pregunta sobre posicionamiento real. El desarrollador que entiende cómo funciona un LLM, sabe cuándo usarlo y cuándo no, y puede auditar el código que genera, tiene una habilidad adicional respecto al que sabe lo mismo pero nunca tocó estas herramientas. Las dos personas siguen siendo desarrolladores. Una tiene un toolkit más amplio.

Los que aprendan a trabajar con IA no están “traicionando” la programación. La están usando como los carpinteros usan clavadoras neumáticas: la herramienta hace una parte del trabajo mecánico, el juicio sigue siendo humano. Y si la clavadora te entierra un clavo donde no debía, el error es tuyo.

Dicho esto, las preocupaciones sobre concentración de poder, derechos de autor, privacidad del código y devaluación de ciertas habilidades son legítimas y merecen atención política y regulatoria. Eso no se resuelve ignorando las herramientas; se resuelve participando en las discusiones sobre cómo se regulan.

Errores comunes en el debate

Confundir el AI slop con toda la IA. Que existan libros digitales basura generados por IA no dice nada sobre si Copilot te ayuda a debuggear más rápido. Son fenómenos distintos que comparten tecnología base, igual que el spam de email no invalida el correo electrónico.

Tratar los benchmarks de productividad como publicidad. “Ese estudio lo financió GitHub” es un argumento que hay que aplicar consistentemente, no solo cuando el resultado no te gusta. Si los datos muestran que algo no funciona, también los citamos. El sesgo de confirmación en el debate IA va en las dos direcciones. Para más detalles técnicos, mirá automatizaciones sin código que transforman procesos.

Así es básicamente lo que desarrollamos en The anti-AI crowd is giving “real farmers don’t use tractors.

Creer que el rechazo te protege de la automatización. Si tu trabajo incluye tareas que un LLM puede hacer razonablemente bien, ignorar eso no cambia la situación. Entender cómo funciona la herramienta te da ventaja sobre quien la usa sin criterio y sobre quien la rechaza sin haberla probado.

Preguntas Frecuentes

¿Por qué hay tanta resistencia a la inteligencia artificial entre desarrolladores?

Parte de la resistencia viene de críticas válidas al AI slop y a las prácticas de algunas empresas. Otra parte es identidad tribal: en ciertos círculos tech, rechazar IA se convirtió en señal de autenticidad. El problema es que la segunda razón está desplazando a la primera, y el rechazo automático le impide a mucha gente evaluar herramientas que podrían mejorar su trabajo.

¿Qué es el AI slop y por qué es un problema?

El AI slop es contenido de baja calidad generado masivamente con herramientas de IA y publicado sin revisión. Incluye desde libros digitales baratos hasta publicaciones en redes con información incorrecta presentada con fluidez. Es un problema porque satura plataformas y reduce la señal/ruido, pero no invalida todos los usos de IA.

¿En qué se diferencia la crítica válida del luddismo anti-IA?

La crítica válida nombra problemas concretos: esta herramienta alucina en ciertos contextos, este uso específico tiene riesgos de privacidad, este modelo concentra poder en pocas empresas. El luddismo anti-IA descarta cualquier herramienta por llevar la etiqueta “AI” sin evaluación. La diferencia es si hay criterio aplicado o es postura ideológica previa.

¿Es la IA realmente beneficiosa para el desarrollo de software?

Los datos disponibles apuntan a que sí, en casos de uso específicos. Equipos que usan asistentes de código como GitHub Copilot reportan entre 20% y 30% de mejora en velocidad y 75% reporta menos bugs en revisión. El beneficio no es universal ni automático: depende de cómo se usa, en qué tareas y con qué nivel de revisión del output.

¿Qué herramientas de IA valen realmente la pena para programar?

Depende del flujo de trabajo, pero las que muestran resultados más consistentes son los asistentes de código integrados al editor (Copilot, Cursor) para tareas repetitivas y boilerplate, y los modelos de razonamiento (Claude, GPT-4o) para debugging y exploración de APIs nuevas. Las que no valen generalmente son herramientas que pusieron “AI” en el marketing pero son wrappers con poco valor agregado.

Conclusión

El debate sobre la IA en desarrollo de software en 2026 tiene dos trampas simétricas: el evangelismo que acepta todo sin criterio y el rechazo tribal que descarta todo sin evaluarlo. Las dos son cómodas. Las dos evitan el trabajo real de medir, probar y distinguir.

El AI slop es real. La slopaganda es real. La concentración de poder en pocas empresas de IA es un problema que vale discutir. Nada de eso justifica rechazar por defecto herramientas que, usadas con criterio, mejoran resultados medibles.

Los agricultores que adoptaron tractores no dejaron de ser agricultores. Pero los que se negaron tampoco ganaron nada con eso.

Fuentes

- Steffen Kirkegaard en Dev.to – The anti-AI crowd y el argumento del tractor (2026)

- CIO Magazine – Primeros beneficios de la IA generativa para el desarrollo de software

- The Conversation – Slopaganda: cuando el contenido basura anula la capacidad crítica

- El Diario – Slop, el término que designa el contenido basura que crea la IA

- El Salto Diario – Luddismo y tecnología: historia del rechazo a la automatización