Actualizado el 14/05/2026: Se filtraron nuevos detalles sobre Gemini Omni directamente desde el código de la app de Gemini: la cadena “Create with Gemini Omni: meet our new video model, remix your videos, edit directly in chat, try templates, and more” confirmó capacidades adicionales, incluyendo templates predefinidos y soporte para texto legible dentro de los videos en múltiples idiomas.

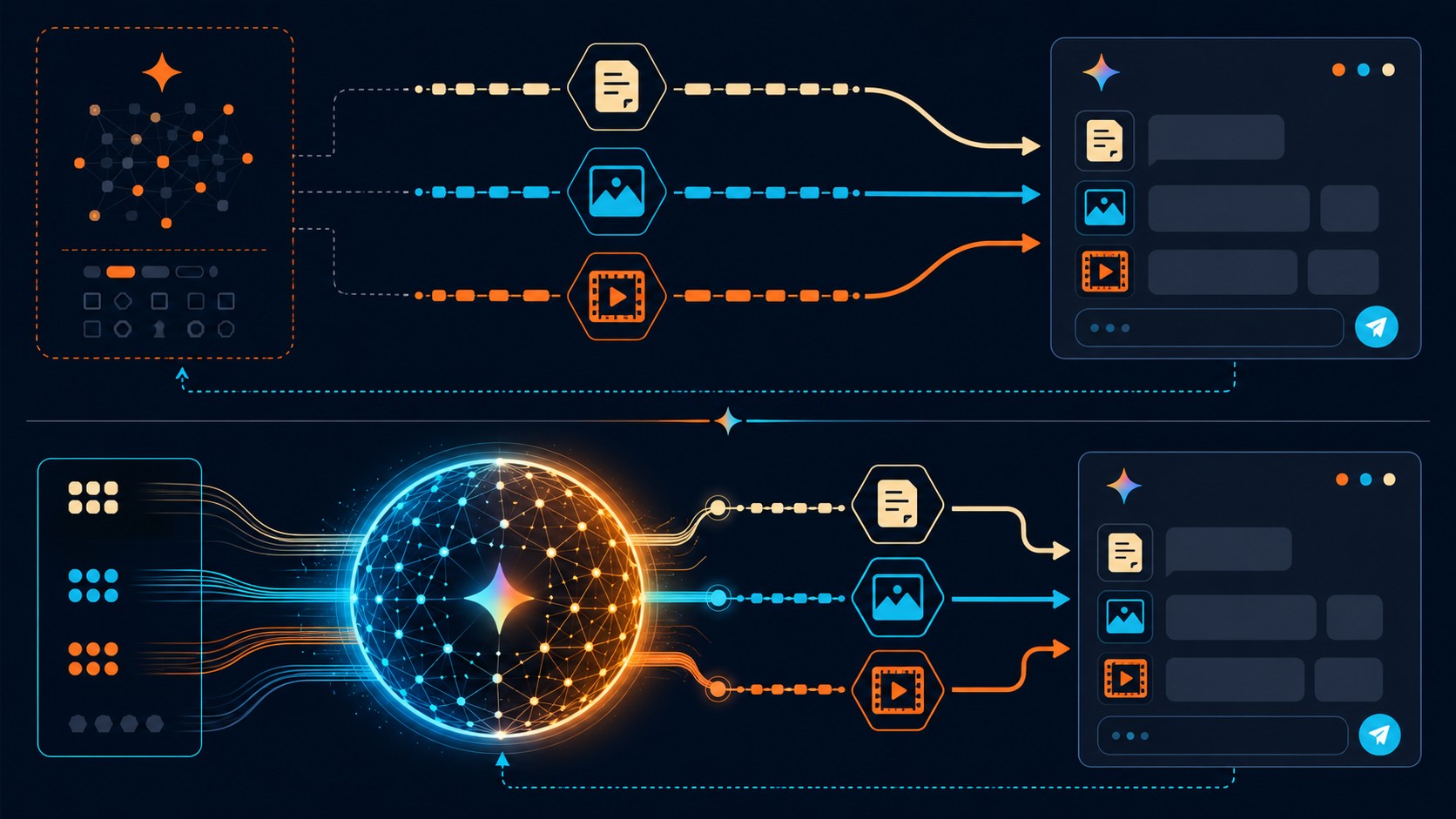

Gemini Omni es el nuevo modelo nativo de video de Google que unifica generación de texto, imagen y video en una sola interfaz conversacional, con edición de clips por chat sin necesidad de software externo. Se filtró dentro de la interfaz de Gemini el 2 de mayo de 2026, semanas antes del anuncio oficial esperado para Google I/O (19-20 de mayo). Lo que lo distingue de Veo 3.1 no es solo la calidad visual, sino que podés pedirle que borre un objeto, cambie la iluminación o reescriba un diálogo y lo hace sobre el clip ya generado, sección por sección.

En 30 segundos

- Gemini Omni se filtró el 2 de mayo de 2026 dentro de la interfaz de Gemini, con demos que muestran edición conversacional de video.

- El 12 de mayo, TestingCatalog encontró la cadena de texto oficial en el código de la app, revelando templates, remixing y edición directa en chat como funciones confirmadas.

- Google reemplaza Veo 3.1 con Omni: la diferencia clave es que Omni permite editar clips directamente desde el chat, sin abrir otra herramienta.

- Genera texto legible dentro de los videos en inglés, chino, japonés y coreano, una capacidad que Veo 3.1 no tenía.

- Genera audio espacial sincronizado en la primera pasada, sin TTS secundario ni efectos de sonido separados.

- El anuncio oficial se espera en Google I/O 2026 (19-20 de mayo), con lanzamiento público 2-4 semanas después.

- Disponible en planes Google AI Pro (USD 19,99/mes) y AI Ultra (USD 249,99/mes) según reportes previos al lanzamiento.

Gemini es un modelo de inteligencia artificial multimodal creado por Google que procesa y genera contenido en texto, imágenes, audio y video, diseñado para tareas como análisis, escritura y programación.

Gemini es un modelo de lenguaje multimodal desarrollado por Google. Fue lanzado en diciembre de 2023 y procesa y genera texto, imágenes, audio y vídeo para tareas de inteligencia artificial.

Qué es Gemini Omni: el modelo multimodal de Google

Gemini Omni es el modelo nativo de video de Google que procesa y genera texto, imagen y video dentro de una misma conversación. No es una actualización de Veo 3.1 sino su reemplazo generacional, con una diferencia fundamental: la edición conversacional. Donde Veo 3.1 genera y listo, Omni te deja seguir la conversación sobre el clip que acabás de crear.

La filtración del 2 de mayo de 2026 mostró las primeras demos reales antes de cualquier anuncio oficial. Según el reporte de Chrome Unboxed, el modelo apareció directamente en la interfaz de Gemini con ejemplos de generación y edición en cadena. No era un leak de documentación interna, era el producto funcionando.

Google I/O 2026, programado para el 19 y 20 de mayo, es la fecha probable de anuncio oficial. Que el modelo haya aparecido dos semanas antes no sorprende a nadie que haya seguido el historial de filtraciones de Google (spoiler: siempre se filtran).

Cómo fue la filtración del 12 de mayo y qué reveló el código

El 12 de mayo de 2026, TestingCatalog encontró dentro del código de la app de Gemini la cadena de texto que describe Omni con sus propias palabras: “Create with Gemini Omni: meet our new video model, remix your videos, edit directly in chat, try templates, and more.” No es un resumen de prensa ni una interpretación. Es literalmente cómo Google describe el producto internamente, antes de cualquier presentación oficial.

Eso importa por dos razones. Primero, confirma que las funciones no son especulativas: templates, remixing y edición en chat ya estaban integrados como features nombradas en la interfaz. Segundo, “and more” es deliberadamente vago, lo que sugiere que hay capacidades que Google todavía no quiere mostrar antes de I/O.

Android Authority amplió el reporte con capturas que muestran la entrada de Omni en la UI de Gemini, incluida la pantalla de selección de modelo. El diseño sugiere que Omni va a coexistir con Veo 3.1 durante un período de transición, no que lo reemplace de golpe el día del anuncio.

Lo que todavía no está claro es si Omni es una evolución arquitectónica de Veo o un sistema completamente distinto. Wavespeed AI plantea tres hipótesis: que Omni sea un nuevo nombre para Veo, un modelo separado entrenado con otra arquitectura, o una capa de orquestación sobre varios modelos. El comportamiento descrito en los leaks —edición por segmentos, audio nativo integrado— apunta más a la tercera opción, pero sin acceso al código no hay forma de confirmarlo.

Edición de videos por chat: la función que cambia el workflow

Ponele que generaste un clip de 15 segundos con Omni y el resultado tiene un logo en la esquina que no pediste, la luz del fondo no convence y el personaje habla demasiado rápido. Con Veo 3.1, regenerás todo desde cero. Con Omni, escribís en el chat: “Remové la marca de agua, ajustá la iluminación para que sea más cálida y reducí el ritmo del diálogo” y el modelo modifica solo las secciones afectadas, fotograma a fotograma. Ya lo cubrimos antes en cómo integrar Gemini Omni en tus proyectos.

La iteración es el diferencial real. El ciclo de ajuste que en cualquier otro flujo de video IA implica volver a prompt desde cero, esperar, evaluar, repetir, acá se comprime en un intercambio de mensajes dentro del mismo chat.

Las capacidades de edición confirmadas en las demos incluyen:

- Eliminación de objetos o elementos de escena sin regenerar el clip completo

- Cambio de iluminación o paleta de color por instrucción en lenguaje natural

- Reescritura de diálogos con sincronización labial automática

- Extensión de clips existentes manteniendo continuidad visual

El modelo regenera solo la sección solicitada. No es magia, es una arquitectura que segmenta el clip y aplica las instrucciones localmente. Dicho esto, todavía no hay benchmarks independientes sobre qué tan precisa es esa segmentación en casos complejos.

Texto legible dentro de los videos: lo que Veo 3.1 no podía hacer

Una de las capacidades nuevas que reveló la filtración del 12 de mayo es la generación de texto legible dentro de los videos. No texto decorativo o borroso como los carteles de fondo que aparecen en otros modelos: texto nítido, integrado en escena, que se puede leer.

Hipertextual describe ejemplos concretos: un profesor escribiendo ecuaciones matemáticas en un pizarrón dentro del video, con los símbolos correctamente formados y en perspectiva. Las demos circulantes también muestran texto en inglés, chino, japonés y coreano, lo que sugiere que la capacidad no está atada a un solo sistema de escritura.

Para educación y contenido tutorial, esto es más relevante de lo que parece. Hasta ahora, si necesitabas un video con texto preciso en escena, tenías que generarlo por separado y composite. Con Omni, el texto forma parte de la generación original. Habría que ver qué tan confiable es en caracteres complejos o en textos largos, pero el punto de partida ya está varios escalones arriba de cualquier modelo de video anterior.

Lo que no está confirmado es si este soporte de texto aplica también a idiomas con alfabeto latino extendido, como el español con tildes. Dato menor para la mayoría, pero no irrelevante para quien produce contenido en castellano.

Audio nativo sincronizado: una sola pasada, video y sonido juntos

La mayoría de los modelos de video IA que conocemos generan video primero y después le pegan audio con una capa separada. El resultado es ese lip-sync raro que delata todo, o el sonido ambiental que no coincide con la escena porque se generó en otro contexto. Relacionado: integrar Gemini en tus aplicaciones Node.js.

Omni genera audio espacial en la misma pasada que el video. Sin TTS secundario, sin Foley adicional. Según Infobae, esta es una de las características que Google presentó como diferenciadora frente a los modelos de la competencia. El sonido ambiental es consistente con la escena porque se modela junto con ella, no después.

Para videos cortos de 10-15 segundos, esto elimina una cantidad considerable de trabajo de postproducción. Los creadores que trabajen con contenido de esa escala van a notarlo.

Remixar clips existentes sin salir del chat

Además de generar desde texto, Omni acepta que subas un clip propio y le pidas que le cambies el estilo, extiendas o recompongás. El modelo mantiene continuidad en iluminación, posicionamiento de personajes y movimiento de cámara. Todo dentro de la misma ventana de chat. Complementá con comparativa con Claude en rendimiento.

En la práctica, un equipo de contenido puede tomar un video existente, pedirle a Omni tres variantes de estilo diferentes y tener los resultados en 15 minutos, sin abrir Premiere, DaVinci ni ningún otro software. Para marketing y creadores que iteran en volumen, el ahorro de tiempo no es menor.

Ojo: “mantiene continuidad” según las demos. Hasta que no haya pruebas independientes con casos de uso variados, tomalo con pinzas. Las demos de Google siempre muestran el caso feliz.

Gemini Omni video Google vs Veo 3.1: qué cambia en la práctica

Veo 3.1 es el generador actual de Google, actualmente disponible en los planes AI Pro y AI Ultra. Omni es su reemplazo. Las diferencias no son solo de calidad visual.

| Característica | Veo 3.1 (actual) | Gemini Omni (próximo) |

|---|---|---|

| Edición conversacional en chat | No | Sí |

| Audio sincronizado nativo | No (capa separada) | Sí (primera pasada) |

| Remix de clips subidos | Limitado | Sí, con continuidad |

| Texto legible en escena | No | Sí (inglés, chino, japonés, coreano) |

| Templates predefinidos | No | Sí (confirmado en código) |

| Disponibilidad | Ahora | Post Google I/O 2026 |

| Planes disponibles | AI Pro / AI Ultra | AI Pro / AI Ultra (estimado) |

| Iteración sin regenerar | No | Sí (por sección) |

Veo 3.1 va a seguir disponible durante la transición. Google no suele cortar modelos de golpe, sobre todo cuando hay integraciones en API que los equipos ya tienen corriendo. Para más detalles técnicos, mirá cómo se compara Claude con Gemini.

Qué está confirmado y qué todavía no

Con dos leaks en dos semanas y Google I/O a días, conviene separar lo que ya tiene respaldo concreto de lo que sigue siendo especulación.

Confirmado por el código y las demos

- Existe una entrada llamada “Gemini Omni” en la interfaz de Gemini (encontrada el 12 de mayo en el código de la app)

- Las funciones descriptas textualmente son: remix de videos, edición directa en chat, templates, generación con el nuevo modelo

- Demos funcionales muestran eliminación de objetos, cambio de iluminación y reescritura de diálogos sobre clips ya generados

- Generación de texto legible en escena en al menos cuatro idiomas

- Precio estimado: dentro de los planes AI Pro y AI Ultra existentes

Todavía sin confirmar

- Si Omni es una arquitectura nueva o una capa sobre modelos existentes (Veo incluido)

- Duración máxima de los clips generados (las demos muestran fragmentos cortos, no se confirmaron videos de más de 30 segundos)

- Soporte de texto en español u otros idiomas con alfabeto latino

- Fecha exacta de disponibilidad pública post-I/O

- Límites de uso dentro de cada plan (cuántos videos por día, resolución máxima)

- Acceso vía API para desarrolladores y timeline de ese lanzamiento

Muchas de estas incógnitas van a tener respuesta entre el 19 y 20 de mayo. Lo que sí está claro es que Google no va a anunciar algo a medias: si Omni aparece en I/O, llega con fecha y precio.

Comparación con Sora de OpenAI

Sora 2 sigue siendo la referencia en realismo visual puro para videos de hasta 1 minuto. Si lo que necesitás es calidad cinematográfica para una producción donde cada frame importa, Sora todavía está por delante en los tests informales que circularon en mayo de 2026.

Omni no compite en ese terreno, al menos no todavía. Lo que ofrece es velocidad de iteración. Generás, ajustás en el chat, generás de nuevo, sin salir de la interfaz. Para contenido de redes, demos rápidas o materiales de marketing donde el tiempo de producción importa tanto como la calidad, Omni tiene ventaja de workflow. Más contexto en capacidades proactivas en Android.

La pregunta real: ¿cuánto importa la diferencia de calidad visual cuando el modelo más rápido de iterar produce resultados suficientemente buenos en 20% del tiempo? Para equipos de contenido con volumen alto, probablemente Omni sea la respuesta. Para una agencia que entrega un comercial, Sora 2.

Qué significa para equipos y creadores en Latinoamérica

El acceso vía planes Google AI Pro (USD 19,99/mes) pone a Omni al alcance de equipos chicos y freelancers en Argentina y el resto de la región, sin necesidad de infraestructura propia ni contratos enterprise. Eso es un cambio respecto a las herramientas de video profesional que hasta hace dos años requerían equipos de postproducción dedicados.

Para agencias de marketing y equipos de contenido, la edición conversacional resuelve un problema concreto: la brecha entre “generar” y “publicar”. Hoy ese gap implica Premiere, revisiones, exports. Con Omni, si las demos reflejan el producto real, gran parte de ese ciclo desaparece.

Ahora bien, hay que considerar que los planes de Google AI tienen precios en dólares y no siempre están disponibles en todos los países de la región desde el día uno. Es habitual que el lanzamiento empiece en Estados Unidos y llegue a América Latina con semanas o meses de diferencia. Conviene seguir el anuncio de I/O para ver si Argentina está en la lista de disponibilidad inicial.

Para quienes ya usan la API de Gemini en sus aplicaciones: Programming Insider publicó una guía anticipatoria para desarrolladores con los endpoints que probablemente use Omni. Útil para preparar integraciones antes de que el acceso esté disponible.

Disponibilidad y precios esperados

El anuncio oficial se espera en Google I/O 2026, el 19 o 20 de mayo. El lanzamiento público estimado es 2-4 semanas después, lo que ubica la disponibilidad general entre fines de mayo y mediados de junio de 2026.

Omni llegaría en dos variantes: una versión Flash optimizada para velocidad y una versión Pro orientada a calidad máxima. Ambas dentro de los planes AI Pro y AI Ultra existentes, aunque los límites de uso todavía no están definidos públicamente. Que los límites sean “altos” según los reportes previos al lanzamiento sugiere que Google quiere que la adopción sea amplia desde el primer día.

Preguntas frecuentes

¿Qué es Gemini Omni y cómo genera videos?

Gemini Omni es el nuevo modelo de video de Google que procesa texto, imagen y video dentro de una misma conversación. A diferencia de los generadores tradicionales, no solo crea el clip inicial: permite seguir editándolo desde el chat, con instrucciones en lenguaje natural. El modelo segmenta el clip y aplica los cambios solo en las secciones indicadas, sin regenerar todo desde cero. En generación y edición de imágenes con IA profundizamos sobre esto.

¿En qué se diferencia Omni de Veo 3.1?

Veo 3.1 genera videos pero no permite editarlos una vez creados: si algo no quedó bien, hay que volver al prompt y regenerar. Omni agrega edición conversacional, remixing de clips existentes, templates predefinidos, audio nativo sincronizado y generación de texto legible dentro de escena. Son diferencias de workflow, no solo de calidad visual.

¿Cuándo estará disponible Gemini Omni en Argentina?

El anuncio oficial se espera en Google I/O los días 19-20 de mayo de 2026. El lanzamiento público estimado es 2-4 semanas después. La disponibilidad en Argentina depende de si el rollout inicial incluye la región: Google habitualmente empieza por Estados Unidos y expande en semanas. Conviene revisar el anuncio de I/O para confirmar el alcance geográfico desde el primer día.

¿Cómo funciona la edición de videos directamente en el chat de Gemini Omni?

Una vez generado un clip, podés escribirle al chat instrucciones específicas: eliminar un objeto, cambiar la iluminación, reescribir un diálogo, extender la escena. Omni identifica las secciones afectadas y las modifica localmente, manteniendo el resto del clip intacto. No hay interfaz de timeline ni herramientas de corte: todo se hace mediante lenguaje natural dentro de la misma conversación donde generaste el video.

¿Qué reveló exactamente la filtración del 12 de mayo?

TestingCatalog encontró dentro del código de la app de Gemini la cadena de texto que describe el producto: “Create with Gemini Omni: meet our new video model, remix your videos, edit directly in chat, try templates, and more.” Eso confirmó que las funciones de remixing, edición en chat y templates no son especulación sino features ya integradas en la interfaz, antes de cualquier anuncio oficial en Google I/O.

Conclusión

Gemini Omni llegó dos veces antes de ser anunciado: primero como demos en mayo, después como texto en el código de la propia app de Google. Eso no es casualidad, es un producto que ya estaba listo para mostrarse.

Lo que cambió con la filtración del 12 de mayo no es solo la confirmación de las funciones: es que ahora sabemos exactamente cómo Google describe Omni internamente. Remix, edición en chat, templates. Sin ambigüedad. El diferencial frente a Veo 3.1 es de workflow, no solo de píxeles: la posibilidad de iterar sobre el clip sin salir de la conversación es lo que va a determinar quién lo adopta y para qué.

Lo que queda por ver es si el producto real a la hora del lanzamiento cumple lo que muestran las demos. Google I/O va a dar las respuestas sobre precios definitivos, límites de uso, acceso API y disponibilidad regional. Vale la pena seguir el anuncio del 19-20 de mayo en tiempo real, porque si Omni funciona como promete, el flujo de producción de video IA va a ser otro a partir de ese momento.

Fuentes

- TestingCatalog — Google’s Gemini Omni video model surfaces ahead of I/O debut

- Chrome Unboxed — An impressive new Gemini Omni video model just leaked ahead of Google I/O

- Android Authority — Google Gemini Omni video model leak

- Infobae — Google reemplaza Veo con Omni

- Hipertextual — Así es Omni, el sustituto de Veo con resultados nunca antes vistos

- Programming Insider — Building with Gemini Omni: A Developer’s Guide