El costo de compute IA vs empleados llegó al centro del debate en 2026 después de que Bryan Catanzaro, VP de Applied Deep Learning en Nvidia, declarara a Axios: “The cost of compute is far beyond the costs of the employees” (el costo del cómputo supera con creces el costo de los empleados). En términos concretos: las empresas hoy gastan más en servidores y GPUs para correr sus modelos de IA que en los salarios de los equipos que los usan.

En 30 segundos

- Un ejecutivo de Nvidia confirmó en abril de 2026 que el costo de infraestructura IA supera al costo de nómina en las grandes tech.

- Meta, Google y Microsoft planean gastar en conjunto cerca de USD 700 mil millones en infraestructura IA durante 2026.

- Una sola GPU NVIDIA H100 en la nube cuesta entre USD 2,50 y USD 9 por hora, lo que equivale a hasta USD 4.008 al mes corriendo 24/7.

- Entrenar un modelo como Gemini Ultra costó aproximadamente USD 191 millones; la inferencia escala con el volumen de uso.

- Los costos de inferencia podrían bajar más del 90% en los próximos cuatro años, pero el gasto total seguirá subiendo por el crecimiento del volumen.

¿Qué dijo el ejecutivo de Nvidia sobre el costo de compute?

Bryan Catanzaro es VP de Applied Deep Learning en Nvidia. No es un vocero de marketing: trabaja en la capa técnica donde se decide cómo se usan las GPUs en producción real. Cuando alguien con ese perfil dice que el cómputo cuesta más que los empleados, no está vendiendo hardware. Está describiendo lo que ve todos los días.

La declaración salió publicada el 28 de abril de 2026 en Fortune, citando una entrevista con Axios. La frase exacta: “The cost of compute is far beyond the costs of the employees”. Traducido y sin adornos: si una empresa implementa IA a escala, lo que paga en servidores, nubes y GPUs hace quedar chico lo que paga en sueldos del equipo que opera esos sistemas.

Eso sí: Catanzaro también mencionó que los costos de inferencia van a caer más del 90% en cuatro años. Lo cual suena esperanzador hasta que te acordás de que el volumen de uso va a escalar de forma proporcional (o más). El gasto total no necesariamente baja.

El costo real de la infraestructura IA en grandes empresas

Los números de 2026 son difíciles de ignorar. Meta anunció una inversión de entre USD 115.000 y USD 135.000 millones en infraestructura IA para este año, con el mensaje explícito de “infraestructura primero”. Google tiene comprometidos USD 185.000 millones. Microsoft ronda los USD 105.000 millones. Sumado a otros jugadores, el gasto total del sector se acerca a USD 700.000 millones en 2026.

Para dimensionarlo: la nómina global de Google tiene unas 180.000 personas. Con un salario promedio de USD 150.000 anuales (incluyendo beneficios), eso son USD 27.000 millones al año en nómina. Su presupuesto de infraestructura IA es casi siete veces eso.

Desglose de costos: GPU, electricidad y enfriamiento

Ponele que tu empresa decide correr su propio modelo. ¿Qué se gasta?

Una GPU NVIDIA H100 (el estándar de facto para inferencia y fine-tuning en 2026) tiene un precio de compra de entre USD 25.000 y USD 40.000 por unidad, dependiendo del proveedor y la configuración. Si no querés comprarla sino alquilarla vía nube, el costo va de USD 2,50 a USD 9 por hora. Una sola GPU corriendo 24/7 durante un mes te cuesta entre USD 1.800 y USD 4.008. Y eso es una GPU.

Un cluster de 100 GPUs H100 corriendo sin parar durante un mes: entre USD 180.000 y USD 400.000, sin contar electricidad, refrigeración ni el equipo de DevOps que lo mantiene vivo. Los centros de datos para clusters grandes consumen megawatts, y el agua para enfriar los racks es un ítem presupuestario que nadie menciona en los keynotes.

¿Y qué pasó cuando las empresas escalaron sin planificar esos costos? Exacto: facturas de nube que triplicaron las estimaciones iniciales y revisiones presupuestarias de emergencia en el Q1 de 2026.

Costo de entrenar vs. costo de operar modelos grandes

Hay dos momentos de gasto en IA: el entrenamiento (hacerlo una vez, caro) y la inferencia (usarlo todo el tiempo, acumulativo).

Según estimaciones publicadas por ITNow, entrenar Gemini Ultra costó aproximadamente USD 191 millones. GPT-4 estuvo en el rango de USD 70 a USD 100 millones. Son gastos únicos (o casi: cada nueva versión requiere otro ciclo). El problema es la inferencia: cada vez que un usuario hace una consulta, el modelo consume cómputo. A escala de millones de consultas diarias, eso acumula rápido.

Un modelo de 1 billón de parámetros corriendo inferencia en producción, según Fortune, podría ver sus costos caer más del 90% en cuatro años. Esa caída es real. Eso sí, si pasás de 1 millón de consultas diarias a 100 millones, la ecuación no cierra igual aunque el costo por consulta baje.

¿Por qué IA es más caro que empleados? La ecuación económica

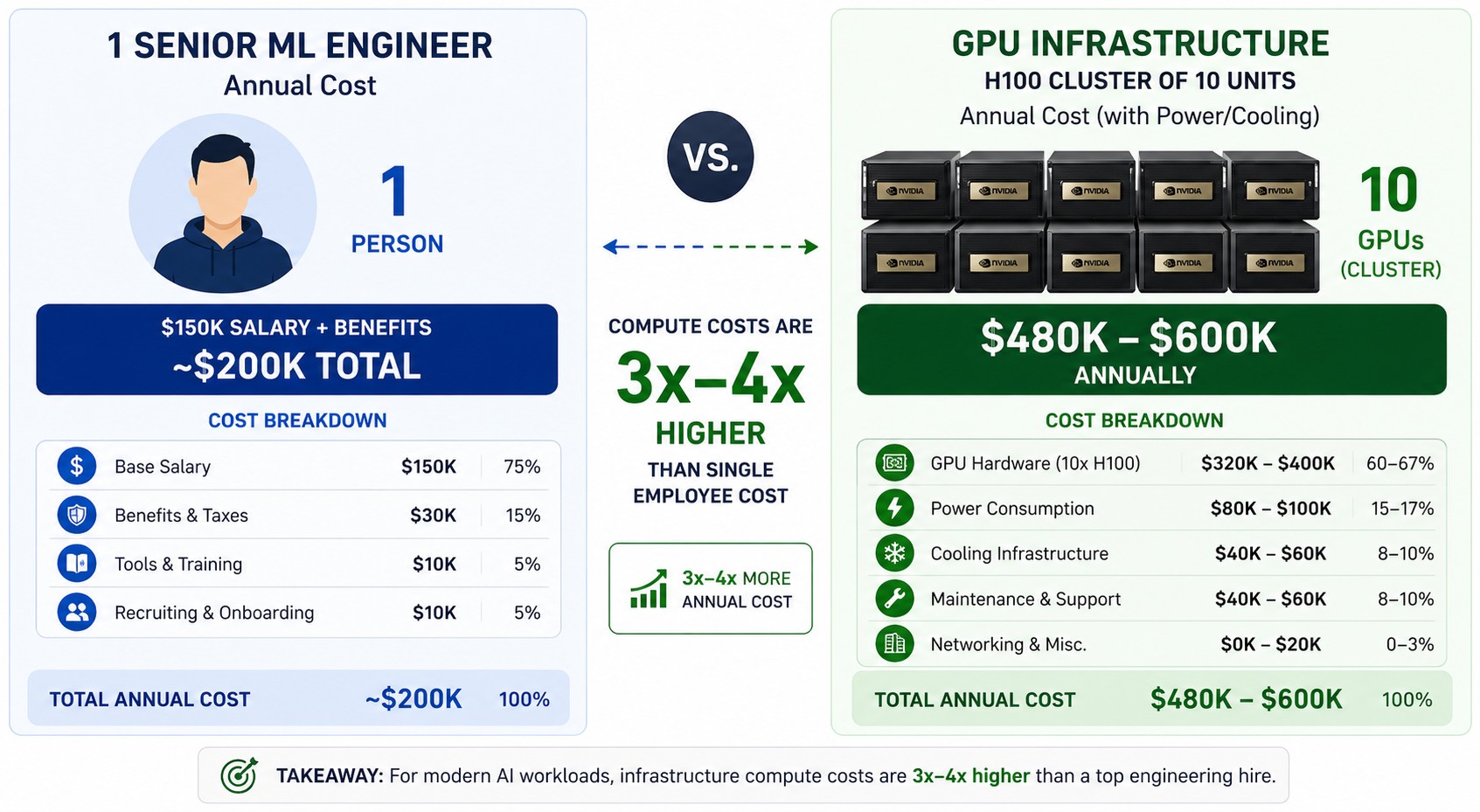

Un ingeniero de machine learning en Argentina gana entre USD 40.000 y USD 80.000 anuales. En Estados Unidos, el rango sube a USD 130.000 o USD 150.000 con beneficios. Una H100 en nube cuesta USD 48.000 al año corriendo 24/7. Parecería que estamos cerca. Pero necesitás varias GPUs por modelo en producción, no una sola.

Un equipo de 10 GPUs H100 corriendo continuo: entre USD 180.000 y USD 480.000 anuales, sin infraestructura adicional. Para comparar con cuántos humanos reemplazaría eso en un caso real de uso empresarial, hay que agregar los costos del equipo que configura, monitorea y corrige esos sistemas.

El MIT publicó un análisis en 2024 (cuyos datos siguen siendo relevantes en 2026) señalando que solo el 23% de los roles donde la IA podría aplicarse realmente son rentables de automatizar hoy. El 77% restante sigue siendo más barato con trabajo humano. Y según el mismo estudio, el 67% de las empresas que implementaron IA no redujeron su planta de personal.

La “automatización masiva de empleos” que se prometió es, por ahora, más un gasto de capital que un ahorro de nómina.

Tabla comparativa: costo de infraestructura IA vs. costo de empleados en 2026

| Concepto | Costo estimado (anual USD) | Notas |

|---|---|---|

| Ingeniero ML (EE.UU.) | $130.000 – $150.000 | Salario + beneficios promedio |

| Ingeniero ML (Argentina) | $40.000 – $80.000 | Salario en dólares, remoto |

| 1 GPU H100 en nube (24/7) | $21.600 – $48.000 | A $2,50-$9/hora según proveedor |

| Cluster 10 GPUs H100 (24/7) | $216.000 – $480.000 | Sin electricidad ni mantenimiento |

| Cluster 100 GPUs H100 (24/7) | $2.160.000 – $4.800.000 | Escala empresarial real |

| Entrenamiento Gemini Ultra | ~$191.000.000 | Gasto único por ciclo de entrenamiento |

| Gasto total Big Tech en IA (2026) | ~$700.000.000.000 | Meta + Google + Microsoft + otros |

Proyecciones: ¿seguirá siendo tan caro?

La buena noticia: los costos de inferencia van a bajar. La curva de mejora en eficiencia de hardware y software es real, y Fortune cita que en cuatro años los costos por consulta podrían caer más del 90%.

La mala noticia: el volumen de uso crecerá de forma exponencial. Empresas que hoy corren 100.000 consultas diarias van a correr 10 millones. El gasto total no baja porque el costo unitario baje; depende de qué hacés con ese abaratamiento.

Dicho esto, hay un cambio estructural en curso: los modelos más eficientes (como las series de “reasoning” compactos que aparecieron en 2025-2026) hacen que no necesités un H100 para cada inferencia. Modelos más chicos, bien ajustados, corriendo en hardware más barato. Eso sí está cambiando el cálculo para empresas medianas. Si te interesa desplegar modelos en tu propia infra o en hosting cloud, donweb.com tiene opciones de servidores VPS que pueden servir como punto de partida para inferencia liviana.

El mensaje real de Nvidia: inversión, no ahorro

Catanzaro no estaba quejándose. Nvidia vende las GPUs que hacen eso caro, así que tiene todos los incentivos del mundo para que el gasto en cómputo suba. Su declaración es más una descripción del estado actual que una crítica.

Lo que sí subraya es que en 2026 la IA es un gasto de capital masivo que las empresas hacen apostando a retorno futuro, no una reducción de costos inmediata. Eso explica algo que no cierra si mirás solo los titulares: Meta despidió miles de personas en los últimos dos años Y al mismo tiempo comprometió USD 135.000 millones en infraestructura IA. Los despidos no ocurrieron porque la IA reemplazó esos roles. Ocurrieron por reestructuraciones, presión de inversores y cambio de prioridades estratégicas. La IA fue el destino del presupuesto liberado, no la causa de los despidos.

Son dos fenómenos distintos que se solapan en el tiempo y generan confusión.

Errores comunes al pensar en costos de IA

Error 1: comparar el costo de una GPU con el sueldo de un empleado. Una GPU no hace el trabajo de una persona. Necesitás múltiples GPUs, más la infraestructura de red, almacenamiento, refrigeración y el equipo humano que lo mantiene. La comparación justa es el costo total del sistema, no el hardware aislado.

Error 2: asumir que bajar el costo por consulta reduce el gasto total. Si el costo por consulta baja 90% pero el volumen sube 20 veces, gastás el doble. Las proyecciones optimistas de reducción de costos suelen ignorar el efecto rebote en demanda.

Error 3: confundir costo de entrenamiento con costo de operación. Empresas chicas que ven la cifra de USD 191 millones para entrenar Gemini Ultra y asumen que “hacer IA propia” cuesta eso. Para la mayoría de los casos de uso empresarial, el fine-tuning de un modelo existente o el uso vía API cuesta órdenes de magnitud menos. El costo de entrenamiento desde cero es un problema de las big labs, no de las empresas que usan IA.

Preguntas Frecuentes

¿Cuánto cuesta operar un modelo de IA grande en producción?

Depende del tamaño del modelo y el volumen de uso, pero como referencia: alquilar una GPU NVIDIA H100 en la nube cuesta entre USD 2,50 y USD 9 por hora. Un cluster de 100 GPUs corriendo 24/7 puede costar entre USD 2 millones y USD 4,8 millones anuales, sin contar electricidad ni equipo de soporte. Para modelos pequeños o APIs de terceros, los costos son significativamente menores.

¿Por qué el costo de compute supera el costo de los empleados en IA?

Porque la infraestructura necesaria para correr modelos grandes a escala (GPUs, servidores, almacenamiento, refrigeración, red) tiene un costo que escala con el uso y es continuo. Un ingeniero cuesta USD 150.000 al año; un cluster de 100 GPUs H100 puede costar entre USD 2 millones y USD 5 millones anuales. En empresas como Google o Meta, los equipos de IA tienen miles de personas pero usan infraestructura que vale decenas de miles de millones.

¿Cuánto gastan Meta, Google y Microsoft en infraestructura IA en 2026?

Meta tiene comprometidos entre USD 115.000 y USD 135.000 millones para infraestructura IA en 2026. Google está cerca de USD 185.000 millones y Microsoft alrededor de USD 105.000 millones. Sumando otros actores del sector, el total se acerca a USD 700.000 millones a nivel global en este año.

¿Los costos de IA van a bajar en los próximos años?

El costo por consulta de inferencia podría caer más del 90% en cuatro años, según la proyección de Fortune citando el contexto de las declaraciones de Catanzaro. Eso no significa que el gasto total de las empresas vaya a bajar: el volumen de uso crece más rápido que la reducción de costos unitarios. A mediano plazo, modelos más eficientes y hardware más accesible van a cambiar la ecuación para empresas medianas.

¿La IA reemplaza empleados y por eso las empresas tech despidieron personal?

El MIT estimó que solo el 23% de los roles donde podría aplicarse IA son rentables de automatizar hoy. El 67% de las empresas que implementaron IA no redujeron personal. Los despidos en Meta, Google y Microsoft entre 2024 y 2026 respondieron a reestructuraciones estratégicas y presión de inversores, no a reemplazos directos por IA. La IA fue el destino de ese presupuesto liberado, no la causa de los recortes.

Conclusión

La declaración de Catanzaro pone en palabras algo que los balances de las big tech ya venían mostrando: en 2026, apostar a IA no ahorra dinero de forma inmediata. Es una inversión de capital masiva con retorno incierto y horizonte largo. Los USD 700.000 millones que el sector va a gastar en infraestructura este año superan la nómina combinada de esas mismas empresas.

Para equipos en Latinoamérica que están evaluando si “hacer IA propia” tiene sentido: la respuesta casi siempre es no, al menos no desde cero. Usar modelos vía API, hacer fine-tuning de modelos open source en infraestructura moderada, o construir sobre providers existentes es el camino que tiene sentido económico para el 95% de los casos de uso reales. El hardware de USD 40.000 por GPU es un problema de Nvidia, Google y Meta, no tuyo.

Lo que sí cambia para todos es el contexto competitivo: las empresas que tienen acceso a esa infraestructura cara están construyendo ventajas que son difíciles de replicar. El costo de compute es la nueva barrera de entrada.

Fuentes

- Fortune – Declaración de ejecutivo de Nvidia sobre costos de compute vs empleados (abril 2026)

- TechSpot – Costos de compute IA y su comparación con costos laborales

- SZWecent – Guía completa de precios de NVIDIA H100 en 2026

- WWWhatsnew – Meta y su inversión de USD 135.000 millones en IA para 2026

- ITNow – Cuánto cuesta entrenar un modelo de IA