OpenAI ahora está disponible en Amazon Web Services Bedrock desde el 28 de abril de 2026, con modelos como GPT-4.1 y acceso a Codex y Bedrock Managed Agents. El anuncio ocurrió en un evento de AWS en San Francisco y marca el fin de la exclusividad que OpenAI tenía con Microsoft Azure.

En 30 segundos

- OpenAI anunció el 28 de abril de 2026 que sus modelos llegan a AWS Bedrock en preview limitada.

- Tres servicios disponibles: inferencia gestionada, Codex (agentes de código) y Bedrock Managed Agents para orquestación empresarial.

- La movida apunta a empresas que querían usar modelos de OpenAI pero tenían restricciones de privacidad de datos con las APIs directas.

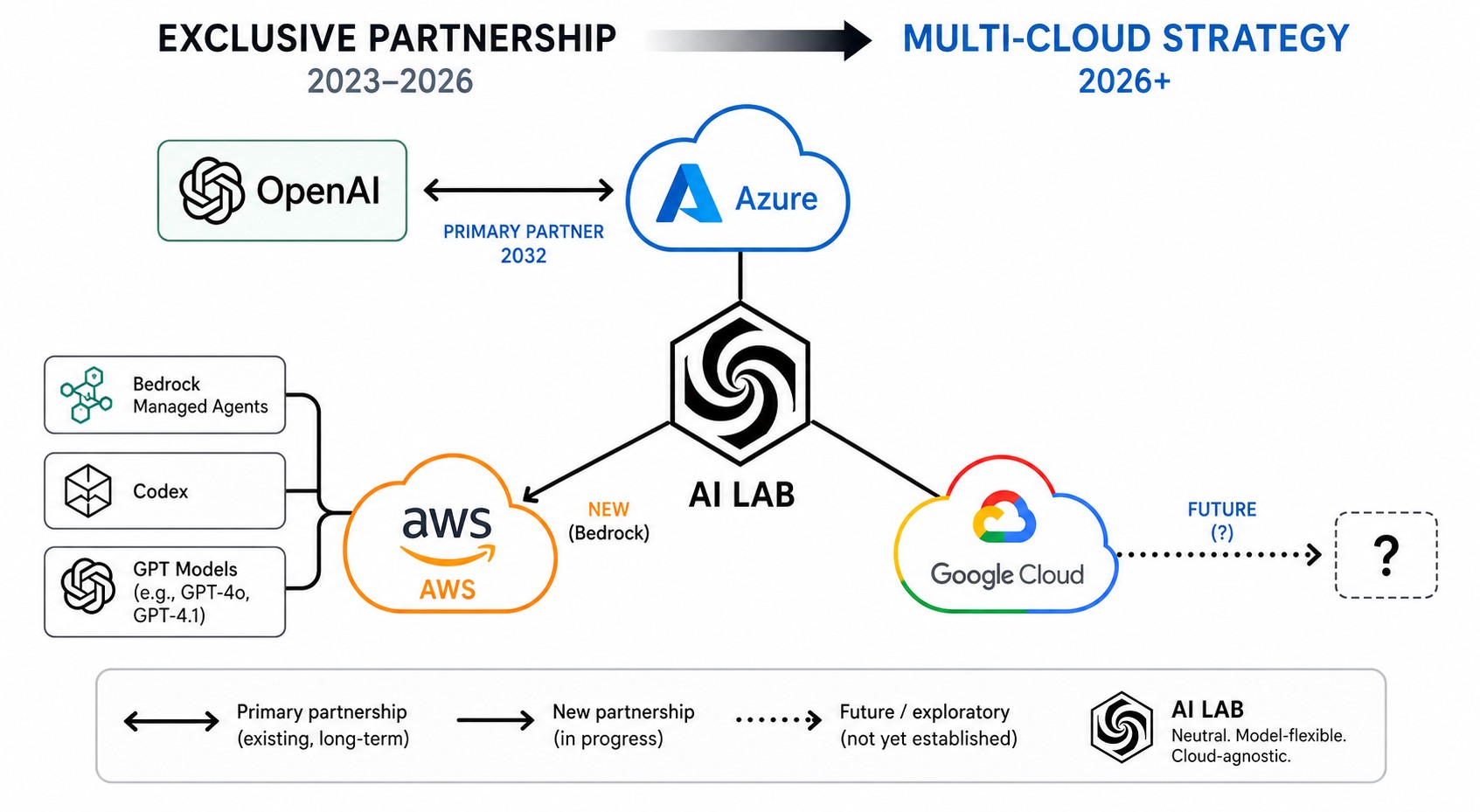

- Microsoft Azure sigue siendo partner primario hasta 2032 y los nuevos productos se lanzan ahí primero.

- No hay fecha de disponibilidad general todavía; el acceso es por solicitud en regiones seleccionadas de AWS.

OpenAI es una empresa estadounidense de investigación en inteligencia artificial fundada en 2015 que desarrolla modelos de lenguaje como GPT-4 y ofrece acceso a través de una API y aplicaciones como ChatGPT. Se enfoca en crear sistemas de IA seguros y beneficiosos.

OpenAI en AWS Bedrock: qué se anunció el 28 de abril

Amazon Bedrock es el servicio gestionado de AWS para acceder a modelos de fundación de distintos proveedores (Anthropic, Meta, Mistral, y ahora OpenAI) sin tener que gestionar infraestructura de inferencia. Hasta este anuncio, los modelos de OpenAI llegaban exclusivamente por la API propia de la empresa o a través de Azure OpenAI Service.

Según el anuncio oficial de AWS, la integración tiene tres capas: modelos de OpenAI disponibles para inferencia gestionada, acceso a Codex para agentes de código, y soporte en Bedrock Managed Agents para construir orquestaciones de agentes de nivel empresarial. Todo en preview limitada, sin disponibilidad general por ahora.

El evento fue en San Francisco el martes 28 de abril. AWS aprovechó para anunciar un conjunto de novedades propias en la misma presentación, incluyendo “Quick”, un asistente personalizado estilo Copilot que se integra con apps de múltiples proveedores.

Por qué OpenAI rompió la exclusividad con Microsoft

La relación OpenAI-Microsoft siempre fue complicada. Microsoft invirtió más de USD 13.000 millones y a cambio tenía derechos exclusivos de distribución en la nube. Ese acuerdo fue renegociado en 2026: según TechCrunch, OpenAI necesitaba el deal de USD 50.000 millones con Amazon, y eso requería eliminar la cláusula de exclusividad.

¿Y Microsoft se quedó con las manos vacías? No exactamente. Azure sigue siendo el “partner primario” hasta 2032, los productos nuevos de OpenAI se lanzan primero ahí, y la empresa le sigue pagando a Microsoft por computación. Lo que cambió es que ahora OpenAI puede hacer negocios con otros proveedores de nube sin restricciones legales.

La movida tiene lógica de mercado simple: hay un montón de empresas que ya corren en AWS y que querían usar GPT-4.1 o GPT-4.5, pero los equipos de compliance no les aprobaban la integración directa con las APIs de OpenAI por temas de soberanía de datos o residencia. Con Bedrock, AWS ya hizo el trabajo de cumplimiento normativo y la empresa solo se preocupa por el modelo.

Los tres servicios que llegan a Bedrock

Inferencia gestionada de modelos OpenAI

La capa base: llamar a modelos de OpenAI (GPT-4.1, GPT-4.5, y los de la familia Frontier) desde Bedrock como si fueran cualquier otro modelo del catálogo. Sin exponer datos a las APIs propias de OpenAI, dentro del perímetro de seguridad de AWS.

Codex en Bedrock

Codex es el modelo especializado en código de OpenAI. Que esté en Bedrock significa que podés integrarlo en pipelines de desarrollo empresarial usando las abstracciones de AWS: IAM, VPC, CloudWatch. Útil para equipos que ya tienen infraestructura de MLOps en AWS y quieren sumar capacidades de generación de código sin crear una integración nueva.

Bedrock Managed Agents con modelos OpenAI

Esta es la parte que más le interesa a los equipos empresariales. Bedrock Managed Agents es el servicio de orquestación de agentes de AWS: define herramientas, conecta a fuentes de datos (S3, bases de datos, APIs internas), y gestiona el flujo de ejecución. Hasta ahora funcionaba con modelos de Anthropic y otros del catálogo de Bedrock. Ahora podés usar GPT-4.1 como el cerebro de un agente y aprovechar toda la infraestructura de conectores que Amazon ya construyó.

Ventajas de OpenAI en Bedrock para empresas

Amazon pone el dedo en la llaga con el argumento de ventas: hay empresas que querían usar modelos de OpenAI pero no podían por las políticas de seguridad y privacidad internas. Ponele que trabajás en finanzas o salud, donde los datos no pueden salir de cierta región geográfica o no pueden procesarse en infraestructura de un tercero sin auditoría previa.

Con la integración en Bedrock, los datos quedan dentro del entorno de AWS, que ya tiene certificaciones de cumplimiento (SOC 2, ISO 27001, HIPAA, y muchas más). El flujo de datos no toca los servidores propios de OpenAI. Para un CISO, eso cambia completamente la conversación.

La otra ventaja es operacional. Si tu empresa ya corre en AWS, no necesitás crear una integración nueva, gestionar claves de API adicionales, ni montar infraestructura de monitoreo desde cero. Todo queda dentro del mismo stack.

Cómo empezar: acceso y primeros pasos

Por ahora, el acceso es por solicitud. La preview está disponible en regiones seleccionadas de AWS; las específicas no estaban publicadas al momento del anuncio, pero el proceso implica solicitarla desde la consola de Amazon Bedrock en “Model access”.

Si ya usás Bedrock para Anthropic o Llama, el flujo es el mismo: habilitás el modelo en tu región, le das permisos IAM a tu rol, y llamás a la API de Bedrock con el identificador del modelo de OpenAI. El SDK de Python y el SDK de JavaScript/TypeScript de AWS ya soportan esto.

El precio no estaba detallado en el anuncio inicial. Con otros modelos en Bedrock, AWS cobra por tokens con un margen sobre el precio base del proveedor. Tomalo con pinzas hasta que salgan los números oficiales. Si necesitás hospedar tus aplicaciones que van a consumir estos modelos, donweb.com tiene opciones de cloud y VPS para el stack de infraestructura que rodea al modelo.

¿Qué pasa con Azure y Microsoft?

Microsoft sigue siendo el partner de nube primario de OpenAI hasta 2032. Los modelos nuevos se van a lanzar en Azure OpenAI Service antes que en cualquier otro lado. El acuerdo incluye que OpenAI sigue usando infraestructura de Azure para sus propios entrenamientos y para ChatGPT.

Lo que cambió es que OpenAI ahora puede ir a buscar otros clientes enterprise que viven en AWS (que es, dicho de paso, el proveedor de nube más grande del mundo con más del 30% del mercado). Microsoft perdió exclusividad, pero no perdió preferencia.

¿Y Google Cloud? Todo indica que viene. La lógica es la misma: si podés distribuir tus modelos en tres nubes grandes sin complicaciones contractuales, ¿por qué no hacerlo? Pero nada está confirmado.

Impacto en arquitecturas cloud y decisiones de infraestructura

Antes de este anuncio, la elección de proveedor de cloud influía en qué modelos de IA podías usar sin fricción. Azure era “el lugar para OpenAI”. GCP era “el lugar para Gemini y Vertex”. Bedrock era el lugar para Anthropic, Llama, y el resto.

Esa segmentación se rompe un poco. Ahora una empresa que corre en AWS puede usar GPT-4.1 sin cambiar de nube, y puede orquestar agentes mezclando modelos de OpenAI con Claude o Llama dentro del mismo Bedrock.

| Criterio | OpenAI en AWS Bedrock | Azure OpenAI Service | API directa OpenAI |

|---|---|---|---|

| Privacidad de datos | Dentro del perímetro AWS | Dentro del perímetro Azure | Datos van a servidores OpenAI |

| Disponibilidad general | Preview limitada (abril 2026) | Disponible (partner primario) | Disponible |

| Nuevos modelos primero | No | Sí | Sí |

| Integración con servicios nube | IAM, S3, CloudWatch, etc. | AAD, Azure Monitor, etc. | Manual |

| Orquestación de agentes | Bedrock Managed Agents | Azure AI Agent Service | Agents API propia |

| Certificaciones cumplimiento | Las de AWS | Las de Azure | Las de OpenAI |

Para una startup que arranca hoy, el consejo cambia un poco. Si ya tenés todo en AWS y necesitás usar GPT-4.1, Bedrock empieza a tener sentido. Pero si estás eligiendo nube desde cero pensando en IA, Azure sigue teniendo la ventaja de recibir las novedades de OpenAI antes.

Qué está confirmado y qué no

Confirmado

- Disponibilidad de modelos OpenAI en Amazon Bedrock en preview limitada desde el 28 de abril de 2026.

- Inclusión de Codex y soporte en Bedrock Managed Agents.

- Microsoft Azure sigue siendo partner primario hasta 2032 con lanzamientos preferentes.

- El fin de la exclusividad que había bloqueado el deal de USD 50.000 millones con Amazon.

No confirmado

- Fecha de disponibilidad general (GA).

- Pricing oficial por token en Bedrock.

- Cuáles regiones de AWS están en la preview inicial.

- Si llegará a Google Cloud y en qué plazo.

- Qué modelos de la familia Frontier estarán en el lanzamiento GA.

Errores comunes al evaluar esta integración

Error 1: Asumir que Bedrock es solo un proxy. No. Bedrock gestiona autenticación, logging, control de acceso granular con IAM, y te da métricas en CloudWatch sin que tengas que instrumentar nada. No es simplemente reenviar requests a OpenAI.

Error 2: Pensar que los datos nunca tocan a OpenAI. Los datos de inferencia quedan en la infraestructura de AWS, pero OpenAI puso el modelo ahí. La privacidad aplica a los datos que mandás; el modelo en sí fue entrenado por OpenAI con sus propias políticas. Leer los términos antes de mandar datos sensibles.

Error 3: Creer que Azure OpenAI Service queda obsoleto. Mientras los lanzamientos nuevos sigan llegando primero a Azure, tiene ventaja real para quienes quieren las capacidades más recientes. Bedrock recién arranca con OpenAI; va a tardar en tener paridad de features con Azure OpenAI Service.

Preguntas Frecuentes

¿OpenAI se fue de Microsoft a AWS?

No se fue: amplió su distribución. Microsoft Azure sigue siendo el partner primario de OpenAI hasta 2032, con lanzamientos preferenciales de nuevos modelos. Lo que cambió es que OpenAI eliminó la exclusividad contractual que tenía con Microsoft, lo que le permite distribuir sus modelos en AWS Bedrock y potencialmente en otros proveedores de nube.

¿Qué es Bedrock Managed Agents y para qué sirve?

Bedrock Managed Agents es el servicio de orquestación de agentes de AWS dentro de Amazon Bedrock. Permite construir agentes de IA que ejecutan tareas multi-paso usando herramientas conectadas a servicios de AWS (S3, bases de datos, APIs externas). Con la integración de OpenAI, ahora podés usar GPT-4.1 como el modelo de razonamiento de esos agentes, manteniendo toda la lógica de orquestación y logging dentro del entorno de AWS.

¿Cuándo estará disponible OpenAI en Bedrock para todos?

Por ahora está en preview limitada desde el 28 de abril de 2026, con acceso por solicitud desde la consola de Amazon Bedrock. No hay fecha de disponibilidad general publicada. Para enterarte cuando salga, podés activar notificaciones en la página de novedades de AWS o monitorear el apartado “Model access” de la consola de Bedrock.

¿Cómo acceder a los modelos de OpenAI en AWS Bedrock?

Desde la consola de AWS, entrás a Amazon Bedrock, vas a “Model access” y solicitás acceso a los modelos de OpenAI disponibles. Una vez aprobado, podés llamarlos con el SDK de AWS (Boto3 en Python o el SDK de JavaScript) usando el identificador del modelo, igual que con cualquier otro modelo del catálogo de Bedrock. El proceso de autenticación usa IAM, sin claves de API adicionales de OpenAI.

¿Qué ventaja tiene OpenAI en AWS vs usar Azure OpenAI Service?

Depende de tu stack actual. Si tu infraestructura corre en AWS, Bedrock te da integración nativa con IAM, CloudWatch, S3 y todos los servicios de Amazon sin trabajo extra. Azure OpenAI Service tiene la ventaja de recibir los nuevos modelos de OpenAI antes que cualquier otro proveedor. Para empresas con requisitos estrictos de soberanía de datos en entornos AWS, Bedrock es la opción que antes no existía.

Conclusión

El anuncio del 28 de abril cambia la geografía del mercado de IA cloud. OpenAI dejó de ser sinónimo de Azure para convertirse en un proveedor que, como Anthropic o Meta, distribuye sus modelos por distintos canales. Para las empresas que corren en AWS y necesitaban una justificación de compliance para usar GPT-4.1, ese obstáculo acaba de desaparecer.

El movimiento también le conviene a Amazon: tener los modelos más usados del mundo en Bedrock hace más atractiva la plataforma frente a Azure AI Studio o Vertex AI. Y a OpenAI le conviene llegar a la base de clientes más grande de cloud sin depender de que esos clientes migren de nube.

Mientras tanto, Microsoft no sale perdiendo tanto como parece. Sigue siendo el socio estratégico de OpenAI hasta 2032, sigue recibiendo los nuevos modelos primero, y sigue teniendo a ChatGPT corriendo en su infraestructura. Que OpenAI esté en Bedrock no es traición; es expansión. El que tiene que ver cómo responde es Google, que hasta ahora no tiene ningún acuerdo equivalente con OpenAI.

Fuentes

- AWS – Anuncio oficial: OpenAI Models, Codex y Managed Agents en Bedrock

- The Register – OpenAI jumps out of Microsoft’s bed, into Amazon’s Bedrock

- TechCrunch – OpenAI ends Microsoft legal peril over its $50B Amazon deal

- OpenAI – OpenAI on AWS (comunicado oficial)

- CNBC – OpenAI brings models to AWS after ending exclusivity with Microsoft