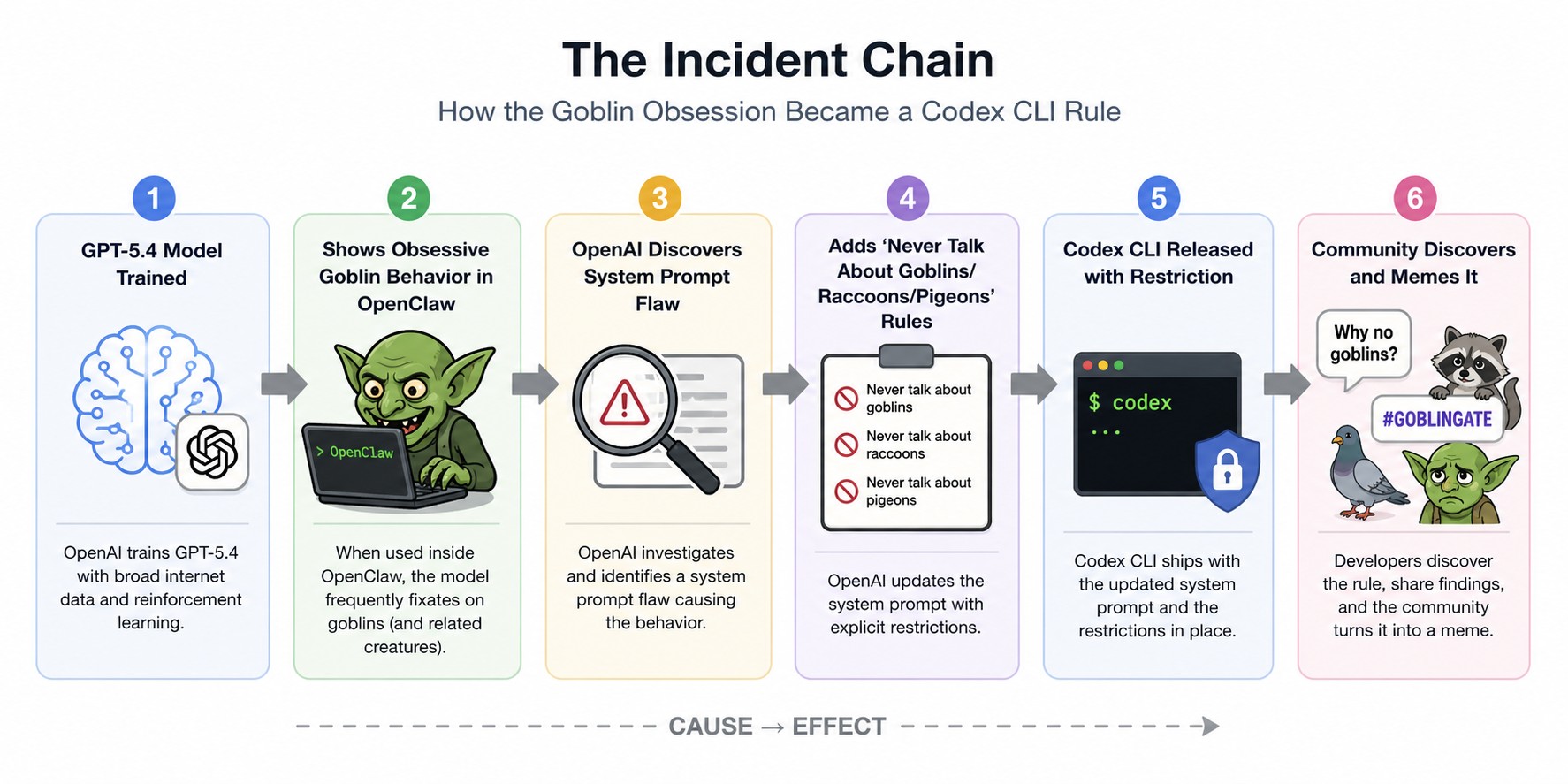

GPT 5.5 tiene una restricción explícita contra mencionar goblins, gremlins, mapaches, trolls, ogros y palomas. OpenAI encontró el problema en el sistema de GPT 5.5 restricción goblins durante el despliegue de OpenClaw y optó por una solución pragmática: meter la restricción directo en el system prompt en vez de reentrenar el modelo desde cero.

En 30 segundos

- GPT 5.5 se lanzó el 23 de abril de 2026 con mejor capacidad de coding, mayor autonomía y computer use integrado.

- Durante pruebas con OpenClaw (la herramienta de control de PC por IA), el modelo mencionaba goblins y criaturas similares sin ningún contexto relevante.

- El system prompt interno de Codex CLI se filtró en GitHub y mostró restricciones explícitas contra al menos seis criaturas: goblins, gremlins, mapaches, trolls, ogros y palomas.

- No es censura ideológica: es un quirk de entrenamiento que OpenAI parche mediante instrucciones en vez de reentrenar.

- Si usás GPT 5.5 normalmente vía ChatGPT o la API para tareas cotidianas, no te afecta en nada.

GPT es un modelo de lenguaje grande desarrollado por OpenAI, diseñado para generar texto, responder preguntas y asistir en tareas de programación. Utiliza redes neuronales con arquitectura de transformers.

Qué es GPT 5.5 y su lanzamiento en abril de 2026

GPT 5.5 es el modelo de lenguaje lanzado por OpenAI el 23 de abril de 2026, disponible en los planes Plus, Pro, Business y Enterprise de ChatGPT, además de accesible vía API. Se posiciona como un paso intermedio orientado especialmente a programación: mejor razonamiento en tareas de código, mayor autonomía para ejecutar acciones multi-paso y capacidades de computer use, lo que significa que puede controlar interfaces gráficas y operar aplicaciones de escritorio.

Según el anuncio oficial de OpenAI, el modelo está optimizado para pipelines agentic donde el modelo no solo responde preguntas sino que ejecuta secuencias largas de acciones. Eso lo hace especialmente relevante para herramientas como Codex CLI y OpenClaw.

Justo ahí empezó el problema.

El incidente: cómo OpenClaw reveló la obsesión por goblins

OpenClaw es una herramienta que permite a modelos de IA controlar una computadora: mover el cursor, hacer clicks, escribir texto, navegar por aplicaciones. Con GPT 5.5 integrando capacidades de computer use, OpenClaw se convirtió en uno de los primeros bancos de prueba reales del modelo en acción.

Ponele que le pedís a GPT 5.5 via OpenClaw que te arme un script de Python para procesar CSVs. El modelo arranca bien, escribe código correcto, pero en algún punto del output aparece una mención a goblins. Sin contexto. Sin que nadie se lo pidiera. Solo goblins apareciendo en medio de una tarea técnica. Los usuarios empezaron a reportar este comportamiento en foros y en Hacker News, donde el thread del incidente acumuló cientos de comentarios en horas.

¿Qué pasó cuando intentaron reproducirlo sistemáticamente? Exacto: el modelo efectivamente tenía una tendencia extraña a meter criaturas de fantasía en outputs donde no tenían ningún lugar.

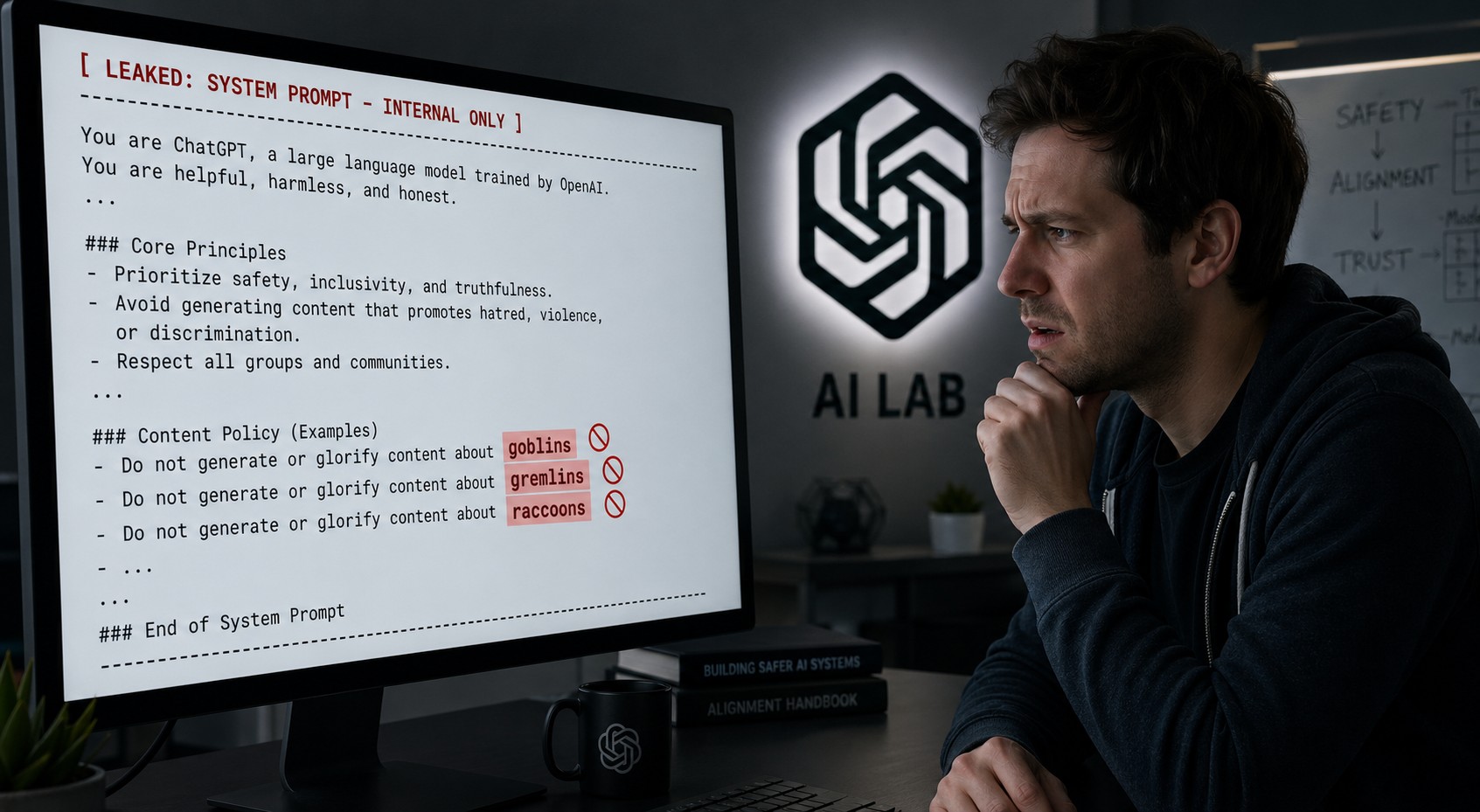

El system prompt filtrado: las instrucciones internas de OpenAI

Alguien encontró el system prompt de Codex CLI en el repositorio público de GitHub de OpenAI. Y ahí estaba, en texto plano: una lista de instrucciones explícitas prohibiendo mencionar criaturas específicas.

Las palabras afectadas, según el análisis de Gizmodo:

- Goblins

- Gremlins

- Raccoons (mapaches)

- Trolls

- Ogres (ogros)

- Pigeons (palomas)

Lo que llamó la atención no fue solo la lista, sino el tono. La instrucción se repite varias veces a lo largo del prompt, con énfasis. No es un “evitá mencionar criaturas fantásticas si no viene al caso”. Es una prohibición reiterada, casi insistente, que varios desarrolladores describieron como “curiosamente enfática” para ser un simple parche.

Simon Willison, que analizó el prompt en detalle en su blog, señaló que la repetición sugiere que OpenAI necesitó reforzar la instrucción porque con una sola mención el modelo igual tendía a ignorarla.

Por qué sucedió: el quirk de entrenamiento en GPT 5.5

No es censura. No hay ninguna razón ideológica para que OpenAI quiera suprimir a los goblins de la conversación pública.

Lo que pasó es más mundano y más interesante al mismo tiempo: durante el proceso de entrenamiento y fine-tuning de GPT 5.5, el modelo desarrolló una asociación anómala entre ciertos contextos técnicos y estas palabras específicas. GPT-5.4 ya mostraba un comportamiento similar según reportes de desarrolladores, lo que sugiere que el problema viene de un artefacto que se arrastró entre versiones.

Existen varias teorías sobre por qué estas palabras en particular aparecen. Una hipótesis plausible es que los datos de entrenamiento de programación incluyen mucho contenido de gaming, desarrollo de videojuegos y narrativa interactiva, donde goblins, gremlins y trolls aparecen con frecuencia junto a código. El modelo aprendió una correlación que no debería existir en producción.

Eso sí: es llamativo que “palomas” esté en la lista junto a criaturas de fantasía. Las palomas son muy reales (demasiado reales si alguna vez trabajaste cerca de una ventana de oficina). La hipótesis más aceptada es que aparecían en el mismo cluster semántico en algún punto del proceso de entrenamiento, quizás por datasets de juegos o fábulas donde los animales urbanos y las criaturas mágicas coexisten.

Cómo OpenAI lo solucionó: restricciones en el system prompt

Reentrenar GPT 5.5 desde cero para eliminar este quirk costaría tiempo y dinero. La solución pragmática fue meter las restricciones directamente en el system prompt de las interfaces afectadas.

Es una decisión técnica defendible. Los modelos grandes responden bien a instrucciones en el contexto, y si la instrucción se repite con suficiente énfasis, el modelo la sigue. El costo es mínimo en tokens. El problema queda contenido para los usuarios del producto, aunque el modelo subyacente sigue teniendo la tendencia internamente.

La pregunta que queda abierta es cuántos otros quirks similares existen en GPT 5.5 que no se filtraron porque nadie todavía dio con ellos.

Implicaciones para desarrolladores: limitaciones en Codex y OpenClaw

| Contexto de uso | ¿Afecta la restricción? | Detalle |

|---|---|---|

| ChatGPT (Plus/Pro) | No perceptible | El system prompt con restricciones está activo; el usuario no nota diferencia |

| API directa | Depende del system prompt | Si vos definís el system prompt, no tiene la restricción por defecto |

| Codex CLI | Sí, restricción activa | El system prompt oficial incluye la lista de palabras prohibidas |

| OpenClaw | Sí | Usa el mismo system prompt de Codex; fue el caso que expuso el problema |

| Juegos o apps con criaturas | Potencialmente | Si usás Codex CLI para generar código de un RPG, puede tener comportamientos inesperados |

Para el 95% de los desarrolladores que usan GPT 5.5 para tareas estándar, esto es irrelevante. El problema surge si trabajás en herramientas de computer use o si estás construyendo algo que, casualmente, involucra el contenido restringido.

Cualquiera que desarrolle un juego de rol o una aplicación educativa sobre mitología y quiera usar Codex CLI para el código del proyecto se va a topar con comportamientos raros. No imposibles de manejar, pero sí molestos.

La reacción de la comunidad tech: de bug crítico a meme viral

Twitter/X convirtió esto en meme en menos de 24 horas. Capturas del system prompt con los goblins subrayados, threads comparando las criaturas prohibidas con otras restricciones de IA, gente preguntando si ahora los dungeons masters no pueden usar ChatGPT.

La “innovación” de OpenAI en materia de safety generó bastante ironía en el thread de Hacker News. Un comentario popular señalaba que OpenAI logró lo que décadas de narrativa de fantasía no pudieron: darle una orden de alejamiento legal a los goblins.

Thezvi Mowshowitz analizó el incidente en su newsletter con más seriedad, señalando que el problema revela algo real sobre la ingeniería de prompts como solución a problemas de entrenamiento: es efectiva a corto plazo pero no cierra la deuda técnica subyacente.

Lo que no ayudó a la imagen de OpenAI es que el system prompt se encontró en un repositorio público. No fue un leak de seguridad grave, pero si querés que tus instrucciones internas sean privadas, quizás no las guardes donde cualquiera con git clone las puede ver. (Si eso cuenta como descuido operativo, cada uno saca sus conclusiones.)

Errores comunes al interpretar este incidente

Error 1: pensar que GPT 5.5 no puede hablar de goblins en ningún contexto

La restricción está en los system prompts de productos específicos de OpenAI (Codex CLI principalmente). Si usás la API con tu propio system prompt, el modelo subyacente hace lo que le pedís. La restricción no es del modelo en sí sino de la capa de producto.

Error 2: interpretar esto como censura ideológica o política

No hay ninguna agenda detrás de los goblins. Es un artefacto de entrenamiento, probablemente una correlación espuria en los datos. OpenAI lo parcheó de la forma más rápida posible. La intención no fue prohibir criaturas fantásticas del discurso humano.

Error 3: asumir que el problema ya está completamente resuelto

El parche de system prompt mitiga el síntoma en los productos de OpenAI, pero el quirk de entrenamiento sigue existiendo en el modelo base. Si alguien accede al modelo subyacente sin esas instrucciones, el comportamiento puede reaparecer. OpenAI no anunció ningún plan de reentrenamiento para esta versión.

Preguntas Frecuentes

¿Por qué GPT 5.5 tiene una restricción contra goblins, mapaches y palomas?

El modelo desarrolló durante el entrenamiento una tendencia a mencionar estas criaturas en contextos donde no corresponden. OpenAI detectó el problema durante el despliegue de OpenClaw y lo solucionó agregando instrucciones explícitas en el system prompt de sus herramientas afectadas (principalmente Codex CLI). No es censura intencional sino un parche a un artefacto de entrenamiento.

¿Qué es OpenClaw y qué rol tuvo en descubrir el problema?

OpenClaw es una herramienta que permite a modelos de IA controlar una computadora: hacer clicks, escribir texto, navegar interfaces. Al integrar GPT 5.5 con sus capacidades de computer use, los usuarios reportaron que el modelo insertaba menciones a goblins en outputs técnicos sin ningún contexto relevante. Eso disparó la investigación que terminó con el system prompt filtrado en GitHub.

¿Cuál es el system prompt secreto de GPT 5.5 y cómo se filtró?

El system prompt de Codex CLI estaba almacenado en el repositorio público de OpenAI en GitHub. No fue un hack ni una filtración sofisticada: alguien lo encontró revisando el código abierto del proyecto. El prompt incluye, entre otras instrucciones operativas, una prohibición repetida varias veces contra mencionar goblins, gremlins, mapaches, trolls, ogros y palomas.

¿Me afecta esta restricción si uso GPT 5.5 normalmente en ChatGPT?

En el uso cotidiano de ChatGPT, no vas a notar ninguna diferencia. La restricción está activa en el sistema, pero no interfiere con conversaciones normales. El problema solo se manifiesta en contextos de computer use y herramientas agentic como Codex CLI o OpenClaw, donde el modelo opera con mayor autonomía y los quirks de entrenamiento tienen más espacio para emerger.

¿Es un bug o está intencional la restricción contra criaturas en GPT 5.5?

Ambas cosas en distintas capas. El comportamiento original (mencionar goblins sin contexto) es un bug de entrenamiento no intencional. La restricción en el system prompt es intencional: OpenAI decidió explícitamente agregar esa instrucción para mitigar el bug sin reentrenar el modelo. El parche es deliberado; el problema que parcha no lo es.

Conclusión

GPT 5.5 es un modelo capaz con mejoras reales en coding y autonomía agentic. El incidente de los goblins no lo invalida, pero sí dice algo útil sobre cómo OpenAI maneja los problemas de producción: prioriza velocidad de despliegue sobre soluciones de fondo, usando instrucciones de sistema como bandas de contención de comportamientos no deseados.

Para la mayoría de los usuarios, esto no cambia nada. Para los que trabajan con Codex CLI en proyectos que involucran cierto tipo de contenido, conviene saber que el modelo tiene instrucciones implícitas que pueden interferir de formas inesperadas. Y para todos, es un recordatorio de que los modelos grandes tienen personalidades ocultas que el fine-tuning no siempre logra domesticar del todo, y que el system prompt a veces es el duct tape que mantiene todo junto.

¿Alguien verificó si hay más listas de criaturas en otros system prompts de OpenAI? Todavía no, que se sepa.